Geospatial-Reasoning-Driven Vocabulary-Agnostic Remote Sensing Semantic Segmentation

作者: Chufeng Zhou, Jian Wang, Xinyuan Liu, Xiaokang Zhang

分类: cs.CV

发布日期: 2026-02-09

备注: 5 pages, 3 figures

💡 一句话要点

提出GR-CoT框架,利用地理空间推理增强遥感语义分割的开放词汇识别能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 遥感语义分割 开放词汇学习 地理空间推理 多模态学习 知识蒸馏

📋 核心要点

- 现有开放词汇遥感语义分割方法依赖外观特征,缺乏地理空间上下文感知,易导致语义混淆和错误分类。

- 提出GR-CoT框架,通过离线知识蒸馏和在线实例推理,增强多模态大语言模型对场景的理解能力。

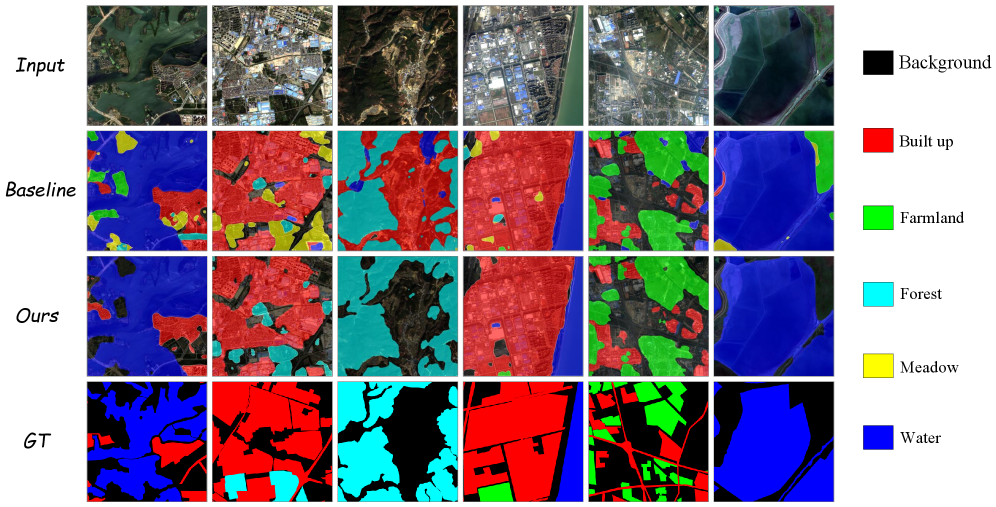

- 在LoveDA和GID5数据集上的实验表明,该方法能够有效提升开放词汇遥感语义分割的精度。

📝 摘要(中文)

开放词汇语义分割已成为遥感领域一个有前景的研究方向,它能够识别超出预定义类别集的多样地物覆盖类型。然而,现有方法主要依赖于视觉特征和文本嵌入的被动映射,这种“基于外观”的模式缺乏地理空间上下文感知,导致在遇到具有相似光谱特征但语义属性不同的地物类别时,出现严重的语义模糊和错误分类。为了解决这个问题,我们提出了一个地理空间推理链式思考(GR-CoT)框架,旨在增强多模态大型语言模型(MLLM)的场景理解能力,从而引导开放词汇分割模型实现精确映射。该框架包括两个协同组件:离线知识蒸馏流和在线实例推理流。离线流建立细粒度的类别解释标准,以解决相似地物类型之间的语义冲突。在在线推理过程中,该框架执行一个顺序推理过程,包括宏观场景锚定、视觉特征解耦和知识驱动的决策合成。这个过程生成一个图像自适应的词汇表,引导下游模型实现与正确地理语义的像素级对齐。在LoveDA和GID5基准上的大量实验证明了我们方法的优越性。

🔬 方法详解

问题定义:现有开放词汇遥感语义分割方法主要依赖于图像的视觉特征和文本嵌入之间的映射,忽略了地理空间上下文信息。这导致当不同地物具有相似的视觉特征时,模型难以区分它们,从而产生语义混淆和错误分类。例如,农田和草地可能具有相似的光谱特征,但它们的语义属性完全不同。现有方法缺乏有效利用地理空间知识的能力,是其性能瓶颈。

核心思路:本文的核心思路是引入地理空间推理能力,增强模型对遥感图像场景的理解。通过构建一个地理空间推理链式思考(GR-CoT)框架,利用多模态大型语言模型(MLLM)的强大推理能力,将地理空间知识融入到语义分割过程中。该框架旨在解决现有方法中“基于外观”的局限性,使模型能够根据地理空间上下文信息进行更准确的语义分割。

技术框架:GR-CoT框架包含两个主要组成部分:离线知识蒸馏流和在线实例推理流。离线知识蒸馏流负责建立细粒度的类别解释标准,解决相似地物类型之间的语义冲突。它通过从专家知识中提取信息,构建一个知识库,用于指导在线推理过程。在线实例推理流则执行一个顺序推理过程,包括宏观场景锚定、视觉特征解耦和知识驱动的决策合成。宏观场景锚定确定图像的大致地理位置和环境;视觉特征解耦旨在区分具有相似视觉特征的不同地物;知识驱动的决策合成则利用离线知识库和解耦后的视觉特征,生成一个图像自适应的词汇表,用于指导下游分割模型。

关键创新:该论文的关键创新在于提出了一个将地理空间推理融入到开放词汇遥感语义分割中的框架。与现有方法相比,GR-CoT框架能够利用地理空间上下文信息,解决语义混淆问题,提高分割精度。通过离线知识蒸馏和在线实例推理,该框架能够有效地将地理空间知识融入到模型中,使其能够更好地理解遥感图像的场景。

关键设计:离线知识蒸馏流的关键设计在于如何有效地从专家知识中提取信息,并构建一个可用于指导在线推理的知识库。在线实例推理流的关键设计在于如何实现宏观场景锚定、视觉特征解耦和知识驱动的决策合成。具体而言,宏观场景锚定可以通过地理编码或场景分类等技术实现;视觉特征解耦可以通过注意力机制或特征解耦模块实现;知识驱动的决策合成可以通过规则推理或知识图谱等技术实现。论文中具体的技术细节(例如损失函数、网络结构等)未知。

🖼️ 关键图片

📊 实验亮点

论文在LoveDA和GID5两个遥感数据集上进行了大量实验,结果表明提出的GR-CoT框架能够显著提升开放词汇遥感语义分割的性能。具体的性能数据和提升幅度未知,但摘要中明确指出该方法优于现有方法,证明了其有效性。

🎯 应用场景

该研究成果可广泛应用于智慧城市建设、农业资源监测、自然灾害评估、环境保护等领域。通过提升遥感图像的语义分割精度,可以更准确地识别和分析地物覆盖类型,为相关决策提供更可靠的数据支持。未来,该技术有望进一步推广到其他遥感应用场景,例如目标检测、图像配准等。

📄 摘要(原文)

Open-vocabulary semantic segmentation has emerged as a promising research direction in remote sensing, enabling the recognition of diverse land-cover types beyond pre-defined category sets. However, existing methods predominantly rely on the passive mapping of visual features and textual embeddings. This ``appearance-based" paradigm lacks geospatial contextual awareness, leading to severe semantic ambiguity and misclassification when encountering land-cover classes with similar spectral features but distinct semantic attributes. To address this, we propose a Geospatial Reasoning Chain-of-Thought (GR-CoT) framework designed to enhance the scene understanding capabilities of Multimodal Large Language Models (MLLMs), thereby guiding open-vocabulary segmentation models toward precise mapping. The framework comprises two collaborative components: an offline knowledge distillation stream and an online instance reasoning stream. The offline stream establishes fine-grained category interpretation standards to resolve semantic conflicts between similar land-cover types. During online inference, the framework executes a sequential reasoning process involving macro-scenario anchoring, visual feature decoupling, and knowledge-driven decision synthesis. This process generates an image-adaptive vocabulary that guides downstream models to achieve pixel-level alignment with correct geographical semantics. Extensive experiments on the LoveDA and GID5 benchmarks demonstrate the superiority of our approach.