Integrating Specialized and Generic Agent Motion Prediction with Dynamic Occupancy Grid Maps

作者: Rabbia Asghar, Lukas Rummelhard, Wenqian Liu, Anne Spalanzani, Christian Laugier

分类: cs.CV, cs.RO

发布日期: 2026-02-08

备注: Updated version with major revisions; currently under the second round of review at IEEE Transactions on Intelligent Vehicles

💡 一句话要点

提出结合动态占据栅格地图的通用与专用Agent运动预测框架,提升复杂场景下的预测精度。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 运动预测 动态占据栅格地图 自动驾驶 场景理解 时空预测

📋 核心要点

- 现有方法在复杂动态场景中预测Agent运动轨迹时,难以兼顾通用性和专用性,导致预测精度受限。

- 提出一种统一框架,结合动态占据栅格地图,同时预测占据状态、车辆和场景流,实现更全面的场景理解。

- 实验结果表明,该方法在nuScenes和Woven Planet数据集上,对动态车辆和通用动态场景元素的预测性能均优于基线方法。

📝 摘要(中文)

由于传感器数据的不确定性、Agent行为的复杂性以及多种可行未来轨迹的可能性,准确预测驾驶场景是一项具有挑战性的任务。现有的使用占据栅格地图的预测方法主要集中于与Agent无关的场景预测,而Agent特定的预测则借助语义信息提供专门的行为洞察。然而,这两种范式都面临着明显的局限性:与Agent无关的模型难以捕捉动态行为者的行为复杂性,而Agent特定的方法则无法推广到感知不佳或无法识别的Agent;结合两者可以实现更稳健和更安全的运动预测。为了解决这个问题,我们提出了一个统一的框架,通过利用动态占据栅格地图在一个简化的时间解码流程中,同时预测未来的占据状态栅格、车辆栅格和场景流栅格。我们的方法依赖于一个轻量级的时空骨干网络,其核心是一个定制的、相互依赖的损失函数,该函数捕捉栅格间的依赖关系并实现多样化的未来预测。通过使用占据状态信息来强制执行流引导的转换,损失函数充当一个正则化器,引导占据演化,同时考虑障碍物和遮挡。因此,该模型不仅预测车辆Agent的特定行为,而且识别其他动态实体并预测它们在复杂场景中的演化。在真实世界的nuScenes和Woven Planet数据集上的评估表明,与基线方法相比,该方法在动态车辆和通用动态场景元素的预测性能方面表现更优。

🔬 方法详解

问题定义:现有运动预测方法,要么侧重于Agent无关的场景预测,忽略了特定Agent的行为特性;要么侧重于Agent特定的预测,但泛化能力不足,无法处理感知不佳或未识别的Agent。这两种方法都难以在复杂动态场景中实现准确的运动预测。

核心思路:论文的核心思路是将Agent无关的场景预测和Agent特定的预测相结合,利用动态占据栅格地图作为统一的表示形式,并通过定制的损失函数来约束不同类型的栅格之间的关系,从而实现更全面和准确的运动预测。

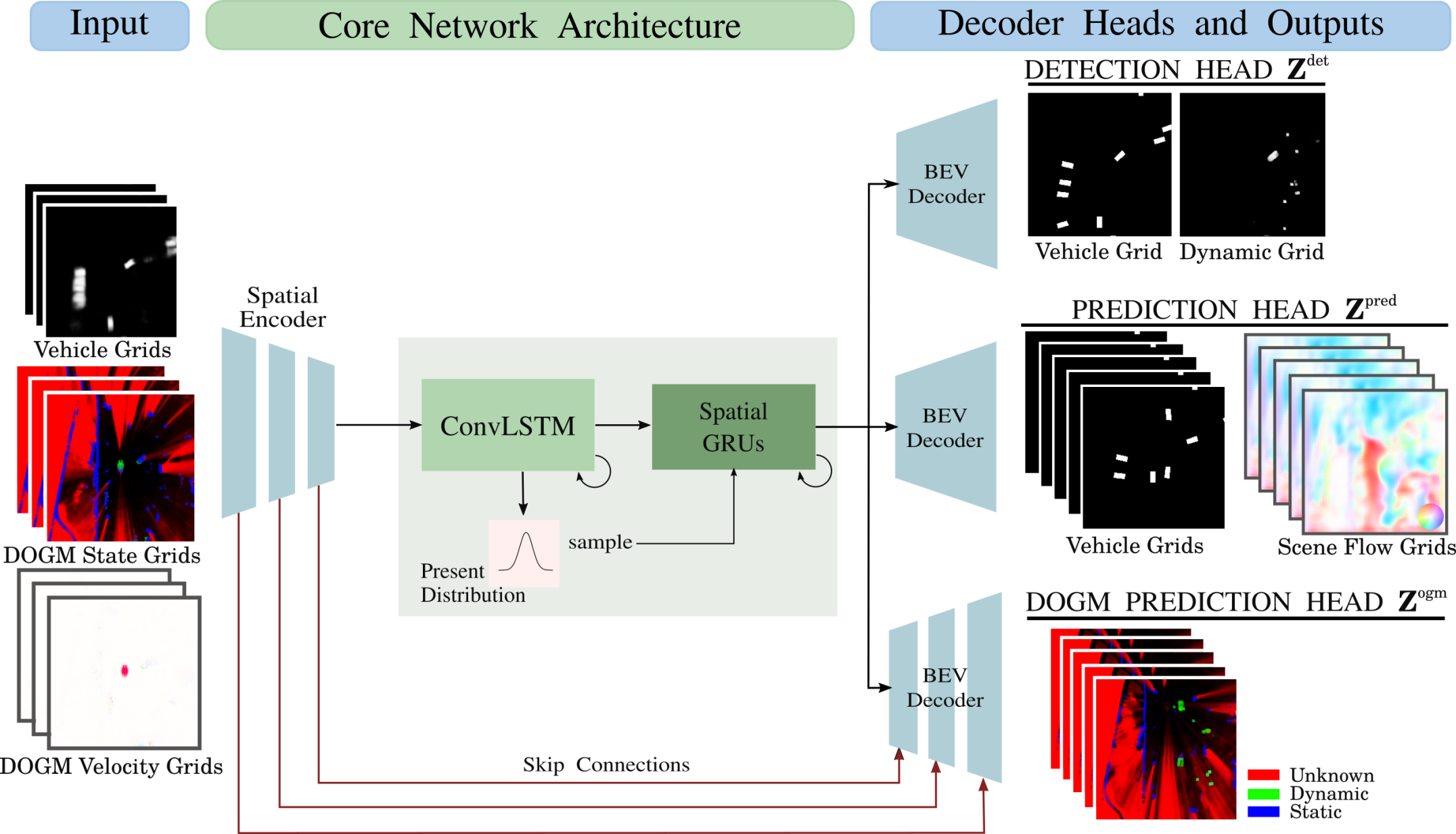

技术框架:该框架包含一个轻量级的时空骨干网络,用于提取时空特征。然后,通过一个时间解码流程,同时预测未来的占据状态栅格、车辆栅格和场景流栅格。关键在于一个定制的、相互依赖的损失函数,它捕捉栅格间的依赖关系,并利用占据状态信息来引导场景流的演化。

关键创新:该方法最重要的创新点在于将Agent无关和Agent特定的预测融合到一个统一的框架中,并设计了一个能够捕捉栅格间依赖关系的损失函数。这种方法能够更好地利用场景中的信息,从而提高运动预测的准确性和鲁棒性。

关键设计:损失函数是该方法设计的关键。它由多个部分组成,包括占据状态预测损失、车辆栅格预测损失和场景流预测损失。这些损失函数相互依赖,通过占据状态信息来约束场景流的演化,从而实现更准确的预测。具体的网络结构和参数设置在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

该方法在nuScenes和Woven Planet数据集上进行了评估,实验结果表明,与基线方法相比,该方法在动态车辆和通用动态场景元素的预测性能方面表现更优。具体的性能提升数据未在摘要中给出,属于未知信息,但结论是优于基线方法。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、智能监控等领域。通过准确预测场景中动态元素的运动轨迹,可以提高自动驾驶系统的安全性,增强机器人对环境的适应性,并提升智能监控系统的预警能力。该方法在复杂动态环境下的鲁棒性使其具有广泛的应用前景。

📄 摘要(原文)

Accurate prediction of driving scene is a challenging task due to uncertainty in sensor data, the complex behaviors of agents, and the possibility of multiple feasible futures. Existing prediction methods using occupancy grid maps primarily focus on agent-agnostic scene predictions, while agent-specific predictions provide specialized behavior insights with the help of semantic information. However, both paradigms face distinct limitations: agent-agnostic models struggle to capture the behavioral complexities of dynamic actors, whereas agent-specific approaches fail to generalize to poorly perceived or unrecognized agents; combining both enables robust and safer motion forecasting. To address this, we propose a unified framework by leveraging Dynamic Occupancy Grid Maps within a streamlined temporal decoding pipeline to simultaneously predict future occupancy state grids, vehicle grids, and scene flow grids. Relying on a lightweight spatiotemporal backbone, our approach is centered on a tailored, interdependent loss function that captures inter-grid dependencies and enables diverse future predictions. By using occupancy state information to enforce flow-guided transitions, the loss function acts as a regularizer that directs occupancy evolution while accounting for obstacles and occlusions. Consequently, the model not only predicts the specific behaviors of vehicle agents, but also identifies other dynamic entities and anticipates their evolution within the complex scene. Evaluations on real-world nuScenes and Woven Planet datasets demonstrate superior prediction performances for dynamic vehicles and generic dynamic scene elements compared to baseline methods.