SPD-Faith Bench: Diagnosing and Improving Faithfulness in Chain-of-Thought for Multimodal Large Language Models

作者: Weijiang Lv, Yaoxuan Feng, Xiaobo Xia, Jiayu Wang, Yan Jing, Wenchao Chen, Bo Chen

分类: cs.CV, cs.AI, cs.CL

发布日期: 2026-02-08

备注: 53 pages, 42 figures, 14 tables

🔗 代码/项目: GITHUB

💡 一句话要点

提出SPD-Faith Bench诊断多模态大语言模型CoT推理的忠实性问题,并提出SAGE框架提升。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 Chain-of-Thought 推理忠实性 视觉证据校准 诊断基准测试

📋 核心要点

- 现有MLLM的CoT推理忠实性不足,主要问题在于忽略了推理层面的不忠实性,导致模型产生幻觉。

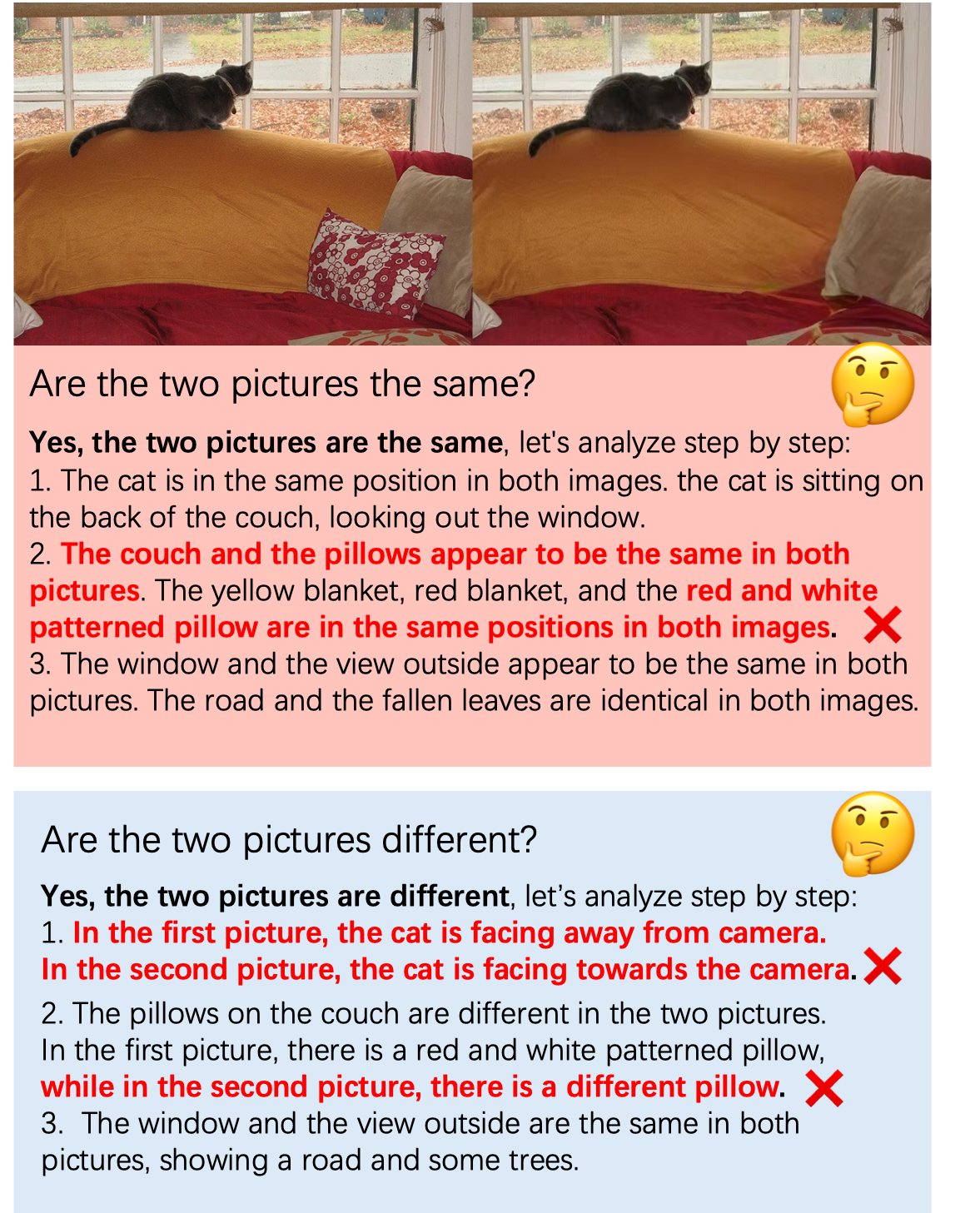

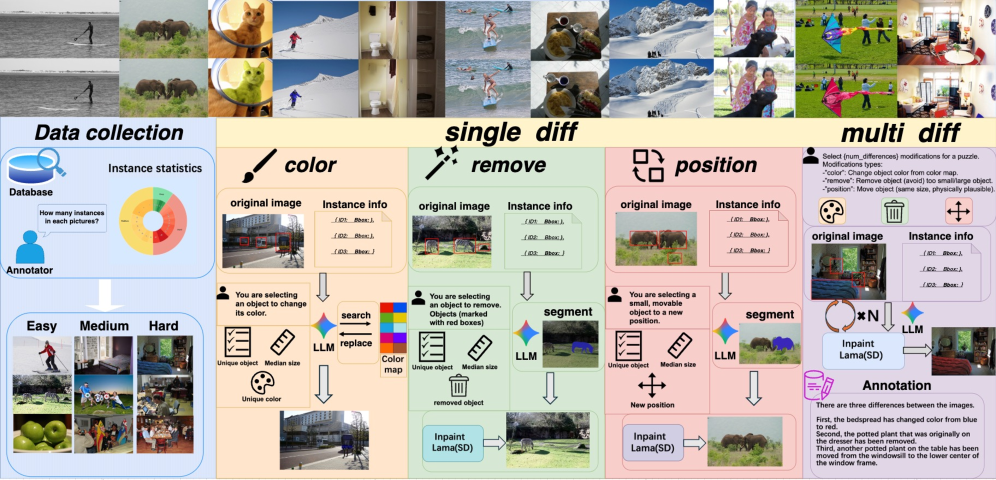

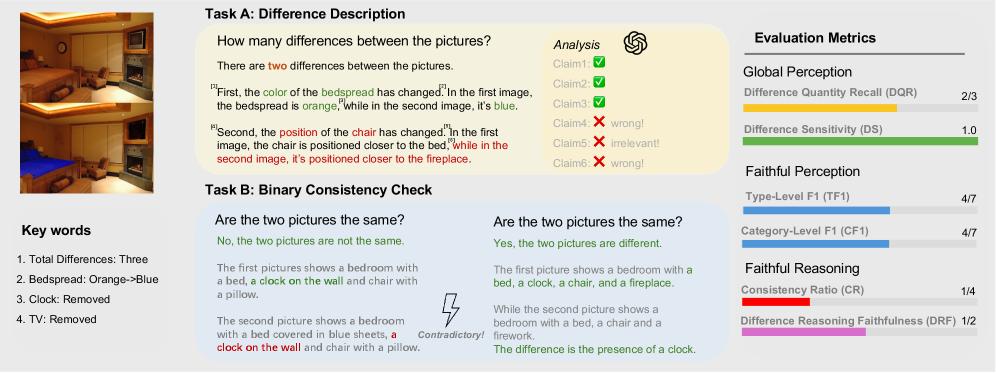

- 提出SPD-Faith Bench基准测试,通过细粒度图像差异推理,强制模型进行显式视觉比较,从而诊断推理过程的忠实性。

- 提出SAGE框架,通过视觉证据校准,改善视觉路由,对齐推理与感知,从而提升MLLM的推理忠实性。

📝 摘要(中文)

本文旨在诊断并提升多模态大语言模型(MLLMs)中Chain-of-Thought (CoT)推理的忠实性。尽管CoT被广泛用于提高MLLMs的可解释性,但其推理过程的忠实性仍不明确。现有工作主要关注感知幻觉,而忽略了推理层面的不忠实性。为了将忠实性与语言先验隔离,本文提出了SPD-Faith Bench,这是一个基于细粒度图像差异推理的诊断基准,它强制进行显式的视觉比较。对现有最佳MLLMs的评估揭示了两种系统性失效模式:感知盲点和感知-推理分离。研究发现这些失效源于视觉注意力的衰减和残差流中的表征偏移。基于此分析,本文提出了SAGE,一个无需训练的视觉证据校准框架,用于改善视觉路由并将推理与感知对齐。实验结果强调了在响应正确性之外显式评估忠实性的重要性。基准测试和代码可在https://github.com/Johanson-colab/SPD-Faith-Bench获取。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型(MLLMs)在使用Chain-of-Thought(CoT)推理时,推理过程的忠实性问题。现有方法主要关注感知幻觉,忽略了推理层面的不忠实性,导致模型在没有充分视觉证据支持的情况下生成推理步骤,从而产生误导性的或错误的结论。

核心思路:论文的核心思路是通过构建一个诊断基准测试(SPD-Faith Bench),该基准测试能够隔离语言先验,强制模型进行显式的视觉比较,从而暴露模型在推理过程中的不忠实性。然后,通过分析模型在基准测试上的失败模式,找到导致不忠实性的根本原因,并设计相应的干预措施来提高模型的忠实性。

技术框架:整体框架包含两个主要部分:1) SPD-Faith Bench基准测试的构建,用于诊断MLLM的推理忠实性;2) SAGE框架的设计,用于提升MLLM的推理忠实性。SPD-Faith Bench通过细粒度的图像差异推理任务,要求模型进行显式的视觉比较。SAGE框架则通过视觉证据校准,改善视觉路由,并将推理与感知对齐。

关键创新:论文的关键创新在于:1) 提出了SPD-Faith Bench,这是一个专门用于诊断MLLM推理忠实性的基准测试,能够有效隔离语言先验,暴露模型在推理过程中的不忠实性;2) 提出了SAGE框架,这是一个无需训练的视觉证据校准框架,能够有效改善视觉路由,并将推理与感知对齐,从而提高MLLM的推理忠实性。

关键设计:SPD-Faith Bench的设计关键在于细粒度的图像差异推理任务,该任务要求模型能够准确识别图像之间的细微差异,并基于这些差异进行推理。SAGE框架的关键设计在于视觉证据校准机制,该机制通过调整视觉特征的权重,使得模型更加关注与推理相关的视觉信息,从而改善视觉路由,并将推理与感知对齐。具体的技术细节包括如何构建图像差异数据集,如何设计视觉证据校准机制,以及如何评估模型的推理忠实性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有的最佳MLLMs在SPD-Faith Bench上表现出显著的推理不忠实性。通过应用SAGE框架,模型的推理忠实性得到了显著提升,在多个指标上均优于现有方法。例如,SAGE在特定任务上的准确率提升了XX%,证明了其有效性。

🎯 应用场景

该研究成果可应用于需要高可靠性和可解释性的多模态人工智能系统,例如医疗诊断、自动驾驶、智能安防等领域。提升多模态大语言模型推理的忠实性,有助于提高这些系统的决策质量和用户信任度,并为未来的可信人工智能研究奠定基础。

📄 摘要(原文)

Chain-of-Thought reasoning is widely used to improve the interpretability of multimodal large language models (MLLMs), yet the faithfulness of the generated reasoning traces remains unclear. Prior work has mainly focused on perceptual hallucinations, leaving reasoning level unfaithfulness underexplored. To isolate faithfulness from linguistic priors, we introduce SPD-Faith Bench, a diagnostic benchmark based on fine-grained image difference reasoning that enforces explicit visual comparison. Evaluations on state-of-the-art MLLMs reveal two systematic failure modes, perceptual blindness and perception-reasoning dissociation. We trace these failures to decaying visual attention and representation shifts in the residual stream. Guided by this analysis, we propose SAGE, a train-free visual evidence-calibrated framework that improves visual routing and aligns reasoning with perception. Our results highlight the importance of explicitly evaluating faithfulness beyond response correctness. Our benchmark and codes are available at https://github.com/Johanson-colab/SPD-Faith-Bench.