VISOR: VIsual Spatial Object Reasoning for Language-driven Object Navigation

作者: Francesco Taioli, Shiping Yang, Sonia Raychaudhuri, Marco Cristani, Unnat Jain, Angel X Chang

分类: cs.CV, cs.AI

发布日期: 2026-02-07

💡 一句话要点

VISOR:用于语言驱动物体导航的视觉空间物体推理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言驱动导航 视觉空间推理 具身智能 视觉语言动作智能体 图像接地推理

📋 核心要点

- 现有语言驱动物体导航方法泛化性差,缺乏动作级别的可解释性,或存在误差累积和计算成本高等问题。

- 论文提出一种紧凑的视觉-语言-动作(VLA)智能体,通过显式的图像接地推理模拟人类的具身推理过程。

- 该方法通过“思考”、“思考总结”和“行动”三个阶段,提升了可解释性、泛化能力和导航效率。

📝 摘要(中文)

语言驱动的物体导航要求智能体理解目标物体的自然语言描述,这些描述结合了内在和外在属性,用于实例识别和常识导航。现有方法要么(i)使用端到端训练的模型与视觉-语言嵌入,这难以泛化到训练数据之外,并且缺乏动作级别的可解释性,要么(ii)依赖于具有大型语言模型(LLM)和开放集物体检测器的模块化零样本流水线,这会遭受误差传播、高计算成本以及难以将其推理集成回导航策略的问题。为此,我们提出了一个紧凑的30亿参数视觉-语言-动作(VLA)智能体,它执行类似人类的具身推理,用于物体识别和动作选择,从而消除了对拼接多模型流水线的需求。我们的智能体不采用原始嵌入匹配,而是采用显式的图像接地推理来直接回答“这是目标物体吗?”和“我为什么要采取这个动作?”。推理过程分三个阶段展开:“思考”、“思考总结”和“行动”,从而提高了可解释性、更强的泛化能力和更高效的导航。代码和数据集将在接收后提供。

🔬 方法详解

问题定义:语言驱动的物体导航任务需要智能体根据自然语言描述找到目标物体。现有方法要么依赖端到端模型,泛化能力差且缺乏可解释性;要么使用模块化零样本流水线,存在误差传播和计算成本高的问题。这些方法难以有效地将视觉信息和语言信息融合,并进行有效的推理和决策。

核心思路:论文的核心思路是设计一个紧凑的视觉-语言-动作(VLA)智能体,该智能体能够像人类一样进行具身推理,直接回答“这是目标物体吗?”和“我为什么要采取这个动作?”。通过显式的图像接地推理,智能体可以更好地理解场景,并做出更合理的导航决策。这种方法避免了复杂的嵌入匹配和模块化流水线,提高了效率和可解释性。

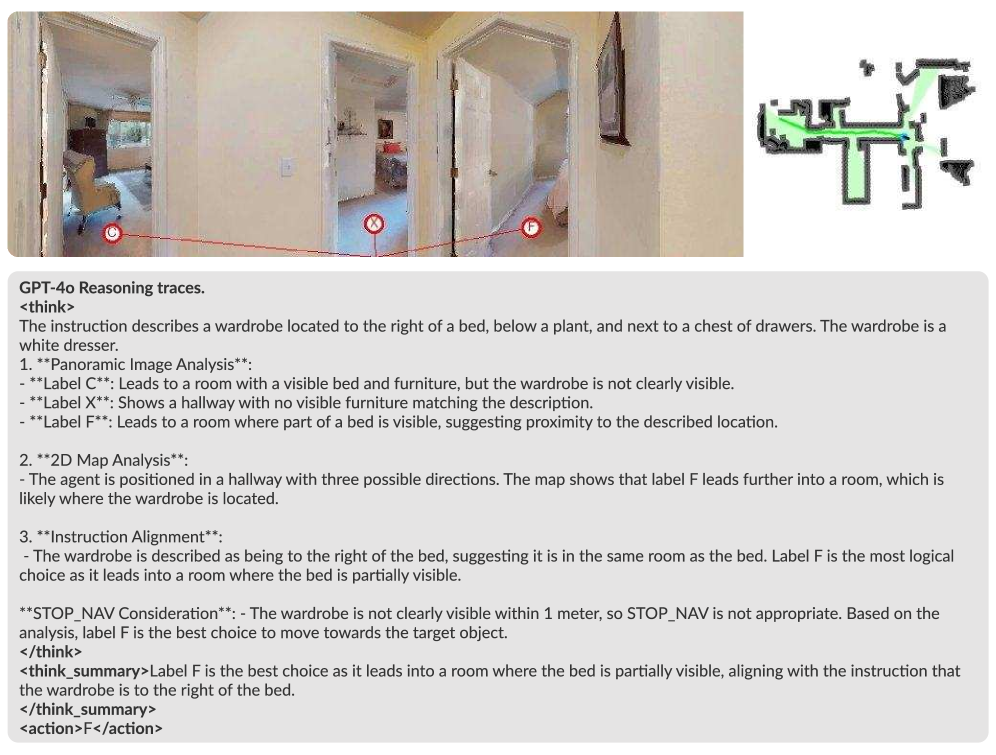

技术框架:该智能体的推理过程分为三个阶段:“思考”、“思考总结”和“行动”。在“思考”阶段,智能体分析视觉输入和语言描述,提取关键信息。在“思考总结”阶段,智能体对提取的信息进行总结和推理,形成对当前状态的理解。在“行动”阶段,智能体根据推理结果选择合适的动作。整个框架采用端到端训练,使得各个模块可以协同工作,共同完成导航任务。

关键创新:该论文的关键创新在于提出了一个紧凑的VLA智能体,该智能体能够进行显式的图像接地推理。与现有方法相比,该方法不需要复杂的嵌入匹配和模块化流水线,提高了效率和可解释性。此外,该方法通过“思考”、“思考总结”和“行动”三个阶段,模拟了人类的具身推理过程,使得智能体能够更好地理解场景,并做出更合理的导航决策。

关键设计:该智能体使用一个30亿参数的模型,该模型包含视觉编码器、语言编码器和动作解码器。视觉编码器负责提取图像特征,语言编码器负责提取语言特征,动作解码器负责根据视觉和语言特征选择合适的动作。损失函数包括导航损失、物体识别损失和动作预测损失。具体网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

论文提出了一个紧凑的30亿参数VLA智能体,通过显式的图像接地推理,在语言驱动的物体导航任务上取得了显著的性能提升。与现有方法相比,该方法提高了可解释性、泛化能力和导航效率。具体实验数据将在论文接收后公布。

🎯 应用场景

该研究成果可应用于家庭服务机器人、自动驾驶、虚拟现实等领域。例如,家庭服务机器人可以根据用户的语言指令,在复杂的家庭环境中找到目标物体并执行相应的任务。自动驾驶系统可以根据乘客的语音指令,规划行驶路线并安全到达目的地。该研究有助于提升人机交互的自然性和智能化水平,具有广阔的应用前景。

📄 摘要(原文)

Language-driven object navigation requires agents to interpret natural language descriptions of target objects, which combine intrinsic and extrinsic attributes for instance recognition and commonsense navigation. Existing methods either (i) use end-to-end trained models with vision-language embeddings, which struggle to generalize beyond training data and lack action-level explainability, or (ii) rely on modular zero-shot pipelines with large language models (LLMs) and open-set object detectors, which suffer from error propagation, high computational cost, and difficulty integrating their reasoning back into the navigation policy. To this end, we propose a compact 3B-parameter Vision-Language-Action (VLA) agent that performs human-like embodied reasoning for both object recognition and action selection, removing the need for stitched multi-model pipelines. Instead of raw embedding matching, our agent employs explicit image-grounded reasoning to directly answer "Is this the target object?" and "Why should I take this action?" The reasoning process unfolds in three stages: "think", "think summary", and "action", yielding improved explainability, stronger generalization, and more efficient navigation. Code and dataset available upon acceptance.