Zero-Shot UAV Navigation in Forests via Relightable 3D Gaussian Splatting

作者: Zinan Lv, Yeqian Qian, Chen Sang, Hao Liu, Danping Zou, Ming Yang

分类: cs.CV, cs.RO

发布日期: 2026-02-06 (更新: 2026-02-18)

备注: 12 pages, 8 figures

💡 一句话要点

提出基于可重光照3D高斯溅射的零样本无人机森林导航方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 无人机导航 强化学习 3D高斯溅射 零样本学习 光照鲁棒性

📋 核心要点

- 现有方法在非结构化户外环境中使用单目视觉进行无人机导航时,面临仿真与现实之间巨大的视觉领域差异。

- 论文提出可重光照3D高斯溅射,通过分解场景组件,实现对环境光照的显式编辑,从而提升策略在不同光照条件下的泛化能力。

- 实验结果表明,该方法使无人机在复杂森林环境中实现了高达10米/秒的鲁棒导航,且无需针对光照变化进行微调。

📝 摘要(中文)

本文提出了一种新颖的端到端强化学习框架,旨在实现无人机在非结构化户外环境中的有效零样本迁移。该框架基于单目视觉,克服了仿真与现实之间的视觉领域差异。利用3D高斯溅射实现逼真的场景重建,并引入可重光照3D高斯溅射,将场景组件分解,从而在神经表示中显式地、基于物理地编辑环境光照。通过增强训练,使用从强方向性阳光到漫射阴天的各种合成光照条件,迫使策略学习鲁棒的、光照不变的视觉特征。大量真实环境实验表明,轻型四旋翼飞行器在复杂森林环境中实现了鲁棒、无碰撞的导航,速度高达10米/秒,并且在没有微调的情况下,对剧烈的光照变化表现出显著的适应性。

🔬 方法详解

问题定义:论文旨在解决无人机在非结构化户外环境中,使用单目视觉进行导航时,由于仿真环境与真实环境光照差异巨大,导致策略泛化能力差的问题。现有方法通常将静态光照与几何信息耦合,难以适应真实世界动态变化的光照条件。

核心思路:论文的核心思路是解耦场景的几何信息和光照信息,通过可重光照的3D高斯溅射表示场景,并在训练过程中对光照进行增强,从而使策略学习到对光照变化具有鲁棒性的视觉特征。这样,即使在真实环境中遇到与训练环境不同的光照条件,无人机也能正常导航。

技术框架:整体框架是一个端到端的强化学习流程。首先,使用真实世界数据构建高保真仿真环境。然后,在仿真环境中训练策略,该策略直接将原始单目RGB图像映射到连续控制指令。为了克服光照限制,引入可重光照3D高斯溅射模块,用于场景表示和光照编辑。最后,通过在各种合成光照条件下进行训练,提高策略的泛化能力。

关键创新:最重要的创新点是可重光照3D高斯溅射。与传统的3D高斯溅射方法不同,该方法将场景组件分解,从而可以显式地、基于物理地编辑环境光照。这使得在仿真环境中可以生成各种不同的光照条件,从而增强策略的鲁棒性。

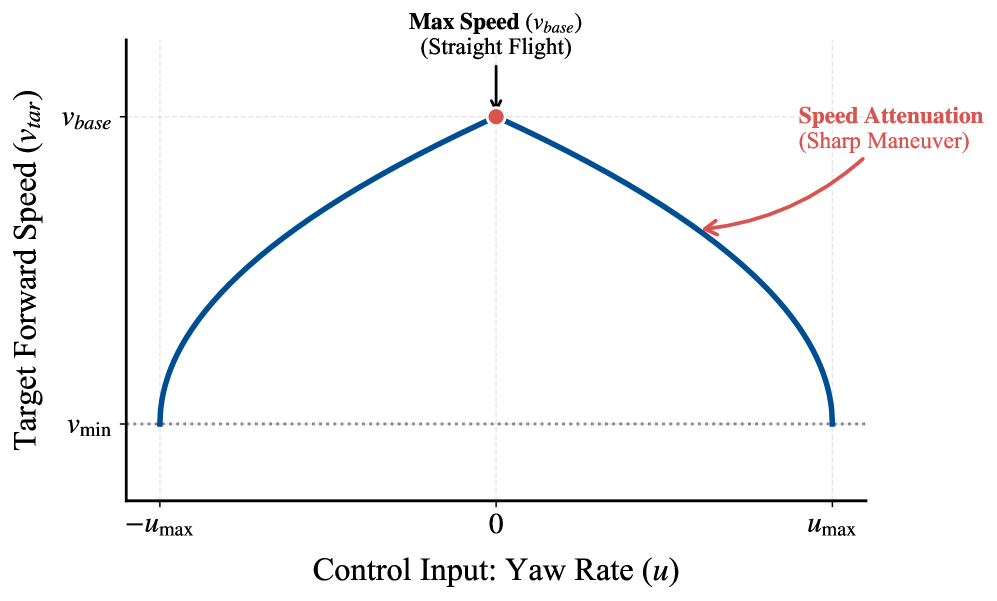

关键设计:论文使用强化学习算法训练导航策略。损失函数包括导航奖励、碰撞惩罚等。可重光照3D高斯溅射模块的具体实现细节未知,但其核心在于解耦几何信息和光照信息,并允许对光照进行显式控制。训练过程中,会随机生成各种光照条件,例如强方向性阳光、漫射阴天等,以增强策略的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法使轻型四旋翼飞行器在复杂森林环境中实现了高达10米/秒的鲁棒、无碰撞导航。更重要的是,该方法无需针对真实环境的光照条件进行微调,即可实现零样本迁移,这表明该方法具有很强的泛化能力。

🎯 应用场景

该研究成果可应用于无人机在森林、山区等复杂户外环境中的自主导航,例如森林巡检、灾害救援、环境监测等。通过提高无人机在不同光照条件下的导航能力,可以扩展无人机的应用范围,并提高其在实际场景中的可靠性。

📄 摘要(原文)

UAV navigation in unstructured outdoor environments using passive monocular vision is hindered by the substantial visual domain gap between simulation and reality. While 3D Gaussian Splatting enables photorealistic scene reconstruction from real-world data, existing methods inherently couple static lighting with geometry, severely limiting policy generalization to dynamic real-world illumination. In this paper, we propose a novel end-to-end reinforcement learning framework designed for effective zero-shot transfer to unstructured outdoors. Within a high-fidelity simulation grounded in real-world data, our policy is trained to map raw monocular RGB observations directly to continuous control commands. To overcome photometric limitations, we introduce Relightable 3D Gaussian Splatting, which decomposes scene components to enable explicit, physically grounded editing of environmental lighting within the neural representation. By augmenting training with diverse synthesized lighting conditions ranging from strong directional sunlight to diffuse overcast skies, we compel the policy to learn robust, illumination-invariant visual features. Extensive real-world experiments demonstrate that a lightweight quadrotor achieves robust, collision-free navigation in complex forest environments at speeds up to 10 m/s, exhibiting significant resilience to drastic lighting variations without fine-tuning.