LIBERO-X: Robustness Litmus for Vision-Language-Action Models

作者: Guodong Wang, Chenkai Zhang, Qingjie Liu, Jinjin Zhang, Jiancheng Cai, Junjie Liu, Xinmin Liu

分类: cs.CV, cs.AI, cs.RO

发布日期: 2026-02-06

备注: 19 pages, 14 figures and 8 tables

💡 一句话要点

LIBERO-X:针对视觉-语言-动作模型的鲁棒性评测基准

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作模型 基准测试 鲁棒性 分层评估 分布偏移

📋 核心要点

- 现有VLA基准测试无法充分捕捉真实世界分布偏移,导致评估结果有限或具有误导性。

- LIBERO-X通过分层评估协议和高多样性训练数据,更可靠地评估VLA模型的鲁棒性。

- 实验表明,代表性VLA模型在LIBERO-X基准上性能显著下降,暴露了模型在场景理解和指令对齐方面的不足。

📝 摘要(中文)

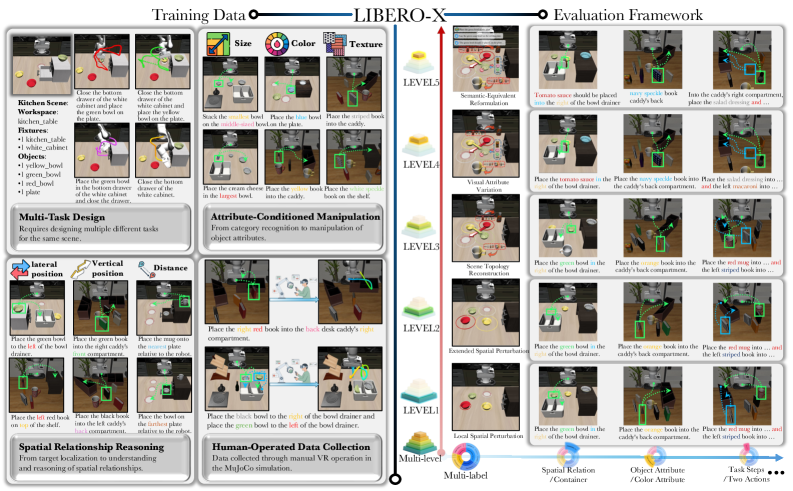

可靠的基准测试对于推进视觉-语言-动作(VLA)模型至关重要,因为它揭示了模型在感知与语言驱动的操作任务中的泛化性、鲁棒性和对齐性。然而,现有的基准测试由于评估协议不足,无法充分捕捉真实世界的分布偏移,因此提供的评估结果往往有限或具有误导性。本文从评估和数据角度系统地重新思考了VLA基准测试,提出了LIBERO-X基准,其特点包括:1)一个具有渐进难度等级的分层评估协议,针对空间泛化、物体识别和任务指令理解这三个核心能力。这种设计能够对在不断增加的环境和任务复杂性下的性能下降进行细粒度分析;2)一个通过人工遥操作收集的高多样性训练数据集,其中每个场景支持多个细粒度的操作目标,以弥合训练-评估分布差距。对代表性VLA模型的实验表明,在累积扰动下性能显著下降,暴露了场景理解和指令对齐方面的持续局限性。通过将分层评估与多样化的训练数据相结合,LIBERO-X为评估和推进VLA开发提供了一个更可靠的基础。

🔬 方法详解

问题定义:论文旨在解决现有视觉-语言-动作(VLA)模型基准测试的不足。现有基准测试无法充分模拟真实世界的复杂性和分布偏移,导致对VLA模型的泛化能力、鲁棒性和指令理解能力的评估不准确。现有方法的痛点在于评估协议简单,训练数据单一,无法有效暴露模型在实际应用中可能遇到的问题。

核心思路:论文的核心思路是通过构建一个更具挑战性和多样性的基准测试LIBERO-X,来更全面、更准确地评估VLA模型的性能。该基准测试包含一个分层评估协议,逐步增加任务难度,并提供一个高多样性的训练数据集,以弥合训练和评估之间的分布差距。通过这种方式,可以更有效地暴露VLA模型在场景理解和指令对齐方面的局限性。

技术框架:LIBERO-X基准测试主要包含两个部分:分层评估协议和高多样性训练数据集。分层评估协议包含三个难度等级,分别针对空间泛化、物体识别和任务指令理解这三个核心能力。高多样性训练数据集通过人工遥操作收集,每个场景支持多个细粒度的操作目标。VLA模型首先在训练数据集上进行训练,然后在分层评估协议上进行测试,以评估其性能。

关键创新:LIBERO-X的关键创新在于其分层评估协议和高多样性训练数据集。分层评估协议能够对VLA模型在不同难度等级下的性能进行细粒度分析,从而更全面地了解模型的优势和不足。高多样性训练数据集能够弥合训练和评估之间的分布差距,从而更准确地评估模型在实际应用中的性能。与现有方法相比,LIBERO-X能够提供更可靠、更全面的VLA模型评估。

关键设计:分层评估协议的设计考虑了VLA模型需要具备的三个核心能力:空间泛化、物体识别和任务指令理解。每个难度等级都针对其中一个或多个能力进行评估。高多样性训练数据集的收集采用了人工遥操作的方式,以确保数据的真实性和多样性。在数据收集过程中,每个场景都支持多个细粒度的操作目标,以增加数据的复杂性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,代表性的VLA模型在LIBERO-X基准测试上表现出显著的性能下降,尤其是在累积扰动下。这表明现有VLA模型在场景理解和指令对齐方面存在明显的局限性。例如,在最难的评估等级上,模型的成功率下降了超过30%。这些结果强调了LIBERO-X基准测试在暴露VLA模型弱点方面的有效性。

🎯 应用场景

LIBERO-X基准测试可以广泛应用于机器人、自动化和人工智能等领域。它可以帮助研究人员和工程师更准确地评估和改进VLA模型的性能,从而开发出更智能、更可靠的机器人系统。例如,LIBERO-X可以用于评估机器人抓取、操作和导航等任务的性能,并帮助开发出能够更好地理解人类指令并执行复杂任务的机器人。

📄 摘要(原文)

Reliable benchmarking is critical for advancing Vision-Language-Action (VLA) models, as it reveals their generalization, robustness, and alignment of perception with language-driven manipulation tasks. However, existing benchmarks often provide limited or misleading assessments due to insufficient evaluation protocols that inadequately capture real-world distribution shifts. This work systematically rethinks VLA benchmarking from both evaluation and data perspectives, introducing LIBERO-X, a benchmark featuring: 1) A hierarchical evaluation protocol with progressive difficulty levels targeting three core capabilities: spatial generalization, object recognition, and task instruction understanding. This design enables fine-grained analysis of performance degradation under increasing environmental and task complexity; 2) A high-diversity training dataset collected via human teleoperation, where each scene supports multiple fine-grained manipulation objectives to bridge the train-evaluation distribution gap. Experiments with representative VLA models reveal significant performance drops under cumulative perturbations, exposing persistent limitations in scene comprehension and instruction grounding. By integrating hierarchical evaluation with diverse training data, LIBERO-X offers a more reliable foundation for assessing and advancing VLA development.