AdaptOVCD: Training-Free Open-Vocabulary Remote Sensing Change Detection via Adaptive Information Fusion

作者: Mingyu Dou, Shi Qiu, Ming Hu, Yifan Chen, Huping Ye, Xiaohan Liao, Zhe Sun

分类: cs.CV

发布日期: 2026-02-06

🔗 代码/项目: GITHUB

💡 一句话要点

提出AdaptOVCD,一种免训练的遥感开放词汇变化检测方法,通过自适应信息融合实现。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 遥感变化检测 开放词汇 免训练 自适应信息融合 预训练模型 零样本学习 多模态融合

📋 核心要点

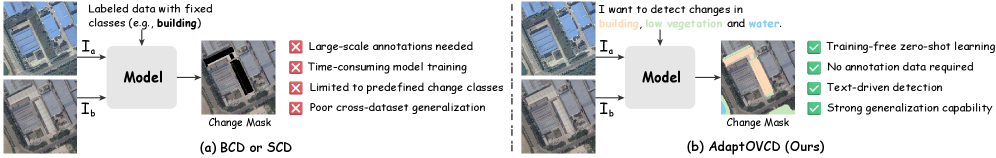

- 现有遥感变化检测方法依赖预定义类别和大量标注,泛化性受限,难以应用于开放世界场景。

- AdaptOVCD通过双维度多层次信息融合,结合自适应模块,实现异构预训练模型的协同,无需训练即可检测变化。

- 实验表明,AdaptOVCD在零样本条件下显著优于现有免训练方法,并在跨数据集评估中接近全监督性能。

📝 摘要(中文)

遥感变化检测在环境监测、城市规划和灾害评估等领域起着关键作用。然而,现有方法通常依赖于预定义的类别和大规模的像素级标注,这限制了它们在开放世界场景中的泛化性和适用性。为了解决这些限制,本文提出了一种基于双维度多层次信息融合的免训练开放词汇变化检测(OVCD)架构AdaptOVCD。该框架在数据、特征和决策层面垂直整合多层次信息融合,同时水平整合有针对性的自适应设计,实现异构预训练模型之间的深度协同,有效缓解误差传播。具体来说,(1)在数据层面,自适应辐射校准(ARA)将辐射统计与原始纹理特征融合,并与SAM-HQ协同,实现辐射一致的分割;(2)在特征层面,自适应变化阈值(ACT)结合全局差异分布与边缘结构先验,并利用DINOv3实现鲁棒的变化检测;(3)在决策层面,自适应置信度过滤(ACF)整合语义置信度与空间约束,并与DGTRS-CLIP协同,实现高置信度的语义识别。在九个场景中的综合评估表明,AdaptOVCD以零样本方式检测任意类别变化,显著优于现有的免训练方法。同时,在跨数据集评估中,它达到了完全监督性能上限的84.89%,并表现出卓越的泛化能力。代码可在https://github.com/Dmygithub/AdaptOVCD 获取。

🔬 方法详解

问题定义:遥感变化检测旨在识别不同时间获取的同一区域遥感图像之间的差异。现有方法的痛点在于需要大量标注数据进行训练,且泛化能力差,难以适应开放世界中未知的变化类型。这些方法通常依赖于预定义的类别,无法检测到超出这些类别的变化。

核心思路:AdaptOVCD的核心思路是利用预训练模型强大的特征提取能力,通过多层次的信息融合和自适应策略,在无需训练的情况下实现开放词汇的变化检测。该方法旨在通过协同利用不同的预训练模型,弥补彼此的不足,从而提高检测的准确性和鲁棒性。

技术框架:AdaptOVCD的整体架构包含三个主要阶段:数据层面的自适应辐射校准(ARA)、特征层面的自适应变化阈值(ACT)和决策层面的自适应置信度过滤(ACF)。ARA旨在消除辐射差异,ACT用于提取变化区域,ACF则用于识别变化类型。这三个阶段通过多层次的信息融合,实现异构预训练模型的协同工作。

关键创新:AdaptOVCD的关键创新在于其双维度多层次的信息融合框架和自适应设计。垂直方向上,它在数据、特征和决策层面进行信息融合;水平方向上,它采用自适应策略,根据不同场景调整模型参数,从而提高模型的泛化能力。与现有方法的本质区别在于,AdaptOVCD无需训练,可以直接应用于新的场景。

关键设计:ARA模块利用辐射统计信息和SAM-HQ进行辐射一致的分割;ACT模块结合全局差异分布和边缘结构先验,并使用DINOv3提取特征,实现鲁棒的变化检测;ACF模块整合语义置信度与空间约束,并与DGTRS-CLIP协同,实现高置信度的语义识别。这些模块的设计都旨在提高模型的准确性和鲁棒性,并减少对训练数据的依赖。

🖼️ 关键图片

📊 实验亮点

AdaptOVCD在九个不同场景的评估中表现出色,以零样本方式检测任意类别变化,显著优于现有的免训练方法。在跨数据集评估中,AdaptOVCD达到了完全监督性能上限的84.89%,展示了其卓越的泛化能力。这些结果表明,AdaptOVCD是一种有效的开放词汇遥感变化检测方法。

🎯 应用场景

AdaptOVCD在环境监测、城市规划、灾害评估等领域具有广泛的应用前景。它可以用于监测森林砍伐、城市扩张、水体变化、自然灾害影响等。该研究的实际价值在于降低了遥感变化检测对标注数据的依赖,提高了模型的泛化能力,从而可以更快速、更经济地应用于新的场景。未来,该方法可以进一步扩展到其他类型的遥感数据和变化类型,并与其他技术相结合,实现更智能化的遥感监测。

📄 摘要(原文)

Remote sensing change detection plays a pivotal role in domains such as environmental monitoring, urban planning, and disaster assessment. However, existing methods typically rely on predefined categories and large-scale pixel-level annotations, which limit their generalization and applicability in open-world scenarios. To address these limitations, this paper proposes AdaptOVCD, a training-free Open-Vocabulary Change Detection (OVCD) architecture based on dual-dimensional multi-level information fusion. The framework integrates multi-level information fusion across data, feature, and decision levels vertically while incorporating targeted adaptive designs horizontally, achieving deep synergy among heterogeneous pre-trained models to effectively mitigate error propagation. Specifically, (1) at the data level, Adaptive Radiometric Alignment (ARA) fuses radiometric statistics with original texture features and synergizes with SAM-HQ to achieve radiometrically consistent segmentation; (2) at the feature level, Adaptive Change Thresholding (ACT) combines global difference distributions with edge structure priors and leverages DINOv3 to achieve robust change detection; (3) at the decision level, Adaptive Confidence Filtering (ACF) integrates semantic confidence with spatial constraints and collaborates with DGTRS-CLIP to achieve high-confidence semantic identification. Comprehensive evaluations across nine scenarios demonstrate that AdaptOVCD detects arbitrary category changes in a zero-shot manner, significantly outperforming existing training-free methods. Meanwhile, it achieves 84.89\% of the fully-supervised performance upper bound in cross-dataset evaluations and exhibits superior generalization capabilities. The code is available at https://github.com/Dmygithub/AdaptOVCD.