Uncertainty-Aware 4D Gaussian Splatting for Monocular Occluded Human Rendering

作者: Weiquan Wang, Feifei Shao, Lin Li, Zhen Wang, Jun Xiao, Long Chen

分类: cs.CV

发布日期: 2026-02-06

💡 一句话要点

提出U-4DGS,解决单目视频中遮挡人体高保真渲染问题。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态人体渲染 遮挡处理 不确定性建模 4D高斯溅射 概率形变网络

📋 核心要点

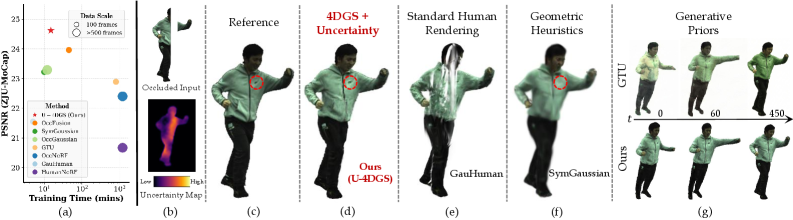

- 单目视频人体渲染在遮挡下性能骤降,现有方法依赖外部先验易引入伪影或无法捕捉多样外观。

- U-4DGS通过概率形变网络和双重光栅化流程,渲染不确定性图,自适应衰减不可靠观测的伪影。

- 置信度感知正则化利用学习到的不确定性,选择性地传播时空有效性,防止几何漂移,提升渲染质量。

📝 摘要(中文)

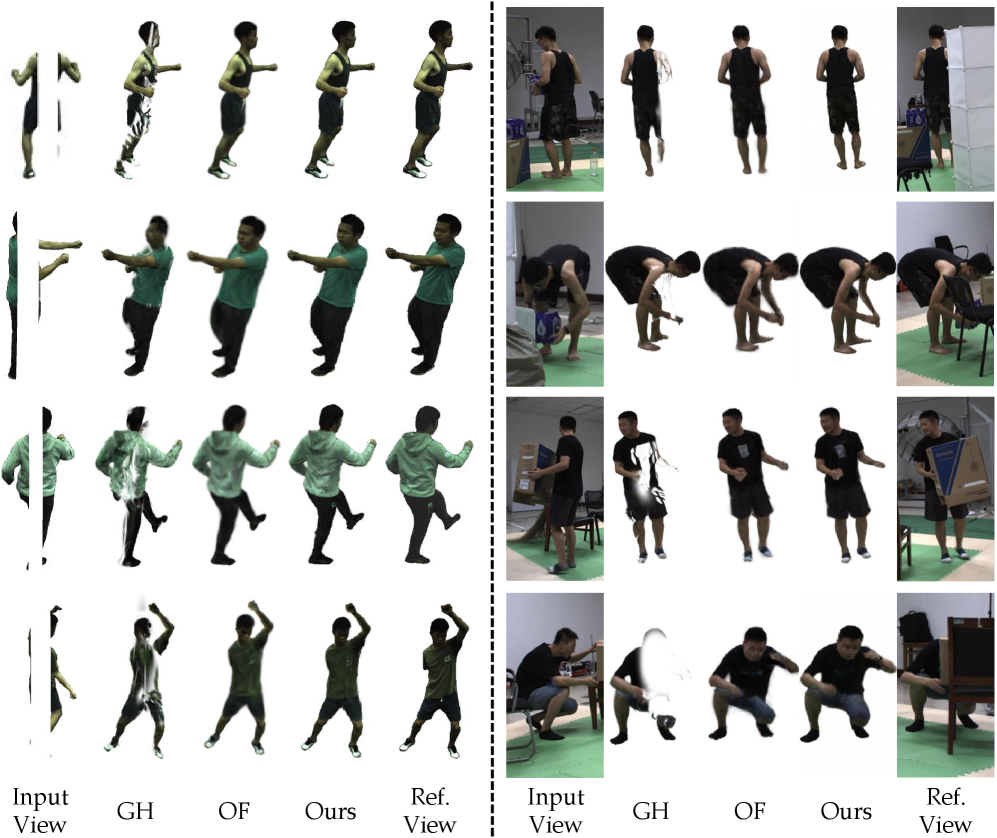

本文提出U-4DGS框架,旨在解决单目视频中动态人体渲染在遮挡情况下性能严重下降的问题。现有方法依赖外部先验,如生成模型产生时序闪烁,或使用几何启发式方法无法捕捉多样外观。U-4DGS将该任务重新定义为异方差观测噪声下的最大后验估计问题,集成了概率形变网络和双重光栅化流程。该架构渲染像素对齐的不确定性图,作为自适应梯度调节器,自动衰减来自不可靠观测的伪影。此外,为了防止缺乏可靠视觉线索区域的几何漂移,实施置信度感知正则化,利用学习到的不确定性选择性地传播时空有效性。在ZJU-MoCap和OcMotion数据集上的大量实验表明,U-4DGS实现了SOTA渲染保真度和鲁棒性。

🔬 方法详解

问题定义:论文旨在解决单目视频中动态人体在存在遮挡情况下的高保真渲染问题。现有方法主要存在两个痛点:一是依赖生成模型来填充缺失内容,导致严重的时序闪烁;二是采用刚性的几何启发式方法,无法捕捉人体外观的多样性。这些方法在遮挡严重的情况下,渲染质量会显著下降。

核心思路:论文的核心思路是将遮挡场景下的动态人体渲染问题建模为一个最大后验估计问题,并考虑异方差观测噪声。通过学习每个像素的不确定性,来指导渲染过程,降低不可靠观测的影响。同时,利用学习到的不确定性进行正则化,防止几何漂移。

技术框架:U-4DGS框架主要包含两个核心模块:概率形变网络和双重光栅化流程。概率形变网络用于预测每个像素的不确定性,双重光栅化流程则利用这些不确定性来调节渲染过程。此外,还引入了置信度感知正则化,以提高渲染的鲁棒性。整体流程是:输入单目视频,通过概率形变网络预测不确定性,然后利用双重光栅化流程进行渲染,最后通过置信度感知正则化进行优化。

关键创新:论文的关键创新在于将不确定性建模引入到4D高斯溅射(4D Gaussian Splatting)框架中,并利用学习到的不确定性来指导渲染和正则化过程。与现有方法相比,U-4DGS不需要依赖外部先验,能够更有效地处理遮挡情况,并生成更高质量的渲染结果。通过像素对齐的不确定性图,实现了自适应的梯度调节,从而衰减了来自不可靠观测的伪影。

关键设计:论文的关键设计包括:1) 概率形变网络的具体结构,用于预测像素级别的不确定性;2) 双重光栅化流程的实现细节,如何利用不确定性来调节渲染过程;3) 置信度感知正则化的具体形式,如何利用不确定性来选择性地传播时空有效性。损失函数的设计也至关重要,需要平衡渲染质量和不确定性预测的准确性。具体的网络结构、损失函数和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

U-4DGS在ZJU-MoCap和OcMotion数据集上进行了大量实验,结果表明其在渲染保真度和鲁棒性方面均优于现有方法,达到了SOTA水平。具体性能数据(例如PSNR、SSIM等指标)和对比基线在论文中有详细展示。实验结果验证了U-4DGS在处理遮挡情况下的有效性,并证明了不确定性建模对于提高渲染质量的重要性。

🎯 应用场景

该研究成果可应用于虚拟现实、增强现实、游戏开发、电影制作等领域,实现更逼真、更鲁棒的动态人体渲染。例如,在虚拟会议中,即使参与者被部分遮挡,也能保证高质量的渲染效果。此外,该技术还可以用于运动捕捉和人体姿态估计等任务,提高算法的准确性和鲁棒性。未来,该技术有望进一步扩展到其他动态场景的渲染,例如动物、车辆等。

📄 摘要(原文)

High-fidelity rendering of dynamic humans from monocular videos typically degrades catastrophically under occlusions. Existing solutions incorporate external priors-either hallucinating missing content via generative models, which induces severe temporal flickering, or imposing rigid geometric heuristics that fail to capture diverse appearances. To this end, we reformulate the task as a Maximum A Posteriori estimation problem under heteroscedastic observation noise. In this paper, we propose U-4DGS, a framework integrating a Probabilistic Deformation Network and a Double Rasterization pipeline. This architecture renders pixel-aligned uncertainty maps that act as an adaptive gradient modulator, automatically attenuating artifacts from unreliable observations. Furthermore, to prevent geometric drift in regions lacking reliable visual cues, we enforce Confidence-Aware Regularizations, which leverage the learned uncertainty to selectively propagate spatial-temporal validity. Extensive experiments on ZJU-MoCap and OcMotion demonstrate that U-4DGS achieves SOTA rendering fidelity and robustness.