Taming SAM3 in the Wild: A Concept Bank for Open-Vocabulary Segmentation

作者: Gensheng Pei, Xiruo Jiang, Yazhou Yao, Xiangbo Shu, Fumin Shen, Byeungwoo Jeon

分类: cs.CV

发布日期: 2026-02-06

🔗 代码/项目: GITHUB

💡 一句话要点

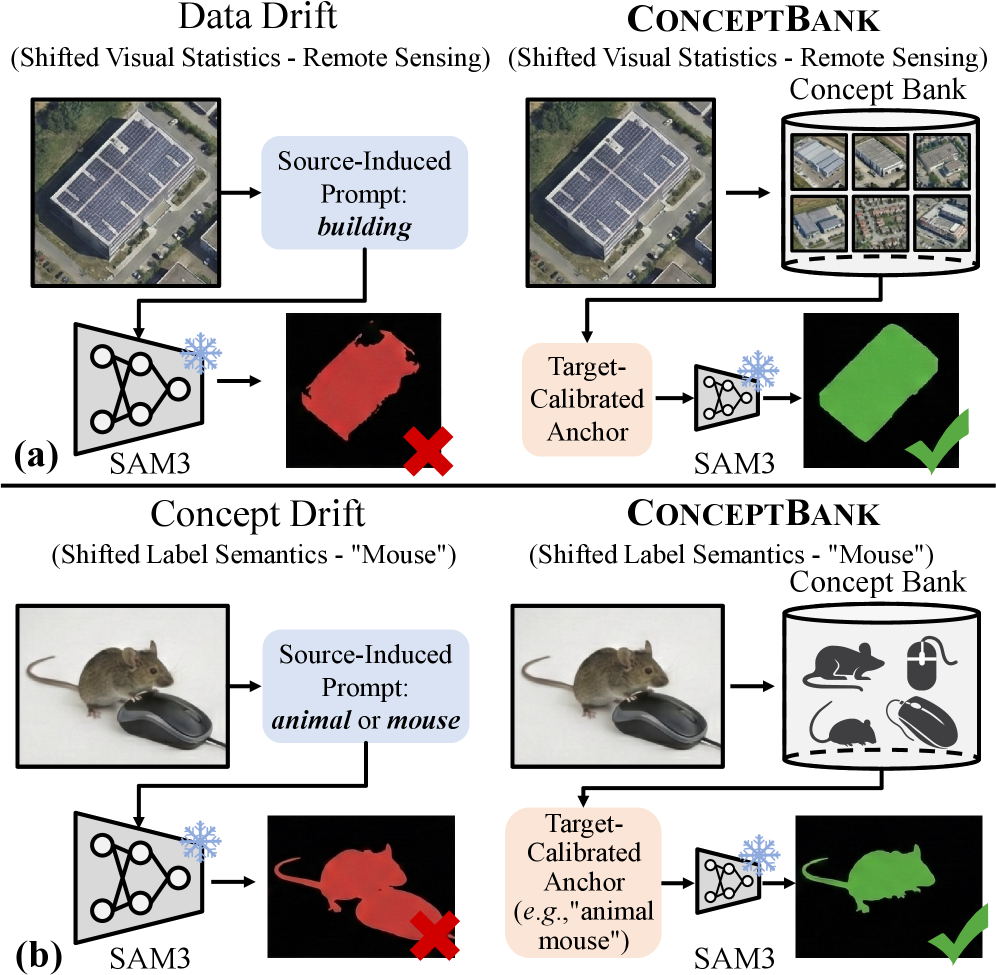

提出ConceptBank,解决SAM3在开放词汇分割中因数据/概念漂移导致的性能下降问题。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 开放词汇分割 数据漂移 概念漂移 领域自适应 视觉原型

📋 核心要点

- SAM3在开放词汇分割中表现出色,但依赖预定义概念,易受数据和概念漂移的影响。

- ConceptBank通过构建数据集特定的概念库,动态校准视觉证据和概念提示之间的对齐。

- 实验证明ConceptBank能有效提升SAM3在自然场景和遥感场景下的分割鲁棒性。

📝 摘要(中文)

本文提出ConceptBank,一个无需参数校准的框架,用于解决SAM3在开放词汇分割(OVS)中因数据漂移或概念漂移导致的性能下降问题。SAM3通过可提示的概念分割实现了OVS的革新,但其对预定义概念的依赖使其容易受到攻击:当目标域中的视觉分布发生变化(数据漂移)或条件标签分布演变(概念漂移)时,视觉证据和提示之间的对齐会中断。ConceptBank通过从目标统计数据构建数据集特定的概念库来恢复这种对齐。该方法(i)通过类别的视觉原型锚定目标域证据,(ii)挖掘代表性支持以抑制数据漂移下的异常值,以及(iii)融合候选概念以纠正概念漂移。实验表明,ConceptBank有效地使SAM3适应分布漂移,包括具有挑战性的自然场景和遥感场景,为OVS的鲁棒性和效率建立了一个新的基线。

🔬 方法详解

问题定义:SAM3在开放词汇分割任务中表现出色,但其性能严重依赖于预定义的类别概念。当目标数据集的视觉分布(数据漂移)或类别定义(概念漂移)与SAM3的训练数据存在差异时,视觉证据与预定义概念之间的对齐关系会失效,导致分割性能显著下降。现有方法难以有效解决这种由分布漂移带来的性能退化问题。

核心思路:ConceptBank的核心思想是利用目标数据集自身的统计信息,构建一个数据集特定的概念库,从而动态地校准视觉证据与概念之间的对齐关系。通过这种方式,ConceptBank能够适应目标数据集的分布特征,减轻数据漂移和概念漂移对分割性能的影响。

技术框架:ConceptBank主要包含三个阶段:(1)视觉原型锚定:为每个类别构建视觉原型,作为目标域视觉证据的锚点。(2)代表性支持挖掘:从目标数据集中挖掘具有代表性的样本,抑制数据漂移带来的异常值。(3)候选概念融合:融合多个候选概念,纠正概念漂移带来的类别定义偏差。整个框架无需参数训练,可以即插即用。

关键创新:ConceptBank的关键创新在于其参数无关性以及动态构建概念库的能力。与需要重新训练或微调的方法不同,ConceptBank可以直接应用于新的数据集,无需额外的训练成本。通过从目标数据集自身学习概念,ConceptBank能够更好地适应数据漂移和概念漂移。

关键设计:视觉原型通过计算每个类别像素的平均特征向量得到。代表性支持挖掘使用聚类算法,选择每个类别中最具代表性的样本。候选概念融合通过加权平均的方式,将多个候选概念的分割结果进行融合。具体的权重计算方式未知,论文可能在补充材料或代码中给出。

🖼️ 关键图片

📊 实验亮点

ConceptBank在多个数据集上进行了评估,包括自然场景和遥感场景。实验结果表明,ConceptBank能够显著提升SAM3在数据漂移和概念漂移下的分割性能,为开放词汇分割的鲁棒性提供了一个新的基线。具体的性能提升数据未知,需要在论文中查找。

🎯 应用场景

ConceptBank可广泛应用于需要开放词汇分割的场景,例如自动驾驶、遥感图像分析、医疗图像诊断等。该方法能够提升分割模型在不同数据分布下的鲁棒性,降低模型部署和维护的成本,具有重要的实际应用价值和潜力。

📄 摘要(原文)

The recent introduction of \texttt{SAM3} has revolutionized Open-Vocabulary Segmentation (OVS) through \textit{promptable concept segmentation}, which grounds pixel predictions in flexible concept prompts. However, this reliance on pre-defined concepts makes the model vulnerable: when visual distributions shift (\textit{data drift}) or conditional label distributions evolve (\textit{concept drift}) in the target domain, the alignment between visual evidence and prompts breaks down. In this work, we present \textsc{ConceptBank}, a parameter-free calibration framework to restore this alignment on the fly. Instead of adhering to static prompts, we construct a dataset-specific concept bank from the target statistics. Our approach (\textit{i}) anchors target-domain evidence via class-wise visual prototypes, (\textit{ii}) mines representative supports to suppress outliers under data drift, and (\textit{iii}) fuses candidate concepts to rectify concept drift. We demonstrate that \textsc{ConceptBank} effectively adapts \texttt{SAM3} to distribution drifts, including challenging natural-scene and remote-sensing scenarios, establishing a new baseline for robustness and efficiency in OVS. Code and model are available at https://github.com/pgsmall/ConceptBank.