VRIQ: Benchmarking and Analyzing Visual-Reasoning IQ of VLMs

作者: Tina Khezresmaeilzadeh, Jike Zhong, Konstantinos Psounis

分类: cs.CV, cs.LG

发布日期: 2026-02-05

💡 一句话要点

VRIQ:提出视觉推理智商基准,分析VLMs在非语言推理中的局限性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉推理 视觉语言模型 基准测试 诊断性探针 感知能力 抽象推理 多模态学习 非语言推理

📋 核心要点

- 现有VLMs在非语言推理能力方面存在不足,难以可靠地执行视觉推理任务。

- 提出VRIQ基准,包含抽象谜题和自然图像推理任务,用于评估和分析VLMs的视觉推理能力。

- 实验结果表明,VLMs在抽象推理方面表现较差,主要瓶颈在于感知能力,而非推理能力。

📝 摘要(中文)

本文提出了VRIQ(视觉推理智商)基准,旨在评估和分析视觉语言模型(VLMs)的视觉推理能力。该基准包含抽象谜题风格和自然图像推理两类任务。实验结果表明,VLMs在抽象谜题上的表现接近随机(约28%准确率),在自然图像任务上表现稍好但仍然较弱(45%准确率)。工具增强推理仅带来有限的性能提升。通过诊断性探针分析发现,约56%的失败源于感知问题,43%源于感知和推理的共同作用,仅1%源于推理本身。进一步的细粒度感知类别探针(如形状、计数、位置、3D/深度)揭示了不同感知类别对性能的影响差异。研究表明,即使使用视觉推理工具,当前的VLMs在抽象推理方面仍然不可靠,主要受限于感知能力,并为改进多模态系统的视觉推理能力提供了理论基础。

🔬 方法详解

问题定义:论文旨在解决视觉语言模型(VLMs)在视觉推理方面能力不足的问题。现有方法无法可靠地进行非语言推理,尤其是在抽象场景下,缺乏有效的评估和诊断工具来分析VLMs的弱点。

核心思路:论文的核心思路是构建一个专门用于评估和分析VLMs视觉推理能力的基准测试集VRIQ。通过设计不同类型的视觉推理任务,并结合诊断性探针,深入分析VLMs在感知和推理方面的表现,从而找出其弱点所在。

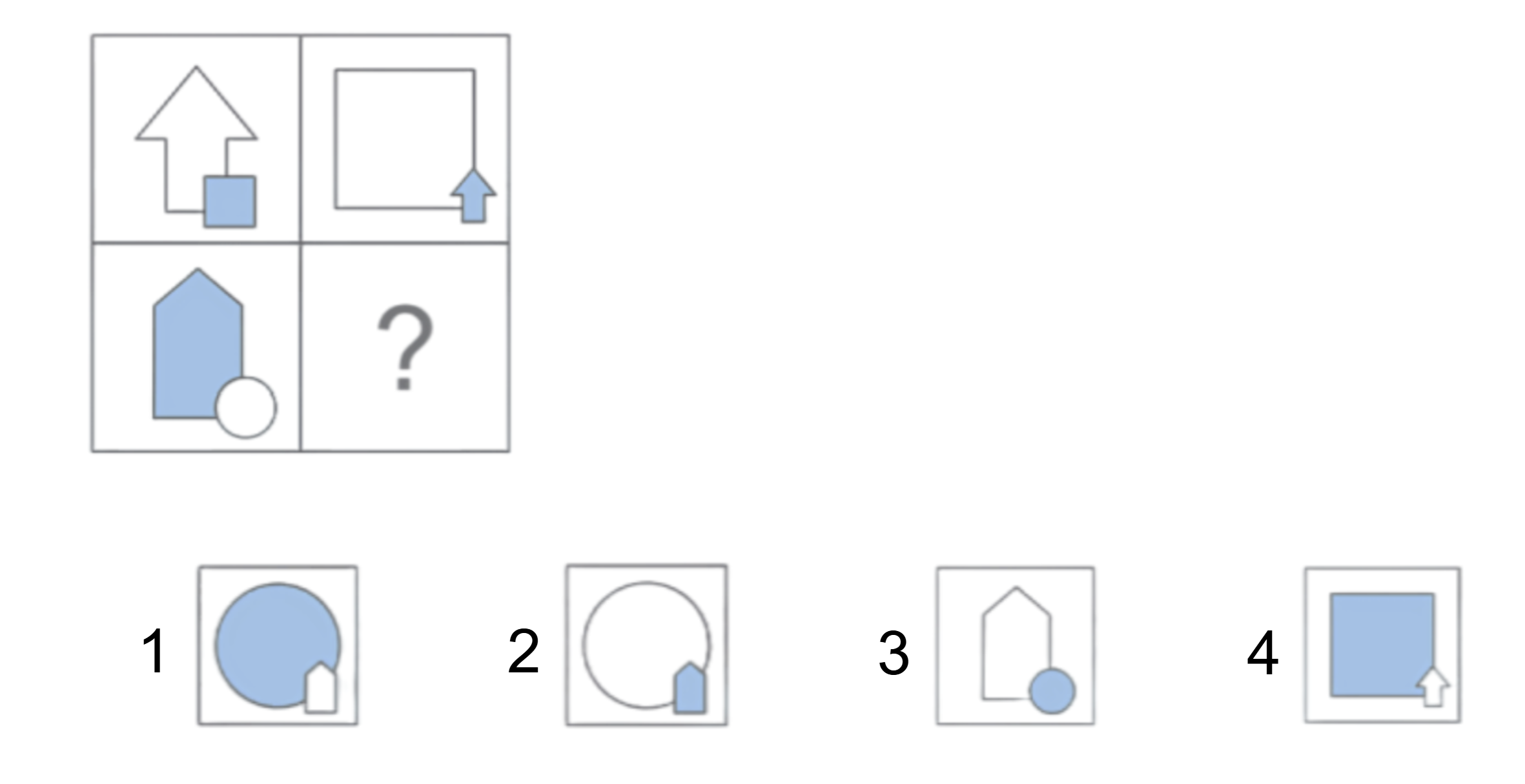

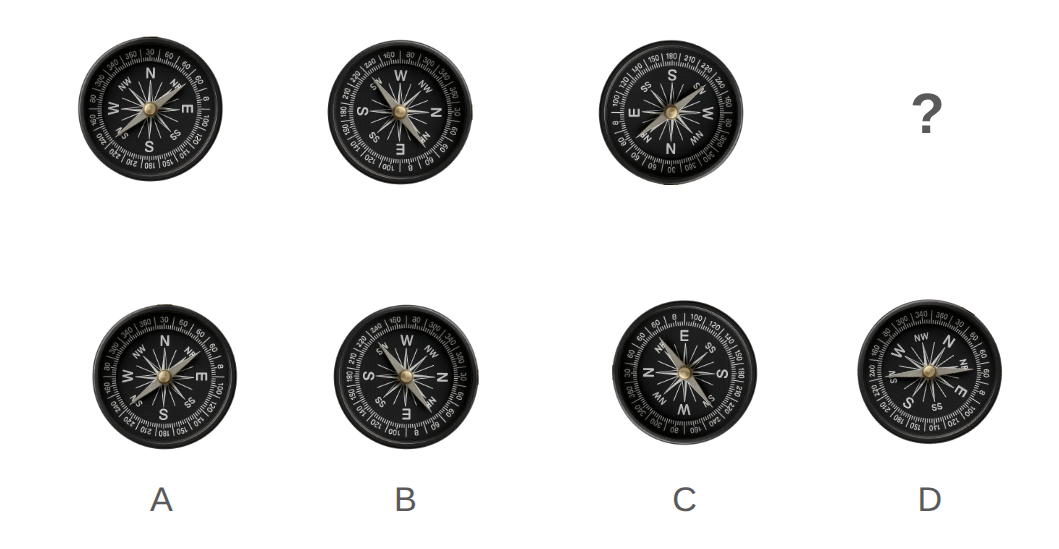

技术框架:VRIQ基准包含两类任务:抽象谜题风格任务和自然图像推理任务。同时,设计了诊断性探针,用于评估VLMs在感知和推理两个方面的能力。诊断性探针进一步细分为针对特定感知类别的探针,如形状、计数、位置、3D/深度等。整体流程包括:1) 构建VRIQ基准;2) 使用VLMs在VRIQ上进行测试;3) 使用诊断性探针分析VLMs的错误来源;4) 分析不同感知类别对性能的影响。

关键创新:VRIQ基准的创新之处在于其专门针对VLMs的视觉推理能力设计,并结合了诊断性探针,能够深入分析VLMs在感知和推理方面的弱点。此外,VRIQ还包含了抽象谜题风格的任务,能够更好地评估VLMs的抽象推理能力。

关键设计:VRIQ基准中的任务设计考虑了不同的视觉推理类型,如空间关系、逻辑推理等。诊断性探针的设计则针对感知和推理两个方面,通过设计特定的问题来评估VLMs在这两个方面的能力。细粒度的感知类别探针则进一步分析了不同感知类别对性能的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VLMs在VRIQ基准的抽象谜题任务上表现接近随机(约28%准确率),在自然图像任务上表现稍好但仍然较弱(45%准确率)。诊断性探针分析发现,约56%的失败源于感知问题,43%源于感知和推理的共同作用,仅1%源于推理本身。这表明当前VLMs的视觉推理能力主要受限于感知能力。

🎯 应用场景

该研究成果可应用于提升视觉语言模型在机器人导航、图像理解、智能问答等领域的性能。通过VRIQ基准的评估和诊断,可以指导VLMs的改进方向,使其在复杂视觉场景中具备更强的推理能力,从而实现更智能的人机交互。

📄 摘要(原文)

Recent progress in Vision Language Models (VLMs) has raised the question of whether they can reliably perform nonverbal reasoning. To this end, we introduce VRIQ (Visual Reasoning IQ), a novel benchmark designed to assess and analyze the visual reasoning ability of VLMs. We evaluate models on two sets of tasks: abstract puzzle-style and natural-image reasoning tasks. We find that on abstract puzzles, performance remains near random with an average accuracy of around 28%, while natural tasks yield better but still weak results with 45% accuracy. We also find that tool-augmented reasoning demonstrates only modest improvements. To uncover the source of this weakness, we introduce diagnostic probes targeting perception and reasoning. Our analysis demonstrates that around 56% of failures arise from perception alone, 43% from both perception and reasoning, and only a mere 1% from reasoning alone. This motivates us to design fine-grained diagnostic probe questions targeting specific perception categories (e.g., shape, count, position, 3D/depth), revealing that certain categories cause more failures than others. Our benchmark and analysis establish that current VLMs, even with visual reasoning tools, remain unreliable abstract reasoners, mostly due to perception limitations, and offer a principled basis for improving visual reasoning in multimodal systems.