Annotation Free Spacecraft Detection and Segmentation using Vision Language Models

作者: Samet Hicsonmez, Jose Sosa, Dan Pineau, Inder Pal Singh, Arunkumar Rathinam, Abd El Rahman Shabayek, Djamila Aouada

分类: cs.CV

发布日期: 2026-02-04

备注: ICRA 2026

🔗 代码/项目: GITHUB

💡 一句话要点

提出一种基于视觉语言模型的无标注航天器检测与分割方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 航天器检测 航天器分割 视觉语言模型 无监督学习 知识蒸馏

📋 核心要点

- 航天图像人工标注成本高昂,存在低可见度、光照变化和目标与背景融合等挑战。

- 利用视觉语言模型生成伪标签,并采用教师-学生模型进行知识蒸馏,实现无标注训练。

- 在多个航天数据集上验证,分割平均精度AP提升高达10个百分点,效果显著。

📝 摘要(中文)

本文提出了一种基于视觉语言模型(VLM)的航天器目标检测与分割的无标注流水线方法。由于航天领域中人工标注的困难性,该方法利用预训练的VLM自动为少量未标注的真实数据生成伪标签。然后,利用这些伪标签,在教师-学生标签蒸馏框架中训练轻量级模型。尽管伪标签存在噪声,但蒸馏过程显著优于直接的零样本VLM推理。在SPARK-2024、SPEED+和TANGO数据集上的分割任务实验表明,平均精度(AP)持续提升高达10个百分点。代码和模型可在https://github.com/giddyyupp/annotation-free-spacecraft-segmentation获取。

🔬 方法详解

问题定义:论文旨在解决航天器检测与分割任务中,由于缺乏大量标注数据而导致模型训练困难的问题。现有方法依赖于人工标注,成本高昂且容易出错,尤其是在航天图像中,光照变化、低能见度和背景干扰使得标注工作更加困难。因此,如何利用少量甚至无标注数据训练出高性能的航天器检测与分割模型是一个重要的挑战。

核心思路:论文的核心思路是利用预训练的视觉语言模型(VLM)的零样本能力,为少量未标注的真实数据自动生成伪标签,然后将这些伪标签作为弱监督信号,通过教师-学生模型的知识蒸馏方法训练轻量级的检测与分割模型。这样可以在不需要大量人工标注的情况下,获得较好的模型性能。

技术框架:整体框架包含两个主要阶段:伪标签生成阶段和知识蒸馏阶段。在伪标签生成阶段,使用预训练的VLM对少量未标注的航天图像进行推理,生成航天器的检测框和分割掩码作为伪标签。在知识蒸馏阶段,将VLM作为教师模型,轻量级的检测与分割模型作为学生模型,利用伪标签作为监督信号,训练学生模型。

关键创新:该方法最大的创新在于利用VLM的零样本能力,实现了航天器检测与分割的无标注训练。与传统的监督学习方法相比,该方法不需要人工标注数据,大大降低了训练成本。与直接使用VLM进行推理相比,通过知识蒸馏可以提高模型的性能和泛化能力。

关键设计:在伪标签生成阶段,需要选择合适的VLM模型和prompt工程,以获得高质量的伪标签。在知识蒸馏阶段,需要设计合适的损失函数,例如交叉熵损失和Dice损失,以指导学生模型的训练。此外,学生模型的网络结构也需要精心设计,以保证模型的轻量性和高性能。论文中具体使用的VLM模型和学生模型结构以及损失函数等细节未明确说明,属于未知信息。

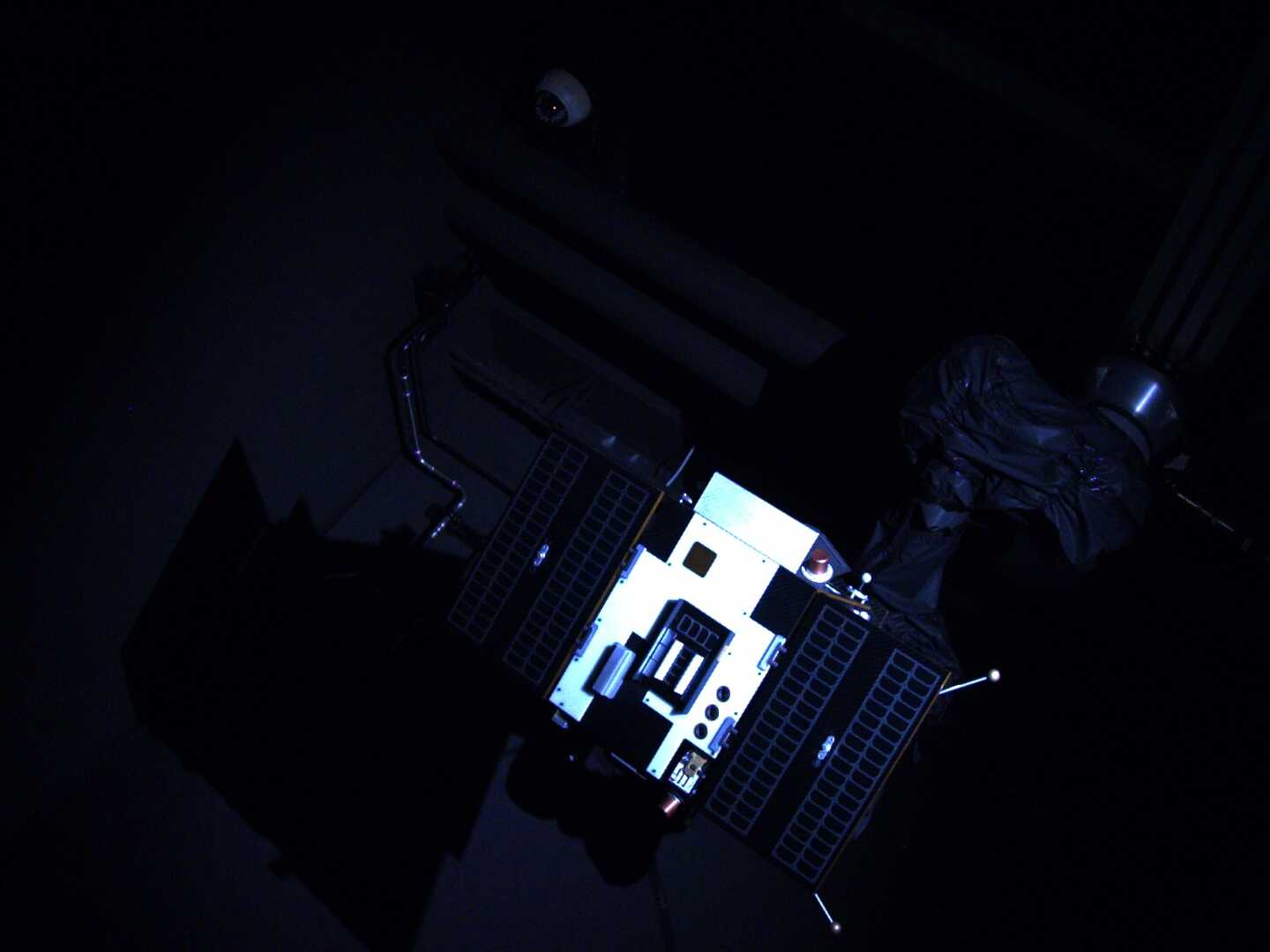

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在SPARK-2024、SPEED+和TANGO数据集上均取得了显著的性能提升。与直接使用VLM进行零样本推理相比,分割平均精度(AP)提升高达10个百分点。这表明该方法能够有效利用VLM的知识,并克服伪标签噪声带来的影响,从而提高模型的性能。

🎯 应用场景

该研究成果可应用于卫星遥感图像分析、空间态势感知、空间碎片监测等领域。通过自动检测和分割航天器,可以提高空间目标的识别效率和准确性,为空间任务规划、空间安全保障等提供技术支持,具有重要的实际应用价值和战略意义。

📄 摘要(原文)

Vision Language Models (VLMs) have demonstrated remarkable performance in open-world zero-shot visual recognition. However, their potential in space-related applications remains largely unexplored. In the space domain, accurate manual annotation is particularly challenging due to factors such as low visibility, illumination variations, and object blending with planetary backgrounds. Developing methods that can detect and segment spacecraft and orbital targets without requiring extensive manual labeling is therefore of critical importance. In this work, we propose an annotation-free detection and segmentation pipeline for space targets using VLMs. Our approach begins by automatically generating pseudo-labels for a small subset of unlabeled real data with a pre-trained VLM. These pseudo-labels are then leveraged in a teacher-student label distillation framework to train lightweight models. Despite the inherent noise in the pseudo-labels, the distillation process leads to substantial performance gains over direct zero-shot VLM inference. Experimental evaluations on the SPARK-2024, SPEED+, and TANGO datasets on segmentation tasks demonstrate consistent improvements in average precision (AP) by up to 10 points. Code and models are available at https://github.com/giddyyupp/annotation-free-spacecraft-segmentation.