OmniRad: A Radiological Foundation Model for Multi-Task Medical Image Analysis

作者: Luca Zedda, Andrea Loddo, Cecilia Di Ruberto

分类: cs.CV, cs.AI

发布日期: 2026-02-04

备注: 19 pages, 4 figures, 12 tables

💡 一句话要点

OmniRad:面向多任务医学影像分析的放射学基础模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医学影像分析 放射学基础模型 自监督学习 迁移学习 多任务学习 深度学习 医学图像分割

📋 核心要点

- 放射学分析日益依赖预训练视觉表征,但现有方法在跨模态和多任务的支持上存在不足。

- OmniRad通过在大量医学图像上进行自监督预训练,并结合放射学领域的先验知识,实现表征重用和跨任务迁移。

- 实验表明,OmniRad在多个医学影像数据集上,分类和分割任务均取得了显著提升,尤其是在MedMNISTv2上F1提升了2.05%。

📝 摘要(中文)

本文提出了OmniRad,一个自监督放射学基础模型,该模型在120万张医学图像上进行预训练,其设计灵感来源于放射学原理,强调表征重用和跨任务迁移能力。作者在多种下游自适应模式下评估了预训练编码器,包括使用带有冻结骨干网络的轻量级任务特定适配器,以及用于分类的完全端到端微调,从而评估表征质量和任务特定性能。OmniRad在一系列涵盖多种模态的公共基准上进行了评估,包括分类和分割任务。在MedMNISTv2集合上,OmniRad的分类F1得分比同类基础模型提高了2.05%。对于密集预测,当使用冻结表示时,OmniRad在六个MedSegBench数据集上获得了平均Dice得分的提升。定性分析和潜在空间可视化表明,特征聚类和模态相关分离得到了改善。

🔬 方法详解

问题定义:放射学图像分析面临着数据模态多样、任务类型繁多的挑战。现有的预训练模型虽然在自然图像领域取得了显著成果,但在医学影像领域,由于数据分布差异和领域知识的缺乏,其泛化能力受到限制。因此,如何构建一个能够有效利用大规模医学影像数据,并能迁移到不同模态和任务的放射学基础模型是一个关键问题。

核心思路:OmniRad的核心思路是利用大规模医学影像数据进行自监督预训练,学习通用的放射学图像表征。同时,借鉴放射学领域的先验知识,设计模型结构和训练策略,以提高表征的质量和泛化能力。通过强调表征重用和跨任务迁移,使得模型能够适应不同的下游任务,减少对特定任务标注数据的依赖。

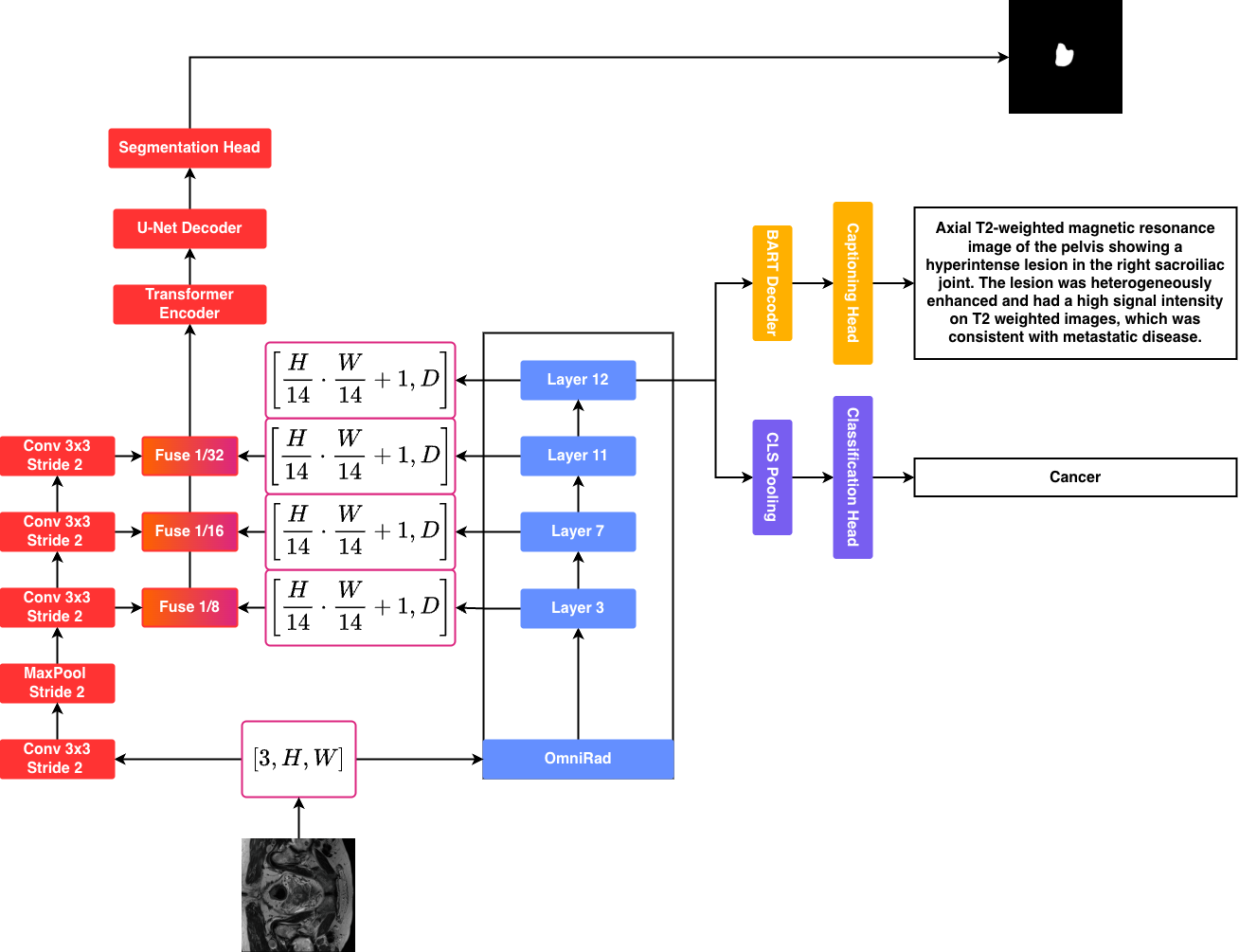

技术框架:OmniRad的整体框架包括一个预训练阶段和一个下游任务适应阶段。在预训练阶段,模型使用自监督学习方法在大规模医学影像数据集上进行训练,学习通用的图像表征。在下游任务适应阶段,可以使用轻量级的任务特定适配器(Adapter)或进行完全端到端微调,将预训练模型应用于不同的分类和分割任务。

关键创新:OmniRad的关键创新在于其放射学领域知识的融入和表征重用的设计。通过在大量医学图像上进行预训练,模型能够学习到医学图像的通用特征。同时,通过设计合适的模型结构和训练策略,使得模型能够更好地适应不同的医学影像模态和任务。此外,OmniRad还采用了轻量级的任务特定适配器,可以在冻结骨干网络的情况下,快速适应新的下游任务。

关键设计:OmniRad的具体实现细节包括:使用Transformer作为基础架构,采用对比学习作为自监督学习方法,设计了针对医学影像的特定数据增强策略,以及使用轻量级的Adapter进行下游任务适应。具体的损失函数和网络结构细节在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

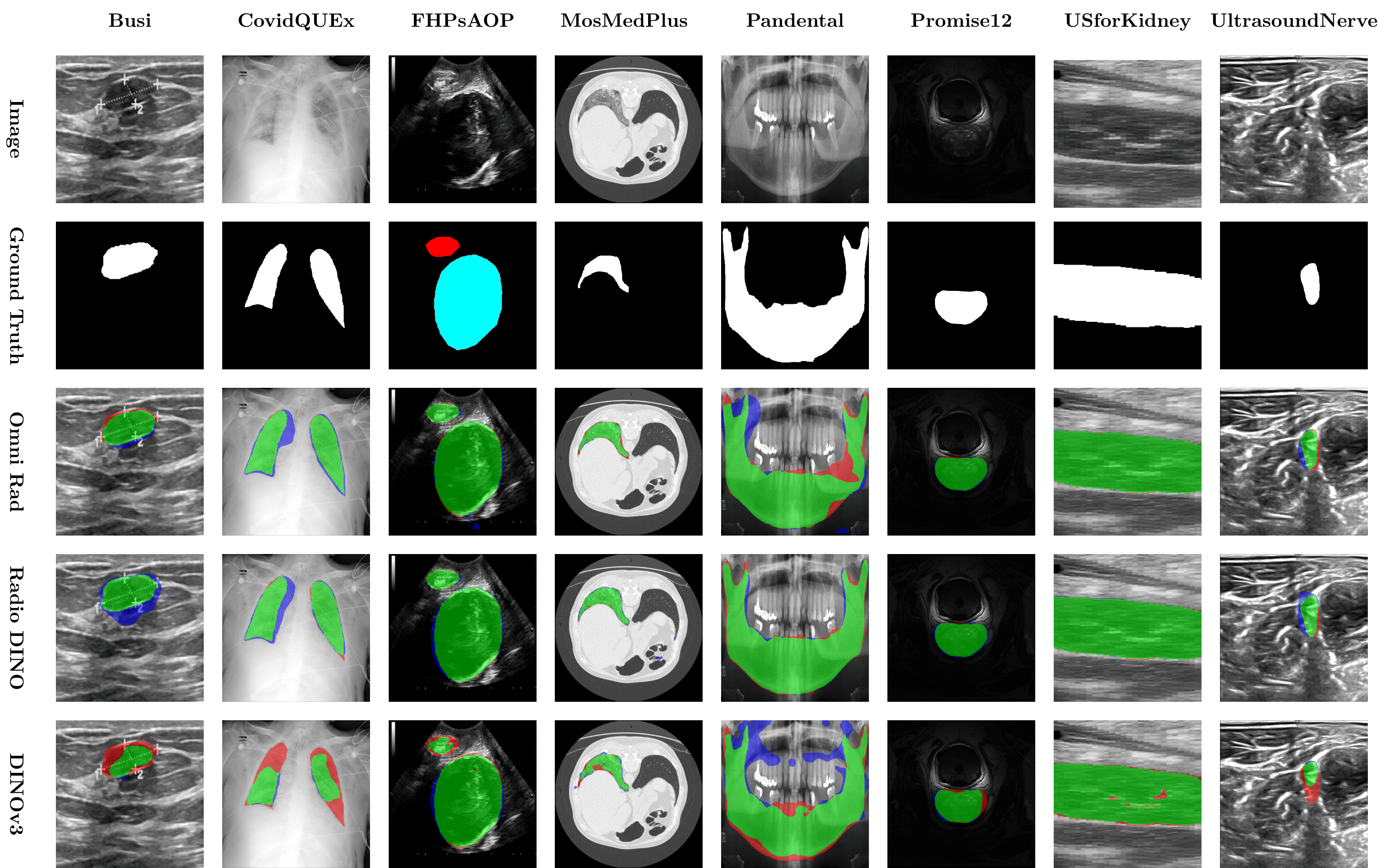

OmniRad在MedMNISTv2数据集上,分类F1得分比现有基础模型提升了2.05%。在MedSegBench数据集上,使用冻结表示时,平均Dice得分也获得了显著提升。这些结果表明,OmniRad能够有效学习医学影像的通用表征,并在多个下游任务上取得优异的性能。定性分析和潜在空间可视化也验证了OmniRad在特征聚类和模态分离方面的优势。

🎯 应用场景

OmniRad具有广泛的应用前景,可用于辅助医生进行疾病诊断、病灶分割和病情评估。通过迁移学习,该模型可以快速适应新的医学影像模态和任务,降低对标注数据的依赖,加速医学影像分析的自动化进程。未来,OmniRad有望成为医学影像分析领域的重要基础设施,推动人工智能在医疗领域的应用。

📄 摘要(原文)

Radiological analysis increasingly benefits from pretrained visual representations that can support heterogeneous downstream tasks across imaging modalities. In this work, we introduce OmniRad, a self-supervised radiological foundation model pretrained on 1.2 million medical images, designed with radiology-inspired principles emphasizing representation reuse and cross-task transferability. We evaluate the pretrained encoder under multiple downstream adaptation regimes, including lightweight task-specific adapters with a frozen backbone as well as full end-to-end fine-tuning for classification, allowing us to assess both representation quality and task-specific performance. OmniRad is evaluated on a broad suite of public benchmarks spanning classification and segmentation across multiple modalities. On the MedMNISTv2 collection, OmniRad improves classification F1 by up to 2.05% over competing foundation models. For dense prediction, OmniRad attains mean Dice score improvements across six MedSegBench datasets when using frozen representations. Qualitative analyses and latent-space visualizations suggest improved feature clustering and modality-related separation.