Temporal Slowness in Central Vision Drives Semantic Object Learning

作者: Timothy Schaumlöffel, Arthur Aubret, Gemma Roig, Jochen Triesch

分类: cs.CV

发布日期: 2026-02-04

备注: ICLR 2026

💡 一句话要点

利用中心视觉的时间迟缓特性,提升自监督学习的物体语义表征能力

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 自监督学习 物体表征 中心视觉 时间迟缓 自我中心视觉 Ego4D数据集 注视预测

📋 核心要点

- 现有方法在利用自我中心视觉流学习物体语义表征时,缺乏对中心视觉和时间信息的有效建模。

- 该研究提出结合中心视觉和时间迟缓学习,通过模拟人类视觉体验,提升自监督学习的物体语义表征能力。

- 实验结果表明,该方法能够有效提取前景物体特征,并编码更广泛的物体语义信息,优于现有方法。

📝 摘要(中文)

本文研究了中心视觉和时间迟缓学习在从类人视觉体验中形成语义物体表征中的作用。通过Ego4D数据集模拟了五个月的类人视觉体验,并使用先进的注视预测模型生成注视坐标。利用这些预测,提取模拟中心视觉的图像块,并在其上训练时间对比自监督学习模型。结果表明,结合时间迟缓和中心视觉能够改善物体表征不同语义方面的编码。具体来说,关注中心视觉能够加强前景物体特征的提取,而考虑时间迟缓,尤其是在注视期间,能够使模型编码更广泛的物体语义信息。这些发现为人类如何从自然视觉体验中发展语义物体表征的机制提供了新的见解。

🔬 方法详解

问题定义:现有方法在利用自我中心视觉数据进行物体语义表征学习时,通常忽略了人类视觉系统的两个重要特性:一是人类视觉系统主要以高分辨率处理视野中心区域的信息;二是视觉系统倾向于学习时间上接近的视觉输入的相似表征。因此,如何有效地利用中心视觉和时间信息来提升物体语义表征学习是一个关键问题。

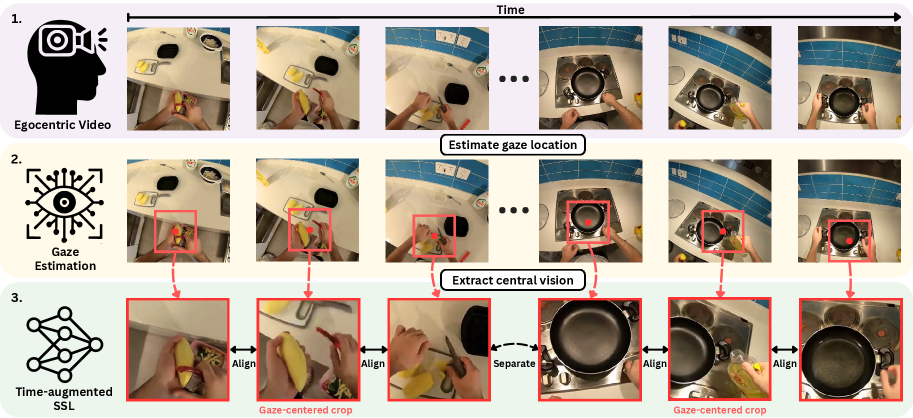

核心思路:本文的核心思路是模拟人类的视觉体验,通过结合中心视觉和时间迟缓学习,训练一个自监督学习模型,从而提升物体语义表征能力。具体来说,利用注视预测模型模拟人类的注视行为,提取中心视觉区域的图像块,并利用时间对比学习方法,鼓励模型学习时间上接近的视觉输入的相似表征。

技术框架:该方法主要包含以下几个阶段:1) 数据生成:使用Ego4D数据集模拟类人视觉体验,并使用注视预测模型生成注视坐标。2) 中心视觉模拟:根据注视坐标,提取模拟中心视觉的图像块。3) 模型训练:在提取的图像块上训练时间对比自监督学习模型。4) 表征评估:评估学习到的物体表征在不同语义方面的表现。

关键创新:该研究的关键创新在于将中心视觉和时间迟缓学习结合起来,用于提升自监督学习的物体语义表征能力。与现有方法相比,该方法更符合人类视觉系统的特性,能够更有效地利用自我中心视觉数据。

关键设计:该研究使用了时间对比自监督学习模型,该模型通过对比时间上接近的视觉输入和时间上远离的视觉输入,来学习物体表征。具体来说,该模型使用了InfoNCE损失函数,该损失函数鼓励模型学习时间上接近的视觉输入的相似表征,并抑制时间上远离的视觉输入的相似表征。此外,该研究还使用了先进的注视预测模型,以更准确地模拟人类的注视行为。

🖼️ 关键图片

📊 实验亮点

实验结果表明,结合时间迟缓和中心视觉能够显著改善物体表征的不同语义方面的编码。关注中心视觉能够加强前景物体特征的提取,而考虑时间迟缓,尤其是在注视期间,能够使模型编码更广泛的物体语义信息。具体性能提升数据未知。

🎯 应用场景

该研究成果可应用于机器人视觉、自动驾驶、视频理解等领域。通过模拟人类视觉系统的特性,可以提升机器在复杂环境下的物体识别和理解能力。此外,该研究也为理解人类视觉认知机制提供了新的思路。

📄 摘要(原文)

Humans acquire semantic object representations from egocentric visual streams with minimal supervision. Importantly, the visual system processes with high resolution only the center of its field of view and learns similar representations for visual inputs occurring close in time. This emphasizes slowly changing information around gaze locations. This study investigates the role of central vision and slowness learning in the formation of semantic object representations from human-like visual experience. We simulate five months of human-like visual experience using the Ego4D dataset and generate gaze coordinates with a state-of-the-art gaze prediction model. Using these predictions, we extract crops that mimic central vision and train a time-contrastive Self-Supervised Learning model on them. Our results show that combining temporal slowness and central vision improves the encoding of different semantic facets of object representations. Specifically, focusing on central vision strengthens the extraction of foreground object features, while considering temporal slowness, especially during fixational eye movements, allows the model to encode broader semantic information about objects. These findings provide new insights into the mechanisms by which humans may develop semantic object representations from natural visual experience.