VecSet-Edit: Unleashing Pre-trained LRM for Mesh Editing from Single Image

作者: Teng-Fang Hsiao, Bo-Kai Ruan, Yu-Lun Liu, Hong-Han Shuai

分类: cs.CV, cs.AI

发布日期: 2026-02-04

🔗 代码/项目: GITHUB

💡 一句话要点

VecSet-Edit:利用预训练LRM实现单图像网格编辑

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D网格编辑 预训练模型 VecSet LRM 单图像重建 扩散模型

📋 核心要点

- 现有3D网格编辑方法依赖体素表示,存在分辨率低、需人工标注3D掩模等问题,限制了编辑的精度和效率。

- VecSet-Edit利用预训练的VecSet LRM,通过分析token的空间属性,实现基于2D图像条件的精确网格编辑。

- 该方法引入Token Seeding、Token Gating和Token Pruning等策略,并结合细节保留纹理烘焙,提升编辑质量。

📝 摘要(中文)

3D编辑已成为一个重要的研究领域,旨在为用户提供对3D资产的灵活控制。虽然当前的编辑方法主要集中于3D高斯溅射或多视图图像,但直接编辑3D网格的研究仍然不足。先前的尝试,如VoxHammer,依赖于基于体素的表示,这受到有限分辨率的限制,并且需要大量的人工3D掩模。为了解决这些限制,我们提出了VecSet-Edit,这是第一个利用高保真VecSet大型重建模型(LRM)作为网格编辑主干的流程。我们的方法基于对VecSet tokens中空间属性的分析,揭示了token子集控制着不同的几何区域。基于这一洞察,我们引入了掩模引导的Token Seeding和注意力对齐的Token Gating策略,仅使用2D图像条件即可精确定位目标区域。此外,考虑到VecSet扩散过程与体素之间的差异,我们设计了一种漂移感知Token Pruning来拒绝去噪过程中的几何异常值。最后,我们的细节保留纹理烘焙模块确保我们不仅保留原始网格的几何细节,还保留纹理信息。更多详细信息可以在我们的项目页面找到:https://github.com/BlueDyee/VecSet-Edit/tree/main

🔬 方法详解

问题定义:论文旨在解决直接编辑3D网格的难题。现有方法,如VoxHammer,依赖于体素表示,存在分辨率低、计算量大,以及需要人工标注3D掩模等问题,严重限制了编辑的精度和效率,阻碍了3D网格编辑的广泛应用。

核心思路:论文的核心思路是利用预训练的VecSet大型重建模型(LRM)的强大表征能力,通过分析VecSet tokens的空间属性,建立图像特征与网格几何区域之间的对应关系。通过操纵特定的token子集,实现对3D网格的精确编辑。这种方法避免了体素化过程,从而提高了编辑的分辨率和效率。

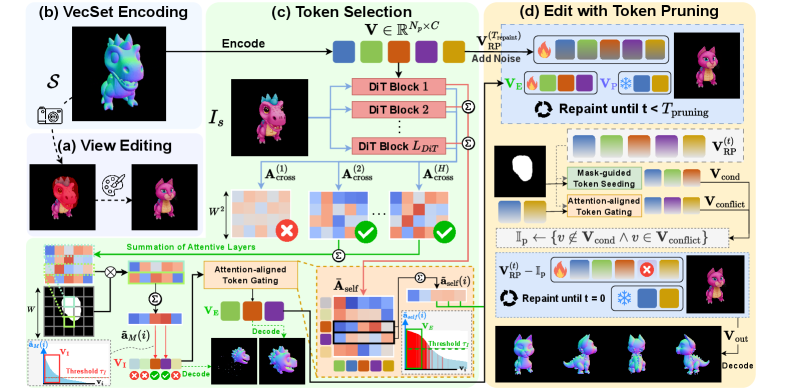

技术框架:VecSet-Edit的整体流程包括以下几个主要模块:1) Mask-guided Token Seeding:根据2D图像掩模,初始化目标区域的tokens。2) Attention-aligned Token Gating:利用注意力机制,筛选与目标区域相关的tokens。3) Drift-aware Token Pruning:在去噪过程中,去除几何异常值,保证编辑的稳定性。4) Detail-preserving Texture Baking:将编辑后的几何信息和原始纹理信息融合,保留细节。

关键创新:该论文的关键创新在于:1) 首次将预训练的VecSet LRM应用于3D网格编辑。2) 提出了Mask-guided Token Seeding和Attention-aligned Token Gating策略,实现了基于2D图像条件的精确区域定位。3) 设计了Drift-aware Token Pruning方法,有效抑制了编辑过程中的几何漂移。

关键设计:1) Token Seeding:使用2D图像掩模作为引导,选择与目标区域对应的VecSet tokens作为种子。2) Token Gating:利用交叉注意力机制,计算图像特征与VecSet tokens之间的相关性,筛选出与目标区域高度相关的tokens。3) Token Pruning:在扩散模型的去噪过程中,通过计算tokens的几何一致性,去除偏离目标区域的tokens。4) Texture Baking:使用UV展开将编辑后的网格几何信息映射回原始纹理,保留细节。

🖼️ 关键图片

📊 实验亮点

论文提出的VecSet-Edit方法,首次实现了基于预训练LRM的单图像网格编辑。通过Mask-guided Token Seeding和Attention-aligned Token Gating策略,能够精确地定位目标编辑区域。Drift-aware Token Pruning有效抑制了几何漂移,提升了编辑质量。细节保留纹理烘焙模块保证了编辑后的模型具有高质量的纹理细节。

🎯 应用场景

VecSet-Edit在游戏开发、虚拟现实、数字内容创作等领域具有广泛的应用前景。它可以帮助用户快速、便捷地编辑3D模型,例如修改角色的外观、调整场景的布局等。该研究的成果有望降低3D内容创作的门槛,促进相关产业的发展。

📄 摘要(原文)

3D editing has emerged as a critical research area to provide users with flexible control over 3D assets. While current editing approaches predominantly focus on 3D Gaussian Splatting or multi-view images, the direct editing of 3D meshes remains underexplored. Prior attempts, such as VoxHammer, rely on voxel-based representations that suffer from limited resolution and necessitate labor-intensive 3D mask. To address these limitations, we propose \textbf{VecSet-Edit}, the first pipeline that leverages the high-fidelity VecSet Large Reconstruction Model (LRM) as a backbone for mesh editing. Our approach is grounded on a analysis of the spatial properties in VecSet tokens, revealing that token subsets govern distinct geometric regions. Based on this insight, we introduce Mask-guided Token Seeding and Attention-aligned Token Gating strategies to precisely localize target regions using only 2D image conditions. Also, considering the difference between VecSet diffusion process versus voxel we design a Drift-aware Token Pruning to reject geometric outliers during the denoising process. Finally, our Detail-preserving Texture Baking module ensures that we not only preserve the geometric details of original mesh but also the textural information. More details can be found in our project page: https://github.com/BlueDyee/VecSet-Edit/tree/main