Natural Language Instructions for Scene-Responsive Human-in-the-Loop Motion Planning in Autonomous Driving using Vision-Language-Action Models

作者: Angel Martinez-Sanchez, Parthib Roy, Ross Greer

分类: cs.CV, cs.AI, cs.LG, cs.RO

发布日期: 2026-02-04

🔗 代码/项目: GITHUB

💡 一句话要点

利用视觉-语言-动作模型,实现场景响应式人机协同自动驾驶运动规划

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动驾驶 运动规划 自然语言指令 视觉-语言模型 人机交互

📋 核心要点

- 现有指令跟随规划器依赖模拟或固定命令词汇,限制了其在真实世界的泛化能力,是核心问题。

- 论文核心在于将乘客指令融入视觉-语言接口,在轨迹生成前进行语言条件约束,提升规划的鲁棒性。

- 实验表明,指令条件约束显著降低了平均ADE,即使移除异常值,良好指令仍能有效提升轨迹对齐。

📝 摘要(中文)

本文提出了一种基于自然语言指令的自动驾驶运动规划方法,旨在使车辆能够理解乘客的意图并据此规划轨迹。作者利用首个真实世界数据集doScenes,该数据集将自由形式的指令(带有指代性)与nuScenes的真实运动数据相关联,从而实现指令条件下的规划。本文将开源MLLM端到端驾驶框架OpenEMMA适配到该场景,构建了一个可复现的指令条件基线,并研究了人类指令提示对预测驾驶行为的影响。通过将doScenes指令作为乘客风格的提示集成到OpenEMMA的视觉-语言接口中,实现了轨迹生成前的语言条件约束。在849个标注场景上的评估表明,指令条件约束显著提高了鲁棒性,避免了极端故障,平均ADE降低了98.7%。即使移除异常值,指令仍然影响轨迹对齐,措辞良好的提示可将ADE提高高达5.1%。作者进一步分析了OpenEMMA框架下“良好”指令的构成要素,并发布了评估提示和脚本,为指令感知规划建立了一个可复现的基线。

🔬 方法详解

问题定义:论文旨在解决自动驾驶中如何利用自然语言指令引导车辆运动规划的问题。现有方法主要依赖于模拟环境或预定义的命令集,无法很好地处理真实世界中复杂多变的指令,尤其是在存在指代的情况下,难以准确理解乘客的意图并做出相应的规划。

核心思路:论文的核心思路是将自然语言指令作为条件,融入到视觉-语言-动作的端到端自动驾驶框架中。通过将指令与视觉信息相结合,使车辆能够更好地理解场景和乘客的意图,从而生成更合理、更安全的驾驶轨迹。这种方法旨在提高自动驾驶系统对人类指令的理解和执行能力,使其更贴近人类驾驶员的驾驶习惯。

技术框架:论文基于开源的MLLM端到端驾驶框架OpenEMMA,该框架接收前置摄像头视图和车辆自身状态作为输入,输出10步的速度-曲率轨迹。为了实现指令条件下的规划,作者将doScenes数据集中的指令作为乘客风格的提示,集成到OpenEMMA的视觉-语言接口中。具体流程是:首先,OpenEMMA处理视觉输入和车辆状态;然后,结合指令提示,通过MLLM生成轨迹;最后,根据生成的轨迹控制车辆运动。

关键创新:论文的关键创新在于将自然语言指令直接融入到端到端的自动驾驶框架中,实现了指令条件下的运动规划。与以往依赖预定义命令或模拟环境的方法不同,该方法能够处理自由形式的指令,并利用真实世界的数据进行训练和评估。此外,论文还分析了不同指令对驾驶行为的影响,为设计更有效的指令提示提供了指导。

关键设计:论文的关键设计包括:1) 使用doScenes数据集,该数据集包含真实世界场景下的自由形式指令和对应的车辆运动数据;2) 将指令作为提示集成到OpenEMMA的视觉-语言接口中,利用MLLM进行指令理解和轨迹生成;3) 使用ADE(Average Displacement Error)作为评估指标,衡量预测轨迹与真实轨迹之间的差异;4) 分析不同指令对ADE的影响,从而优化指令提示的设计。

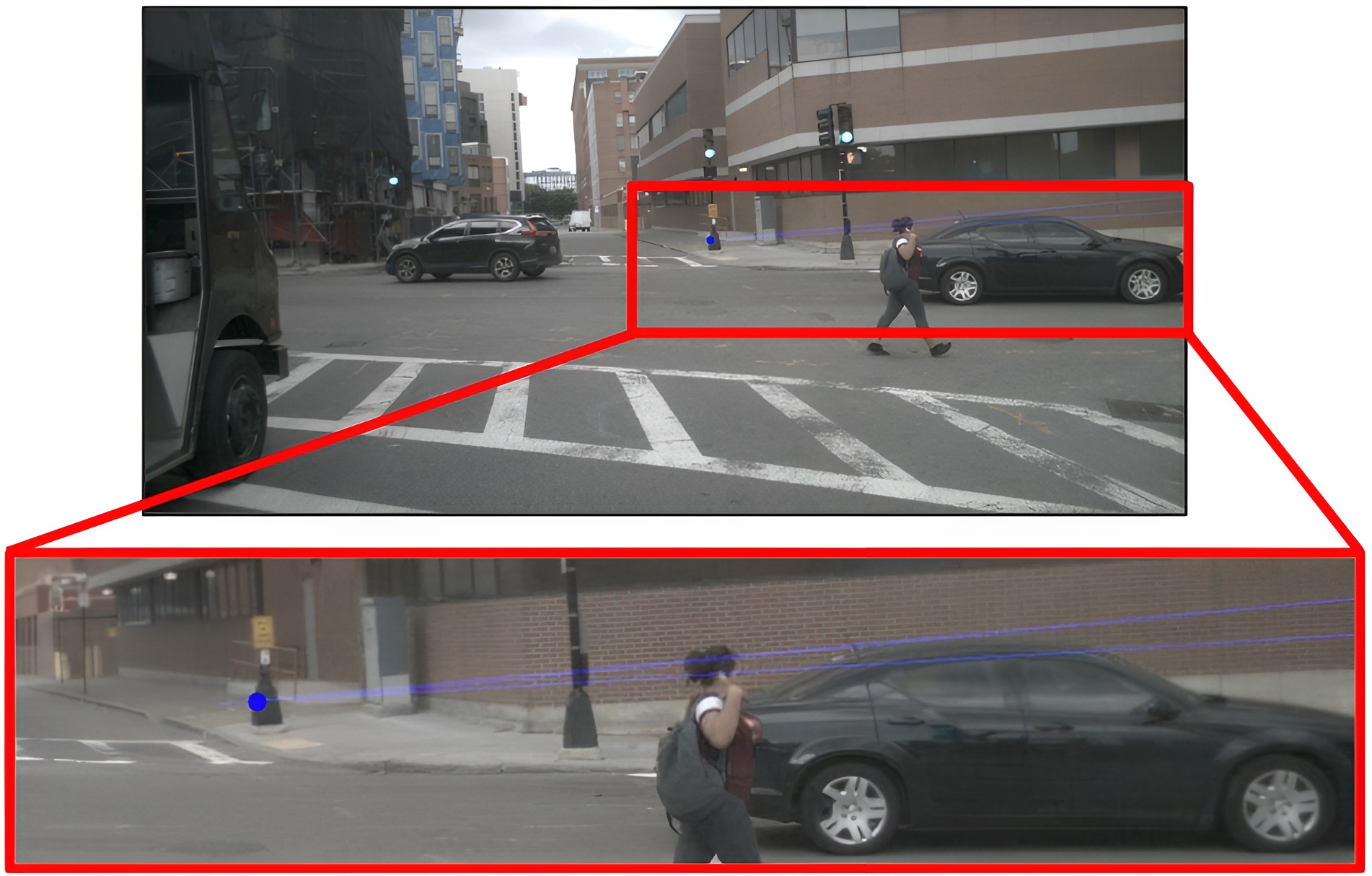

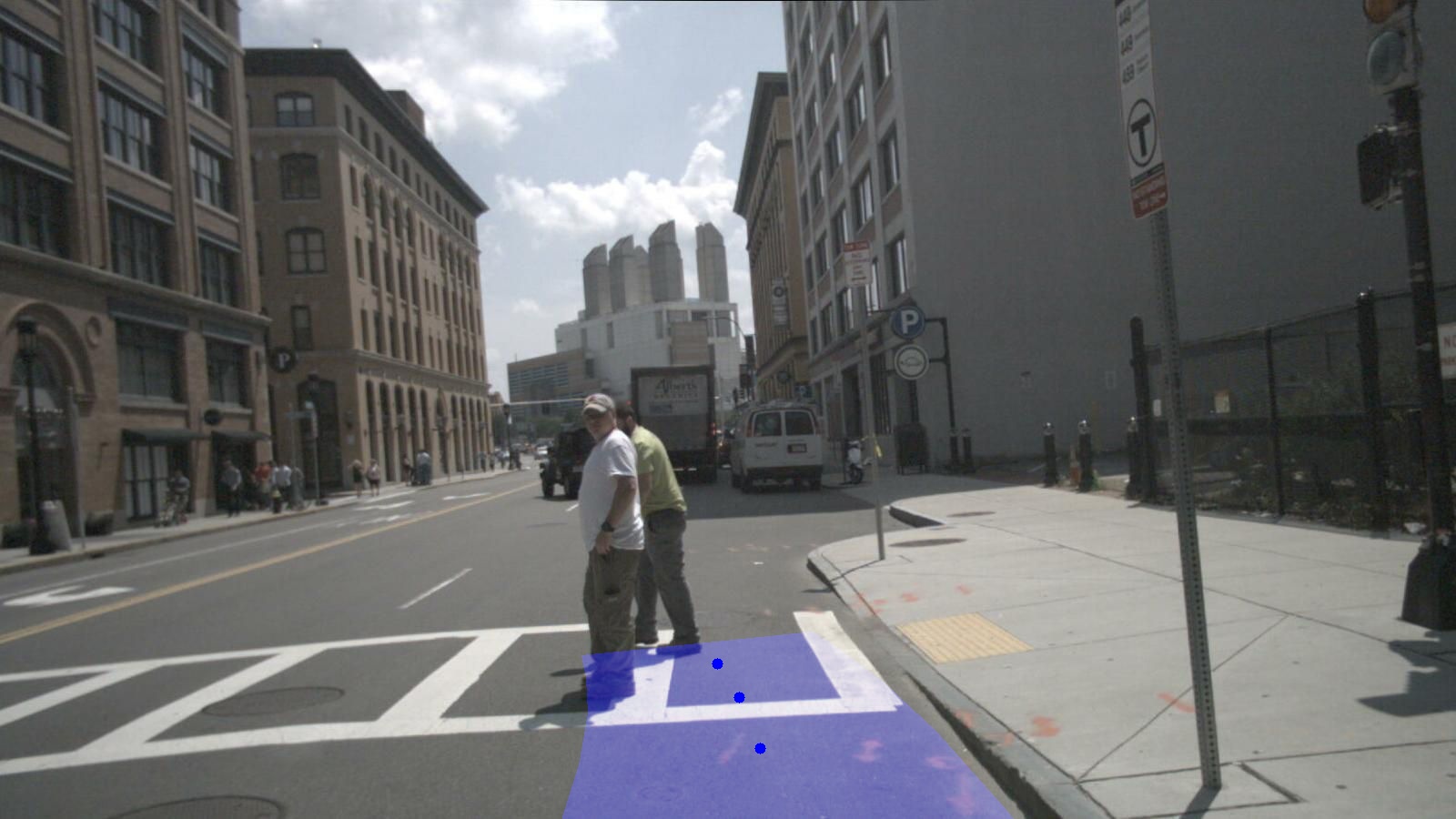

🖼️ 关键图片

📊 实验亮点

实验结果表明,在doScenes数据集上,指令条件约束显著提高了OpenEMMA的鲁棒性,平均ADE降低了98.7%。即使移除异常值,精心设计的指令提示仍然可以将ADE提高高达5.1%。这些结果表明,自然语言指令可以有效地引导自动驾驶车辆的运动规划,提高其性能和安全性。

🎯 应用场景

该研究成果可应用于各种自动驾驶场景,例如出租车服务、物流运输和个人车辆。通过自然语言指令,乘客可以更方便地与车辆进行交互,指定目的地、行驶路线和驾驶风格。此外,该技术还可以用于辅助驾驶系统,帮助驾驶员更好地理解交通状况和做出决策,提高驾驶安全性。

📄 摘要(原文)

Instruction-grounded driving, where passenger language guides trajectory planning, requires vehicles to understand intent before motion. However, most prior instruction-following planners rely on simulation or fixed command vocabularies, limiting real-world generalization. doScenes, the first real-world dataset linking free-form instructions (with referentiality) to nuScenes ground-truth motion, enables instruction-conditioned planning. In this work, we adapt OpenEMMA, an open-source MLLM-based end-to-end driving framework that ingests front-camera views and ego-state and outputs 10-step speed-curvature trajectories, to this setting, presenting a reproducible instruction-conditioned baseline on doScenes and investigate the effects of human instruction prompts on predicted driving behavior. We integrate doScenes directives as passenger-style prompts within OpenEMMA's vision-language interface, enabling linguistic conditioning before trajectory generation. Evaluated on 849 annotated scenes using ADE, we observe that instruction conditioning substantially improves robustness by preventing extreme baseline failures, yielding a 98.7% reduction in mean ADE. When such outliers are removed, instructions still influence trajectory alignment, with well-phrased prompts improving ADE by up to 5.1%. We use this analysis to discuss what makes a "good" instruction for the OpenEMMA framework. We release the evaluation prompts and scripts to establish a reproducible baseline for instruction-aware planning. GitHub: https://github.com/Mi3-Lab/doScenes-VLM-Planning