Continuous Control of Editing Models via Adaptive-Origin Guidance

作者: Alon Wolf, Chen Katzir, Kfir Aberman, Or Patashnik

分类: cs.CV, cs.GR

发布日期: 2026-02-03

备注: Project page at https://adaor-paper.github.io/

💡 一句话要点

提出AdaOr自适应调整编辑模型,实现文本引导图像/视频编辑的平滑强度控制。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱四:生成式动作 (Generative Motion)

关键词: 扩散模型 图像编辑 视频编辑 文本引导 无分类器引导 自适应原点 编辑强度控制

📋 核心要点

- 现有文本引导的图像/视频编辑模型缺乏对编辑强度进行平滑控制的有效机制。

- 提出自适应原点引导(AdaOr)方法,通过调整引导原点,实现编辑强度的连续控制。

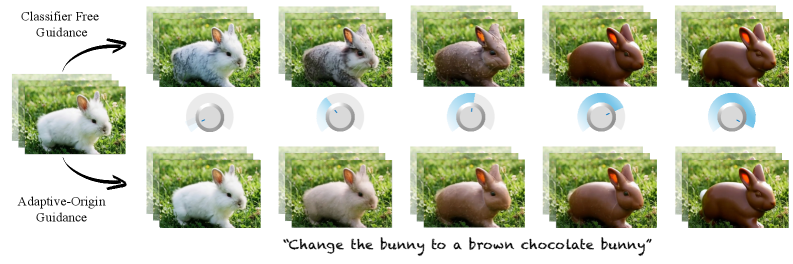

- 实验表明,AdaOr在图像和视频编辑任务上,相比现有方法,能够提供更平滑和一致的控制。

📝 摘要(中文)

基于扩散的编辑模型已成为语义图像和视频操作的强大工具。然而,现有模型缺乏平滑控制文本引导编辑强度的机制。在标准的文本条件生成中,无分类器引导(CFG)会影响提示的依从性,这表明它可以作为编辑模型中编辑强度的潜在控制。然而,我们表明,在这些模型中缩放CFG并不能产生输入和编辑结果之间的平滑过渡。我们将此行为归因于无条件预测,它作为引导原点,并在低引导尺度下主导生成,同时代表对输入内容的任意操作。为了实现连续控制,我们引入了自适应原点引导(AdaOr),这是一种使用与身份操作相对应的身份指令,通过身份条件自适应原点来调整此标准引导原点的方法。通过根据编辑强度将此身份预测与标准无条件预测进行插值,我们确保从输入到编辑结果的连续过渡。我们在图像和视频编辑任务上评估了我们的方法,表明与当前基于滑块的编辑方法相比,它提供了更平滑和更一致的控制。我们的方法将身份指令整合到标准训练框架中,从而在推理时实现细粒度的控制,而无需每次编辑都进行特殊处理或依赖专门的数据集。

🔬 方法详解

问题定义:现有基于扩散模型的图像/视频编辑方法,在利用文本引导进行编辑时,难以对编辑强度进行平滑且连续的控制。简单地调整Classifier-Free Guidance (CFG) 的尺度并不能实现平滑过渡,因为无条件预测作为引导原点,在低引导尺度下会主导生成,导致编辑效果不佳。

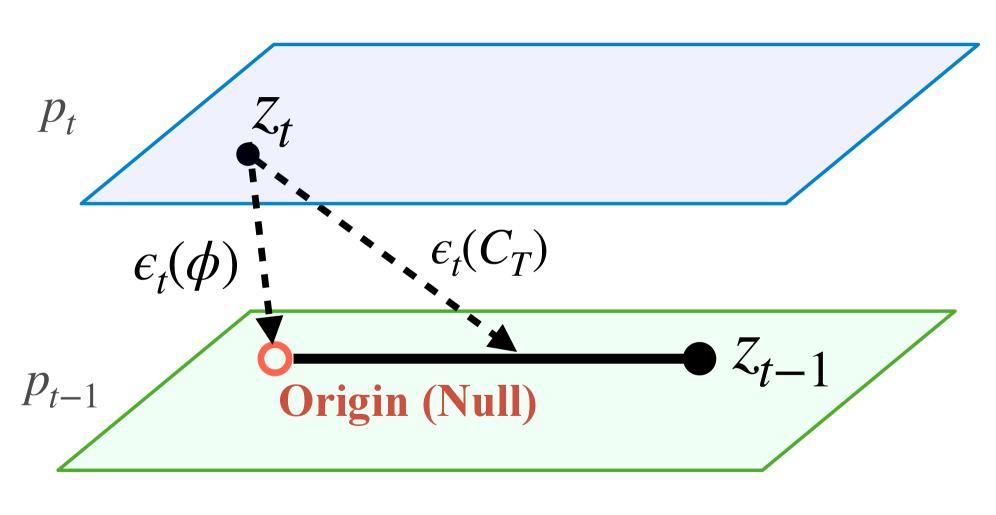

核心思路:论文的核心思路是调整CFG的引导原点。通过引入一个与“身份操作”相对应的“身份指令”,并利用该指令预测的“身份条件自适应原点”来替代原有的无条件预测,从而确保从原始输入到编辑结果的平滑过渡。

技术框架:AdaOr方法的核心在于修改了扩散模型推理阶段的引导方式。具体来说,在标准的CFG中,模型会根据文本提示和无条件输入分别进行预测。AdaOr引入了一个额外的“身份指令”,并使用该指令进行预测,得到一个“身份条件自适应原点”。然后,通过一个可调节的参数(对应于编辑强度),将“身份条件自适应原点”与原有的无条件预测进行插值,得到最终的引导原点,用于指导扩散模型的生成过程。

关键创新:AdaOr的关键创新在于提出了“自适应原点”的概念,并将其应用于扩散模型的引导过程。通过使用“身份指令”来预测一个更贴近原始输入的引导原点,AdaOr能够实现对编辑强度的平滑控制,避免了传统CFG中由于无条件预测带来的突变和不连续性。

关键设计:AdaOr的关键设计在于“身份指令”的选择和“自适应原点”的插值方式。论文中使用了与“身份操作”相对应的指令,例如“保持图像不变”等。插值方式则采用了简单的线性插值,通过调节插值系数来控制编辑强度。此外,AdaOr方法可以很容易地集成到现有的扩散模型训练框架中,无需对模型结构进行大的改动。

🖼️ 关键图片

📊 实验亮点

实验结果表明,AdaOr方法在图像和视频编辑任务上,能够实现对编辑强度的平滑控制,避免了传统CFG方法中出现的突变和不连续性。与现有的基于滑块的编辑方法相比,AdaOr能够提供更平滑和更一致的编辑效果,提升用户体验。具体性能数据和对比基线的信息在论文中详细展示。

🎯 应用场景

该研究成果可广泛应用于图像和视频编辑领域,例如照片修复、风格迁移、内容创作等。用户可以通过简单的文本指令和强度调节,实现对图像和视频内容的精细控制,提高编辑效率和创作自由度。未来,该技术有望应用于虚拟现实、增强现实等领域,为用户提供更加沉浸式的编辑体验。

📄 摘要(原文)

Diffusion-based editing models have emerged as a powerful tool for semantic image and video manipulation. However, existing models lack a mechanism for smoothly controlling the intensity of text-guided edits. In standard text-conditioned generation, Classifier-Free Guidance (CFG) impacts prompt adherence, suggesting it as a potential control for edit intensity in editing models. However, we show that scaling CFG in these models does not produce a smooth transition between the input and the edited result. We attribute this behavior to the unconditional prediction, which serves as the guidance origin and dominates the generation at low guidance scales, while representing an arbitrary manipulation of the input content. To enable continuous control, we introduce Adaptive-Origin Guidance (AdaOr), a method that adjusts this standard guidance origin with an identity-conditioned adaptive origin, using an identity instruction corresponding to the identity manipulation. By interpolating this identity prediction with the standard unconditional prediction according to the edit strength, we ensure a continuous transition from the input to the edited result. We evaluate our method on image and video editing tasks, demonstrating that it provides smoother and more consistent control compared to current slider-based editing approaches. Our method incorporates an identity instruction into the standard training framework, enabling fine-grained control at inference time without per-edit procedure or reliance on specialized datasets.