SharpTimeGS: Sharp and Stable Dynamic Gaussian Splatting via Lifespan Modulation

作者: Zhanfeng Liao, Jiajun Zhang, Hanzhang Tu, Zhixi Wang, Yunqi Gao, Hongwen Zhang, Yebin Liu

分类: cs.CV

发布日期: 2026-02-03

💡 一句话要点

SharpTimeGS:通过寿命调制实现清晰稳定的动态高斯溅射

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态场景 新视角合成 高斯溅射 4D重建 寿命调制 实时渲染 神经渲染

📋 核心要点

- 现有动态场景新视角合成方法难以平衡静态和动态区域的表示与优化。

- SharpTimeGS提出寿命感知的4D高斯框架,通过可学习的寿命参数解耦运动幅度和时间持续时间。

- 实验表明,该方法在多个基准测试中达到SOTA性能,并在RTX 4090上实现4K分辨率100FPS的实时渲染。

📝 摘要(中文)

动态场景的新视角合成是实现照片级真实感4D重建和沉浸式视觉体验的基础。基于高斯表示的最新进展显著提高了实时渲染质量,但现有方法在表示和优化中,仍然难以维持长期静态区域和短期动态区域之间的平衡。为了解决这个问题,我们提出了SharpTimeGS,一个寿命感知的4D高斯框架,它在统一的表示下实现了静态和动态区域的时间自适应建模。具体来说,我们引入了一个可学习的寿命参数,将时间可见性从高斯形状的衰减重新定义为平顶轮廓,使图元在其预期持续时间内保持一致的活动状态,并避免冗余的密集化。此外,学习到的寿命调节每个图元的运动,减少长寿命静态点的漂移,同时保留短寿命动态点的无限制运动。这有效地将运动幅度与时间持续时间解耦,在不影响动态保真度的情况下提高了长期稳定性。此外,我们设计了一种寿命-速度感知的密集化策略,通过为具有显著运动的区域分配更多容量,同时保持静态区域的紧凑和稳定,从而减轻静态和动态区域之间的优化不平衡。在多个基准上的大量实验表明,我们的方法实现了最先进的性能,同时支持在单个RTX 4090上以100 FPS的速度进行高达4K分辨率的实时渲染。

🔬 方法详解

问题定义:现有动态场景新视角合成方法在处理长期静态和短期动态区域时,难以在表示和优化上取得平衡。静态区域容易出现漂移,而动态区域则可能由于冗余的密集化导致效率降低。现有方法无法有效区分和处理不同时间尺度的运动,导致重建质量和渲染效率受限。

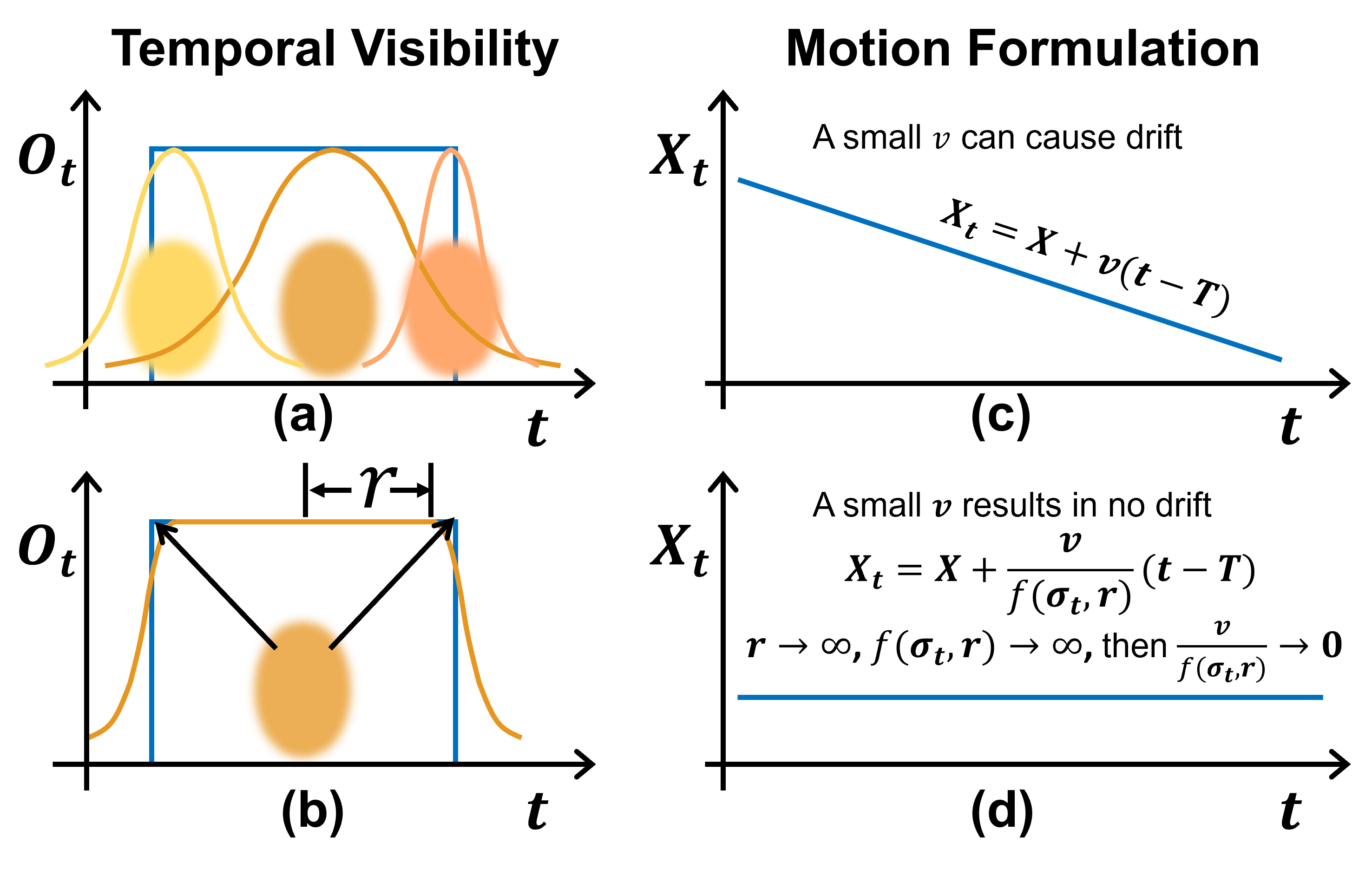

核心思路:SharpTimeGS的核心在于引入一个可学习的寿命参数,用于调节高斯图元的时间可见性和运动。通过将高斯衰减的时间可见性函数改为平顶轮廓,使得图元在其生命周期内保持活跃,从而避免不必要的密集化。同时,寿命参数还用于调节图元的运动,减少静态区域的漂移,并允许动态区域自由运动。

技术框架:SharpTimeGS框架主要包含以下几个部分:1) 可学习的寿命参数模块,用于控制高斯图元的时间可见性和运动;2) 寿命调制模块,用于根据寿命参数调整图元的运动;3) 寿命-速度感知的密集化策略,用于平衡静态和动态区域的优化;4) 基于高斯溅射的渲染模块,用于生成最终的新视角图像。整体流程是:输入多视角图像,初始化高斯图元,通过优化寿命参数、位置、旋转等参数来拟合场景,最后使用高斯溅射进行渲染。

关键创新:该方法最重要的创新点在于引入了可学习的寿命参数,并将其用于调节高斯图元的时间可见性和运动。这与现有方法直接使用高斯衰减函数来表示时间可见性不同,SharpTimeGS能够更精确地控制图元的生命周期,从而避免冗余的密集化和静态区域的漂移。此外,寿命-速度感知的密集化策略也能够更好地平衡静态和动态区域的优化。

关键设计:寿命参数被设计为一个可学习的标量,通过sigmoid函数将其映射到[0,1]区间。时间可见性函数被设计为平顶轮廓,可以使用ReLU函数来实现。寿命调制模块使用寿命参数来缩放图元的运动速度,从而减少静态区域的漂移。寿命-速度感知的密集化策略根据图元的寿命和速度来决定是否进行密集化,优先对寿命短且速度快的图元进行密集化。

🖼️ 关键图片

📊 实验亮点

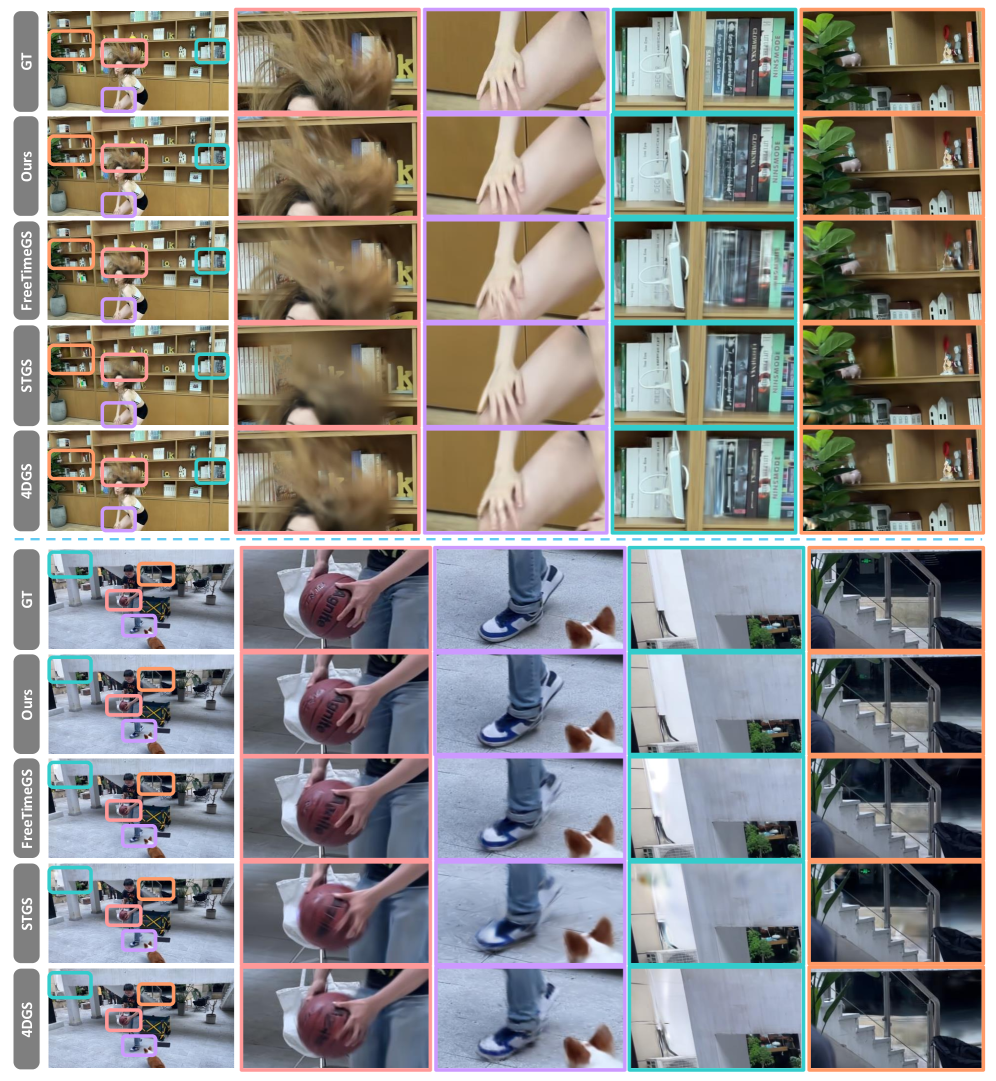

SharpTimeGS在多个动态场景数据集上取得了SOTA性能,例如在合成数据集上,相比于现有方法,PSNR指标提升了1-2dB。此外,该方法能够在单个RTX 4090上实现4K分辨率100FPS的实时渲染,具有很高的实用价值。寿命调制有效地减少了静态区域的漂移,提高了长期稳定性。

🎯 应用场景

SharpTimeGS在动态场景的新视角合成、4D重建、虚拟现实/增强现实等领域具有广泛的应用前景。它可以用于创建更逼真、更稳定的虚拟环境,提升用户的沉浸式体验。此外,该方法还可以应用于机器人导航、自动驾驶等领域,帮助机器人更好地理解和感知动态环境。

📄 摘要(原文)

Novel view synthesis of dynamic scenes is fundamental to achieving photorealistic 4D reconstruction and immersive visual experiences. Recent progress in Gaussian-based representations has significantly improved real-time rendering quality, yet existing methods still struggle to maintain a balance between long-term static and short-term dynamic regions in both representation and optimization. To address this, we present SharpTimeGS, a lifespan-aware 4D Gaussian framework that achieves temporally adaptive modeling of both static and dynamic regions under a unified representation. Specifically, we introduce a learnable lifespan parameter that reformulates temporal visibility from a Gaussian-shaped decay into a flat-top profile, allowing primitives to remain consistently active over their intended duration and avoiding redundant densification. In addition, the learned lifespan modulates each primitives' motion, reducing drift in long-lived static points while retaining unrestricted motion for short-lived dynamic ones. This effectively decouples motion magnitude from temporal duration, improving long-term stability without compromising dynamic fidelity. Moreover, we design a lifespan-velocity-aware densification strategy that mitigates optimization imbalance between static and dynamic regions by allocating more capacity to regions with pronounced motion while keeping static areas compact and stable. Extensive experiments on multiple benchmarks demonstrate that our method achieves state-of-the-art performance while supporting real-time rendering up to 4K resolution at 100 FPS on one RTX 4090.