Infinite-World: Scaling Interactive World Models to 1000-Frame Horizons via Pose-Free Hierarchical Memory

作者: Ruiqi Wu, Xuanhua He, Meng Cheng, Tianyu Yang, Yong Zhang, Zhuoliang Kang, Xunliang Cai, Xiaoming Wei, Chunle Guo, Chongyi Li, Ming-Ming Cheng

分类: cs.CV, cs.AI

发布日期: 2026-02-02

备注: 14 pages, 8 figures

💡 一句话要点

Infinite-World:通过无姿态分层记忆将交互式世界模型扩展到1000帧

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 世界模型 长时记忆 分层记忆压缩 无姿态估计 交互式环境

📋 核心要点

- 现有世界模型在真实场景中受限于噪声姿态估计和视点重访稀疏,难以维持长时连贯性。

- 提出分层无姿态记忆压缩器(HPMC),递归提炼历史信息,无需显式几何先验即可实现长时记忆。

- 引入不确定性感知动作标记,将连续动作离散化,提升动作-响应学习的鲁棒性,并结合重访密集微调策略。

📝 摘要(中文)

我们提出了Infinite-World,一个强大的交互式世界模型,能够在复杂的真实世界环境中维持超过1000帧的连贯视觉记忆。现有的世界模型虽然可以在具有完美ground-truth的合成数据上高效优化,但由于噪声姿态估计和视点重访的稀缺性,它们缺乏针对真实世界视频的有效训练范式。为了弥合这一差距,我们首先引入了一种分层无姿态记忆压缩器(HPMC),它以递归方式将历史潜在变量提炼成固定预算的表示。通过将压缩器与生成骨干网络联合优化,HPMC使模型能够以有界的计算成本自主地将生成锚定在遥远的过去,从而消除了对显式几何先验的需求。其次,我们提出了一种不确定性感知动作标记模块,该模块将连续运动离散化为三态逻辑。这种策略最大限度地利用原始视频数据,同时保护确定性动作空间免受噪声轨迹的破坏,确保了鲁棒的动作-响应学习。此外,在初步玩具研究的指导下,我们采用了一种重访密集微调策略,使用紧凑的30分钟数据集来有效地激活模型的长程闭环能力。广泛的实验,包括客观指标和用户研究,表明Infinite-World在视觉质量、动作可控性和空间一致性方面取得了优异的性能。

🔬 方法详解

问题定义:现有世界模型在真实场景中难以维持长时连贯性,主要痛点在于:一是真实视频的姿态估计存在噪声,二是视点重访的数据稀疏,导致模型难以学习到长程依赖关系。这些问题限制了世界模型在真实交互环境中的应用。

核心思路:论文的核心思路是设计一种能够有效压缩和利用历史信息,同时对噪声具有鲁棒性的世界模型。通过分层记忆压缩,模型能够将长时信息编码到固定维度的潜在空间中,并利用不确定性感知的动作标记来提高动作预测的准确性。

技术框架:Infinite-World模型主要包含三个模块:1) 分层无姿态记忆压缩器(HPMC):用于递归地压缩历史潜在变量,形成固定预算的记忆表示。2) 生成骨干网络:利用压缩后的记忆和当前动作生成下一帧图像。3) 不确定性感知动作标记模块:将连续动作离散化为三态逻辑,减少噪声的影响。整个流程是,首先使用HPMC压缩历史信息,然后结合当前动作,通过生成骨干网络预测下一帧,并使用不确定性感知动作标记模块来提高动作预测的准确性。

关键创新:最重要的技术创新点在于分层无姿态记忆压缩器(HPMC)。与现有方法依赖于显式几何先验不同,HPMC通过联合优化压缩器和生成骨干网络,使模型能够自主地学习如何将生成锚定在遥远的过去,从而消除了对精确姿态估计的依赖。此外,不确定性感知动作标记模块也是一个重要的创新,它提高了动作预测的鲁棒性。

关键设计:HPMC采用递归结构,每一层都将上一层的潜在表示进行压缩,最终形成固定维度的记忆表示。生成骨干网络可以使用各种图像生成模型,例如VAE或GAN。不确定性感知动作标记模块将连续动作离散化为三个状态(例如,前进、后退、停止),并使用交叉熵损失函数进行训练。重访密集微调策略使用少量数据来激活模型的长程闭环能力。

🖼️ 关键图片

📊 实验亮点

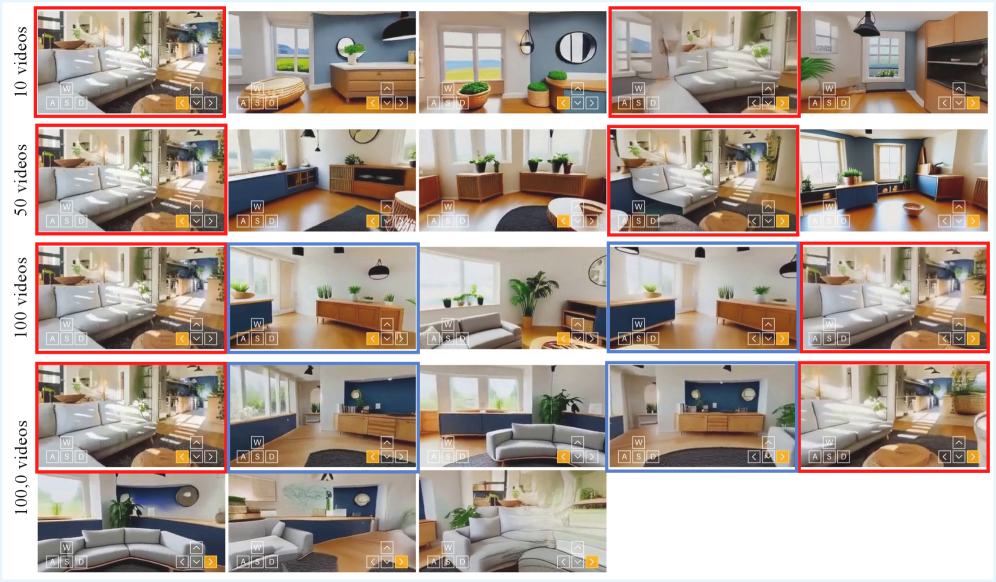

实验结果表明,Infinite-World在视觉质量、动作可控性和空间一致性方面均优于现有方法。通过客观指标和用户研究,证明了该模型能够维持超过1000帧的连贯视觉记忆,并能够有效地响应用户的动作指令。重访密集微调策略仅使用30分钟的数据集,即可显著提升模型的长程闭环能力。

🎯 应用场景

Infinite-World具有广泛的应用前景,包括机器人导航、自动驾驶、游戏AI和虚拟现实等领域。该模型能够帮助机器人在复杂环境中进行长期规划和决策,提高其自主性和适应性。此外,该模型还可以用于生成逼真的虚拟环境,为用户提供沉浸式的交互体验。

📄 摘要(原文)

We propose Infinite-World, a robust interactive world model capable of maintaining coherent visual memory over 1000+ frames in complex real-world environments. While existing world models can be efficiently optimized on synthetic data with perfect ground-truth, they lack an effective training paradigm for real-world videos due to noisy pose estimations and the scarcity of viewpoint revisits. To bridge this gap, we first introduce a Hierarchical Pose-free Memory Compressor (HPMC) that recursively distills historical latents into a fixed-budget representation. By jointly optimizing the compressor with the generative backbone, HPMC enables the model to autonomously anchor generations in the distant past with bounded computational cost, eliminating the need for explicit geometric priors. Second, we propose an Uncertainty-aware Action Labeling module that discretizes continuous motion into a tri-state logic. This strategy maximizes the utilization of raw video data while shielding the deterministic action space from being corrupted by noisy trajectories, ensuring robust action-response learning. Furthermore, guided by insights from a pilot toy study, we employ a Revisit-Dense Finetuning Strategy using a compact, 30-minute dataset to efficiently activate the model's long-range loop-closure capabilities. Extensive experiments, including objective metrics and user studies, demonstrate that Infinite-World achieves superior performance in visual quality, action controllability, and spatial consistency.