Real-Time 2D LiDAR Object Detection Using Three-Frame RGB Scan Encoding

作者: Soheil Behnam Roudsari, Alexandre S. Brandão, Felipe N. Martins

分类: eess.SP, cs.CV, cs.LG, cs.RO

发布日期: 2026-02-02

备注: 6 pages, 6 figures, submitted to IEEE SAS 2026

💡 一句话要点

提出基于三帧RGB扫描编码的实时2D激光雷达目标检测方法,适用于室内服务机器人。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 2D激光雷达 目标检测 时间编码 嵌入式系统 室内机器人 YOLOv8 实时性 隐私保护

📋 核心要点

- 现有方法在嵌入式硬件上进行鲁棒、隐私友好的室内机器人感知方面存在挑战,尤其是在计算资源受限的情况下。

- 该论文提出一种新颖的2D激光雷达目标检测方法,通过将连续三帧扫描编码为RGB图像,有效利用了时间上下文信息。

- 实验结果表明,该方法在保持高检测精度的同时,显著降低了端到端延迟,并在嵌入式设备上实现了实时性能。

📝 摘要(中文)

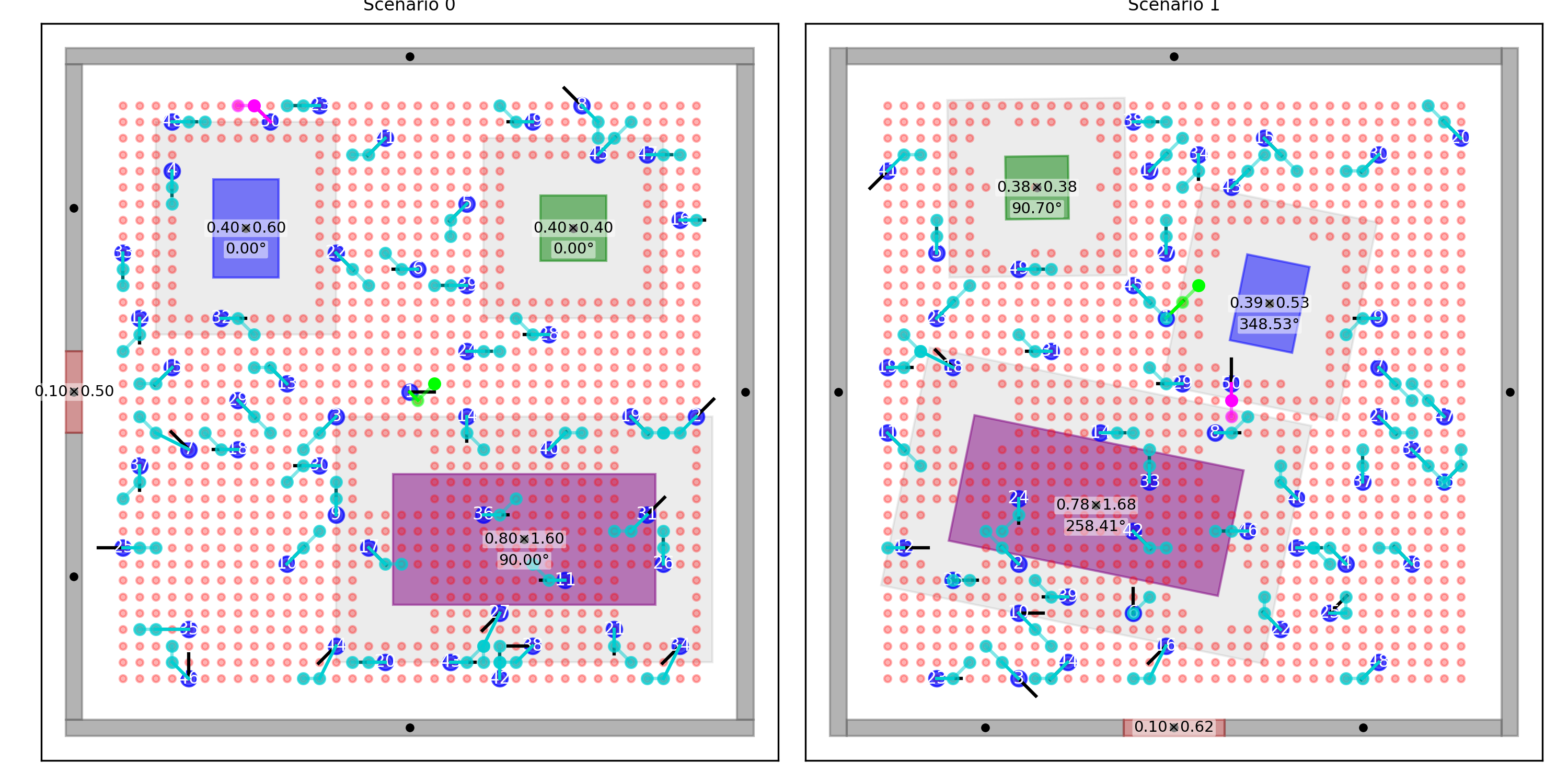

本文提出了一种无需摄像头、基于2D激光雷达的目标检测流程,适用于室内服务机器人。该流程通过堆叠三个连续扫描帧作为RGB通道来编码短期时间上下文,生成紧凑的YOLOv8n输入,无需构建占据栅格,同时保留了角度结构和运动线索。在Webots中,通过160个随机室内场景进行评估,并采用严格的场景级留出法,该方法在四个目标类别上实现了98.4%的mAP@0.5(0.778 mAP@0.5:0.95),精度为94.9%,召回率为94.7%。在Raspberry Pi 5上,该方法以平均47.8ms/帧的端到端延迟(包括扫描编码和后处理)实时运行。相对于在同一平台上报告的密切相关的占据栅格LiDAR-YOLO流程,所提出的表示方法具有显著更低的端到端延迟。虽然结果基于仿真,但表明轻量级时间编码可以实现精确和实时的纯激光雷达检测,适用于嵌入式室内机器人,而无需捕获RGB外观。

🔬 方法详解

问题定义:现有基于激光雷达的室内机器人目标检测方法,通常需要构建占据栅格,计算复杂度高,难以在嵌入式硬件上实现实时性。此外,一些方法依赖RGB图像,存在隐私泄露的风险。因此,如何在计算资源有限的情况下,实现鲁棒、隐私友好的实时目标检测是一个关键问题。

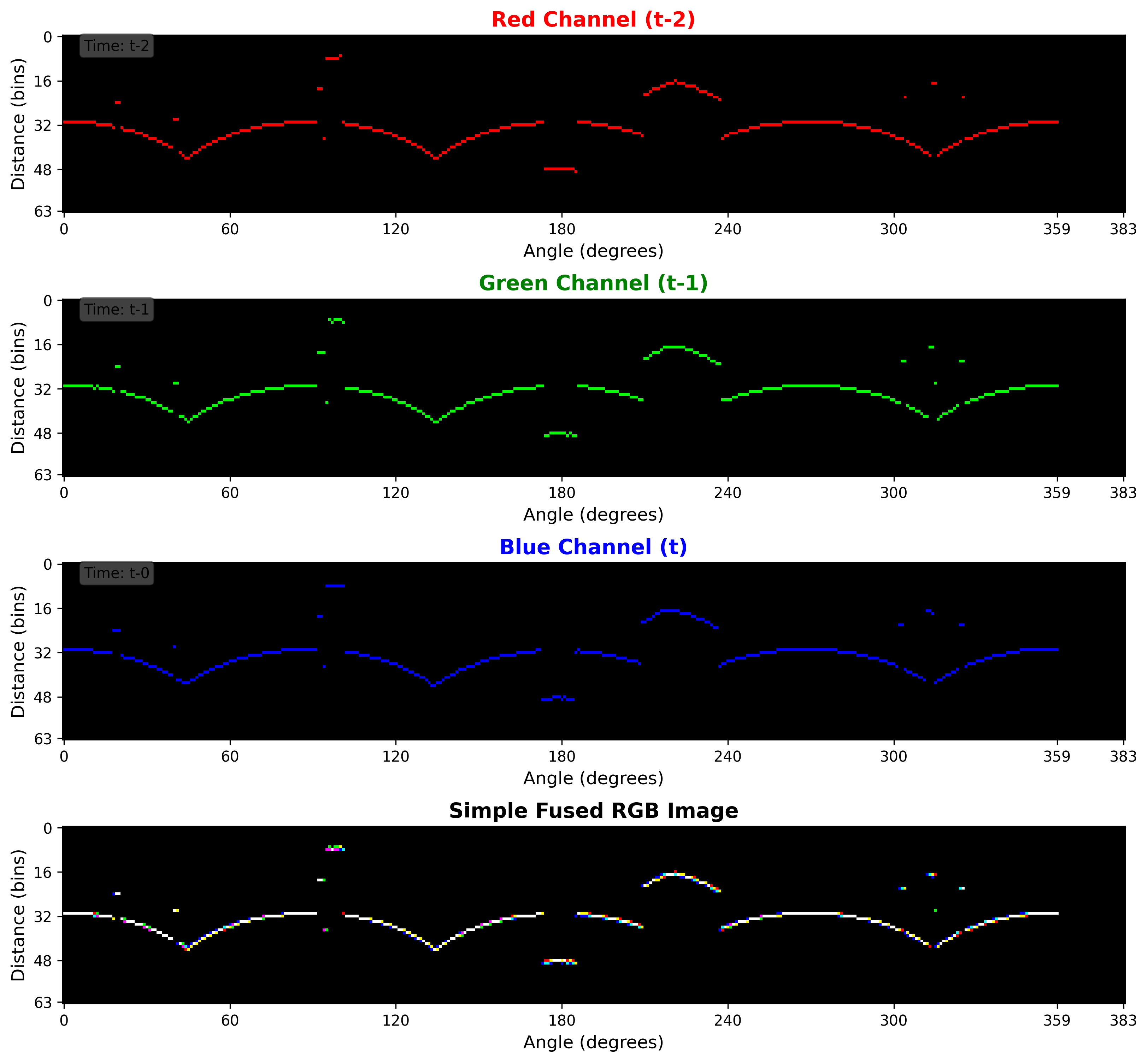

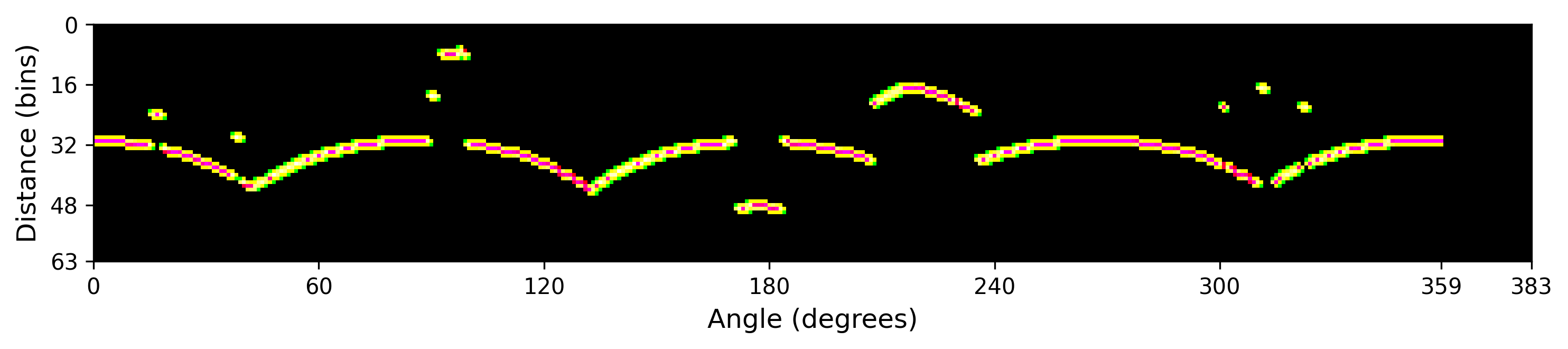

核心思路:该论文的核心思路是将连续的三帧激光雷达扫描数据编码为RGB图像,利用图像处理领域成熟的卷积神经网络进行目标检测。通过这种方式,既保留了激光雷达数据的角度结构和运动信息,又避免了构建占据栅格带来的计算负担。同时,由于不使用RGB图像,也保护了用户隐私。

技术框架:该方法主要包含两个阶段:扫描编码阶段和目标检测阶段。在扫描编码阶段,将连续的三帧激光雷达扫描数据分别作为RGB三个通道的值,形成一幅“RGB图像”。在目标检测阶段,将该“RGB图像”输入到YOLOv8n模型中进行目标检测,并进行后处理以获得最终的检测结果。

关键创新:该方法最重要的创新点在于提出了三帧RGB扫描编码的方式,将时间上下文信息融入到激光雷达数据中,从而提高了目标检测的精度和鲁棒性。与传统的占据栅格方法相比,该方法计算复杂度更低,更适合在嵌入式硬件上部署。此外,该方法无需使用RGB图像,保护了用户隐私。

关键设计:该方法使用YOLOv8n作为目标检测模型,这是一个轻量级的目标检测模型,适合在资源受限的设备上运行。在扫描编码阶段,需要对激光雷达数据进行归一化处理,以保证数据的范围在0-255之间。此外,还需要对YOLOv8n模型的输入尺寸进行调整,以适应激光雷达数据的分辨率。

🖼️ 关键图片

📊 实验亮点

该方法在Webots仿真环境中进行了评估,在四个目标类别上实现了98.4%的mAP@0.5,精度为94.9%,召回率为94.7%。在Raspberry Pi 5上,该方法以平均47.8ms/帧的端到端延迟实时运行。与基于占据栅格的LiDAR-YOLO方法相比,该方法显著降低了端到端延迟,表明了其在嵌入式平台上的实用性。

🎯 应用场景

该研究成果可广泛应用于室内服务机器人领域,例如清洁机器人、送餐机器人、导览机器人等。该方法能够在计算资源有限的嵌入式平台上实现实时、精确的目标检测,提高机器人的自主导航和交互能力。此外,由于不依赖RGB图像,该方法也适用于对隐私保护有较高要求的场景。

📄 摘要(原文)

Indoor service robots need perception that is robust, more privacy-friendly than RGB video, and feasible on embedded hardware. We present a camera-free 2D LiDAR object detection pipeline that encodes short-term temporal context by stacking three consecutive scans as RGB channels, yielding a compact YOLOv8n input without occupancy-grid construction while preserving angular structure and motion cues. Evaluated in Webots across 160 randomized indoor scenarios with strict scenario-level holdout, the method achieves 98.4% mAP@0.5 (0.778 mAP@0.5:0.95) with 94.9% precision and 94.7% recall on four object classes. On a Raspberry Pi 5, it runs in real time with a mean post-warm-up end-to-end latency of 47.8ms per frame, including scan encoding and postprocessing. Relative to a closely related occupancy-grid LiDAR-YOLO pipeline reported on the same platform, the proposed representation is associated with substantially lower reported end-to-end latency. Although results are simulation-based, they suggest that lightweight temporal encoding can enable accurate and real-time LiDAR-only detection for embedded indoor robotics without capturing RGB appearance.