UrbanGS: A Scalable and Efficient Architecture for Geometrically Accurate Large-Scene Reconstruction

作者: Changbai Li, Haodong Zhu, Hanlin Chen, Xiuping Liang, Tongfei Chen, Shuwei Shao, Linlin Yang, Huobin Tan, Baochang Zhang

分类: cs.CV

发布日期: 2026-02-02

备注: ICLR 2026

💡 一句话要点

UrbanGS:面向城市级场景,兼顾几何精度、效率与可扩展性的三维重建框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting)

关键词: 三维重建 高斯溅射 城市建模 几何精度 大规模场景

📋 核心要点

- 现有3DGS方法在大型城市环境中面临几何一致性差、内存效率低和计算量大等挑战。

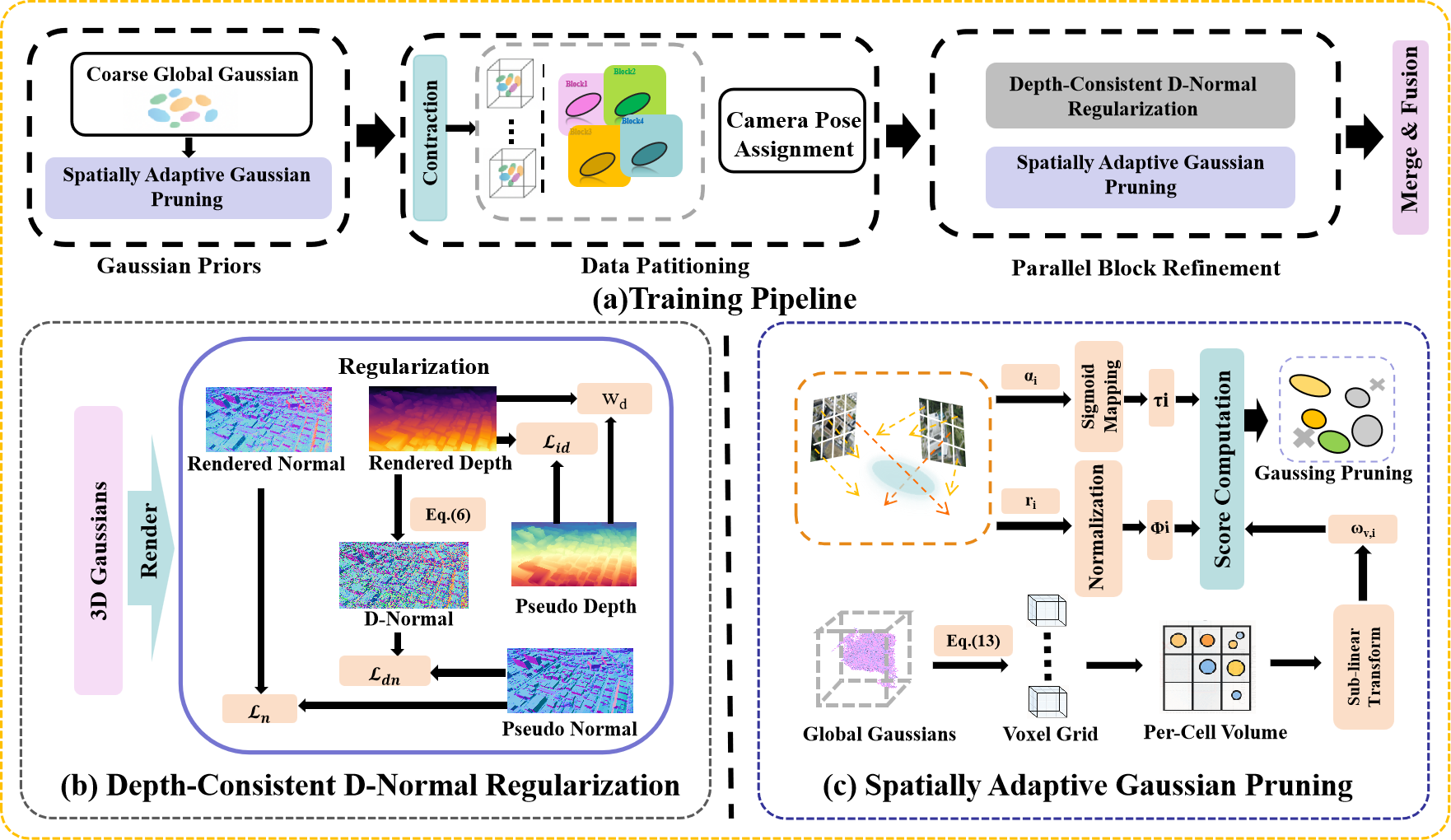

- UrbanGS通过深度一致的D-Normal正则化、空间自适应高斯剪枝和统一的分区视图分配方案来解决上述问题。

- 实验结果表明,UrbanGS在渲染质量、几何精度和内存效率方面均优于现有方法,实现了城市级场景的高保真重建。

📝 摘要(中文)

本文提出UrbanGS,一个可扩展的重建框架,旨在解决3D高斯溅射(3DGS)扩展到大型城市环境时面临的几何一致性、内存效率和计算可扩展性等关键挑战。首先,提出了深度一致的D-Normal正则化模块,该模块结合了D-Normal约束与外部深度监督,实现了对所有几何参数的全面更新,并通过自适应置信度加权机制,显著增强了多视图深度对齐和几何一致性。其次,引入了空间自适应高斯剪枝(SAGP)策略,根据局部几何复杂度和可见性动态调整高斯密度,减少冗余。此外,设计了统一的分区和视图分配方案,消除了边界伪影并优化了计算负载。在多个城市数据集上的实验表明,UrbanGS在渲染质量、几何精度和内存效率方面均优于现有方法,为高保真大规模场景重建提供了一个系统性的解决方案。

🔬 方法详解

问题定义:现有基于3D高斯溅射的方法在处理大规模城市场景时,由于场景的复杂性和规模,容易出现几何不一致的问题,尤其是在位置参数的更新上效果不佳。同时,高斯数量庞大导致内存占用过高,计算效率低下,难以扩展到城市级别。

核心思路:UrbanGS的核心思路是通过引入深度信息来约束高斯参数的更新,提高几何一致性;通过空间自适应的高斯剪枝策略来减少冗余高斯,提高内存效率;并通过统一的分区和视图分配方案来优化计算负载,提高计算效率。这样,就能在保证几何精度的前提下,实现大规模场景的高效重建。

技术框架:UrbanGS框架主要包含三个核心模块:1) 深度一致的D-Normal正则化模块,用于提高几何一致性;2) 空间自适应高斯剪枝(SAGP)策略,用于减少冗余高斯;3) 统一的分区和视图分配方案,用于优化计算负载。整个流程首先使用D-Normal正则化模块优化高斯参数,然后使用SAGP策略进行高斯剪枝,最后使用统一的分区和视图分配方案进行渲染。

关键创新:UrbanGS的关键创新在于深度一致的D-Normal正则化模块和空间自适应高斯剪枝策略。D-Normal正则化模块结合了D-Normal约束与外部深度监督,能够更全面地更新高斯参数,提高几何一致性。SAGP策略能够根据局部几何复杂度和可见性动态调整高斯密度,有效减少冗余高斯,提高内存效率。与现有方法相比,UrbanGS能够更好地处理大规模城市场景的重建问题。

关键设计:D-Normal正则化模块中,使用了自适应置信度加权机制,该机制基于梯度一致性和逆深度偏差来调整不同视图的权重,从而提高多视图深度对齐的精度。SAGP策略中,高斯密度的调整是基于局部几何复杂度和可见性的,具体实现方式未知。统一的分区和视图分配方案的具体实现细节未知,但其目标是消除边界伪影并优化计算负载。

🖼️ 关键图片

📊 实验亮点

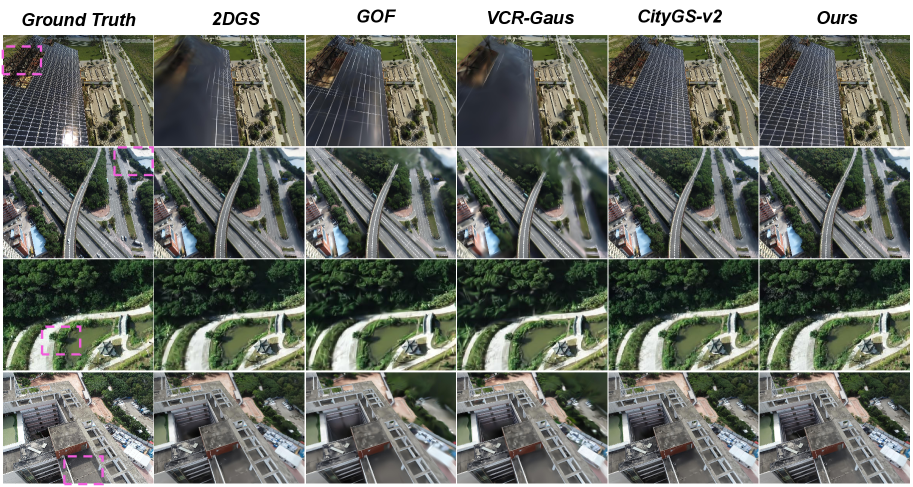

UrbanGS在多个城市数据集上进行了实验,结果表明,该方法在渲染质量、几何精度和内存效率方面均优于现有方法。具体性能数据未知,但论文强调UrbanGS为高保真大规模场景重建提供了一个系统性的解决方案,解决了现有方法在大规模场景中面临的挑战。

🎯 应用场景

UrbanGS技术可广泛应用于智慧城市建设、自动驾驶、虚拟现实、城市规划、游戏开发等领域。通过高精度、高效率地重建城市三维模型,可以为这些应用提供强大的数据支撑,例如,自动驾驶可以利用重建的三维地图进行精准定位和导航,城市规划可以利用三维模型进行可视化分析和模拟。

📄 摘要(原文)

While 3D Gaussian Splatting (3DGS) enables high-quality, real-time rendering for bounded scenes, its extension to large-scale urban environments gives rise to critical challenges in terms of geometric consistency, memory efficiency, and computational scalability. To address these issues, we present UrbanGS, a scalable reconstruction framework that effectively tackles these challenges for city-scale applications. First, we propose a Depth-Consistent D-Normal Regularization module. Unlike existing approaches that rely solely on monocular normal estimators, which can effectively update rotation parameters yet struggle to update position parameters, our method integrates D-Normal constraints with external depth supervision. This allows for comprehensive updates of all geometric parameters. By further incorporating an adaptive confidence weighting mechanism based on gradient consistency and inverse depth deviation, our approach significantly enhances multi-view depth alignment and geometric coherence, which effectively resolves the issue of geometric accuracy in complex large-scale scenes. To improve scalability, we introduce a Spatially Adaptive Gaussian Pruning (SAGP) strategy, which dynamically adjusts Gaussian density based on local geometric complexity and visibility to reduce redundancy. Additionally, a unified partitioning and view assignment scheme is designed to eliminate boundary artifacts and optimize computational load. Extensive experiments on multiple urban datasets demonstrate that UrbanGS achieves superior performance in rendering quality, geometric accuracy, and memory efficiency, providing a systematic solution for high-fidelity large-scale scene reconstruction.