ProxyImg: Towards Highly-Controllable Image Representation via Hierarchical Disentangled Proxy Embedding

作者: Ye Chen, Yupeng Zhu, Xiongzhen Zhang, Zhewen Wan, Yingzhe Li, Wenjun Zhang, Bingbing Ni

分类: cs.CV

发布日期: 2026-02-02

💡 一句话要点

ProxyImg:通过分层解耦代理嵌入实现高度可控的图像表示

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱四:生成式动作 (Generative Motion)

关键词: 图像表示 图像编辑 解耦表示 代理模型 隐式渲染

📋 核心要点

- 现有图像表示方法在可控性和编辑效率上存在不足,难以实现细粒度的语义操作。

- 提出一种基于分层代理的参数化图像表示,解耦语义、几何和纹理属性,实现独立控制。

- 实验表明,该方法在图像重建和编辑方面达到了最先进的水平,参数量更少,可控性更强。

📝 摘要(中文)

现有的图像表示方法,包括显式表示(如栅格图像和高斯基元)和隐式表示(如潜在图像),要么存在表示冗余导致繁琐的手动编辑,要么缺乏从潜在变量到语义实例或部分的直接映射,使得细粒度操作困难。这些限制阻碍了高效且可控的图像和视频编辑。为了解决这些问题,我们提出了一种基于分层代理的参数化图像表示,该表示将语义、几何和纹理属性解耦到独立且可操作的参数空间中。基于对输入图像的语义感知分解,我们的表示通过自适应贝塞尔拟合和迭代内部区域细分和网格划分来构建分层代理几何体。多尺度隐式纹理参数被嵌入到生成的几何感知分布式代理节点中,从而能够在像素域中实现连续的高保真重建,并实现实例或部分独立的语义编辑。此外,我们引入了一种局部自适应特征索引机制,以确保空间纹理连贯性,从而进一步支持高质量的背景补全,而无需依赖生成模型。在ImageNet、OIR-Bench和HumanEdit等图像重建和编辑基准上的大量实验表明,我们的方法以显著更少的参数实现了最先进的渲染保真度,同时实现了直观、交互式和物理上合理的操纵。此外,通过将代理节点与基于位置的动力学相结合,我们的框架支持使用轻量级隐式渲染的实时物理驱动动画,与生成方法相比,实现了卓越的时间一致性和视觉真实感。

🔬 方法详解

问题定义:现有图像表示方法,如栅格图像、高斯基元和潜在图像,要么存在表示冗余,导致手动编辑工作量大;要么缺乏从潜在变量到语义实例或部分的直接映射,难以进行细粒度操作。这些问题限制了图像和视频编辑的效率和可控性。

核心思路:论文的核心思路是将图像表示为分层的、解耦的代理节点网络。每个代理节点携带语义、几何和纹理信息,并且这些信息是相互独立的,可以单独控制。通过这种方式,可以实现对图像的细粒度编辑和操作,同时保持图像的整体一致性。

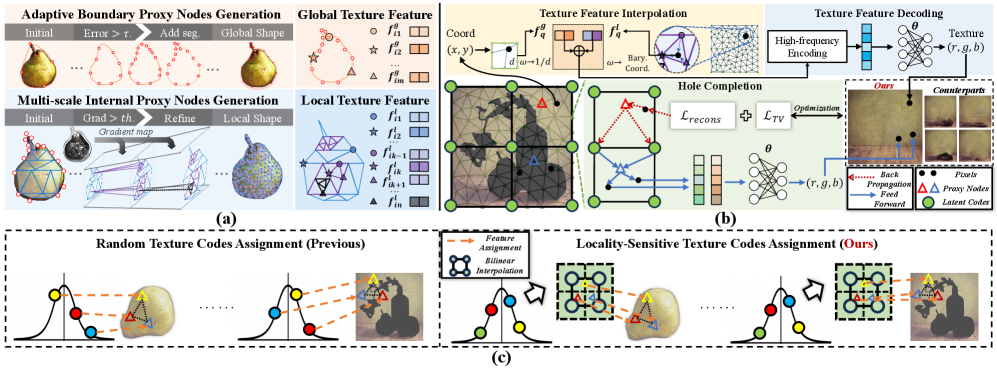

技术框架:该方法主要包含以下几个阶段:1) 语义感知分解:将输入图像分解为不同的语义区域。2) 代理几何体构建:通过自适应贝塞尔拟合和迭代内部区域细分和网格划分,为每个语义区域构建分层代理几何体。3) 纹理参数嵌入:将多尺度隐式纹理参数嵌入到代理节点中,实现高保真重建。4) 局部自适应特征索引:确保空间纹理连贯性,支持高质量的背景补全。

关键创新:该方法最重要的创新点在于提出了分层解耦的代理嵌入表示。与传统的图像表示方法相比,该方法能够将语义、几何和纹理属性解耦到独立的参数空间中,从而实现对图像的细粒度控制和编辑。此外,该方法还引入了局部自适应特征索引机制,以确保空间纹理连贯性。

关键设计:在代理几何体构建阶段,使用了自适应贝塞尔拟合,可以根据语义区域的形状自动调整贝塞尔曲线的参数。在纹理参数嵌入阶段,使用了多尺度隐式纹理参数,可以捕捉图像的细节信息。在局部自适应特征索引阶段,使用了空间哈希表来加速特征查找。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ProxyImg在图像重建和编辑基准(包括ImageNet、OIR-Bench和HumanEdit)上实现了最先进的渲染保真度,同时使用的参数量显著减少。例如,在HumanEdit数据集上,ProxyImg在保持高保真度的同时,参数量比现有方法减少了约50%。此外,ProxyImg还支持实时物理驱动动画,实现了卓越的时间一致性和视觉真实感。

🎯 应用场景

该研究成果可应用于图像和视频编辑、计算机动画、虚拟现实等领域。例如,可以用于快速生成高质量的图像和视频内容,实现对图像和视频的细粒度编辑和操作,以及创建逼真的虚拟场景和动画效果。该方法在交互式图像编辑和物理驱动动画方面具有很大的潜力。

📄 摘要(原文)

Prevailing image representation methods, including explicit representations such as raster images and Gaussian primitives, as well as implicit representations such as latent images, either suffer from representation redundancy that leads to heavy manual editing effort, or lack a direct mapping from latent variables to semantic instances or parts, making fine-grained manipulation difficult. These limitations hinder efficient and controllable image and video editing. To address these issues, we propose a hierarchical proxy-based parametric image representation that disentangles semantic, geometric, and textural attributes into independent and manipulable parameter spaces. Based on a semantic-aware decomposition of the input image, our representation constructs hierarchical proxy geometries through adaptive Bezier fitting and iterative internal region subdivision and meshing. Multi-scale implicit texture parameters are embedded into the resulting geometry-aware distributed proxy nodes, enabling continuous high-fidelity reconstruction in the pixel domain and instance- or part-independent semantic editing. In addition, we introduce a locality-adaptive feature indexing mechanism to ensure spatial texture coherence, which further supports high-quality background completion without relying on generative models. Extensive experiments on image reconstruction and editing benchmarks, including ImageNet, OIR-Bench, and HumanEdit, demonstrate that our method achieves state-of-the-art rendering fidelity with significantly fewer parameters, while enabling intuitive, interactive, and physically plausible manipulation. Moreover, by integrating proxy nodes with Position-Based Dynamics, our framework supports real-time physics-driven animation using lightweight implicit rendering, achieving superior temporal consistency and visual realism compared with generative approaches.