GPD: Guided Progressive Distillation for Fast and High-Quality Video Generation

作者: Xiao Liang, Yunzhu Zhang, Linchao Zhu

分类: cs.CV

发布日期: 2026-02-02

💡 一句话要点

提出引导式渐进蒸馏(GPD)框架,加速高质量视频生成扩散模型。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 视频生成 扩散模型 模型蒸馏 加速算法 频域约束

📋 核心要点

- 视频生成扩散模型计算成本高昂,限制了其应用,减少采样步骤是关键挑战。

- GPD框架通过教师模型引导学生模型,使用更大步长进行蒸馏,加速扩散过程。

- GPD在Wan2.1模型上将采样步骤从48降至6,并在VBench上保持了竞争力的视觉质量。

📝 摘要(中文)

扩散模型在视频生成领域取得了显著成功,但去噪过程的高计算成本仍然是一个主要瓶颈。现有方法在减少扩散步骤数量方面显示出潜力,但应用于视频生成时,通常会遭受显著的质量下降。我们提出了引导式渐进蒸馏(GPD),这是一个加速扩散过程以实现快速和高质量视频生成的框架。GPD引入了一种新颖的训练策略,其中教师模型逐步引导学生模型以更大的步长运行。该框架包含两个关键组成部分:(1)在线生成的训练目标,可降低优化难度,同时提高计算效率;(2)潜在空间中的频域约束,可促进对细粒度细节和时间动态的保留。应用于Wan2.1模型,GPD将采样步骤数从48减少到6,同时在VBench上保持了具有竞争力的视觉质量。与现有的蒸馏方法相比,GPD在流程简单性和质量保持方面均表现出明显的优势。

🔬 方法详解

问题定义:视频生成领域中,扩散模型虽然效果显著,但其高昂的计算成本,特别是去噪过程,严重限制了其应用。现有加速方法,如减少扩散步骤,往往导致生成视频质量显著下降,无法满足实际需求。因此,如何在保证视频质量的前提下,显著降低扩散模型的计算复杂度,是本文要解决的核心问题。

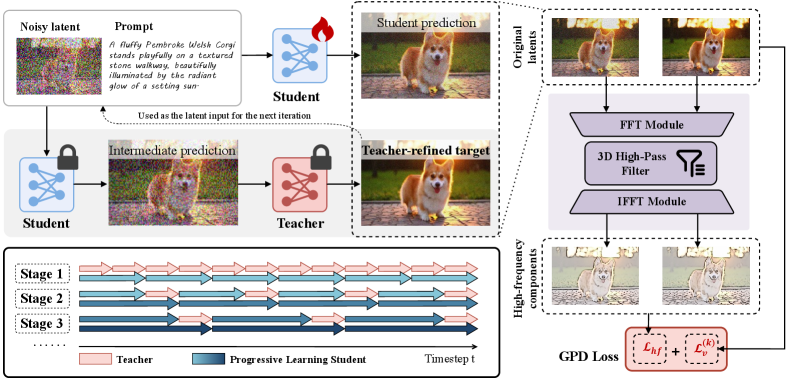

核心思路:本文的核心思路是利用蒸馏技术,将一个训练好的教师扩散模型的知识迁移到一个更小的学生模型上,使得学生模型能够以更少的采样步骤生成高质量的视频。为了克服传统蒸馏方法在视频生成中质量下降的问题,本文提出了“引导式渐进蒸馏”(Guided Progressive Distillation, GPD)框架,通过逐步引导的方式,让学生模型适应更大的步长,从而加速生成过程。

技术框架:GPD框架主要包含两个关键组成部分:1) 在线生成的训练目标:不同于传统的离线蒸馏,GPD采用在线生成训练目标的方式,即在训练过程中动态生成目标,从而降低优化难度,提高计算效率。2) 频域约束:为了保证生成视频的细节和时间动态,GPD在潜在空间中引入了频域约束,鼓励学生模型保留高频信息,从而提升生成视频的质量。整体训练流程是,教师模型以较小的步长生成目标,然后学生模型学习以更大的步长逼近教师模型生成的目标,并通过频域约束保证细节和时间动态。

关键创新:GPD的关键创新在于其渐进式的蒸馏策略和频域约束。传统的蒸馏方法通常直接让学生模型学习教师模型的输出,这在视频生成任务中容易导致质量下降。GPD通过渐进的方式,逐步增加学生模型的步长,使其更容易适应。同时,频域约束的引入,有效地保证了生成视频的细节和时间动态,这是现有蒸馏方法所缺乏的。

关键设计:GPD的关键设计包括:1) 在线训练目标生成:具体如何动态生成训练目标,例如,可以使用教师模型在不同噪声水平下的预测结果作为学生模型的训练目标。2) 频域约束的具体形式:例如,可以使用傅里叶变换将潜在表示转换到频域,然后计算教师模型和学生模型在频域上的差异,作为损失函数的一部分。3) 渐进式步长增加策略:如何逐步增加学生模型的步长,例如,可以采用线性或指数方式增加步长,并根据训练效果进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GPD框架在Wan2.1模型上将采样步骤从48减少到6,同时在VBench基准测试上保持了具有竞争力的视觉质量。与现有的蒸馏方法相比,GPD在流程简单性和质量保持方面均表现出明显的优势,验证了其有效性。

🎯 应用场景

GPD框架可应用于各种需要快速视频生成的场景,例如实时视频编辑、游戏AI、虚拟现实内容生成等。通过降低计算成本,使得在资源受限的设备上进行高质量视频生成成为可能。未来,该技术有望推动视频生成在移动设备和边缘计算平台上的普及。

📄 摘要(原文)

Diffusion models have achieved remarkable success in video generation; however, the high computational cost of the denoising process remains a major bottleneck. Existing approaches have shown promise in reducing the number of diffusion steps, but they often suffer from significant quality degradation when applied to video generation. We propose Guided Progressive Distillation (GPD), a framework that accelerates the diffusion process for fast and high-quality video generation. GPD introduces a novel training strategy in which a teacher model progressively guides a student model to operate with larger step sizes. The framework consists of two key components: (1) an online-generated training target that reduces optimization difficulty while improving computational efficiency, and (2) frequency-domain constraints in the latent space that promote the preservation of fine-grained details and temporal dynamics. Applied to the Wan2.1 model, GPD reduces the number of sampling steps from 48 to 6 while maintaining competitive visual quality on VBench. Compared with existing distillation methods, GPD demonstrates clear advantages in both pipeline simplicity and quality preservation.