Simplicity Prevails: The Emergence of Generalizable AIGI Detection in Visual Foundation Models

作者: Yue Zhou, Xinan He, Kaiqing Lin, Bing Fan, Feng Ding, Bin Li

分类: cs.CV

发布日期: 2026-02-02

💡 一句话要点

利用视觉基础模型,通过简单线性分类器实现通用人工智能生成图像检测,显著提升泛化性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人工智能生成图像检测 视觉基础模型 线性分类器 泛化能力 自监督学习

📋 核心要点

- 现有AIGI检测器在特定数据集表现良好,但在真实场景中泛化能力差,性能大幅下降。

- 论文提出利用视觉基础模型提取特征,并用简单线性分类器进行AIGI检测,提升泛化能力。

- 实验表明,该方法在野外数据集上显著优于专用检测器,准确率提升超过30%。

📝 摘要(中文)

尽管针对人工智能生成图像(AIGI)的专用检测器在精心设计的基准测试中能达到近乎完美的准确率,但在真实的、野外场景中,它们的性能会急剧下降。本文表明,简单性胜过复杂的架构设计。一个简单的线性分类器,在现代视觉基础模型(包括Perception Encoder、MetaCLIP 2和DINOv3)的冻结特征上进行训练,建立了一个新的技术水平。通过对传统基准、未见过的生成器和具有挑战性的野外分布的全面评估,我们表明,该基线不仅在标准基准上与专用检测器相匹配,而且在野外数据集上明显优于它们,准确率提高了30%以上。我们认为,这种卓越的能力是一种涌现属性,是由包含合成内容的大规模预训练数据驱动的。我们追溯了这种能力的来源,发现数据暴露的两种不同表现形式:视觉-语言模型内化了伪造的显式语义概念,而自监督学习模型则从预训练数据中隐式地获得了可区分的取证特征。然而,我们也揭示了持续存在的局限性:这些模型在重新捕获和传输下性能下降,对VAE重建和局部编辑仍然视而不见。最后,我们提倡人工智能取证的范式转变,从过度拟合静态基准转向利用基础模型不断发展的世界知识,以提高现实世界的可靠性。

🔬 方法详解

问题定义:现有的人工智能生成图像(AIGI)检测方法,特别是那些针对特定生成器或数据集设计的专用检测器,在面对真实世界的、未知的AIGI图像时,泛化能力严重不足。这些方法往往过度拟合于特定的训练数据分布,导致在实际应用中性能急剧下降。因此,需要一种更具鲁棒性和泛化性的AIGI检测方法,能够适应各种生成器和场景。

核心思路:论文的核心思路是利用大规模预训练的视觉基础模型(Vision Foundation Models)所学习到的通用视觉表示,并在此基础上训练一个简单的线性分类器。这种方法假设,视觉基础模型在海量数据上的预训练,使其能够捕捉到AIGI图像中潜在的、与生成过程相关的统计特征或语义信息,从而实现更好的泛化能力。通过冻结预训练模型的参数,并仅训练一个线性分类器,可以避免过度拟合于特定的AIGI数据集。

技术框架:该方法主要包含两个阶段:特征提取和分类。首先,使用预训练的视觉基础模型(如Perception Encoder、MetaCLIP 2和DINOv3)提取输入图像的特征表示。这些模型通常具有强大的视觉理解能力,能够将图像编码成高维特征向量。然后,将提取的特征向量输入到一个简单的线性分类器中进行分类,判断图像是否为AIGI图像。线性分类器的训练目标是最小化分类误差,可以使用标准的优化算法(如梯度下降)进行训练。

关键创新:该方法最重要的创新点在于,它利用了视觉基础模型所学习到的通用视觉表示,避免了从头开始训练复杂的AIGI检测器。这种方法不仅简单有效,而且具有更好的泛化能力,能够适应各种生成器和场景。此外,论文还深入分析了视觉-语言模型和自监督学习模型在AIGI检测中的作用,揭示了数据暴露对模型性能的影响。

关键设计:该方法的关键设计包括:1) 选择合适的视觉基础模型,这些模型需要具有强大的视觉理解能力和良好的泛化性能;2) 冻结预训练模型的参数,避免过度拟合;3) 使用简单的线性分类器,降低模型的复杂度;4) 使用大规模的AIGI数据集进行训练,提高模型的鲁棒性。此外,论文还探讨了不同的特征提取方法和分类器参数对模型性能的影响。

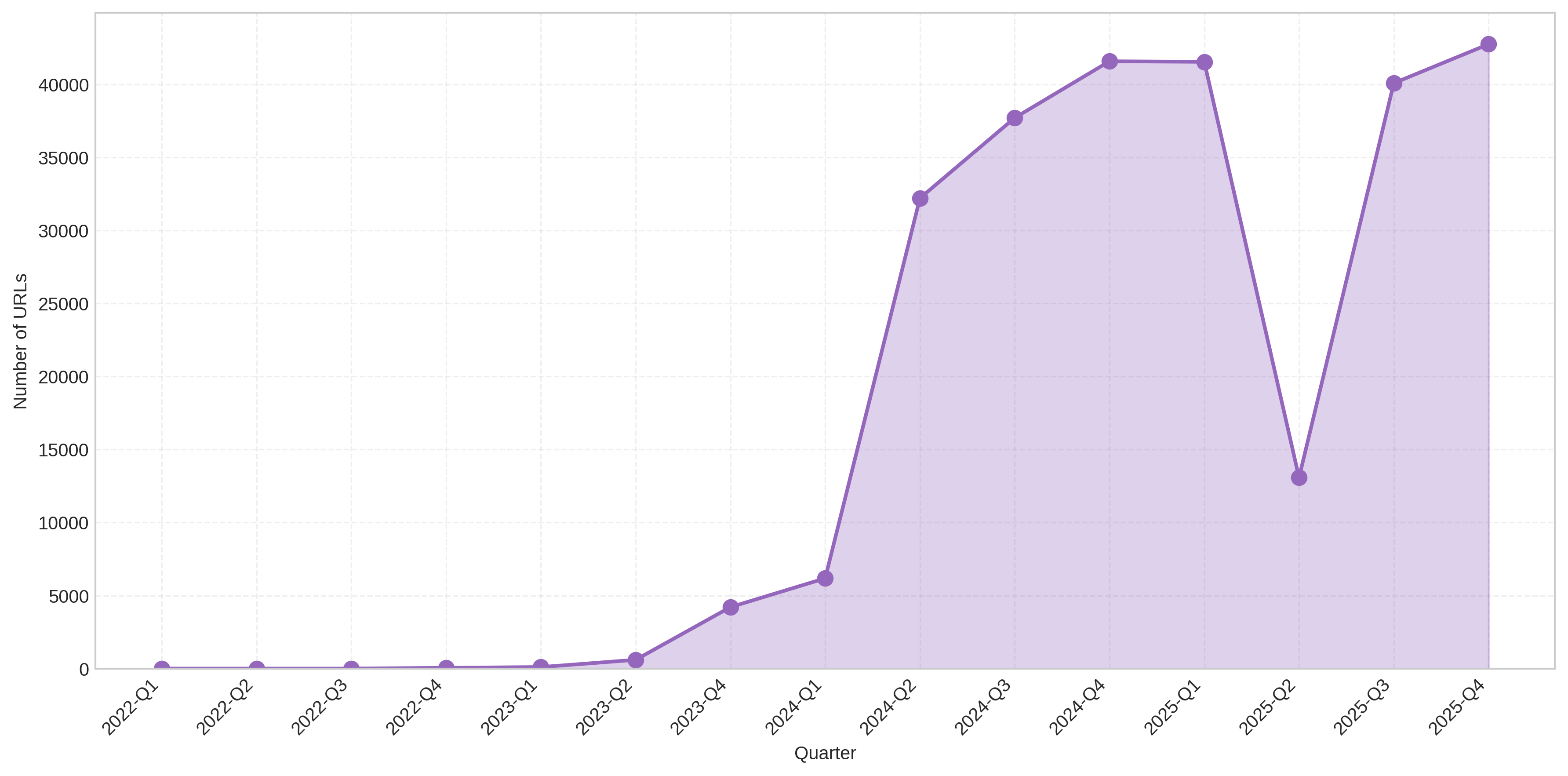

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在野外数据集上显著优于现有的专用AIGI检测器,准确率提升超过30%。即使在传统的基准测试中,该方法也能与专用检测器相媲美。此外,论文还揭示了视觉-语言模型和自监督学习模型在AIGI检测中的作用,为未来的研究提供了新的思路。

🎯 应用场景

该研究成果可应用于内容安全、版权保护、新闻真实性验证等领域。通过检测人工智能生成的图像,可以有效防止虚假信息的传播,维护网络空间的健康秩序。未来,该技术有望集成到各类图像处理软件和在线平台中,实现自动化的AIGI检测。

📄 摘要(原文)

While specialized detectors for AI-Generated Images (AIGI) achieve near-perfect accuracy on curated benchmarks, they suffer from a dramatic performance collapse in realistic, in-the-wild scenarios. In this work, we demonstrate that simplicity prevails over complex architectural designs. A simple linear classifier trained on the frozen features of modern Vision Foundation Models , including Perception Encoder, MetaCLIP 2, and DINOv3, establishes a new state-of-the-art. Through a comprehensive evaluation spanning traditional benchmarks, unseen generators, and challenging in-the-wild distributions, we show that this baseline not only matches specialized detectors on standard benchmarks but also decisively outperforms them on in-the-wild datasets, boosting accuracy by striking margins of over 30\%. We posit that this superior capability is an emergent property driven by the massive scale of pre-training data containing synthetic content. We trace the source of this capability to two distinct manifestations of data exposure: Vision-Language Models internalize an explicit semantic concept of forgery, while Self-Supervised Learning models implicitly acquire discriminative forensic features from the pretraining data. However, we also reveal persistent limitations: these models suffer from performance degradation under recapture and transmission, remain blind to VAE reconstruction and localized editing. We conclude by advocating for a paradigm shift in AI forensics, moving from overfitting on static benchmarks to harnessing the evolving world knowledge of foundation models for real-world reliability.