DenVisCoM: Dense Vision Correspondence Mamba for Efficient and Real-time Optical Flow and Stereo Estimation

作者: Tushar Anand, Maheswar Bora, Antitza Dantcheva, Abhijit Das

分类: cs.CV

发布日期: 2026-02-02

备注: IEEE International Conference on Robotics and Automation 2026

🔗 代码/项目: GITHUB

💡 一句话要点

提出DenVisCoM Mamba模块和混合架构,用于高效实时的光流和立体匹配估计

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 光流估计 立体匹配 Mamba Transformer 实时推理 深度学习 计算机视觉

📋 核心要点

- 现有光流和立体匹配方法难以兼顾精度、实时性和内存占用。

- 提出DenVisCoM Mamba块和混合架构,利用Mamba在序列建模上的优势。

- 实验表明,该模型能在保证精度的前提下,实现光流和视差的实时估计。

📝 摘要(中文)

本文提出了一种新颖的Mamba块DenVisCoM,以及一种专门为精确和实时估计光流和视差而量身定制的混合架构。考虑到这种多视图几何和运动任务从根本上是相关的,我们提出了一个统一的架构来共同解决它们。具体来说,所提出的混合架构基于DenVisCoM和基于Transformer的注意力块,可以有效地解决实时推理、内存占用和准确性问题,同时用于运动和3D密集感知任务的联合估计。我们广泛地分析了大量数据集上准确性和实时处理的基准权衡。我们的实验结果和相关分析表明,我们提出的模型可以实时准确地估计光流和视差。所有模型和相关代码可在https://github.com/vimstereo/DenVisCoM获得。

🔬 方法详解

问题定义:论文旨在解决光流和立体匹配任务中,现有方法难以同时满足高精度、实时性和低内存占用的问题。传统方法或基于卷积神经网络,难以捕捉长距离依赖关系,或基于Transformer,计算复杂度高,难以实时推理。

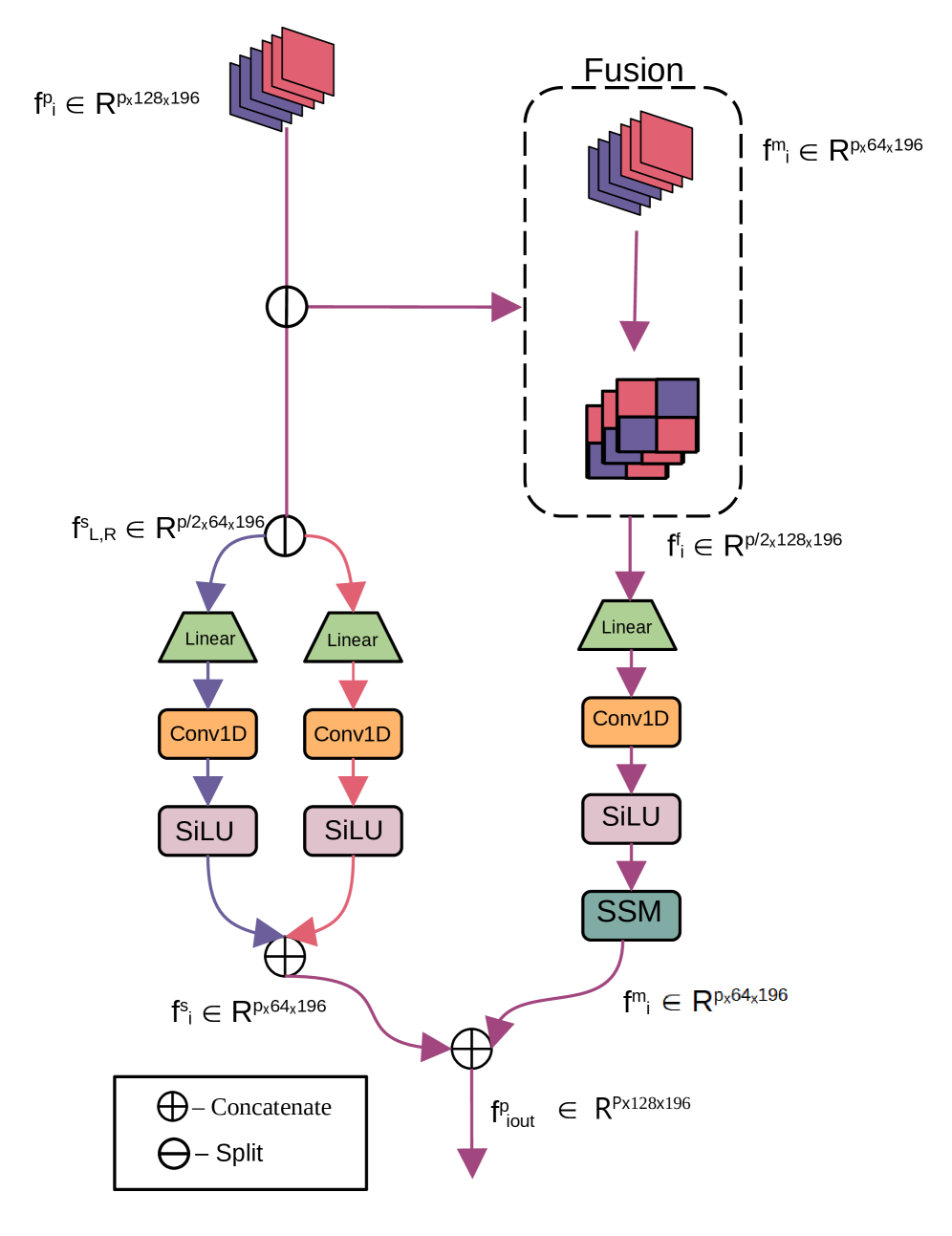

核心思路:论文的核心思路是利用Mamba架构在序列建模方面的优势,设计一种新型的Mamba块DenVisCoM,并将其与Transformer注意力机制相结合,构建一个混合架构。Mamba擅长处理长序列依赖,且计算复杂度较低,Transformer注意力机制则擅长捕捉全局信息。

技术框架:整体架构是一个混合网络,包含以下主要模块:1) 特征提取模块:用于从输入图像中提取特征;2) DenVisCoM模块:用于处理特征序列,捕捉像素之间的长距离依赖关系;3) Transformer注意力模块:用于增强全局上下文信息;4) 光流/视差估计模块:基于提取的特征,估计光流或视差图。该架构可以同时处理光流和视差估计任务。

关键创新:论文的关键创新在于提出了DenVisCoM Mamba块,并将其与Transformer注意力机制相结合。DenVisCoM块的设计充分考虑了光流和视差估计任务的特点,能够有效地捕捉像素之间的依赖关系,同时保持较低的计算复杂度。混合架构的设计使得模型能够兼顾局部和全局信息,提高估计精度。

关键设计:论文中关于DenVisCoM的具体结构和参数设置,以及Transformer注意力模块的配置,损失函数的设计等细节在论文中应该有更详细的描述。这些细节对于复现和进一步研究至关重要。(具体细节未知,需查阅论文)

🖼️ 关键图片

📊 实验亮点

论文通过大量实验验证了所提出方法的有效性。实验结果表明,该模型在多个数据集上实现了与现有方法相当甚至更好的精度,同时显著降低了计算时间和内存占用。具体性能数据、对比基线和提升幅度需要在论文中查找。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、三维重建、视频监控等领域。实时且精确的光流和视差估计对于环境感知和运动规划至关重要。该方法有望提升相关应用在资源受限平台上的性能,例如嵌入式系统和移动设备。

📄 摘要(原文)

In this work, we propose a novel Mamba block DenVisCoM, as well as a novel hybrid architecture specifically tailored for accurate and real-time estimation of optical flow and disparity estimation. Given that such multi-view geometry and motion tasks are fundamentally related, we propose a unified architecture to tackle them jointly. Specifically, the proposed hybrid architecture is based on DenVisCoM and a Transformer-based attention block that efficiently addresses real-time inference, memory footprint, and accuracy at the same time for joint estimation of motion and 3D dense perception tasks. We extensively analyze the benchmark trade-off of accuracy and real-time processing on a large number of datasets. Our experimental results and related analysis suggest that our proposed model can accurately estimate optical flow and disparity estimation in real time. All models and associated code are available at https://github.com/vimstereo/DenVisCoM.