VRGaussianAvatar: Integrating 3D Gaussian Avatars into VR

作者: Hail Song, Boram Yoon, Seokhwan Yang, Seoyoung Kang, Hyunjeong Kim, Henning Metzmacher, Woontack Woo

分类: cs.CV, cs.GR

发布日期: 2026-02-02

备注: Accepted as an IEEE TVCG paper at IEEE VR 2026 (journal track)

💡 一句话要点

VRGaussianAvatar:将3D高斯头像集成到VR中,实现实时全身虚拟化身

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 虚拟现实 3D高斯溅射 虚拟化身 逆运动学 实时渲染

📋 核心要点

- 现有VR化身方案在实时性和真实感之间难以平衡,且通常依赖复杂传感器。

- VRGaussianAvatar利用3D高斯溅射技术,仅通过HMD数据驱动全身姿态估计和渲染。

- 实验表明,该系统在保持交互性能的同时,显著提升了用户感知的外观相似性与沉浸感。

📝 摘要(中文)

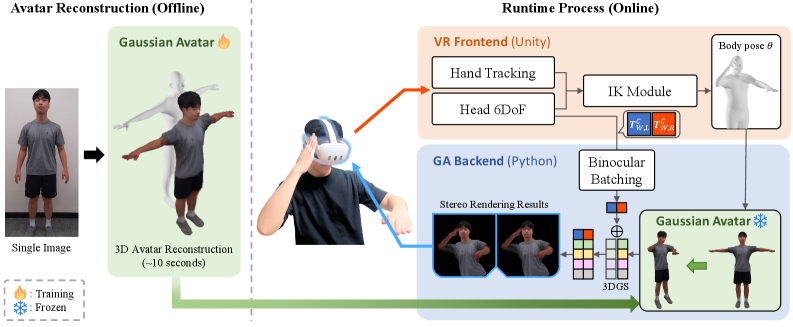

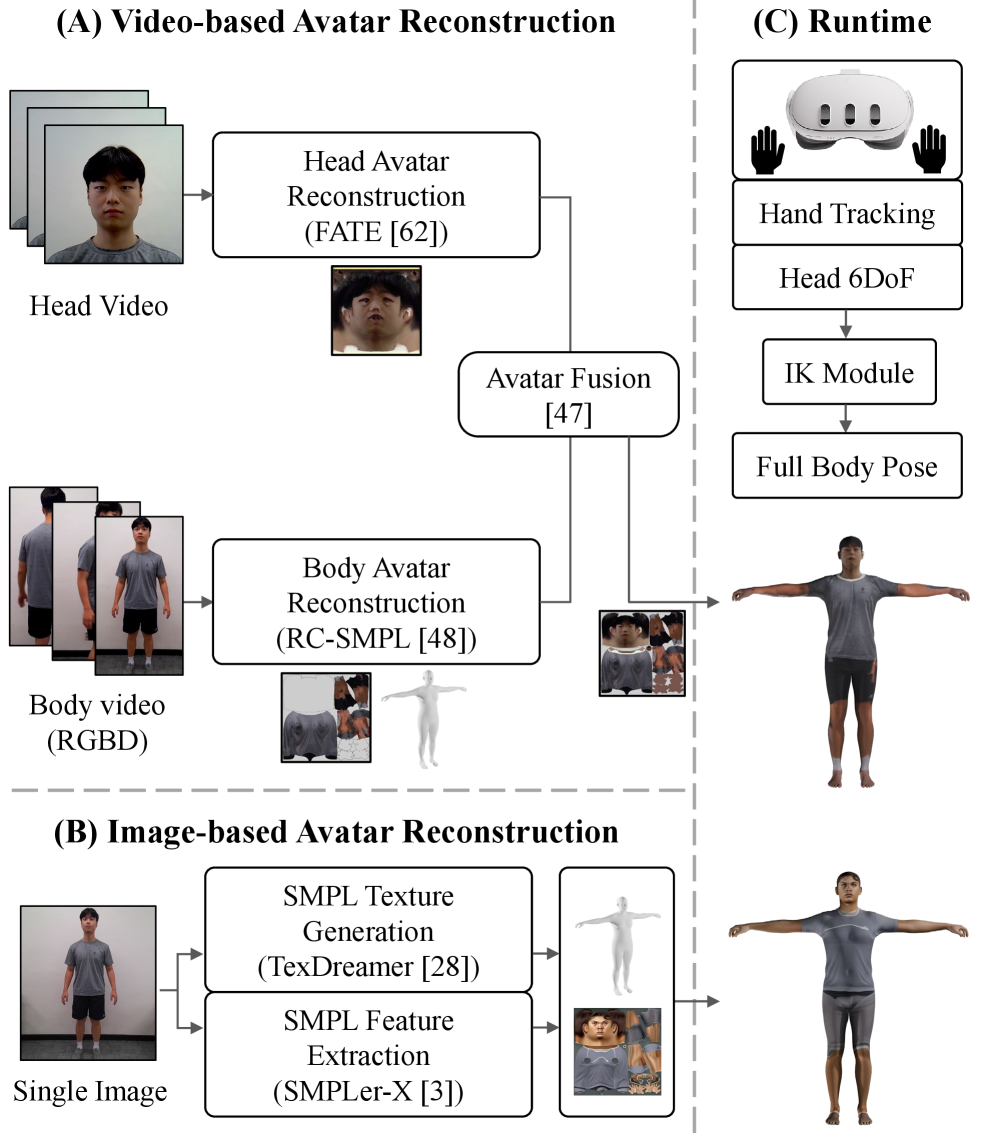

本文提出VRGaussianAvatar,一个集成的系统,仅使用头戴式显示器(HMD)跟踪信号,即可在虚拟现实中实现实时的全身3D高斯溅射(3DGS)化身。该系统采用一个VR前端和一个GA后端的并行管道。VR前端使用逆运动学来估计全身姿势,并将结果姿势与立体相机参数一起流式传输到后端。GA后端以立体方式渲染从单个图像重建的3DGS化身。为了提高立体渲染效率,我们引入了双目批处理,它在单个批处理过程中联合处理左右眼视图,以减少冗余计算并支持高分辨率VR显示。我们通过定量性能测试和一个受试者内用户研究,针对基于图像和视频的网格化身基线评估了VRGaussianAvatar。结果表明,VRGaussianAvatar能够维持交互式VR性能,并产生更高的感知外观相似性、具身性和合理性。项目页面和源代码可在https://vrgaussianavatar.github.io上找到。

🔬 方法详解

问题定义:现有VR化身方案通常面临两个主要问题。一是实时性不足,难以维持流畅的交互体验;二是真实感欠佳,难以提供高度逼真的虚拟形象。此外,许多方案依赖于额外的外部传感器(如深度相机或动作捕捉系统),增加了成本和复杂性。因此,如何在仅使用HMD跟踪数据的情况下,实现实时、高真实度的全身VR化身是一个挑战。

核心思路:VRGaussianAvatar的核心思路是利用3D高斯溅射(3DGS)技术,将单张图像重建的3D模型作为化身,并结合逆运动学(IK)方法,仅使用HMD的跟踪数据驱动全身姿态估计。3DGS能够提供高质量的渲染效果,同时保持较高的渲染效率。通过优化渲染流程,可以满足VR的实时性要求。

技术框架:VRGaussianAvatar系统包含两个主要模块:VR前端和GA后端。VR前端负责接收HMD的跟踪数据,使用逆运动学算法估计全身姿态,并将姿态信息和立体相机参数传输到GA后端。GA后端接收到这些信息后,使用3DGS技术渲染虚拟化身,并生成左右眼视图。为了提高渲染效率,系统采用了双目批处理技术。

关键创新:该论文的关键创新在于将3DGS技术引入VR化身领域,并提出了一种高效的双目批处理渲染方法。与传统的基于网格的化身相比,3DGS能够提供更高的渲染质量和更快的渲染速度。双目批处理通过联合处理左右眼视图,减少了冗余计算,进一步提高了渲染效率,使其能够支持高分辨率VR显示。

关键设计:VR前端使用标准的逆运动学算法,根据HMD的位置和旋转信息,估计全身关节的位置和旋转。GA后端使用CUDA实现3DGS渲染,并采用双目批处理技术,将左右眼视图合并到一个批次中进行处理。具体而言,系统修改了3DGS的渲染管线,使其能够同时处理两个视角的参数,从而减少了重复的计算步骤。此外,系统还针对VR环境进行了优化,例如调整了渲染分辨率和帧率,以获得最佳的视觉体验。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VRGaussianAvatar能够维持交互式VR性能,并显著提升用户感知的外观相似性、具身性和合理性。与基于图像和视频的网格化身基线相比,VRGaussianAvatar在用户主观评价中获得了更高的分数。具体而言,用户认为VRGaussianAvatar生成的化身更像自己,并且更容易产生身临其境的感觉。

🎯 应用场景

VRGaussianAvatar在虚拟会议、远程协作、VR游戏和虚拟社交等领域具有广泛的应用前景。它可以帮助用户在VR环境中创建更逼真、更具沉浸感的虚拟形象,从而提升用户体验和交互质量。该技术还有潜力应用于康复训练、远程医疗等领域,为用户提供个性化的虚拟化身服务。

📄 摘要(原文)

We present VRGaussianAvatar, an integrated system that enables real-time full-body 3D Gaussian Splatting (3DGS) avatars in virtual reality using only head-mounted display (HMD) tracking signals. The system adopts a parallel pipeline with a VR Frontend and a GA Backend. The VR Frontend uses inverse kinematics to estimate full-body pose and streams the resulting pose along with stereo camera parameters to the backend. The GA Backend stereoscopically renders a 3DGS avatar reconstructed from a single image. To improve stereo rendering efficiency, we introduce Binocular Batching, which jointly processes left and right eye views in a single batched pass to reduce redundant computation and support high-resolution VR displays. We evaluate VRGaussianAvatar with quantitative performance tests and a within-subject user study against image- and video-based mesh avatar baselines. Results show that VRGaussianAvatar sustains interactive VR performance and yields higher perceived appearance similarity, embodiment, and plausibility. Project page and source code are available at https://vrgaussianavatar.github.io.