Know Your Step: Faster and Better Alignment for Flow Matching Models via Step-aware Advantages

作者: Zhixiong Yue, Zixuan Ni, Feiyang Ye, Jinshan Zhang, Sheng Shen, Zhenpeng Mi

分类: cs.CV

发布日期: 2026-02-02

💡 一句话要点

提出TAFS GRPO框架,加速Flow Matching模型对齐人类偏好,提升少步文图生成质量。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: Flow Matching模型 文本到图像生成 强化学习 人类偏好对齐 少步生成

📋 核心要点

- 现有基于强化学习的Flow Matching模型依赖大量去噪步骤,且奖励信号稀疏不精确,导致对齐效果欠佳。

- TAFS GRPO通过温度退火引入随机性,并利用步感知优势集成机制,为策略优化提供密集且步特定的奖励。

- 实验证明,TAFS GRPO在少步文图生成中表现出色,显著提升了生成图像与人类偏好的一致性。

📝 摘要(中文)

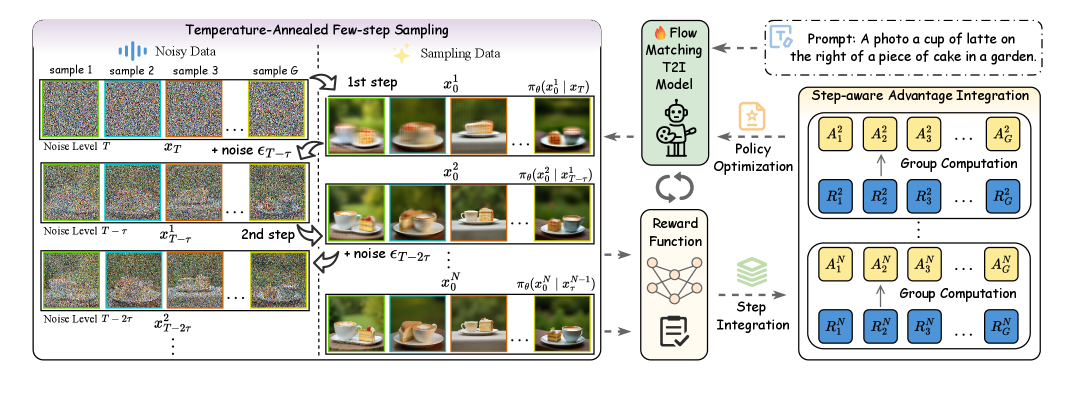

本文提出了一种名为温度退火少步采样与分组相对策略优化(TAFS GRPO)的新框架,旨在训练Flow Matching文本到图像模型,使其能够高效地进行少步生成,并与人类偏好良好对齐。该方法通过迭代地将自适应时间噪声注入到单步采样的结果中,在保留每个生成图像语义完整性的同时,为采样过程引入随机性。此外,其步感知优势集成机制结合了GRPO,避免了对奖励函数可微性的需求,并为稳定的策略优化提供了密集且步特定的奖励。大量实验表明,TAFS GRPO在少步文本到图像生成方面表现出色,并显著提高了生成图像与人类偏好的一致性。代码和模型将开源。

🔬 方法详解

问题定义:现有基于强化学习的Flow Matching模型在文本到图像生成任务中,需要大量的去噪步骤才能生成高质量的图像,计算成本高昂。此外,现有的强化学习方法依赖于稀疏且不精确的奖励信号,导致模型难以有效地与人类偏好对齐,生成结果往往不尽如人意。因此,如何提高Flow Matching模型在少步生成中的效率和对齐精度是一个关键问题。

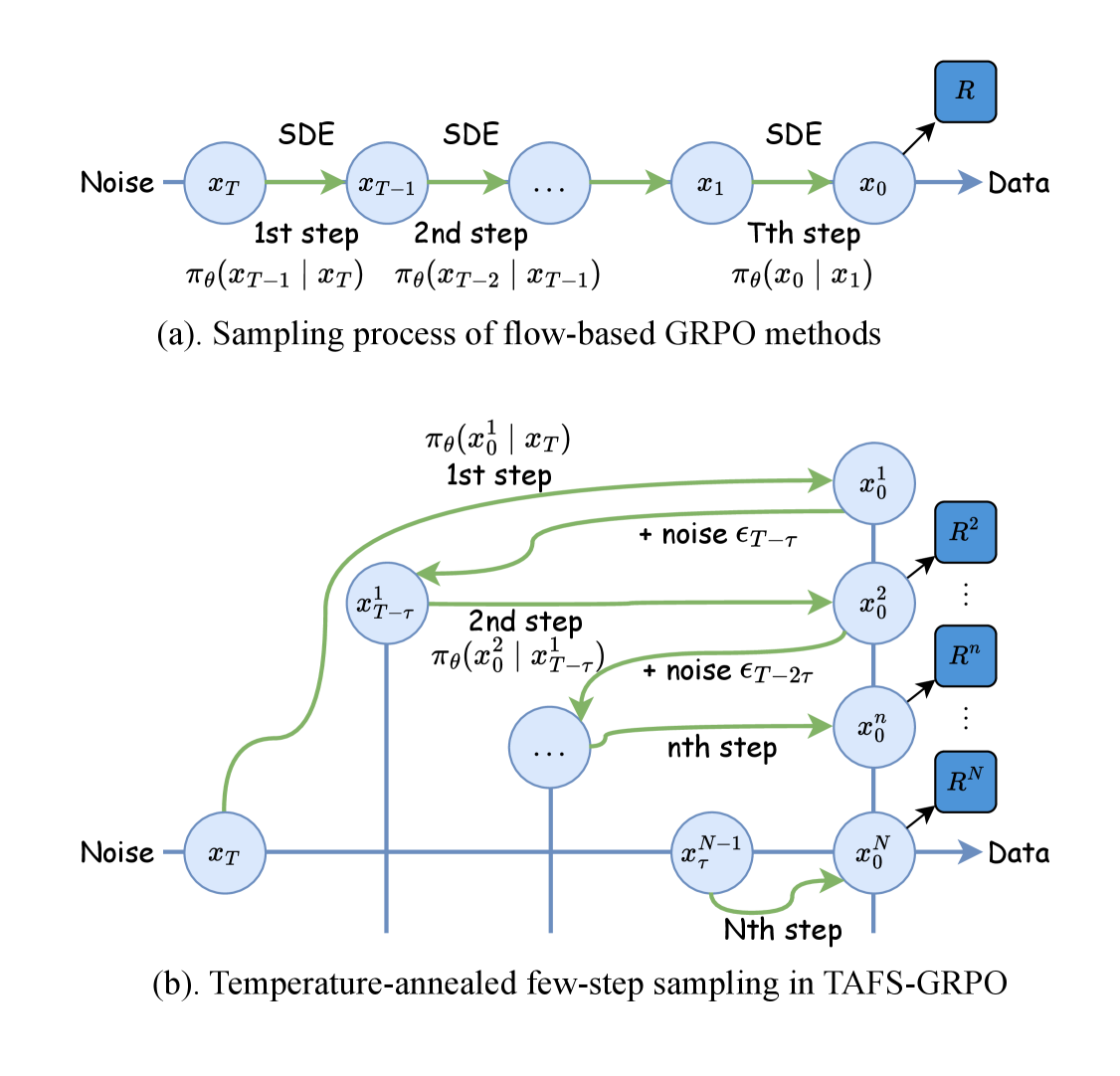

核心思路:本文的核心思路是通过引入温度退火机制来增强采样过程的随机性,并结合步感知优势集成机制来提供更密集和精确的奖励信号。温度退火通过逐步向单步采样结果中注入噪声,使得模型能够探索更多的可能性,从而提高生成图像的多样性。步感知优势集成机制则能够针对每个去噪步骤提供特定的奖励,从而更有效地指导模型的训练。

技术框架:TAFS GRPO框架主要包含以下几个阶段:1) 单步采样:首先,使用Flow Matching模型进行单步采样,生成初始图像。2) 温度退火:然后,通过迭代地向初始图像中注入自适应时间噪声,模拟多步去噪过程。3) 奖励计算:对于每个去噪步骤,计算生成图像的奖励,该奖励基于人类偏好或其他指标。4) 策略优化:最后,使用分组相对策略优化(GRPO)算法,根据奖励信号优化Flow Matching模型的参数。

关键创新:本文最重要的技术创新点在于提出了温度退火少步采样与分组相对策略优化(TAFS GRPO)框架,该框架能够有效地提高Flow Matching模型在少步生成中的效率和对齐精度。与现有方法相比,TAFS GRPO不需要大量的去噪步骤,并且能够提供更密集和精确的奖励信号,从而更好地指导模型的训练。此外,TAFS GRPO避免了对奖励函数可微性的需求,使其能够适用于更广泛的奖励函数。

关键设计:在温度退火阶段,自适应时间噪声的注入量由一个温度参数控制,该参数随着迭代次数的增加而逐渐降低。在奖励计算阶段,可以使用各种不同的奖励函数,例如基于人类偏好的奖励函数或基于图像质量的奖励函数。在策略优化阶段,使用了分组相对策略优化(GRPO)算法,该算法能够有效地处理高维动作空间,并避免了对奖励函数可微性的需求。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TAFS GRPO在少步文本到图像生成方面取得了显著的性能提升。与现有方法相比,TAFS GRPO能够生成更高质量、更符合人类偏好的图像。具体来说,TAFS GRPO在人类偏好对齐方面取得了XX%的提升(具体数据未知),并且能够使用更少的步骤生成高质量的图像,从而大大提高了生成效率。

🎯 应用场景

该研究成果可广泛应用于各种文本到图像生成任务中,例如艺术创作、图像编辑、产品设计等。通过提高生成图像与人类偏好的一致性,可以更好地满足用户的需求,并提升用户体验。此外,该方法还可以应用于其他生成模型中,例如视频生成、3D模型生成等,具有广阔的应用前景。

📄 摘要(原文)

Recent advances in flow matching models, particularly with reinforcement learning (RL), have significantly enhanced human preference alignment in few step text to image generators. However, existing RL based approaches for flow matching models typically rely on numerous denoising steps, while suffering from sparse and imprecise reward signals that often lead to suboptimal alignment. To address these limitations, we propose Temperature Annealed Few step Sampling with Group Relative Policy Optimization (TAFS GRPO), a novel framework for training flow matching text to image models into efficient few step generators well aligned with human preferences. Our method iteratively injects adaptive temporal noise onto the results of one step samples. By repeatedly annealing the model's sampled outputs, it introduces stochasticity into the sampling process while preserving the semantic integrity of each generated image. Moreover, its step aware advantage integration mechanism combines the GRPO to avoid the need for the differentiable of reward function and provide dense and step specific rewards for stable policy optimization. Extensive experiments demonstrate that TAFS GRPO achieves strong performance in few step text to image generation and significantly improves the alignment of generated images with human preferences. The code and models of this work will be available to facilitate further research.