Toward Cognitive Supersensing in Multimodal Large Language Model

作者: Boyi Li, Yifan Shen, Yuanzhe Liu, Yifan Xu, Jiateng Liu, Xinzhuo Li, Zhengyuan Li, Jingyuan Zhu, Yunhan Zhong, Fangzhou Lan, Jianguo Cao, James M. Rehg, Heng Ji, Ismini Lourentzou, Xu Cao

分类: cs.CV, cs.AI

发布日期: 2026-02-02

💡 一句话要点

提出认知超感知训练范式,提升多模态大语言模型在复杂认知任务中的表现。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 视觉问答 认知推理 视觉意象 强化学习

📋 核心要点

- 现有MLLM在复杂认知任务中表现不足,尤其缺乏对抽象视觉细节和视觉记忆的有效利用。

- 论文提出“认知超感知”训练范式,通过学习视觉认知潜在嵌入序列,赋予MLLM类人视觉意象能力。

- 实验表明,该方法在CogSense-Bench上显著优于SOTA模型,并在领域外VQA任务中表现出更好的泛化性。

📝 摘要(中文)

多模态大语言模型(MLLM)在开放词汇感知任务中取得了显著成功,但其解决复杂认知问题的能力仍然有限,尤其是在视觉细节抽象且需要视觉记忆时。现有方法主要在文本空间扩展思维链(CoT)推理,即使仅凭语言不足以进行清晰和结构化的推理,并且在很大程度上忽略了类似于人类视觉空间草图板和视觉意象的视觉推理机制。为了弥补这一缺陷,我们引入了认知超感知,这是一种新颖的训练范式,通过集成潜在视觉意象预测(LVIP)头,使MLLM具备类人视觉意象能力,该LVIP头联合学习视觉认知潜在嵌入序列并将其与答案对齐,从而形成基于视觉的内部推理链。我们进一步引入了一个强化学习阶段,该阶段基于这种有根据的视觉潜在优化文本推理路径。为了评估MLLM的认知能力,我们提出了CogSense-Bench,这是一个综合的视觉问答(VQA)基准,用于评估五个认知维度。大量的实验表明,使用认知超感知训练的MLLM在CogSense-Bench上显著优于最先进的基线,并在领域外数学和科学VQA基准上表现出卓越的泛化能力,这表明内部视觉意象可能是弥合感知识别和认知理解之间差距的关键。我们将开源CogSense-Bench和我们的模型权重。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型(MLLM)在复杂认知任务中表现不足的问题,尤其是在处理抽象视觉信息和需要视觉记忆的任务时。现有方法主要依赖于文本空间的思维链(CoT)推理,忽略了视觉推理机制,导致模型难以进行清晰和结构化的推理。

核心思路:论文的核心思路是赋予MLLM类似人类的视觉意象能力,使其能够像人类一样在头脑中形成视觉表征,并利用这些表征进行推理。通过学习视觉认知潜在嵌入序列,模型可以更好地理解和处理视觉信息,从而提高在复杂认知任务中的表现。

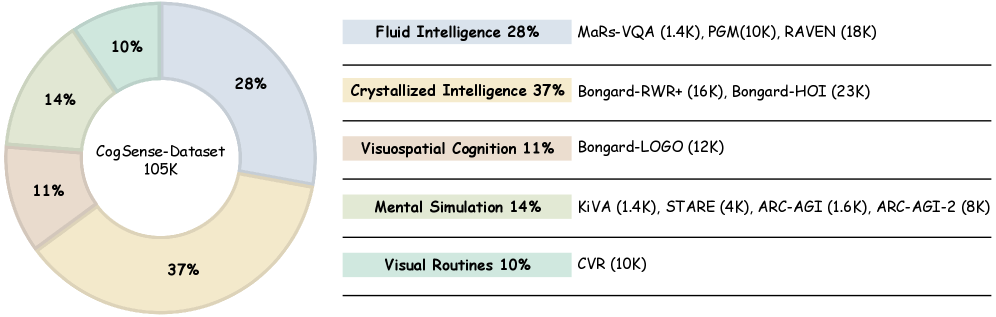

技术框架:整体框架包含以下几个主要模块:1) 潜在视觉意象预测(LVIP)头:用于学习视觉认知潜在嵌入序列,并将其与答案对齐,形成基于视觉的内部推理链。2) 强化学习阶段:基于LVIP头生成的视觉潜在信息,优化文本推理路径。3) CogSense-Bench:用于评估MLLM认知能力的综合视觉问答(VQA)基准。

关键创新:论文的关键创新在于提出了“认知超感知”训练范式,该范式通过集成LVIP头,使MLLM具备了类人视觉意象能力。这种方法不同于以往仅依赖文本推理的方法,而是将视觉信息融入到推理过程中,从而提高了模型在复杂认知任务中的表现。

关键设计:LVIP头的设计是关键。它需要学习能够有效表征视觉信息的潜在嵌入,并将这些嵌入与答案对齐。强化学习阶段的目标是优化文本推理路径,使其能够更好地利用LVIP头生成的视觉潜在信息。CogSense-Bench的设计也至关重要,它需要能够全面评估MLLM的认知能力,包括视觉推理、空间推理、逻辑推理等多个维度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用认知超感知训练的MLLM在CogSense-Bench上显著优于SOTA基线模型。此外,该模型在领域外数学和科学VQA基准上表现出卓越的泛化能力,证明了内部视觉意象对于弥合感知识别和认知理解之间差距的重要性。

🎯 应用场景

该研究成果可应用于需要复杂视觉推理和认知理解的领域,例如智能教育、医疗诊断、机器人导航等。通过赋予机器更强的视觉认知能力,可以使其更好地理解和处理现实世界中的信息,从而实现更智能、更高效的应用。

📄 摘要(原文)

Multimodal Large Language Models (MLLMs) have achieved remarkable success in open-vocabulary perceptual tasks, yet their ability to solve complex cognitive problems remains limited, especially when visual details are abstract and require visual memory. Current approaches primarily scale Chain-of-Thought (CoT) reasoning in the text space, even when language alone is insufficient for clear and structured reasoning, and largely neglect visual reasoning mechanisms analogous to the human visuospatial sketchpad and visual imagery. To mitigate this deficiency, we introduce Cognitive Supersensing, a novel training paradigm that endows MLLMs with human-like visual imagery capabilities by integrating a Latent Visual Imagery Prediction (LVIP) head that jointly learns sequences of visual cognitive latent embeddings and aligns them with the answer, thereby forming vision-based internal reasoning chains. We further introduce a reinforcement learning stage that optimizes text reasoning paths based on this grounded visual latent. To evaluate the cognitive capabilities of MLLMs, we present CogSense-Bench, a comprehensive visual question answering (VQA) benchmark assessing five cognitive dimensions. Extensive experiments demonstrate that MLLMs trained with Cognitive Supersensing significantly outperform state-of-the-art baselines on CogSense-Bench and exhibit superior generalization on out-of-domain mathematics and science VQA benchmarks, suggesting that internal visual imagery is potentially key to bridging the gap between perceptual recognition and cognitive understanding. We will open-source the CogSense-Bench and our model weights.