Structured Over Scale: Learning Spatial Reasoning from Educational Video

作者: Bishoy Galoaa, Xiangyu Bai, Sarah Ostadabbas

分类: cs.CV

发布日期: 2026-01-30

💡 一句话要点

提出DoraVQA数据集,并利用教育视频中的结构化信息提升视觉语言模型的空间推理能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 空间推理 教育视频 结构化学习 多模态理解

📋 核心要点

- 现有视觉语言模型在空间推理等简单任务上表现不佳,无法达到学龄前儿童的水平。

- 利用教育视频中结构化的“上下文-问题-暂停-答案”模式,通过微调提升模型推理能力。

- 实验表明,该方法在多个数据集上取得了显著提升,证明了结构化内容的重要性。

📝 摘要(中文)

视觉语言模型(VLMs)在标准视频理解基准测试中表现出色,但在学龄前儿童可以解决的简单推理任务(包括计数、空间推理和组合理解)中却系统性地失败。我们假设教育视频的教学结构化内容为提高这些能力提供了理想的训练信号。我们引入了DoraVQA,一个包含5344个问答对的数据集,这些问答对是从《爱探险的朵拉》的8个季度中自动提取的,并具有精确的时间戳对齐。每一集都遵循一致的“上下文-问题-暂停-答案”结构,创建了一个类似于互动辅导的自包含学习环境。我们使用Group Relative Policy Optimization (GRPO)对Qwen2和Qwen3进行微调,利用教育内容中固有的清晰正确性信号和结构化推理轨迹。尽管仅在38小时的儿童教育视频上进行训练,但我们的方法在DoraVQA上实现了8-14分的改进,并在CVBench上达到了最先进的86.16%,并且能够很好地迁移到Video-MME和NExT-QA,证明了从狭窄的教学内容到广泛的多模态理解的有效泛化。通过跨领域基准测试,我们表明VLMs可以执行需要从结构化教育内容中学习的强大推理的任务,这表明内容结构与内容规模同样重要。

🔬 方法详解

问题定义:现有视觉语言模型在处理需要空间推理、计数和组合理解等简单任务时表现不佳,即使是学龄前儿童也能轻松解决这些问题。现有方法通常依赖于大规模数据集进行训练,但缺乏对结构化推理过程的有效利用。

核心思路:论文的核心思路是利用教育视频中固有的结构化信息来指导视觉语言模型的学习。教育视频通常采用“上下文-问题-暂停-答案”的模式,这种模式提供了一种清晰的监督信号,可以帮助模型学习如何进行推理。通过在这种结构化数据上进行训练,模型可以更好地理解问题和答案之间的关系,从而提高其推理能力。

技术框架:整体框架包括以下几个主要步骤:1) 从《爱探险的朵拉》等教育视频中自动提取问答对,并创建DoraVQA数据集。2) 使用Group Relative Policy Optimization (GRPO) 对预训练的视觉语言模型(如Qwen2和Qwen3)进行微调。GRPO利用教育视频中的正确性信号和结构化推理轨迹来优化模型。3) 在多个基准测试数据集上评估模型的性能,包括DoraVQA、CVBench、Video-MME和NExT-QA。

关键创新:该论文的关键创新在于:1) 提出了DoraVQA数据集,该数据集专门用于评估视觉语言模型的空间推理能力。2) 利用教育视频中的结构化信息来指导模型的学习,这与传统的依赖大规模数据集的方法不同。3) 使用Group Relative Policy Optimization (GRPO) 来优化模型,该方法可以有效地利用教育视频中的正确性信号。

关键设计:DoraVQA数据集包含5344个问答对,这些问答对是从《爱探险的朵拉》的8个季度中自动提取的,并具有精确的时间戳对齐。GRPO算法用于微调Qwen2和Qwen3模型。具体参数设置和损失函数细节在论文中未明确说明,属于未知信息。

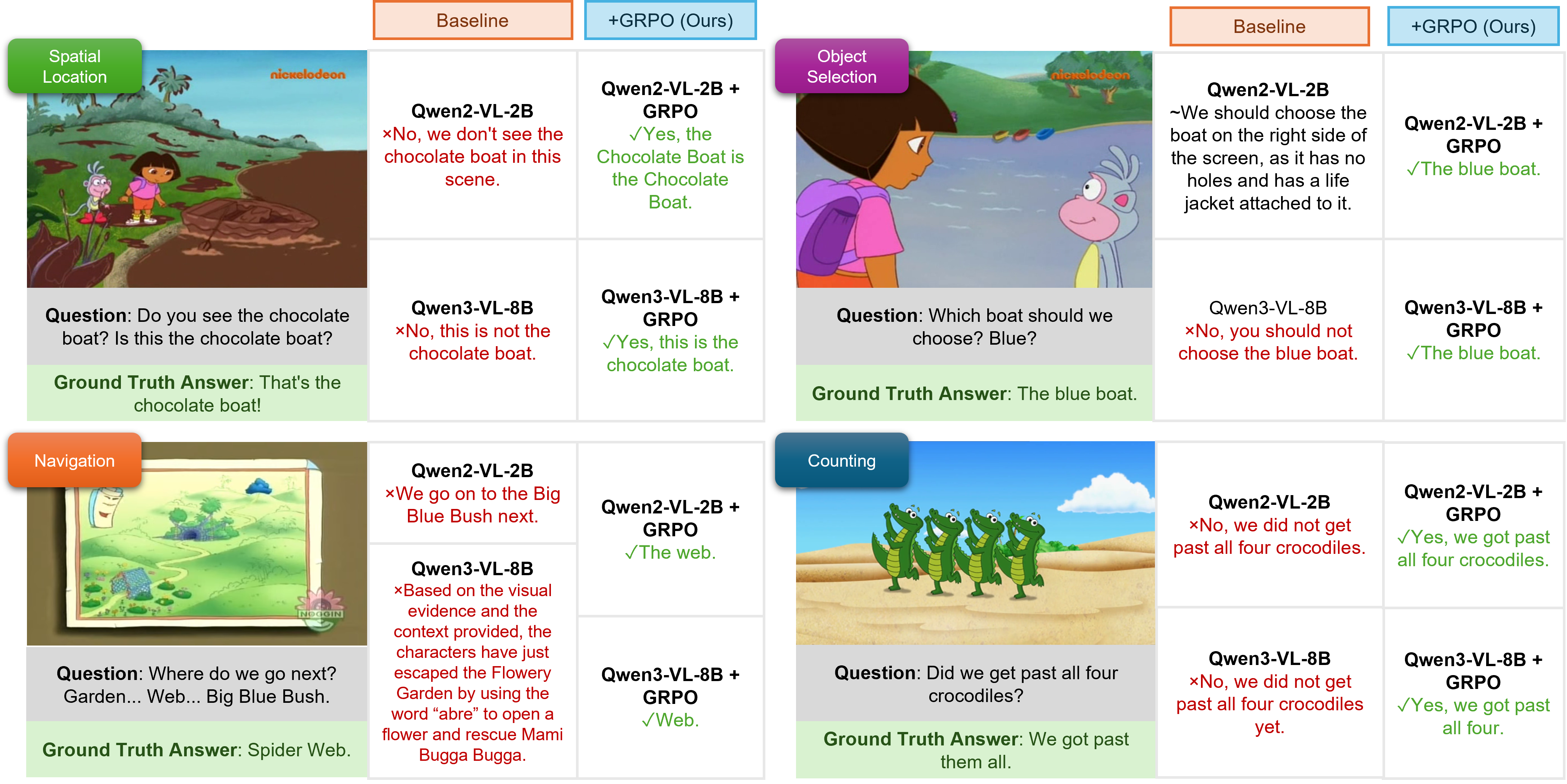

🖼️ 关键图片

📊 实验亮点

该方法在DoraVQA数据集上取得了8-14分的显著提升,并在CVBench上达到了86.16%的state-of-the-art性能。此外,该方法还能够很好地迁移到Video-MME和NExT-QA等数据集上,证明了其在多模态理解方面的有效泛化能力。这些结果表明,利用结构化教育内容可以有效地提升视觉语言模型的推理能力。

🎯 应用场景

该研究成果可应用于提升视觉语言模型在教育、机器人导航、智能助手等领域的空间推理能力。通过学习结构化知识,模型可以更好地理解和解决现实世界中的复杂问题,例如帮助儿童学习、辅助机器人进行环境探索和目标定位等。未来的研究可以探索更多结构化数据的利用方式,进一步提升模型的推理能力和泛化性能。

📄 摘要(原文)

Vision-language models (VLMs) demonstrate impressive performance on standard video understanding benchmarks yet fail systematically on simple reasoning tasks that preschool children can solve, including counting, spatial reasoning, and compositional understanding. We hypothesize that the pedagogically-structured content of educational videos provides an ideal training signal for improving these capabilities. We introduce DoraVQA, a dataset of 5,344 question-answer pairs automatically extracted from 8 seasons of Dora the Explorer with precise timestamp alignment. Each episode follows a consistent \textit{context-question-pause-answer} structure that creates a self-contained learning environment analogous to interactive tutoring. We fine-tune both Qwen2 and Qwen3 using Group Relative Policy Optimization (GRPO), leveraging the clear correctness signals and structured reasoning traces inherent in educational content. Despite training exclusively on 38 hours of children's educational videos, our approach achieves improvements of 8-14 points on DoraVQA and state-of-the-art 86.16\% on CVBench, with strong transfer to Video-MME and NExT-QA, demonstrating effective generalization from narrow pedagogical content to broad multimodal understanding. Through cross-domain benchmarks, we show that VLMs can perform tasks that require robust reasoning learned from structured educational content, suggesting that content structure matters as much as content scale.