FlowCalib: LiDAR-to-Vehicle Miscalibration Detection using Scene Flows

作者: Ilir Tahiraj, Peter Wittal, Markus Lienkamp

分类: cs.CV, cs.RO

发布日期: 2026-01-30

💡 一句话要点

FlowCalib:利用场景流检测LiDAR与车辆的外部参数误差

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: LiDAR标定 外部参数误差检测 场景流 自动驾驶 点云处理 深度学习 nuScenes数据集

📋 核心要点

- 现有方法主要关注传感器间标定,忽略了单个LiDAR与车辆的外部参数误差,这可能导致自动驾驶安全问题。

- FlowCalib利用静态物体的场景流运动信息,通过检测由旋转误差引起的系统性偏差来判断LiDAR是否未正确标定。

- FlowCalib在nuScenes数据集上验证了其检测LiDAR与车辆未标定的能力,并为该任务建立了新的基准。

📝 摘要(中文)

精确的传感器到车辆的标定对于安全的自动驾驶至关重要。LiDAR传感器的角度不对齐可能导致自动驾驶操作期间出现安全问题。然而,目前的方法主要集中在校正传感器之间的误差,而没有考虑导致这些误差的单个传感器的未校准。我们介绍了FlowCalib,这是第一个使用来自静态物体的场景流的运动线索来检测LiDAR到车辆的未校准的框架。我们的方法利用由连续3D点云生成的流场中由旋转不对齐引起的系统偏差,无需额外的传感器。该架构集成了用于流估计的神经场景流先验,并结合了一个双分支检测网络,该网络将学习到的全局流特征与手工制作的几何描述符融合。这些组合表示允许系统执行两个互补的二元分类任务:一个全局二元决策,指示是否存在未对准,以及单独的、轴特定的二元决策,指示每个旋转轴是否未对准。在nuScenes数据集上的实验证明了FlowCalib稳健地检测未校准的能力,为传感器到车辆的未校准检测建立了基准。

🔬 方法详解

问题定义:论文旨在解决自动驾驶系统中LiDAR与车辆之间的外部参数未标定问题。现有方法主要关注多传感器之间的标定,忽略了单个LiDAR与车辆坐标系之间的偏差。这种偏差会导致感知错误,进而影响自动驾驶系统的决策和控制,造成安全隐患。现有方法依赖额外的传感器或人工标定,成本高且效率低。

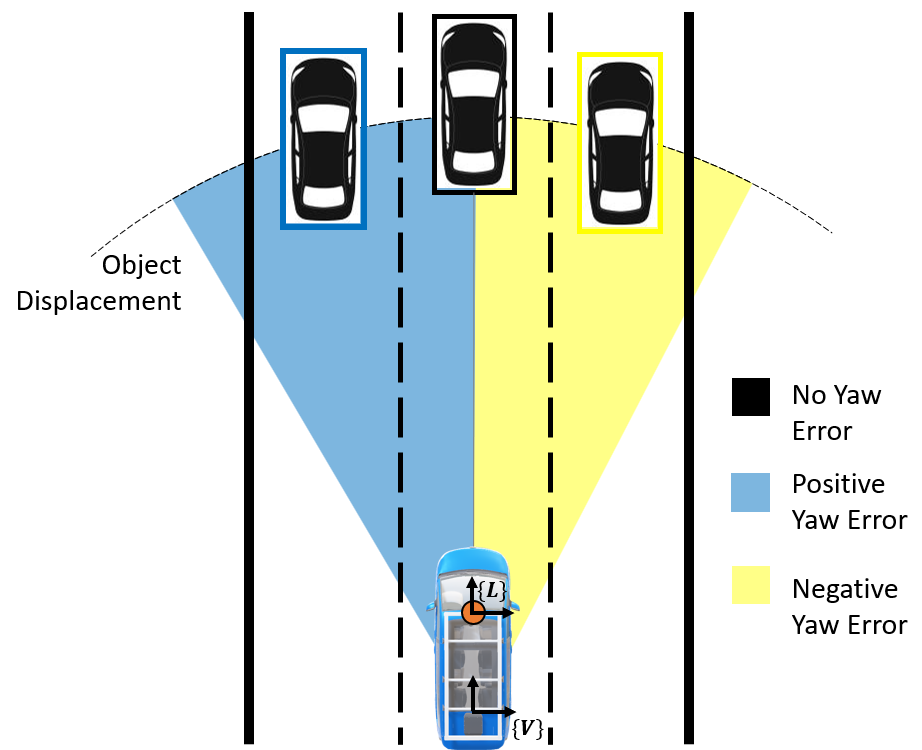

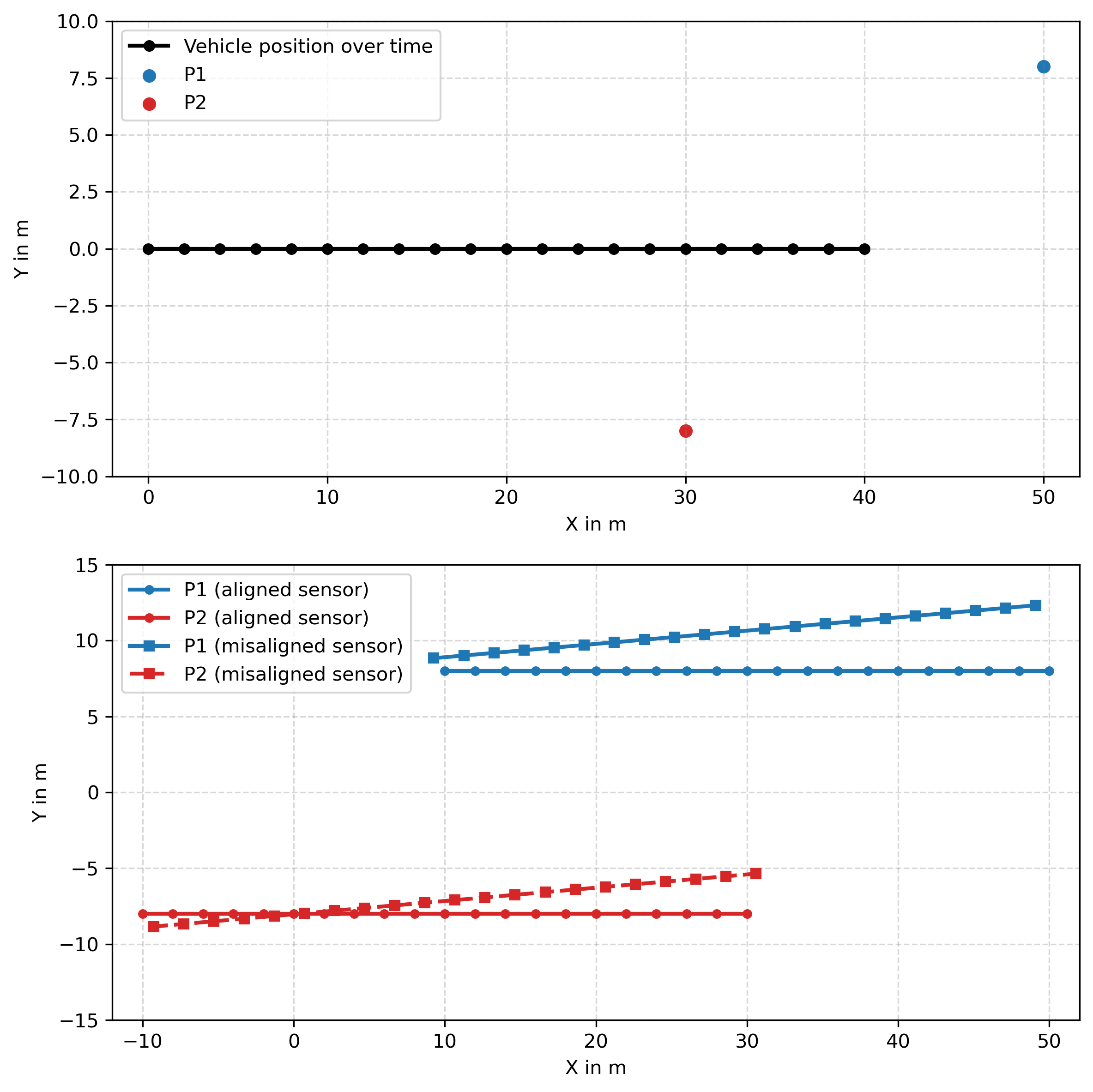

核心思路:FlowCalib的核心思路是利用场景流中的运动信息来检测LiDAR的未标定。具体来说,当LiDAR存在旋转误差时,即使是静态物体,在连续帧的点云中也会表现出一定的运动趋势。FlowCalib通过分析这种由旋转误差引起的系统性偏差,来判断LiDAR是否存在未标定。这种方法无需额外的传感器,仅依赖LiDAR自身的数据。

技术框架:FlowCalib的整体架构包含以下几个主要模块:1) 神经场景流先验:用于估计连续帧点云之间的场景流。2) 双分支检测网络:该网络包含两个分支,一个分支学习全局流特征,另一个分支提取手工制作的几何描述符。3) 融合模块:将两个分支的特征进行融合,得到最终的特征表示。4) 分类器:基于融合后的特征,进行两个二元分类任务:全局未标定检测和轴特定未标定检测。

关键创新:FlowCalib的关键创新在于:1) 首次提出利用场景流来检测LiDAR与车辆的外部参数未标定。2) 设计了一个双分支检测网络,融合了学习到的全局流特征和手工制作的几何描述符,提高了检测的鲁棒性。3) 实现了全局和轴特定的未标定检测,能够更精确地定位未标定的原因。与现有方法相比,FlowCalib无需额外的传感器,且能够自动检测未标定。

关键设计:FlowCalib的关键设计包括:1) 使用PointNet++提取点云特征。2) 使用FlowNet3D作为神经场景流先验。3) 手工制作的几何描述符包括点云的法向量和曲率。4) 损失函数采用交叉熵损失函数,分别用于全局和轴特定的二元分类任务。网络训练使用Adam优化器。

🖼️ 关键图片

📊 实验亮点

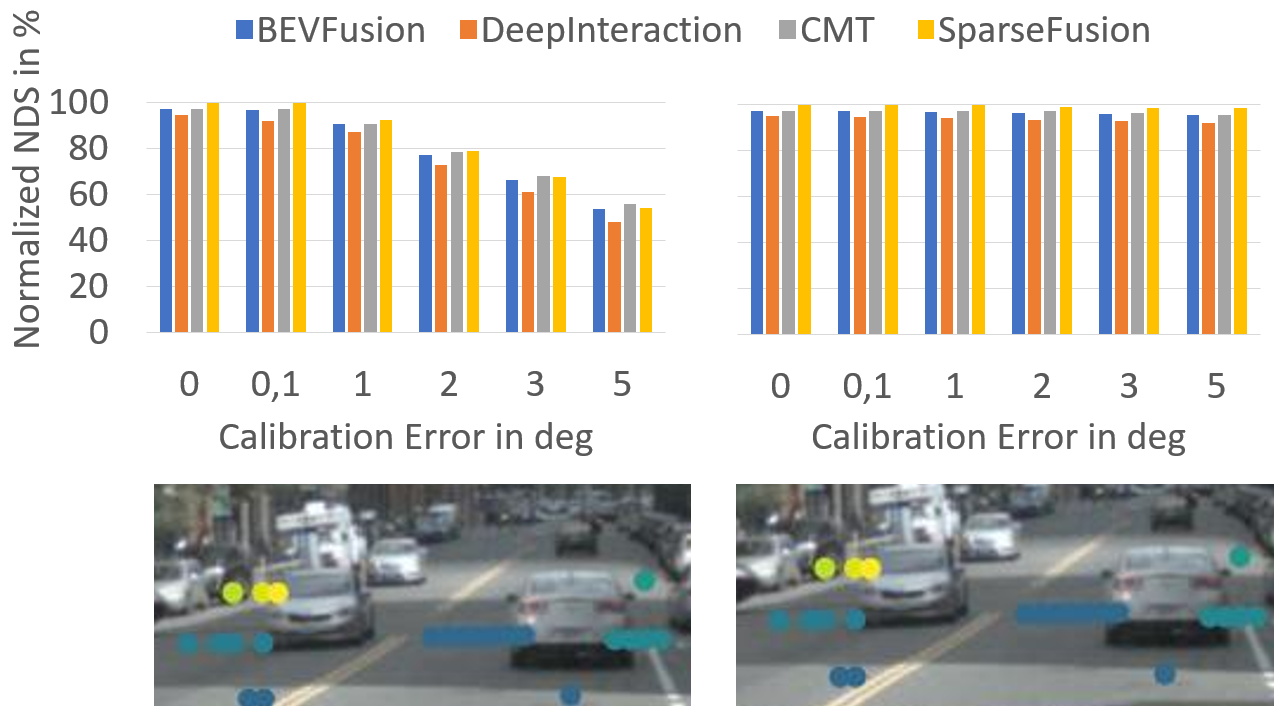

FlowCalib在nuScenes数据集上进行了实验,结果表明该方法能够有效地检测LiDAR与车辆的外部参数未标定。实验结果显示,FlowCalib在全局未标定检测任务上取得了优异的性能,并且能够准确地识别出哪些旋转轴存在未标定。这些结果证明了FlowCalib的有效性和鲁棒性,并为传感器到车辆的未标定检测提供了一个新的基准。

🎯 应用场景

FlowCalib可应用于自动驾驶车辆的自检和校准,确保LiDAR传感器始终处于精确标定状态,提高自动驾驶系统的安全性和可靠性。此外,该方法还可用于机器人、无人机等其他需要精确三维感知的应用场景,例如环境建模、目标跟踪等。未来,FlowCalib可以扩展到同时校准多个传感器,并实现实时的在线标定。

📄 摘要(原文)

Accurate sensor-to-vehicle calibration is essential for safe autonomous driving. Angular misalignments of LiDAR sensors can lead to safety-critical issues during autonomous operation. However, current methods primarily focus on correcting sensor-to-sensor errors without considering the miscalibration of individual sensors that cause these errors in the first place. We introduce FlowCalib, the first framework that detects LiDAR-to-vehicle miscalibration using motion cues from the scene flow of static objects. Our approach leverages the systematic bias induced by rotational misalignment in the flow field generated from sequential 3D point clouds, eliminating the need for additional sensors. The architecture integrates a neural scene flow prior for flow estimation and incorporates a dual-branch detection network that fuses learned global flow features with handcrafted geometric descriptors. These combined representations allow the system to perform two complementary binary classification tasks: a global binary decision indicating whether misalignment is present and separate, axis-specific binary decisions indicating whether each rotational axis is misaligned. Experiments on the nuScenes dataset demonstrate FlowCalib's ability to robustly detect miscalibration, establishing a benchmark for sensor-to-vehicle miscalibration detection.