Past- and Future-Informed KV Cache Policy with Salience Estimation in Autoregressive Video Diffusion

作者: Hanmo Chen, Chenghao Xu, Xu Yang, Xuan Chen, Cheng Deng

分类: cs.CV

发布日期: 2026-01-29

💡 一句话要点

提出PaFu-KV缓存策略,通过显著性估计提升自回归视频扩散模型的效率和质量。

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 自回归视频生成 KV缓存策略 显著性估计 知识蒸馏 长时视频 模型优化 视频扩散模型

📋 核心要点

- 现有自回归视频生成模型采用启发式KV缓存策略,忽略了不同token的重要性,导致信息丢失和效率降低。

- PaFu-KV策略通过引入显著性估计头,区分token重要性,保留关键信息并丢弃冗余缓存,从而优化质量-效率平衡。

- 实验证明,PaFu-KV在保持视频生成质量的同时,加速了推理过程,实现了更高效的长期视频生成。

📝 摘要(中文)

视频生成是数字媒体创作的关键。近年来,自回归视频生成技术的进步显著提高了实时视频合成的效率。然而,现有方法通常依赖于启发式的KV缓存策略,忽略了token在长期视频生成中的重要性差异,导致关键时空信息的丢失和冗余无效缓存的积累,从而降低了视频生成的质量和效率。为了解决这一局限性,我们首先观察到token对视频生成的贡献在时间上是高度异构的,并据此提出了一种新颖的Past- and Future-Informed KV Cache Policy (PaFu-KV)。具体来说,PaFu-KV引入了一个从双向教师模型中提炼出的轻量级显著性估计头,用于估计显著性分数,从而使KV缓存能够保留信息丰富的token,同时丢弃不太相关的token。该策略通过缩小KV缓存容量并减少推理时的内存占用,实现了更好的质量-效率权衡,从而实现更高效的长期视频生成。在基准测试上的大量实验表明,我们的方法在保持高保真视频生成质量的同时,能够加速推理,从而实现更高效的长期视频生成。我们的代码将在论文被接收后发布。

🔬 方法详解

问题定义:现有自回归视频生成模型在长时视频生成中,采用的KV缓存策略通常是启发式的,没有区分不同token的重要性。这导致重要的时空信息可能被丢弃,而冗余的、不重要的token却占据了宝贵的缓存空间,最终影响视频生成的质量和效率。因此,需要一种更智能的KV缓存策略,能够根据token的重要性动态地管理缓存。

核心思路:论文的核心思路是根据token对视频生成的重要性(即显著性)来决定是否将其保留在KV缓存中。重要的token保留,不重要的token丢弃,从而在有限的缓存空间内最大化信息的保留。通过这种方式,可以在保证视频生成质量的同时,减少内存占用,提高推理速度。

技术框架:PaFu-KV策略主要包含以下几个部分:1) 自回归视频生成模型(例如基于Transformer的模型);2) 双向教师模型,用于学习token的上下文信息;3) 轻量级的显著性估计头,从教师模型中蒸馏而来,用于预测每个token的显著性分数;4) KV缓存管理模块,根据显著性分数决定token的保留或丢弃。

关键创新:该方法最重要的创新点在于提出了Past- and Future-Informed的显著性估计方法。传统的显著性估计可能只考虑了token的过去信息,而PaFu-KV通过双向教师模型,同时考虑了token的过去和未来信息,从而更准确地评估token的重要性。此外,通过知识蒸馏,将双向教师模型的知识迁移到轻量级的显著性估计头,降低了计算成本。

关键设计:显著性估计头是一个轻量级的神经网络,输入是token的embedding,输出是该token的显著性分数。该网络通过最小化与双向教师模型预测结果的差异进行训练。KV缓存管理模块根据显著性分数设定一个阈值,高于阈值的token保留,低于阈值的token丢弃。阈值的选择可以根据实际情况进行调整,以平衡视频生成质量和推理速度。

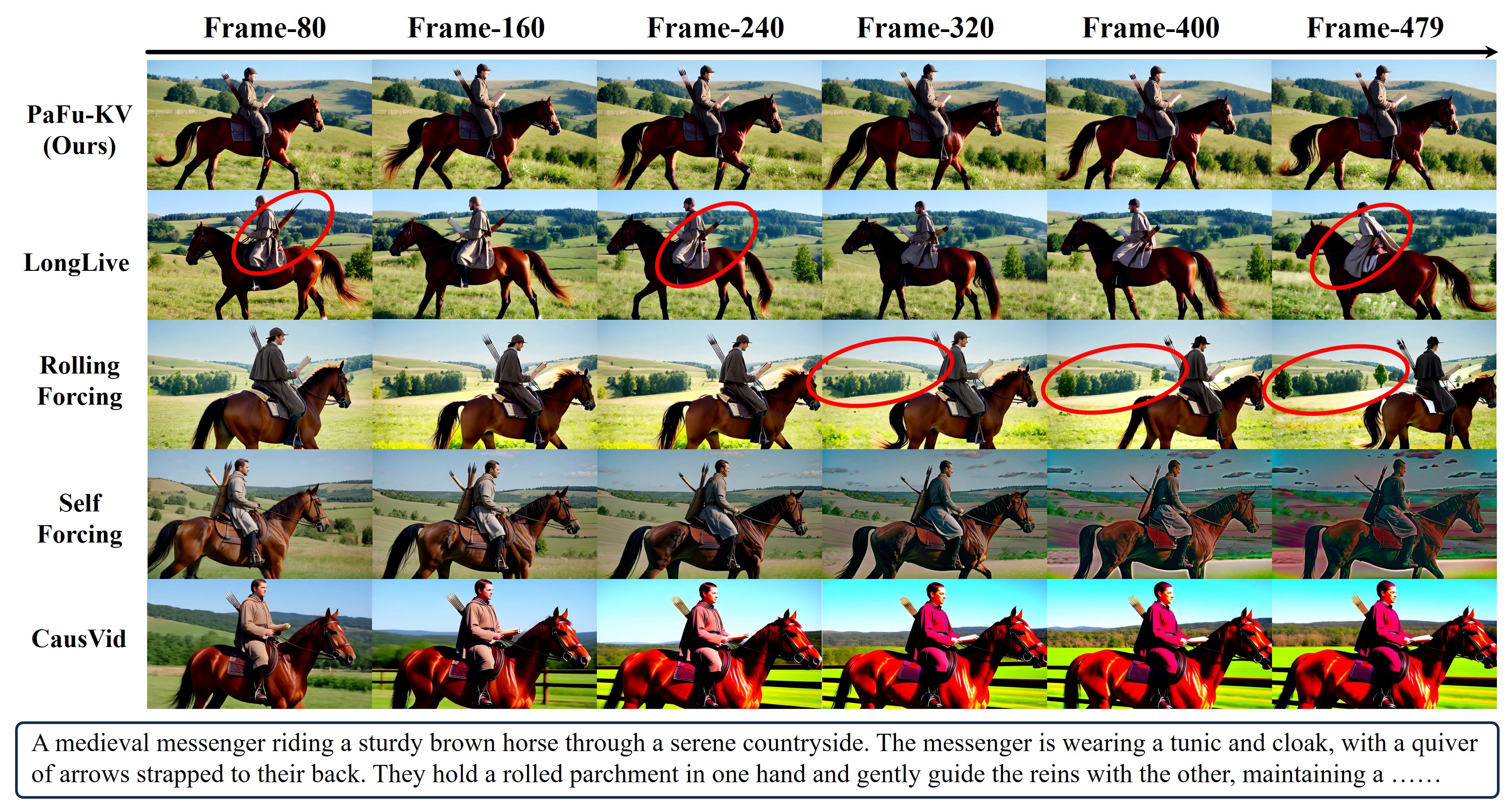

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了PaFu-KV策略的有效性。实验结果表明,在保持视频生成质量的前提下,PaFu-KV能够显著减少KV缓存的容量,从而降低内存占用并加速推理过程。具体的性能数据和与现有基线的对比结果将在论文发表后公开。

🎯 应用场景

该研究成果可广泛应用于各种需要高效视频生成的场景,例如实时视频编辑、游戏开发、虚拟现实、以及在线视频平台的内容生成。通过降低内存占用和提高推理速度,该方法使得在资源受限的设备上进行高质量视频生成成为可能,并有望推动视频生成技术在移动设备和边缘计算领域的应用。

📄 摘要(原文)

Video generation is pivotal to digital media creation, and recent advances in autoregressive video generation have markedly enhanced the efficiency of real-time video synthesis. However, existing approaches generally rely on heuristic KV Cache policies, which ignore differences in token importance in long-term video generation. This leads to the loss of critical spatiotemporal information and the accumulation of redundant, invalid cache, thereby degrading video generation quality and efficiency. To address this limitation, we first observe that token contributions to video generation are highly time-heterogeneous and accordingly propose a novel Past- and Future-Informed KV Cache Policy (PaFu-KV). Specifically, PaFu-KV introduces a lightweight Salience Estimation Head distilled from a bidirectional teacher to estimate salience scores, allowing the KV cache to retain informative tokens while discarding less relevant ones. This policy yields a better quality-efficiency trade-off by shrinking KV cache capacity and reducing memory footprint at inference time. Extensive experiments on benchmarks demonstrate that our method preserves high-fidelity video generation quality while enables accelerated inference, thereby enabling more efficient long-horizon video generation. Our code will be released upon paper acceptance.