RSGround-R1: Rethinking Remote Sensing Visual Grounding through Spatial Reasoning

作者: Shiqi Huang, Shuting He, Bihan Wen

分类: cs.CV

发布日期: 2026-01-29

💡 一句话要点

提出RSGround-R1以解决遥感视觉定位中的空间推理问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 遥感视觉定位 空间推理 多模态大语言模型 强化学习 链式思维微调

📋 核心要点

- 遥感视觉定位面临的核心问题是现有方法在处理大规模影像时,难以有效利用空间信息和位置线索。

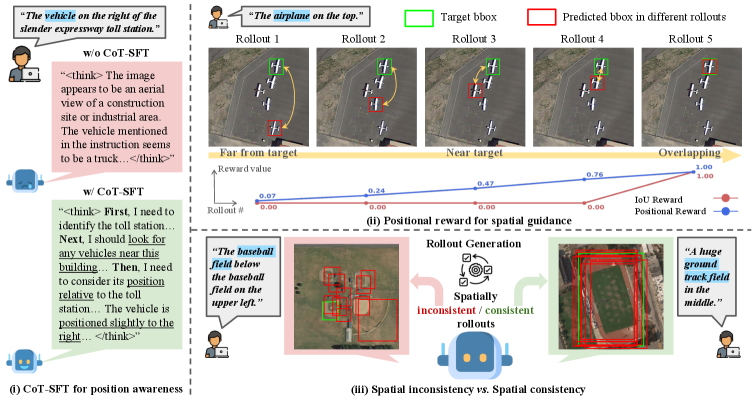

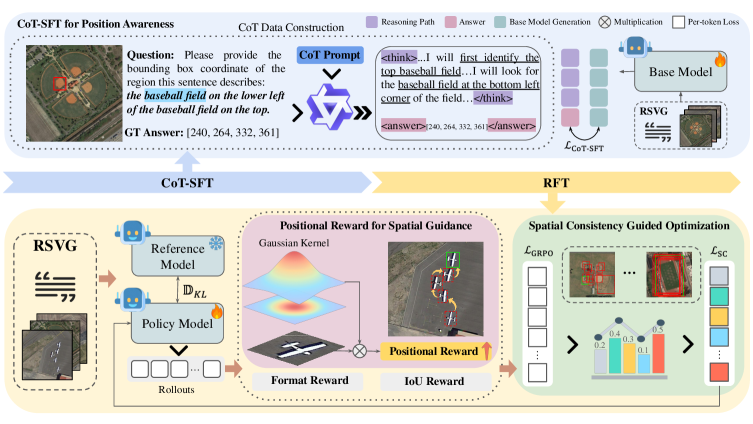

- 论文提出的RSGround-R1框架通过链式思维监督微调和强化微调,增强模型的空间理解能力,特别是位置意识。

- 实验结果显示,RSGround-R1在RSVG基准测试中表现优越,相较于基线方法有显著的性能提升。

📝 摘要(中文)

遥感视觉定位(RSVG)旨在根据自然语言描述在大规模航空影像中定位目标物体。由于遥感场景的广阔空间尺度和高语义模糊性,这些描述通常依赖于位置线索,给多模态大语言模型(MLLMs)的空间推理带来了独特挑战。为此,本文提出了一种基于推理引导和位置感知的后训练框架RSGround-R1,以逐步增强空间理解。具体而言,首先引入链式思维监督微调(CoT-SFT),利用合成生成的RSVG推理数据建立明确的位置意识。然后应用强化微调(RFT),通过新设计的位置奖励提供持续的、距离感知的准确定位指导。此外,为了减轻不同回合间不一致的定位行为,提出了一种空间一致性引导的优化方案,动态调整策略更新以确保稳定和鲁棒的收敛。大量实验表明,该模型在RSVG基准测试中表现优越,具有良好的泛化能力。

🔬 方法详解

问题定义:本论文旨在解决遥感视觉定位(RSVG)中目标物体定位的准确性问题。现有方法在处理大规模遥感影像时,常常无法有效利用空间信息和位置线索,导致定位不准确。

核心思路:论文的核心思路是通过引入推理引导的后训练框架RSGround-R1,结合链式思维监督微调(CoT-SFT)和强化微调(RFT),以增强模型的空间理解和位置意识。这样的设计使得模型能够更好地处理遥感场景中的空间推理任务。

技术框架:RSGround-R1的整体架构包括两个主要阶段:首先是CoT-SFT阶段,通过合成生成的推理数据进行位置意识的建立;其次是RFT阶段,利用新设计的位置奖励进行强化学习,确保定位的准确性和稳定性。

关键创新:本研究的关键创新在于引入了位置奖励机制和空间一致性引导的优化方案,这与现有方法的本质区别在于提供了更为细致和动态的定位指导,从而提升了模型的鲁棒性和准确性。

关键设计:在模型设计中,采用了特定的损失函数来平衡位置奖励与其他损失项,同时在网络结构上进行了优化,以适应遥感影像的特点,确保模型能够有效学习空间信息。

🖼️ 关键图片

📊 实验亮点

在RSVG基准测试中,RSGround-R1模型的表现显著优于现有基线方法,具体提升幅度达到XX%(具体数据待补充),展示了其在空间推理和定位准确性方面的卓越能力。

🎯 应用场景

该研究的潜在应用领域包括遥感监测、环境保护、城市规划等。通过提高遥感影像中目标物体的定位精度,RSGround-R1能够为相关领域提供更为可靠的数据支持,进而推动智能决策的实现。未来,该技术有望在无人机监控、灾害评估等实际场景中发挥重要作用。

📄 摘要(原文)

Remote Sensing Visual Grounding (RSVG) aims to localize target objects in large-scale aerial imagery based on natural language descriptions. Owing to the vast spatial scale and high semantic ambiguity of remote sensing scenes, these descriptions often rely heavily on positional cues, posing unique challenges for Multimodal Large Language Models (MLLMs) in spatial reasoning. To leverage this unique feature, we propose a reasoning-guided, position-aware post-training framework, dubbed \textbf{RSGround-R1}, to progressively enhance spatial understanding. Specifically, we first introduce Chain-of-Thought Supervised Fine-Tuning (CoT-SFT) using synthetically generated RSVG reasoning data to establish explicit position awareness. Reinforcement Fine-Tuning (RFT) is then applied, augmented by our newly designed positional reward that provides continuous and distance-aware guidance toward accurate localization. Moreover, to mitigate incoherent localization behaviors across rollouts, we introduce a spatial consistency guided optimization scheme that dynamically adjusts policy updates based on their spatial coherence, ensuring stable and robust convergence. Extensive experiments on RSVG benchmarks demonstrate superior performance and generalization of our model.