MPF-Net: Exposing High-Fidelity AI-Generated Video Forgeries via Hierarchical Manifold Deviation and Micro-Temporal Fluctuations

作者: Xinan He, Kaiqing Lin, Yue Zhou, Jiaming Zhong, Wei Ye, Wenhui Yi, Bing Fan, Feng Ding, Haodong Li, Bo Cao, Bin Li

分类: cs.CV

发布日期: 2026-01-29

💡 一句话要点

MPF-Net:通过分层流形偏差与微观时间波动揭示高保真AI生成视频伪造

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI生成视频检测 视频伪造检测 流形学习 时间序列分析 视觉基础模型

📋 核心要点

- 现有AI视频生成技术日益精湛,难以通过宏观语义和时间一致性判断真伪,需要更精细的鉴别方法。

- 论文核心思想是AI生成视频本质是流形拟合,相邻帧残差存在结构化和同质化的“流形投影波动”(MPF)现象。

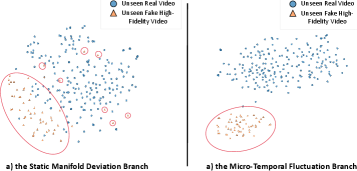

- 论文提出分层双路径框架MPF-Net,通过静态流形偏差和微观时间波动分支,有效检测高保真AI生成视频。

📝 摘要(中文)

随着Veo和Wan等视频生成模型的快速发展,合成内容的视觉质量已经达到了宏观语义错误和时间不一致性不再突出的水平。然而,这并不意味着真实视频和前沿高保真伪造视频之间的区别是无法追踪的。本文认为,AI生成的视频本质上是流形拟合过程的产物,而不是物理记录。因此,AI视频中连续相邻帧残差的像素组成逻辑表现出结构化和同质化的特征,本文称之为“流形投影波动”(MPF)。基于此,本文提出了一种分层双路径框架,该框架作为顺序过滤过程运行。首先,静态流形偏差分支利用大规模视觉基础模型(VFMs)的精细感知边界来捕获偏离自然真实世界流形的残余空间异常或物理违规(离流形)。对于成功驻留在流形上并逃避空间检测的剩余高保真视频,本文引入微观时间波动分支作为二级精细过滤器。通过分析即使在视觉上完美的序列中仍然存在的结构化MPF,本文的框架确保无论伪造表现为全局真实世界流形偏差还是细微的计算指纹,都能被揭露。

🔬 方法详解

问题定义:当前AI视频生成技术迅速发展,生成的视频在视觉质量上已经非常逼真,传统的检测方法难以有效识别。现有的检测方法主要关注宏观的语义错误和时间不一致性,但对于高保真AI生成视频,这些方法已经失效。因此,需要一种新的方法来检测这些难以察觉的伪造视频。

核心思路:论文的核心思路是基于AI生成视频的本质是流形拟合过程的产物。与真实视频的物理记录不同,AI生成视频的连续帧之间存在一种结构化和同质化的关系,即“流形投影波动”(MPF)。通过分析这种MPF,可以有效地识别AI生成视频。论文设计了一个分层双路径框架,首先通过静态流形偏差分支检测明显的空间异常,然后通过微观时间波动分支检测细微的时间波动。

技术框架:MPF-Net框架包含两个主要分支:静态流形偏差分支和微观时间波动分支。静态流形偏差分支利用大规模视觉基础模型(VFMs)来检测视频帧中的空间异常,例如不符合物理规律的物体或场景。如果视频通过了静态流形偏差分支的检测,则进入微观时间波动分支。微观时间波动分支分析连续帧之间的残差,提取MPF特征,并使用分类器来判断视频是否为AI生成。整个框架是一个顺序过滤过程,首先检测明显的异常,然后检测细微的波动。

关键创新:论文的关键创新在于提出了“流形投影波动”(MPF)的概念,并将其应用于AI生成视频的检测。与传统的检测方法不同,MPF-Net关注的是AI生成视频的内在特征,而不是宏观的语义或时间一致性。此外,论文还提出了一个分层双路径框架,可以有效地检测不同类型的AI生成视频。

关键设计:静态流形偏差分支使用了预训练的大规模视觉基础模型(VFMs),例如CLIP或ALIGN,来提取视频帧的特征。微观时间波动分支首先计算连续帧之间的残差,然后使用卷积神经网络(CNN)来提取MPF特征。分类器可以使用任何标准的分类算法,例如支持向量机(SVM)或神经网络。论文中没有明确说明具体的参数设置或损失函数,这部分信息可能在补充材料中。

🖼️ 关键图片

📊 实验亮点

论文提出了MPF-Net框架,通过分层流形偏差和微观时间波动分析,有效检测高保真AI生成视频。具体实验数据未知,但摘要强调该方法能够检测出传统方法难以识别的、视觉上完美的AI生成视频,无论其表现为全局流形偏差还是细微计算指纹。

🎯 应用场景

该研究成果可应用于数字媒体内容安全领域,例如社交媒体平台、新闻媒体机构等,用于检测和识别AI生成的虚假视频,防止恶意传播和信息操纵。此外,该技术还可以用于版权保护,防止未经授权的AI视频生成和传播。未来,该技术可以进一步发展,用于检测更复杂和逼真的AI生成视频,并与其他检测方法相结合,提高检测的准确性和鲁棒性。

📄 摘要(原文)

With the rapid advancement of video generation models such as Veo and Wan, the visual quality of synthetic content has reached a level where macro-level semantic errors and temporal inconsistencies are no longer prominent. However, this does not imply that the distinction between real and cutting-edge high-fidelity fake is untraceable. We argue that AI-generated videos are essentially products of a manifold-fitting process rather than a physical recording. Consequently, the pixel composition logic of consecutive adjacent frames residual in AI videos exhibits a structured and homogenous characteristic. We term this phenomenon `Manifold Projection Fluctuations' (MPF). Driven by this insight, we propose a hierarchical dual-path framework that operates as a sequential filtering process. The first, the Static Manifold Deviation Branch, leverages the refined perceptual boundaries of Large-Scale Vision Foundation Models (VFMs) to capture residual spatial anomalies or physical violations that deviate from the natural real-world manifold (off-manifold). For the remaining high-fidelity videos that successfully reside on-manifold and evade spatial detection, we introduce the Micro-Temporal Fluctuation Branch as a secondary, fine-grained filter. By analyzing the structured MPF that persists even in visually perfect sequences, our framework ensures that forgeries are exposed regardless of whether they manifest as global real-world manifold deviations or subtle computational fingerprints.