RAW-Flow: Advancing RGB-to-RAW Image Reconstruction with Deterministic Latent Flow Matching

作者: Zhen Liu, Diedong Feng, Hai Jiang, Liaoyuan Zeng, Hao Wang, Chaoyu Feng, Lei Lei, Bing Zeng, Shuaicheng Liu

分类: cs.CV

发布日期: 2026-01-28

备注: AAAI2026 Oral

💡 一句话要点

提出RAW-Flow,通过确定性隐空间流匹配实现高质量RGB到RAW图像重建

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: RGB到RAW重建 图像信号处理 流匹配 隐空间学习 图像重建

📋 核心要点

- 现有RGB到RAW重建方法受限于逆ISP的病态性和RGB图像的信息损失,导致细节不一致和颜色偏差。

- RAW-Flow将RGB到RAW重建视为确定性隐空间传输问题,通过流匹配学习隐空间向量场,弥合RGB和RAW表示的差距。

- 实验结果表明,RAW-Flow在定量和视觉效果上均超越了现有最佳方法,实现了更高质量的图像重建。

📝 摘要(中文)

RGB到RAW图像重建,即相机图像信号处理(ISP)流程的逆向建模,旨在从RGB图像中恢复高保真RAW数据。现有方法通常将其视为直接回归问题,容易出现细节不一致和颜色偏差,这是由于逆ISP的病态性和量化RGB图像的固有信息损失所致。为了解决这些限制,我们开创性地从生成角度出发,将RGB到RAW重建重构为确定性隐空间传输问题,并提出了名为RAW-Flow的新框架,该框架利用流匹配来学习隐空间中的确定性向量场,从而有效地弥合RGB和RAW表示之间的差距,并实现结构细节和颜色信息的准确重建。为了进一步增强隐空间传输,我们引入了跨尺度上下文引导模块,将分层RGB特征注入到流估计过程中。此外,我们设计了一个具有特征对齐约束的双域隐空间自编码器,以支持所提出的隐空间传输框架,该框架联合编码RGB和RAW输入,同时促进稳定训练和高保真重建。大量实验表明,RAW-Flow在定量和视觉上均优于最先进的方法。

🔬 方法详解

问题定义:RGB到RAW图像重建旨在从RGB图像中恢复对应的RAW图像,是逆向图像信号处理(ISP)的过程。现有方法通常采用直接回归的方式,但由于逆ISP的病态性以及RGB图像量化带来的信息损失,导致重建的RAW图像在细节和颜色上存在偏差,难以达到高保真效果。

核心思路:RAW-Flow的核心思路是将RGB到RAW的重建问题转化为一个确定性的隐空间传输问题。通过学习一个隐空间中的向量场,将RGB图像的隐表示平滑地映射到对应的RAW图像的隐表示。这种方法避免了直接回归可能带来的不稳定性,并利用隐空间的连续性来更好地保留图像的细节和颜色信息。

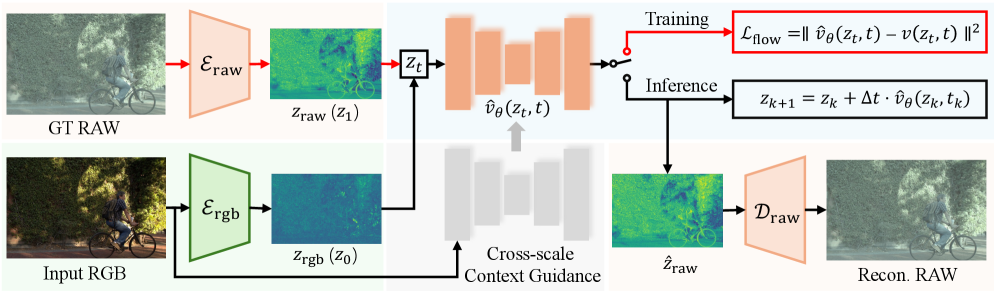

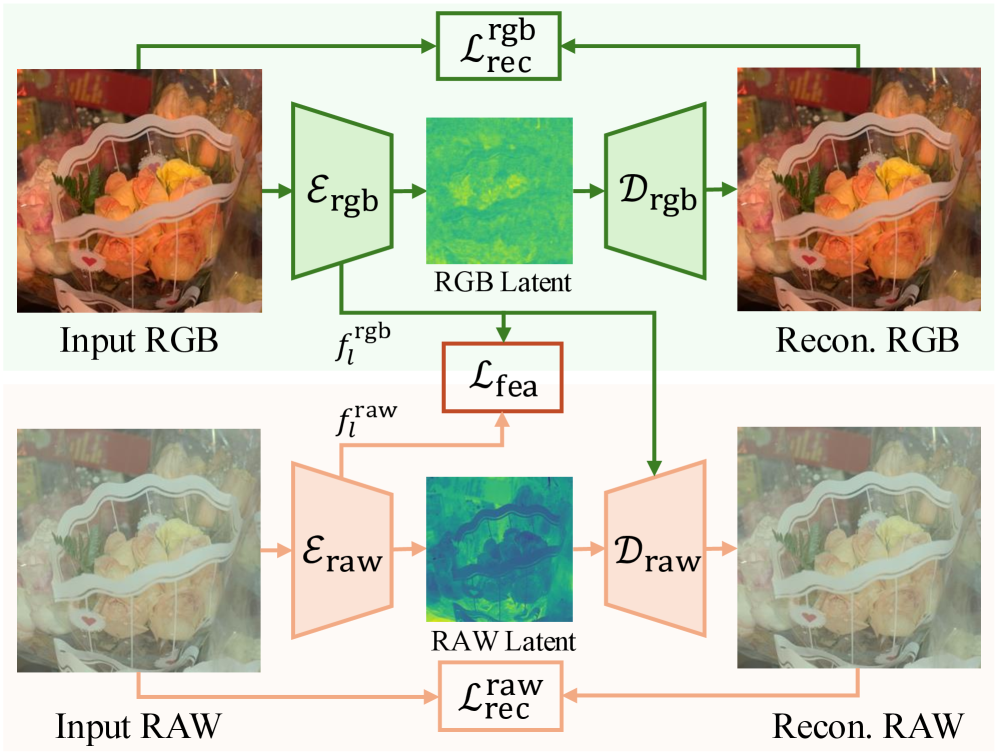

技术框架:RAW-Flow框架主要包含三个核心模块:双域隐空间自编码器、跨尺度上下文引导模块和流匹配模块。首先,双域隐空间自编码器用于将RGB和RAW图像分别编码到各自的隐空间,并施加特征对齐约束,使得两个隐空间具有相似的结构。然后,跨尺度上下文引导模块将RGB图像的多尺度特征注入到流估计过程中,以提供更丰富的上下文信息。最后,流匹配模块学习一个确定性的向量场,用于将RGB图像的隐表示传输到RAW图像的隐表示。

关键创新:RAW-Flow的关键创新在于将流匹配技术引入到RGB到RAW的重建任务中,并将其建模为一个确定性的隐空间传输问题。与传统的直接回归方法相比,这种方法能够更好地处理逆ISP的病态性,并利用隐空间的连续性来提高重建质量。此外,跨尺度上下文引导模块和双域隐空间自编码器的设计也进一步提升了重建效果。

关键设计:双域隐空间自编码器采用共享编码器结构,并使用L1损失和感知损失作为特征对齐约束。跨尺度上下文引导模块通过将RGB图像的多尺度特征concat到流估计网络的输入中,来提供更丰富的上下文信息。流匹配模块采用Conditional Flow Matching (CFM)损失函数来训练确定性向量场。具体而言,损失函数鼓励学习到的向量场能够将RGB图像的隐表示平滑地传输到RAW图像的隐表示。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RAW-Flow在多个公开数据集上均取得了优于现有最佳方法的性能。例如,在DPDD数据集上,RAW-Flow的PSNR指标比第二名提高了约0.5dB,SSIM指标提高了约0.01。此外,视觉效果也明显优于其他方法,重建的RAW图像具有更丰富的细节和更准确的颜色。

🎯 应用场景

RAW-Flow在图像处理和计算机视觉领域具有广泛的应用前景。它可以用于提高低光照条件下的图像质量,改善图像编辑和增强的效果,以及为下游任务(如图像识别和目标检测)提供更高质量的输入数据。此外,该方法还可以应用于相机ISP的优化和设计,以及图像传感器的研发。

📄 摘要(原文)

RGB-to-RAW reconstruction, or the reverse modeling of a camera Image Signal Processing (ISP) pipeline, aims to recover high-fidelity RAW data from RGB images. Despite notable progress, existing learning-based methods typically treat this task as a direct regression objective and struggle with detail inconsistency and color deviation, due to the ill-posed nature of inverse ISP and the inherent information loss in quantized RGB images. To address these limitations, we pioneer a generative perspective by reformulating RGB-to-RAW reconstruction as a deterministic latent transport problem and introduce a novel framework named RAW-Flow, which leverages flow matching to learn a deterministic vector field in latent space, to effectively bridge the gap between RGB and RAW representations and enable accurate reconstruction of structural details and color information. To further enhance latent transport, we introduce a cross-scale context guidance module that injects hierarchical RGB features into the flow estimation process. Moreover, we design a dual-domain latent autoencoder with a feature alignment constraint to support the proposed latent transport framework, which jointly encodes RGB and RAW inputs while promoting stable training and high-fidelity reconstruction. Extensive experiments demonstrate that RAW-Flow outperforms state-of-the-art approaches both quantitatively and visually.