WaterClear-GS: Optical-Aware Gaussian Splatting for Underwater Reconstruction and Restoration

作者: Xinrui Zhang, Yufeng Wang, Shuangkang Fang, Zesheng Wang, Dacheng Qi, Wenrui Ding

分类: cs.CV

发布日期: 2026-01-27

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

WaterClear-GS:基于光衰减和散射的水下高斯溅射重建与复原

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 水下三维重建 高斯溅射 神经辐射场 水下图像复原 光衰减 光散射 实时渲染 光学建模

📋 核心要点

- 水下三维重建面临水体复杂光学特性带来的挑战,传统NeRF方法速度慢且颜色复原差,3DGS缺乏对体散射建模的能力。

- WaterClear-GS将水下光衰减和散射特性融入3DGS基元,无需额外网络,并通过双分支优化策略恢复水下光度一致性和无水外观。

- 实验结果表明,WaterClear-GS在视角合成和水下图像复原任务上表现出色,实现了实时渲染,并在新数据集上验证了有效性。

📝 摘要(中文)

水下三维重建和外观复原受到水体复杂光学特性的阻碍,例如波长相关的衰减和散射。现有的基于神经辐射场(NeRF)的方法渲染速度慢,颜色复原效果欠佳,而3D高斯溅射(3DGS)本质上缺乏对复杂体散射效应建模的能力。为了解决这些问题,我们提出了WaterClear-GS,这是第一个纯粹基于3DGS的框架,它将水下局部衰减和散射的光学特性显式地集成到高斯基元中,无需辅助介质网络。我们的方法采用双分支优化策略,以确保水下光度一致性,同时自然地恢复无水外观。该策略通过深度引导的几何正则化和感知驱动的图像损失来增强,并结合曝光约束、空间自适应正则化和物理引导的光谱正则化,共同强制执行局部3D一致性并保持自然的视觉感知。在标准基准和我们新收集的数据集上的实验表明,WaterClear-GS在新的视角合成(NVS)和水下图像复原(UIR)任务上都取得了出色的性能,同时保持了实时渲染。

🔬 方法详解

问题定义:水下三维重建和图像复原受到水体复杂光学特性的严重影响,例如波长相关的光线衰减和散射。现有的NeRF方法计算复杂度高,渲染速度慢,并且颜色复原效果不佳。而3DGS虽然渲染速度快,但缺乏对水下复杂体散射效应的建模能力,难以直接应用于水下场景。

核心思路:WaterClear-GS的核心思路是将水下光学的衰减和散射特性直接融入到3DGS的基元中,从而在保持3DGS快速渲染优势的同时,能够显式地建模水下光线传播过程。通过这种方式,避免了使用额外的网络来建模介质,简化了模型结构,并提高了效率。

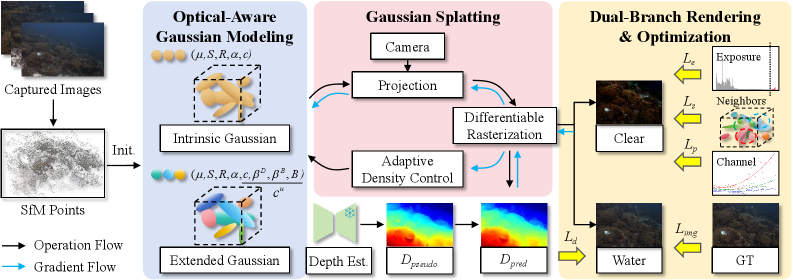

技术框架:WaterClear-GS框架主要包含以下几个部分:首先,将水下光衰减和散射参数集成到3DGS基元中。其次,采用双分支优化策略,一个分支用于优化水下场景的光度一致性,另一个分支用于恢复无水场景的外观。此外,还引入了深度引导的几何正则化、感知驱动的图像损失、曝光约束、空间自适应正则化和物理引导的光谱正则化,以提高重建质量和视觉效果。

关键创新:WaterClear-GS的关键创新在于它是第一个纯粹基于3DGS的框架,能够显式地将水下光学特性(衰减和散射)集成到高斯基元中。与现有方法相比,它无需额外的介质网络,简化了模型结构,并提高了渲染速度和重建质量。此外,双分支优化策略和各种正则化项的引入,进一步提升了水下场景重建和图像复原的效果。

关键设计:WaterClear-GS的关键设计包括:1) 将衰减系数和散射系数作为可学习参数嵌入到高斯基元中;2) 设计双分支优化策略,分别优化水下和无水场景;3) 引入深度引导的几何正则化,利用深度信息约束高斯基元的形状和位置;4) 使用感知驱动的图像损失,例如LPIPS损失,以提高视觉感知质量;5) 采用物理引导的光谱正则化,约束衰减和散射系数的光谱分布,使其符合物理规律。

🖼️ 关键图片

📊 实验亮点

WaterClear-GS在合成数据集和真实数据集上都取得了显著的性能提升。在新的视角合成任务中,相比于现有方法,WaterClear-GS在PSNR、SSIM和LPIPS等指标上均有明显提升。此外,WaterClear-GS还实现了实时渲染,能够在保证重建质量的同时,满足实时应用的需求。新收集的数据集也为水下三维重建和图像复原领域的研究提供了宝贵资源。

🎯 应用场景

WaterClear-GS在水下机器人导航、水下考古、海洋生物研究、水下环境监测等领域具有广泛的应用前景。该方法能够实现高质量的水下三维重建和图像复原,有助于提高水下视觉系统的性能,为相关领域的科学研究和工程应用提供有力支持。未来,该技术有望应用于更复杂的水下环境,并与其他传感器融合,实现更精确的水下感知。

📄 摘要(原文)

Underwater 3D reconstruction and appearance restoration are hindered by the complex optical properties of water, such as wavelength-dependent attenuation and scattering. Existing Neural Radiance Fields (NeRF)-based methods struggle with slow rendering speeds and suboptimal color restoration, while 3D Gaussian Splatting (3DGS) inherently lacks the capability to model complex volumetric scattering effects. To address these issues, we introduce WaterClear-GS, the first pure 3DGS-based framework that explicitly integrates underwater optical properties of local attenuation and scattering into Gaussian primitives, eliminating the need for an auxiliary medium network. Our method employs a dual-branch optimization strategy to ensure underwater photometric consistency while naturally recovering water-free appearances. This strategy is enhanced by depth-guided geometry regularization and perception-driven image loss, together with exposure constraints, spatially-adaptive regularization, and physically guided spectral regularization, which collectively enforce local 3D coherence and maintain natural visual perception. Experiments on standard benchmarks and our newly collected dataset demonstrate that WaterClear-GS achieves outstanding performance on both novel view synthesis (NVS) and underwater image restoration (UIR) tasks, while maintaining real-time rendering. The code will be available at https://buaaxrzhang.github.io/WaterClear-GS/.