QuaMo: Quaternion Motions for Vision-based 3D Human Kinematics Capture

作者: Cuong Le, Pavlo Melnyk, Urs Waldmann, Mårten Wadenbäck, Bastian Wandt

分类: cs.CV

发布日期: 2026-01-27

备注: 10 pages, 4 figures, accepted to ICLR 2026

🔗 代码/项目: GITHUB

💡 一句话要点

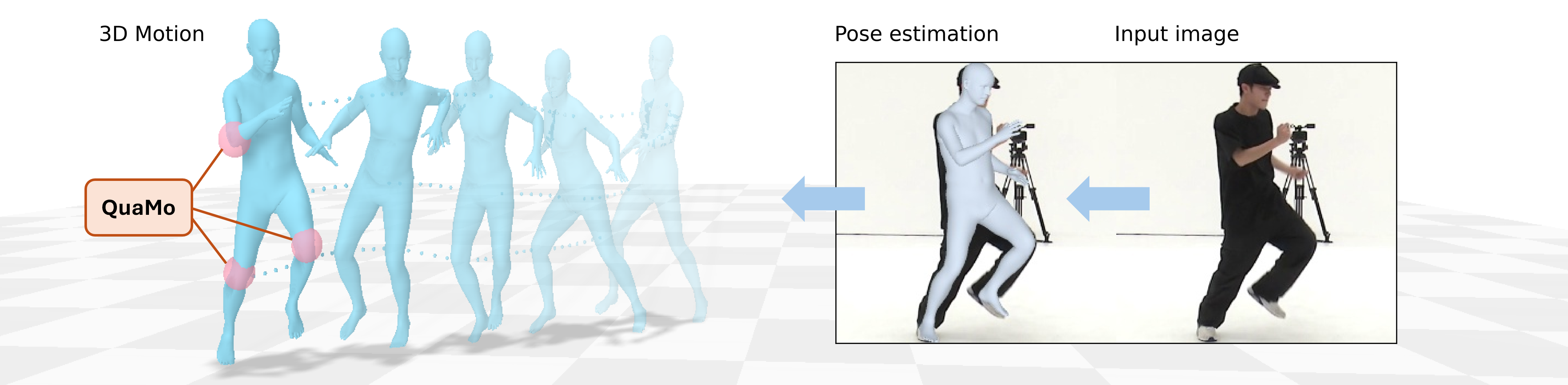

QuaMo:利用四元数运动学捕获视觉三维人体运动,解决欧拉角不连续问题。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 三维人体运动捕获 四元数 运动学 状态空间模型 四元数微分方程 视觉 姿态估计

📋 核心要点

- 传统三维姿态估计忽略时间一致性,导致运动抖动;基于运动学的方法依赖欧拉角,存在不连续性问题。

- QuaMo利用四元数微分方程(QDE)和状态空间模型,在四元数单位球约束下求解,保证运动的连续性。

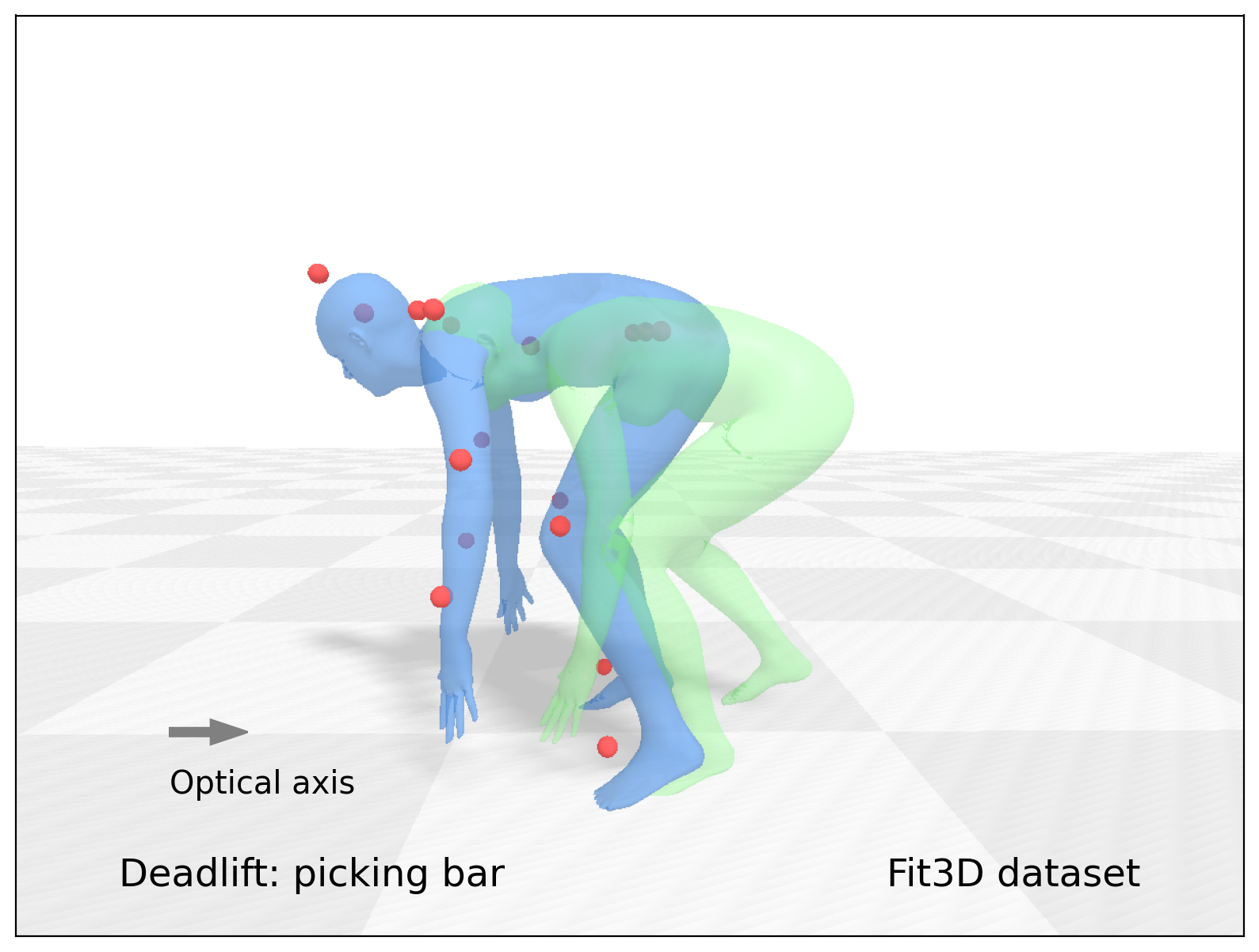

- 实验表明,QuaMo在Human3.6M等多个数据集上优于现有方法,能更准确地估计三维人体运动学。

📝 摘要(中文)

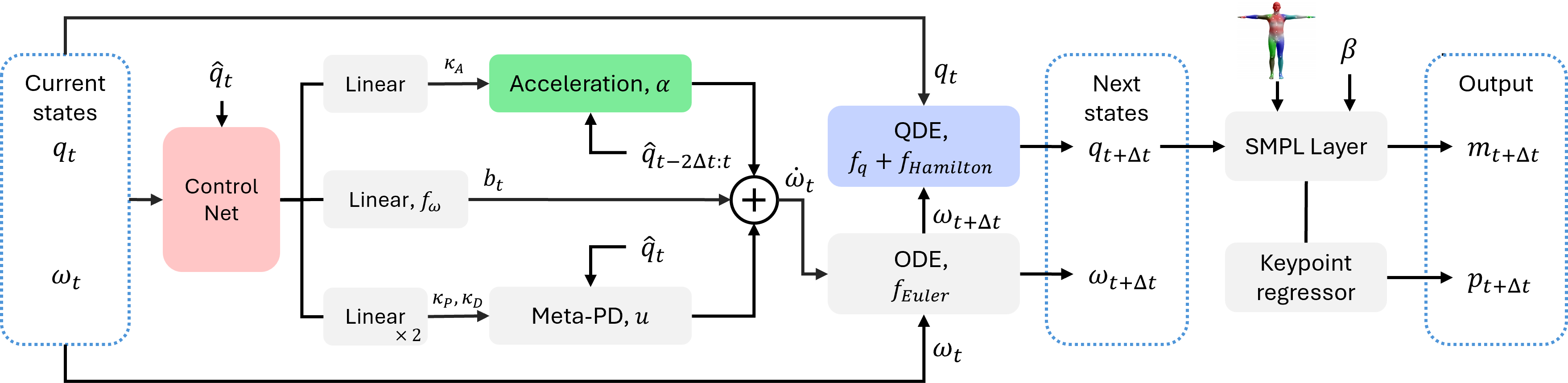

本文提出了一种新的基于视觉的三维人体运动捕获方法QuaMo,该方法利用四元数微分方程(QDE)进行人体运动学捕获。传统的3D姿态估计方法通常忽略帧之间的时间一致性,导致运动不真实且抖动。新兴的基于运动学的3D运动捕获通过估计姿势之间的过渡来解决这些问题。当前运动学方法的一个主要缺点是它们依赖于欧拉角。尽管欧拉角很简单,但它们存在不连续性,导致不稳定的运动重建,尤其是在无法进行轨迹细化的在线设置中。相反,四元数没有不连续性,可以产生姿势之间的连续过渡。QuaMo使用状态空间模型,这是一个描述实时运动学估计的有效系统,其中包含四元数状态和描述四元数速度的QDE。相应的角加速度由元PD控制器计算,该控制器具有新颖的加速度增强功能,可自适应地调节控制信号,因为人会快速更改为新姿势。与先前的工作不同,我们的QDE在四元数单位球约束下求解,从而产生更准确的估计。实验结果表明,我们新颖的QDE公式与加速度增强功能可以准确地估计3D人体运动学,而没有不连续性和最小的不真实性。QuaMo在多个数据集(即Human3.6M,Fit3D,SportsPose和AIST)上均优于可比的最新方法。代码可在https://github.com/cuongle1206/QuaMo获得。

🔬 方法详解

问题定义:现有基于视觉的三维人体运动捕获方法,特别是基于运动学的方法,通常依赖于欧拉角表示旋转。欧拉角存在固有的不连续性(例如万向锁),这会导致运动重建过程中出现不稳定的抖动,尤其是在需要实时性能且无法进行后处理优化的在线场景中。因此,需要一种更稳定、连续的旋转表示方法来提高运动捕获的质量。

核心思路:QuaMo的核心思路是使用四元数来表示人体骨骼的旋转,并利用四元数微分方程(QDE)来描述姿势之间的时间演化。四元数具有无奇点、连续的特性,能够避免欧拉角带来的不稳定性。通过在状态空间模型中结合四元数状态和QDE,可以实现对人体运动学参数的实时估计。

技术框架:QuaMo方法基于状态空间模型,该模型包含以下几个主要组成部分:1) 四元数状态:表示人体骨骼的旋转姿态。2) 四元数微分方程(QDE):描述四元数状态随时间的变化,即四元数速度。3) 元PD控制器:用于计算角加速度,该加速度驱动四元数状态向目标姿态演化。4) 加速度增强模块:自适应地调节控制信号,以应对人体快速的姿态变化。整体流程为:输入视频帧,提取人体姿态信息,利用状态空间模型和QDE估计四元数状态,通过元PD控制器和加速度增强模块计算角加速度,更新四元数状态,最终得到连续、稳定的三维人体运动轨迹。

关键创新:QuaMo的关键创新在于以下几点:1) 使用四元数微分方程(QDE)来描述人体运动学,避免了欧拉角的不连续性问题。2) 在四元数单位球约束下求解QDE,提高了估计的准确性。3) 提出了一个新颖的加速度增强模块,能够自适应地调节控制信号,以应对快速的姿态变化。与现有方法相比,QuaMo能够生成更稳定、更真实的运动轨迹。

关键设计:QuaMo的关键设计包括:1) 四元数微分方程的具体形式,需要根据人体运动学的特点进行设计。2) 元PD控制器的参数设置,需要根据实验数据进行调整,以获得最佳的控制效果。3) 加速度增强模块的自适应调节策略,需要根据姿态变化的快慢进行调整。4) 损失函数的设计,需要综合考虑姿态估计的准确性和运动轨迹的平滑性。

🖼️ 关键图片

📊 实验亮点

QuaMo在Human3.6M、Fit3D、SportsPose和AIST等多个数据集上进行了评估,实验结果表明,QuaMo在运动估计的准确性和稳定性方面均优于现有方法。具体来说,QuaMo能够生成更平滑、更真实的运动轨迹,减少了运动抖动和不连续性。在定量指标上,QuaMo在多个数据集上取得了state-of-the-art的结果,证明了其有效性。

🎯 应用场景

QuaMo在虚拟现实、增强现实、游戏开发、动画制作、运动分析、康复训练等领域具有广泛的应用前景。它可以用于创建更逼真、更自然的虚拟角色动画,提高用户在VR/AR环境中的沉浸感。此外,QuaMo还可以用于分析运动员的运动姿态,评估康复患者的运动能力,为相关领域的研究和应用提供技术支持。

📄 摘要(原文)

Vision-based 3D human motion capture from videos remains a challenge in computer vision. Traditional 3D pose estimation approaches often ignore the temporal consistency between frames, causing implausible and jittery motion. The emerging field of kinematics-based 3D motion capture addresses these issues by estimating the temporal transitioning between poses instead. A major drawback in current kinematics approaches is their reliance on Euler angles. Despite their simplicity, Euler angles suffer from discontinuity that leads to unstable motion reconstructions, especially in online settings where trajectory refinement is unavailable. Contrarily, quaternions have no discontinuity and can produce continuous transitions between poses. In this paper, we propose QuaMo, a novel Quaternion Motions method using quaternion differential equations (QDE) for human kinematics capture. We utilize the state-space model, an effective system for describing real-time kinematics estimations, with quaternion state and the QDE describing quaternion velocity. The corresponding angular acceleration is computed from a meta-PD controller with a novel acceleration enhancement that adaptively regulates the control signals as the human quickly changes to a new pose. Unlike previous work, our QDE is solved under the quaternion unit-sphere constraint that results in more accurate estimations. Experimental results show that our novel formulation of the QDE with acceleration enhancement accurately estimates 3D human kinematics with no discontinuity and minimal implausibilities. QuaMo outperforms comparable state-of-the-art methods on multiple datasets, namely Human3.6M, Fit3D, SportsPose and AIST. The code is available at https://github.com/cuongle1206/QuaMo