Fast Converging 3D Gaussian Splatting for 1-Minute Reconstruction

作者: Ziyu Zhang, Tianle Liu, Diantao Tu, Shuhan Shen

分类: cs.CV

发布日期: 2026-01-27

备注: First Rank of SIGGRAPH Asia 2025 3DGS Challenge. Code available at

💡 一句话要点

提出快速收敛的3D高斯溅射重建方法,实现1分钟内重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 快速重建 神经渲染 SLAM COLMAP 多视图一致性 深度估计

📋 核心要点

- 现有3DGS重建方法在处理噪声轨迹和计算资源受限的情况下,难以实现快速高保真重建。

- 该论文提出一种两阶段方案,结合神经高斯表示、多视图一致性引导的高斯分裂等技术,加速收敛并提高重建质量。

- 实验结果表明,该方法在1分钟内实现了高保真重建,并在SIGGRAPH Asia 3DGS快速重建挑战赛中获得第一名,PSNR达到28.43。

📝 摘要(中文)

本文提出了一种快速的3D高斯溅射(3DGS)重建流程,旨在1分钟内收敛,专为SIGGRAPH Asia 3DGS快速重建挑战赛而设计。该挑战赛包括一个使用SLAM生成的相机姿态(具有噪声轨迹)的初始轮次和一个使用COLMAP姿态(高度准确)的最终轮次。为了稳健地处理这些异构设置,我们开发了一个两阶段解决方案。在第一轮中,我们使用基于Taming-GS和Speedy-splat的反向高斯并行优化和紧凑前向溅射、负载均衡平铺、基于锚点的神经高斯表示(能够以更少的学习参数实现快速收敛)、从单目深度和部分前馈3DGS模型初始化,以及用于噪声SLAM轨迹的全局姿态细化模块。在最终轮次中,精确的COLMAP姿态改变了优化格局;我们禁用姿态细化,从神经高斯恢复到标准3DGS以消除MLP推理开销,引入受Fast-GS启发的、多视图一致性引导的高斯分裂,并引入深度估计器来监督渲染的深度。总之,这些技术能够在严格的一分钟预算下实现高保真重建。我们的方法取得了最佳性能,PSNR为28.43,并在比赛中名列第一。

🔬 方法详解

问题定义:论文旨在解决在计算资源和时间受限的情况下,如何快速且高质量地重建3D场景的问题。现有的3DGS方法在处理SLAM等方法产生的带有噪声的相机轨迹时,收敛速度慢,重建质量不高,难以满足快速重建的需求。

核心思路:论文的核心思路是针对不同精度的相机姿态,采用不同的优化策略。对于噪声较大的SLAM姿态,采用基于神经高斯表示的快速收敛方法和全局姿态优化;对于精确的COLMAP姿态,则采用多视图一致性引导的高斯分裂和深度监督,以提高重建质量。通过分阶段优化,充分利用不同姿态信息的优势,实现快速高保真重建。

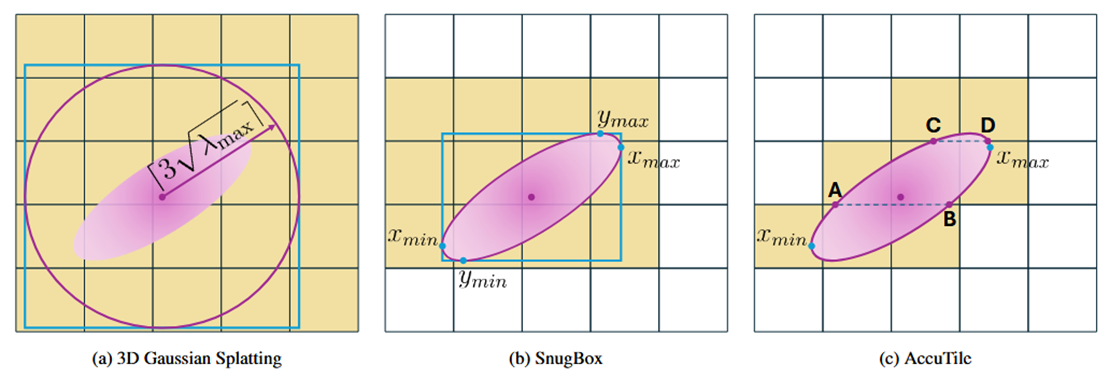

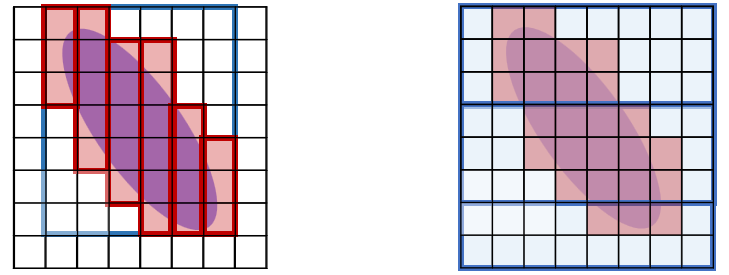

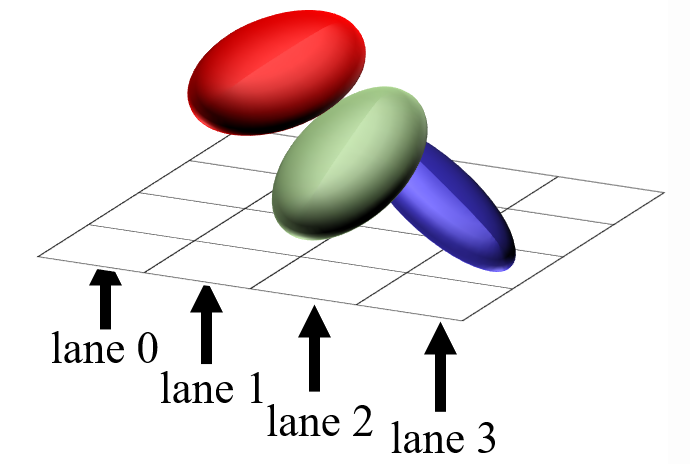

技术框架:该方法采用两阶段重建流程。第一阶段,针对SLAM生成的噪声相机姿态,使用反向高斯并行优化、紧凑前向溅射、负载均衡平铺、基于锚点的神经高斯表示和全局姿态细化。第二阶段,针对COLMAP生成的精确相机姿态,禁用姿态细化,恢复到标准3DGS,引入多视图一致性引导的高斯分裂和深度估计器。

关键创新:该方法的主要创新点在于:1) 提出了一种基于锚点的神经高斯表示,能够以更少的学习参数实现快速收敛;2) 针对精确的COLMAP姿态,引入了多视图一致性引导的高斯分裂,提高了重建质量;3) 针对不同精度的相机姿态,设计了不同的优化策略,提高了重建的鲁棒性和效率。

关键设计:在第一阶段,使用MLP来预测高斯参数的偏移量,从而减少了需要学习的参数数量。在第二阶段,使用深度估计器来监督渲染的深度,从而提高了重建的几何精度。此外,还采用了负载均衡平铺技术,以提高并行优化的效率。

🖼️ 关键图片

📊 实验亮点

该方法在SIGGRAPH Asia 3DGS快速重建挑战赛中取得了最佳性能,PSNR达到了28.43,并在比赛中排名第一。实验结果表明,该方法能够在1分钟内实现高保真重建,显著优于现有的3DGS重建方法。该方法在快速重建速度和重建质量之间取得了良好的平衡。

🎯 应用场景

该研究成果可应用于快速三维场景重建、增强现实、虚拟现实、机器人导航等领域。例如,在AR/VR应用中,可以快速重建用户周围的环境,提供更逼真的沉浸式体验。在机器人导航中,可以快速构建环境地图,帮助机器人进行路径规划和避障。

📄 摘要(原文)

We present a fast 3DGS reconstruction pipeline designed to converge within one minute, developed for the SIGGRAPH Asia 3DGS Fast Reconstruction Challenge. The challenge consists of an initial round using SLAM-generated camera poses (with noisy trajectories) and a final round using COLMAP poses (highly accurate). To robustly handle these heterogeneous settings, we develop a two-stage solution. In the first round, we use reverse per-Gaussian parallel optimization and compact forward splatting based on Taming-GS and Speedy-splat, load-balanced tiling, an anchor-based Neural-Gaussian representation enabling rapid convergence with fewer learnable parameters, initialization from monocular depth and partially from feed-forward 3DGS models, and a global pose refinement module for noisy SLAM trajectories. In the final round, the accurate COLMAP poses change the optimization landscape; we disable pose refinement, revert from Neural-Gaussians back to standard 3DGS to eliminate MLP inference overhead, introduce multi-view consistency-guided Gaussian splitting inspired by Fast-GS, and introduce a depth estimator to supervise the rendered depth. Together, these techniques enable high-fidelity reconstruction under a strict one-minute budget. Our method achieved the top performance with a PSNR of 28.43 and ranked first in the competition.