Towards Gold-Standard Depth Estimation for Tree Branches in UAV Forestry: Benchmarking Deep Stereo Matching Methods

作者: Yida Lin, Bing Xue, Mengjie Zhang, Sam Schofield, Richard Green

分类: cs.CV, cs.RO, eess.IV

发布日期: 2026-01-27

💡 一句话要点

针对无人机林业中树枝深度估计,提出基于深度立体匹配的基准测试方案。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 深度估计 立体匹配 无人机林业 零样本学习 基准测试

📋 核心要点

- 现有深度估计方法在城市和室内场景表现良好,但在植被密集环境下的泛化能力不足,缺乏针对林业场景的系统评估。

- 论文提出对多种深度立体匹配方法进行零样本评估,并在包含树枝图像的新数据集上进行测试,以寻找适用于林业场景的最佳方法。

- 实验结果表明,基础模型DEFOM在跨领域一致性方面表现出色,被认为是植被深度估计的黄金标准基线,可作为未来研究的伪真值。

📝 摘要(中文)

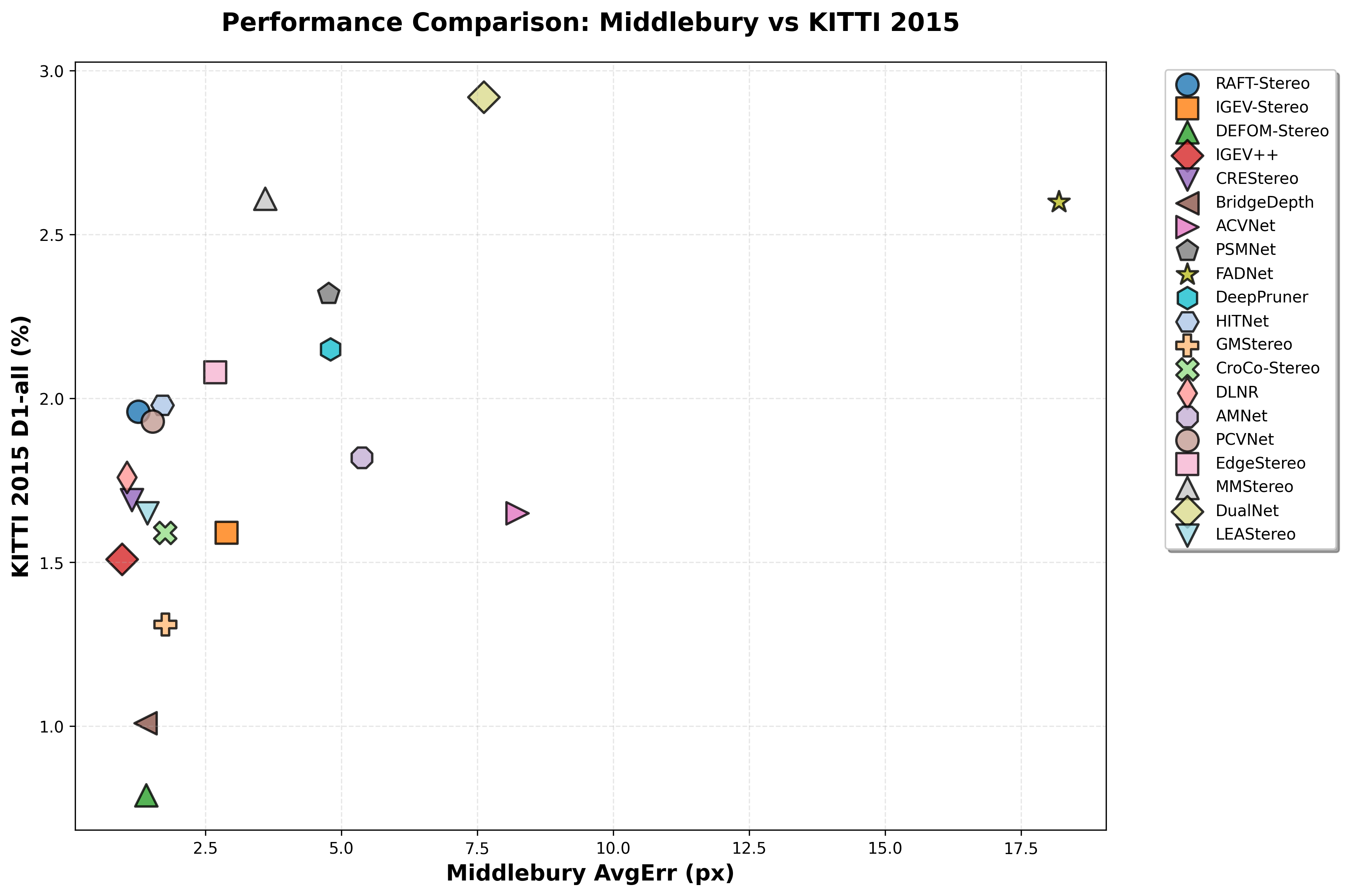

自主无人机林业作业需要强大的深度估计能力和跨领域泛化性,但现有评估主要集中在城市和室内场景,忽略了植被密集环境。本文首次对八种立体匹配方法进行了系统的零样本评估,涵盖迭代细化、基础模型、扩散模型和3D CNN等范式。所有方法均使用官方发布的预训练权重(在Scene Flow上训练),并在四个标准基准(ETH3D、KITTI 2012/2015、Middlebury)以及一个新的包含5313对图像的Canterbury Tree Branches数据集(1920×1080)上进行评估。结果表明存在场景依赖性:基础模型在结构化场景中表现出色(BridgeDepth在ETH3D上为0.23像素;DEFOM在Middlebury上为4.65像素),而迭代方法在不同基准上的表现各不相同(IGEV++在ETH3D上为0.36像素,但在Middlebury上为6.77像素;IGEV在ETH3D上为0.33像素,但在Middlebury上为4.99像素)。在树枝数据集上的定性评估表明,DEFOM是植被深度估计的黄金标准基线,具有卓越的跨领域一致性(在所有基准测试中始终排名第一或第二,平均排名1.75)。DEFOM的预测将作为未来基准测试的伪真值。

🔬 方法详解

问题定义:论文旨在解决无人机林业应用中,现有深度估计方法在植被密集场景下泛化能力差的问题。现有方法主要在城市或室内场景下训练和评估,缺乏针对树枝等复杂植被结构的有效深度估计能力,导致在林业应用中性能下降。

核心思路:论文的核心思路是通过对多种具有代表性的深度立体匹配方法进行零样本评估,即直接使用在通用数据集(如Scene Flow)上预训练的模型,在林业场景数据集上进行测试,从而评估其跨领域泛化能力。通过对比不同方法的性能,找到最适合林业场景的深度估计方法。

技术框架:论文的技术框架主要包括以下几个部分:1)选择具有代表性的深度立体匹配方法,包括迭代细化方法(如IGEV、IGEV++)、基础模型(如BridgeDepth)、扩散模型和3D CNN方法。2)构建包含树枝图像的新数据集(Canterbury Tree Branches dataset)。3)在四个标准基准数据集(ETH3D、KITTI 2012/2015、Middlebury)和新数据集上,对所有方法进行零样本评估。4)对比分析不同方法在不同数据集上的性能表现,并进行定性分析。

关键创新:论文的关键创新在于:1)首次针对无人机林业应用中的树枝深度估计问题,进行了系统的基准测试。2)构建了一个新的包含树枝图像的数据集,填补了现有数据集在林业场景方面的空白。3)通过零样本评估,揭示了不同深度立体匹配方法在跨领域泛化能力方面的差异,为林业应用选择合适的深度估计方法提供了指导。

关键设计:论文的关键设计包括:1)选择具有代表性的深度立体匹配方法,涵盖了不同的网络结构和训练策略。2)使用官方发布的预训练权重,保证了评估的公平性和可重复性。3)采用多种评估指标,包括像素误差和定性分析,全面评估方法的性能。4)将DEFOM的预测作为伪真值,为未来的研究提供了基准。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基础模型DEFOM在跨领域一致性方面表现最佳,在所有基准测试中始终排名第一或第二,平均排名1.75。在ETH3D数据集上,BridgeDepth取得了0.23像素的误差,在Middlebury数据集上,DEFOM取得了4.65像素的误差。这些结果表明,基础模型在结构化场景中具有较强的泛化能力,可以作为林业场景深度估计的有效方法。

🎯 应用场景

该研究成果可应用于自主无人机林业作业,例如树木生长监测、森林资源调查、病虫害防治等。通过准确估计树枝的深度信息,可以提高无人机在复杂林业环境中的导航和作业能力,降低人工成本,提高林业管理的效率和智能化水平。未来,该研究还可以扩展到其他植被类型和农业场景。

📄 摘要(原文)

Autonomous UAV forestry operations require robust depth estimation with strong cross-domain generalization, yet existing evaluations focus on urban and indoor scenarios, leaving a critical gap for vegetation-dense environments. We present the first systematic zero-shot evaluation of eight stereo methods spanning iterative refinement, foundation model, diffusion-based, and 3D CNN paradigms. All methods use officially released pretrained weights (trained on Scene Flow) and are evaluated on four standard benchmarks (ETH3D, KITTI 2012/2015, Middlebury) plus a novel 5,313-pair Canterbury Tree Branches dataset ($1920 \times 1080$). Results reveal scene-dependent patterns: foundation models excel on structured scenes (BridgeDepth: 0.23 px on ETH3D; DEFOM: 4.65 px on Middlebury), while iterative methods show variable cross-benchmark performance (IGEV++: 0.36 px on ETH3D but 6.77 px on Middlebury; IGEV: 0.33 px on ETH3D but 4.99 px on Middlebury). Qualitative evaluation on the Tree Branches dataset establishes DEFOM as the gold-standard baseline for vegetation depth estimation, with superior cross-domain consistency (consistently ranking 1st-2nd across benchmarks, average rank 1.75). DEFOM predictions will serve as pseudo-ground-truth for future benchmarking.