Reg-TTR, Test-Time Refinement for Fast, Robust and Accurate Image Registration

作者: Lin Chen, Yue He, Fengting Zhang, Yaonan Wang, Fengming Lin, Xiang Chen, Min Liu

分类: cs.CV

发布日期: 2026-01-27

💡 一句话要点

提出Reg-TTR,通过测试时优化提升图像配准模型的速度、鲁棒性和精度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像配准 深度学习 测试时优化 基础模型 互信息

📋 核心要点

- 现有图像配准方法在鲁棒性与速度上存在trade-off,深度学习方法在领域泛化性上存在挑战。

- Reg-TTR的核心思想是在测试时对预训练配准模型的预测结果进行优化,结合深度学习与传统方法的优势。

- 实验表明,Reg-TTR在保持较高推理速度的同时,显著提升了配准精度,达到了state-of-the-art的水平。

📝 摘要(中文)

传统图像配准方法虽然鲁棒,但由于其迭代特性速度较慢。深度学习加速了推理过程,但常常难以应对领域偏移。新兴的配准基础模型在速度和鲁棒性之间取得了平衡,但通常无法达到在特定数据集上训练的专用模型的峰值精度。为了缓解这一限制,我们提出了Reg-TTR,一个测试时优化框架,它协同了深度学习和传统配准技术的互补优势。通过在推理时优化预训练模型的预测,我们的方法以适度的计算成本显著提高了配准精度,仅需额外21%的推理时间(0.56秒)。我们在两个不同的任务上评估了Reg-TTR,结果表明它实现了最先进的(SOTA)性能,同时保持了接近先前深度学习方法的推理速度。随着基础模型的不断涌现,我们的框架提供了一种有效的策略,以缩小配准基础模型和在专用数据集上训练的SOTA方法之间的性能差距。源代码将在本文被接受后公开。

🔬 方法详解

问题定义:图像配准旨在寻找两幅图像之间的空间变换关系。传统迭代方法虽然鲁棒,但计算耗时。深度学习方法速度快,但泛化性差,难以适应领域偏移。配准基础模型试图平衡速度和鲁棒性,但精度仍有提升空间。

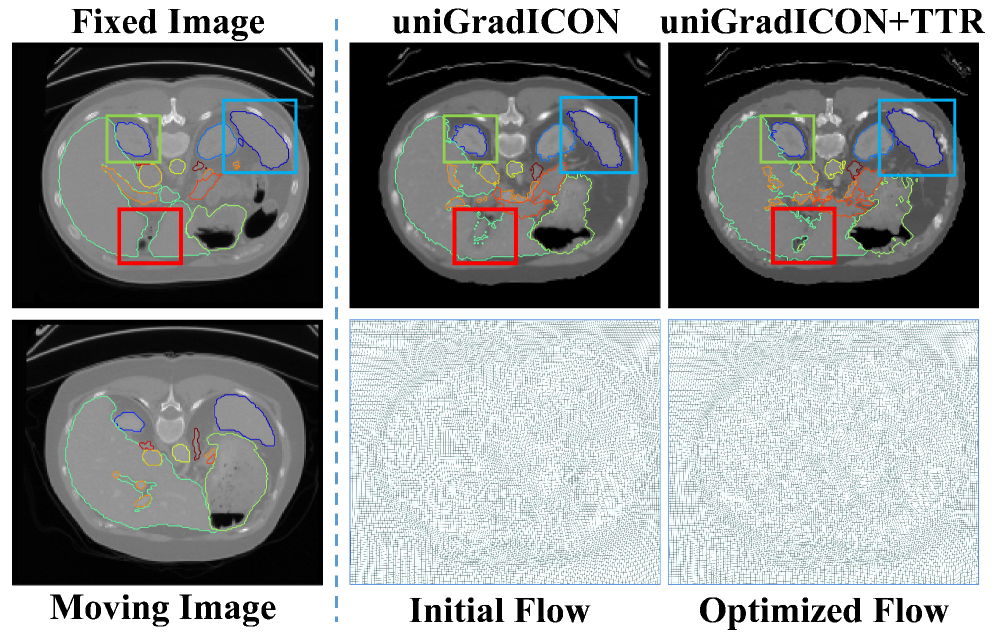

核心思路:Reg-TTR的核心在于利用预训练的深度学习模型提供快速的初始配准结果,然后通过传统优化方法在测试时对该结果进行微调。这种结合方式旨在利用深度学习的速度优势和传统方法的精度优势,从而实现快速、鲁棒和准确的配准。

技术框架:Reg-TTR框架包含两个主要阶段:1) 使用预训练的深度学习配准模型进行初始配准,得到初始变换参数。2) 在测试时,利用传统优化方法(例如,基于互信息的优化)对初始变换参数进行迭代优化,以提高配准精度。该优化过程以深度学习模型的输出作为初始值,并使用图像相似性度量作为优化目标。

关键创新:Reg-TTR的关键创新在于将深度学习的快速推理能力与传统优化方法的精确调整能力相结合。与完全依赖深度学习或传统方法相比,Reg-TTR能够在速度、鲁棒性和精度之间取得更好的平衡。此外,该方法是一种测试时优化策略,不需要额外的训练数据,可以直接应用于各种预训练的配准模型。

关键设计:Reg-TTR的关键设计包括:1) 选择合适的预训练深度学习配准模型作为初始配准器。2) 选择合适的图像相似性度量(例如,互信息、归一化互相关)作为优化目标。3) 设置合适的优化算法(例如,梯度下降、L-BFGS)和迭代次数,以在精度和计算成本之间取得平衡。4) 损失函数主要基于图像相似性度量,例如互信息,用于指导优化过程。

🖼️ 关键图片

📊 实验亮点

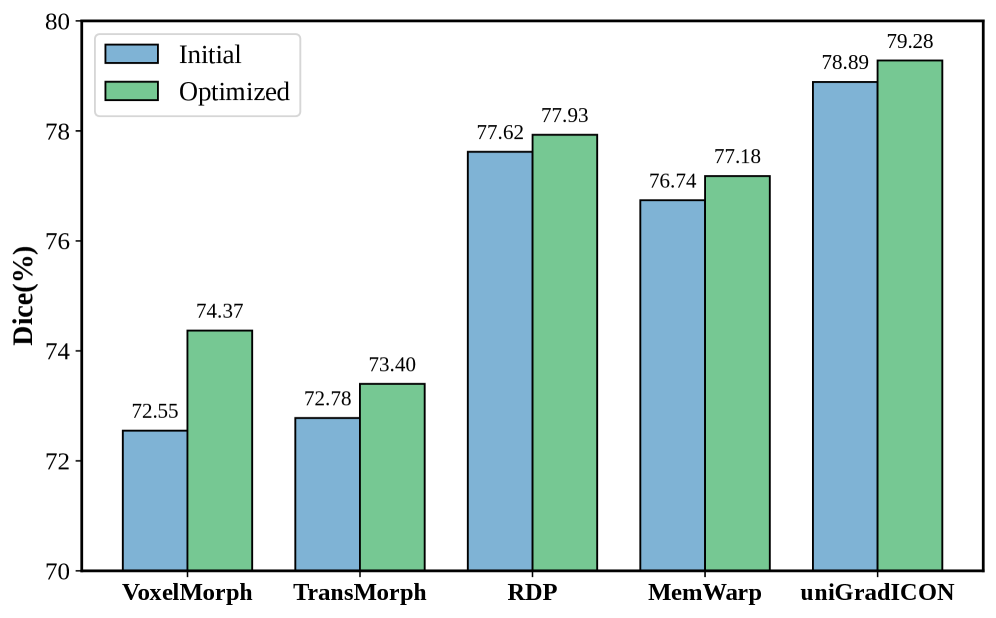

Reg-TTR在两个不同的图像配准任务上进行了评估,实验结果表明,该方法在保持接近深度学习方法推理速度的同时,显著提高了配准精度,达到了state-of-the-art的水平。具体而言,Reg-TTR仅需额外21%的推理时间(0.56秒),即可显著提升配准精度,缩小了配准基础模型与在特定数据集上训练的SOTA方法之间的性能差距。

🎯 应用场景

Reg-TTR具有广泛的应用前景,包括医学图像配准(例如,CT、MRI图像对齐)、遥感图像配准(例如,多时相卫星图像对齐)、计算机视觉中的图像拼接和目标跟踪等。该方法能够提高配准精度,从而改善下游任务的性能,例如疾病诊断、环境监测和自动驾驶。

📄 摘要(原文)

Traditional image registration methods are robust but slow due to their iterative nature. While deep learning has accelerated inference, it often struggles with domain shifts. Emerging registration foundation models offer a balance of speed and robustness, yet typically cannot match the peak accuracy of specialized models trained on specific datasets. To mitigate this limitation, we propose Reg-TTR, a test-time refinement framework that synergizes the complementary strengths of both deep learning and conventional registration techniques. By refining the predictions of pre-trained models at inference, our method delivers significantly improved registration accuracy at a modest computational cost, requiring only 21% additional inference time (0.56s). We evaluate Reg-TTR on two distinct tasks and show that it achieves state-of-the-art (SOTA) performance while maintaining inference speeds close to previous deep learning methods. As foundation models continue to emerge, our framework offers an efficient strategy to narrow the performance gap between registration foundation models and SOTA methods trained on specialized datasets. The source code will be publicly available following the acceptance of this work.