Incorporating Eye-Tracking Signals Into Multimodal Deep Visual Models For Predicting User Aesthetic Experience In Residential Interiors

作者: Chen-Ying Chien, Po-Chih Kuo

分类: cs.CV, cs.AI

发布日期: 2026-01-23

💡 一句话要点

提出融合眼动信号的双分支CNN-LSTM模型,用于预测住宅室内设计的美学体验

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 眼动追踪 多模态融合 CNN-LSTM 室内设计 美学评价

📋 核心要点

- 现有方法难以准确预测室内设计的美学体验,因为人类感知具有主观性和视觉反应的复杂性。

- 论文提出双分支CNN-LSTM框架,融合视觉特征和眼动信号,提升美学评价预测的准确性。

- 实验结果表明,该模型在客观和主观维度上均优于现有方法,且眼动信息训练的模型在仅使用视觉输入时仍保持良好性能。

📝 摘要(中文)

本研究旨在理解人们如何感知和评价室内空间,从而设计出提升幸福感的设计。由于感知的主观性和视觉反应的复杂性,预测美学体验仍然具有挑战。本研究提出了一种双分支CNN-LSTM框架,该框架融合了视觉特征和眼动信号,以预测住宅室内设计的美学评价。我们收集了一个包含224个室内设计视频的数据集,并同步记录了28名参与者对15个美学维度的评分和眼动数据。所提出的模型在客观维度(如光线)上达到了72.2%的准确率,在主观维度(如放松感)上达到了66.8%的准确率,优于最先进的视频基线,并在主观评价任务上表现出明显的提升。值得注意的是,使用眼动数据训练的模型在仅使用视觉输入进行部署时,仍能保持相当的性能。消融实验进一步表明,瞳孔反应对客观评估的贡献最大,而注视和视觉线索的结合增强了主观评估。这些发现突出了在训练过程中将眼动追踪作为特权信息纳入的价值,从而为室内设计中的美学评估提供更实用的工具。

🔬 方法详解

问题定义:论文旨在解决室内设计领域中,如何更准确地预测用户对室内空间的美学体验的问题。现有的方法主要依赖于视觉特征,忽略了用户的主观感知和注意力分配,导致预测结果与实际体验存在偏差。

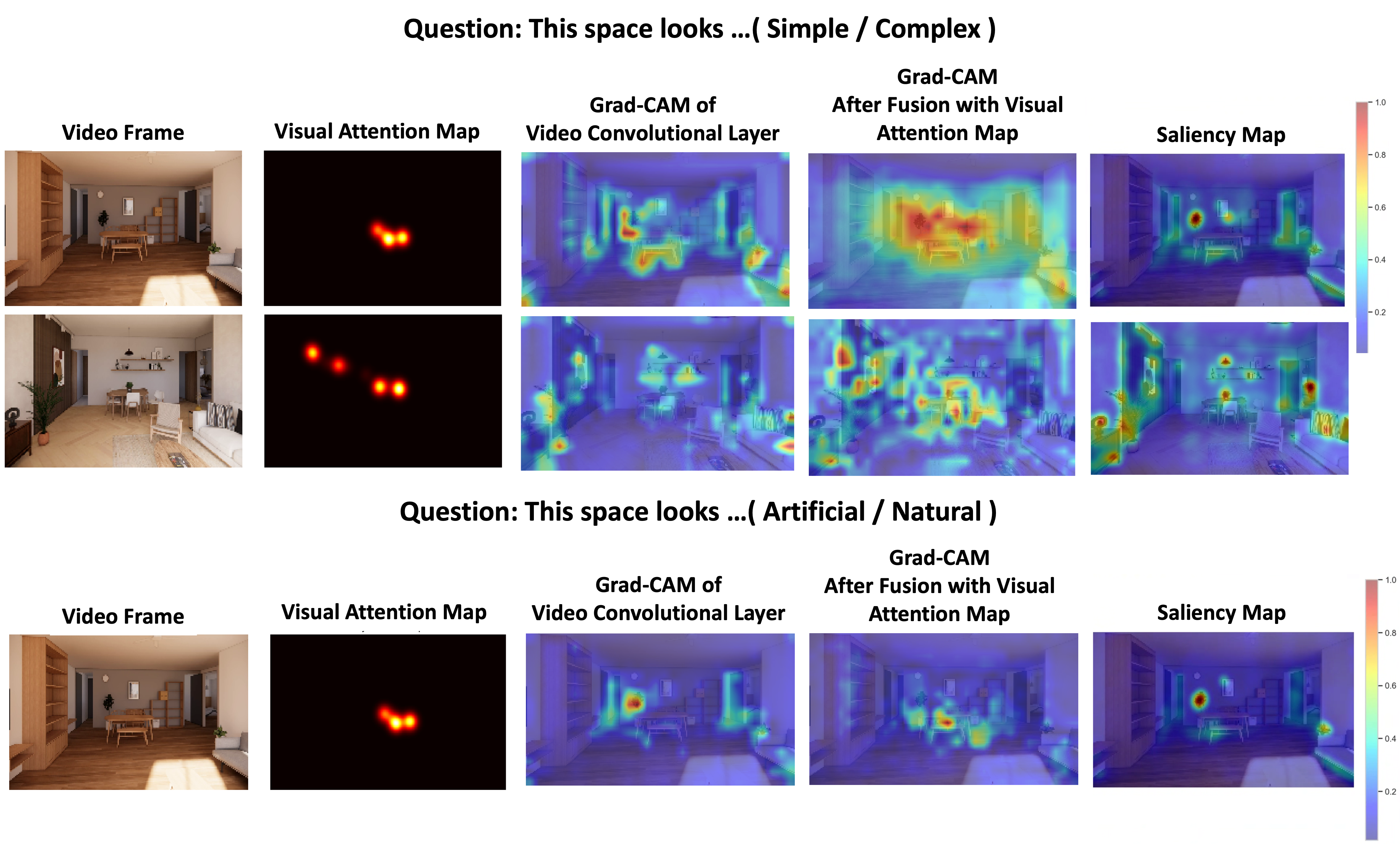

核心思路:论文的核心思路是将用户的眼动信号作为一种重要的补充信息,与视觉特征融合,从而更全面地捕捉用户对室内空间的主观感知。通过让模型学习眼动数据与美学评价之间的关系,提高预测的准确性和可靠性。

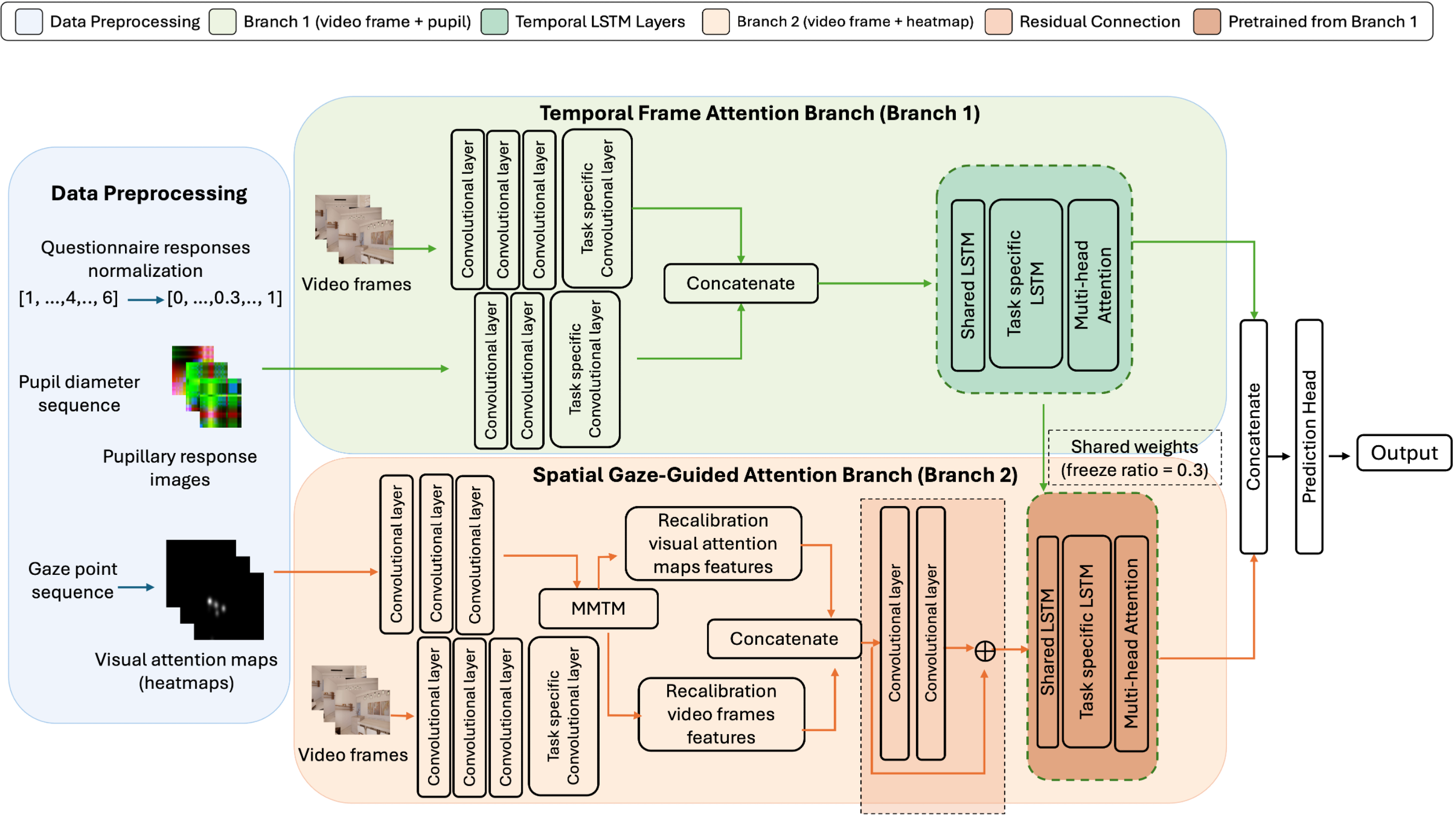

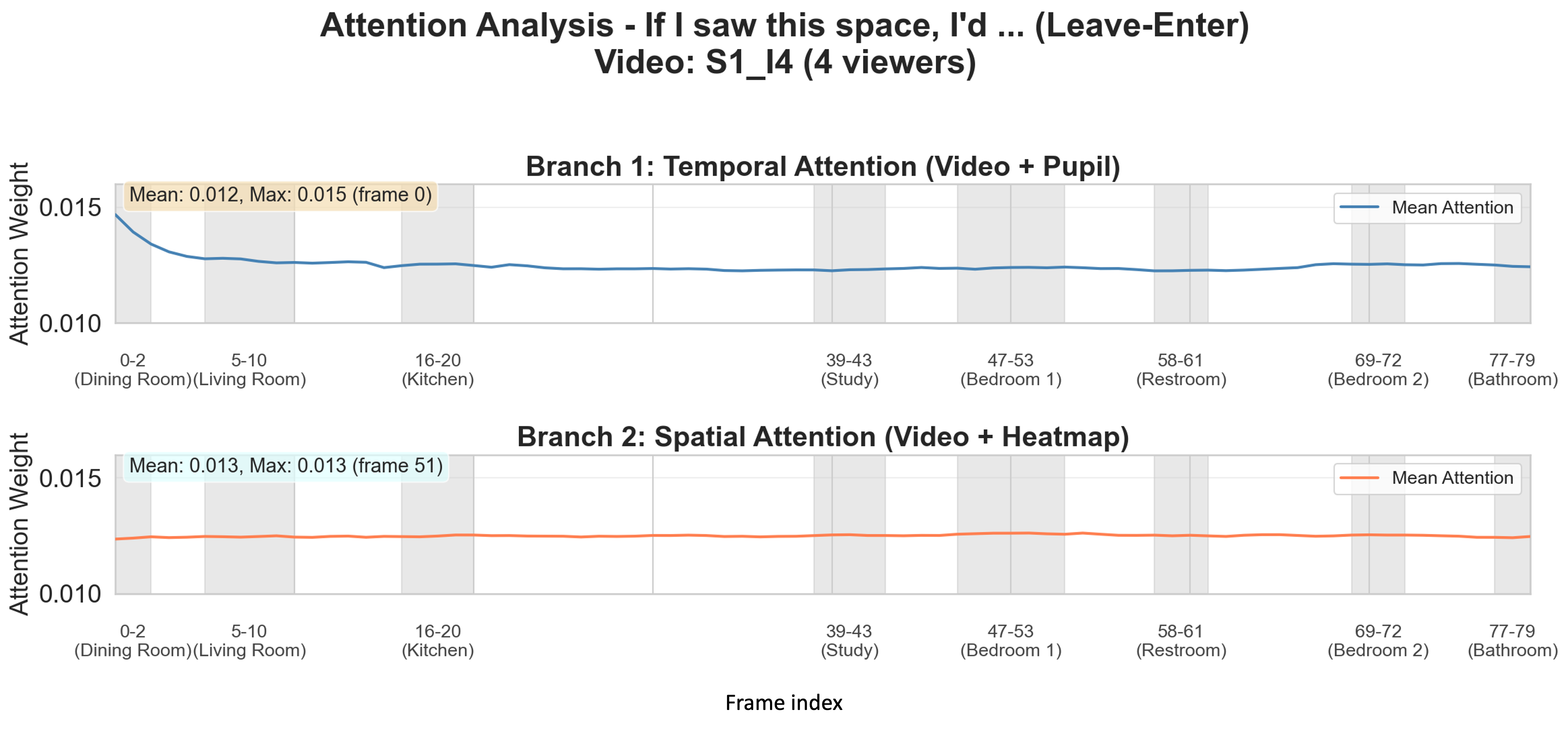

技术框架:该模型采用双分支CNN-LSTM框架。一个分支使用CNN提取视频的视觉特征,另一个分支使用LSTM处理眼动信号的时序信息。然后,将两个分支的特征进行融合,输入到全连接层进行美学评价的预测。整体流程包括数据收集与预处理、特征提取、特征融合和评价预测四个阶段。

关键创新:该研究的关键创新在于将眼动信号作为特权信息(privileged information)引入到模型训练中。即使在测试阶段没有眼动数据,模型也能利用训练阶段学到的眼动信息与视觉特征之间的关联,提升预测性能。这种方法可以有效解决实际应用中眼动数据难以获取的问题。

关键设计:在网络结构方面,CNN分支采用预训练的ResNet模型提取视觉特征,LSTM分支采用两层LSTM网络处理眼动信号。损失函数采用均方误差(MSE)损失函数,优化器采用Adam优化器。在数据预处理方面,对眼动数据进行了平滑处理和归一化处理。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该模型在客观维度(如光线)上达到了72.2%的准确率,在主观维度(如放松感)上达到了66.8%的准确率,显著优于state-of-the-art的视频基线模型。更重要的是,即使在测试阶段仅使用视觉输入,该模型仍能保持与使用眼动数据训练的模型相当的性能,证明了眼动信息作为特权信息的有效性。消融实验还表明,瞳孔反应对客观评估的贡献最大,而注视和视觉线索的结合增强了主观评估。

🎯 应用场景

该研究成果可应用于室内设计辅助工具的开发,帮助设计师更好地理解用户需求,设计出更符合用户审美和体验的室内空间。此外,该方法还可以扩展到其他视觉设计领域,如广告设计、产品设计等,为设计师提供更科学、更有效的决策支持。未来,该研究有望推动人机交互和情感计算的发展。

📄 摘要(原文)

Understanding how people perceive and evaluate interior spaces is essential for designing environments that promote well-being. However, predicting aesthetic experiences remains difficult due to the subjective nature of perception and the complexity of visual responses. This study introduces a dual-branch CNN-LSTM framework that fuses visual features with eye-tracking signals to predict aesthetic evaluations of residential interiors. We collected a dataset of 224 interior design videos paired with synchronized gaze data from 28 participants who rated 15 aesthetic dimensions. The proposed model attains 72.2% accuracy on objective dimensions (e.g., light) and 66.8% on subjective dimensions (e.g., relaxation), outperforming state-of-the-art video baselines and showing clear gains on subjective evaluation tasks. Notably, models trained with eye-tracking retain comparable performance when deployed with visual input alone. Ablation experiments further reveal that pupil responses contribute most to objective assessments, while the combination of gaze and visual cues enhances subjective evaluations. These findings highlight the value of incorporating eye-tracking as privileged information during training, enabling more practical tools for aesthetic assessment in interior design.