Edge-Aware Image Manipulation via Diffusion Models with a Novel Structure-Preservation Loss

作者: Minsu Gong, Nuri Ryu, Jungseul Ok, Sunghyun Cho

分类: cs.CV

发布日期: 2026-01-23

备注: Accepted to WACV 2026

🔗 代码/项目: GITHUB

💡 一句话要点

提出结构保持损失的扩散模型,用于边缘感知图像编辑

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 图像编辑 扩散模型 结构保持 局部线性模型 风格迁移

📋 核心要点

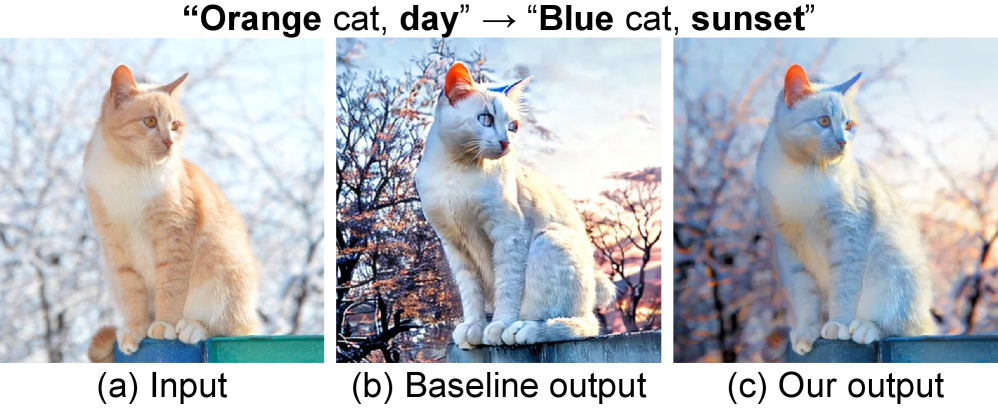

- 基于潜在扩散模型的图像编辑在保持像素级边缘结构方面存在挑战,尤其是在风格迁移等任务中。

- 提出一种新颖的结构保持损失(SPL),通过局部线性模型量化结构差异,直接集成到扩散模型生成过程。

- 实验表明,SPL能有效增强结构保真度,并在图像编辑任务中达到当前最佳性能。

📝 摘要(中文)

本文提出了一种基于潜在扩散模型(LDMs)的图像编辑方法,旨在解决现有方法在进行风格迁移或色调调整等任务时难以保持像素级边缘结构的问题。该方法引入了一种新颖的结构保持损失(SPL),利用局部线性模型来量化输入图像和编辑后图像之间的结构差异。该方法无需训练,直接将SPL集成到扩散模型的生成过程中,以确保结构保真度。此外,还包括一个后处理步骤来减轻LDM解码失真,一个用于精确定位编辑区域的掩蔽策略,以及一个用于保持未编辑区域色调的颜色保持损失。实验结果表明,SPL增强了结构保真度,并在基于潜在扩散的图像编辑中实现了最先进的性能。

🔬 方法详解

问题定义:现有的基于潜在扩散模型的图像编辑方法在进行图像风格迁移、色调调整等操作时,难以保持图像的像素级边缘结构。这导致编辑后的图像在结构上与原始图像存在偏差,影响了编辑质量和真实感。现有方法缺乏对图像局部结构信息的有效约束,容易产生结构失真。

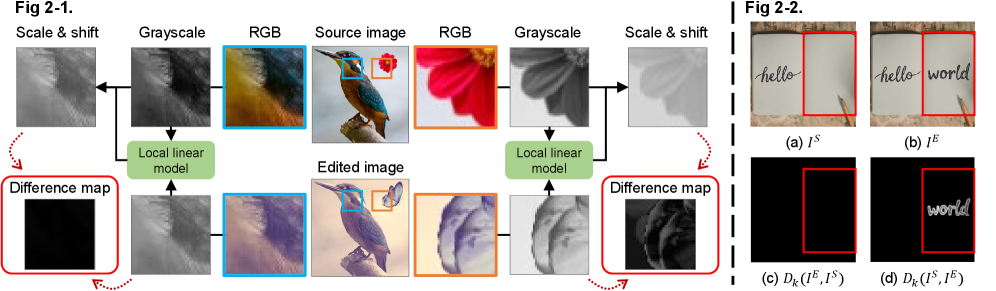

核心思路:本文的核心思路是通过引入结构保持损失(SPL)来约束扩散模型的生成过程,从而在编辑过程中保持图像的结构信息。SPL基于局部线性模型,能够有效地量化输入图像和编辑后图像之间的结构差异。通过最小化SPL,可以促使扩散模型生成在结构上与输入图像相似的编辑结果。

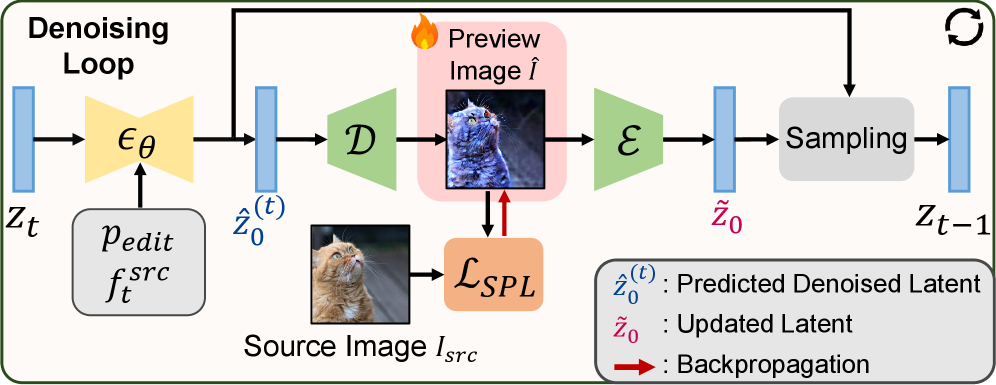

技术框架:该方法的技术框架主要包括以下几个部分:1) 基于潜在扩散模型的图像编辑流程;2) 结构保持损失(SPL)的计算模块;3) 后处理模块,用于减轻LDM解码失真;4) 掩蔽策略,用于精确定位编辑区域;5) 颜色保持损失,用于保持未编辑区域的色调。整体流程是,首先利用掩蔽策略确定编辑区域,然后通过扩散模型进行图像编辑,同时利用SPL约束生成过程,最后通过后处理模块和颜色保持损失进一步优化编辑结果。

关键创新:该方法最重要的技术创新点在于提出了结构保持损失(SPL)。与现有的损失函数不同,SPL基于局部线性模型,能够更准确地量化图像的局部结构信息。通过将SPL直接集成到扩散模型的生成过程中,可以有效地约束生成过程,从而在编辑过程中保持图像的结构信息。此外,该方法无需额外的训练,可以直接应用于现有的潜在扩散模型。

关键设计:SPL的关键设计在于利用局部线性模型来描述图像的局部结构。具体来说,对于图像中的每个像素,计算其周围邻域像素的线性组合,然后利用这些线性组合来表示该像素的结构信息。SPL定义为输入图像和编辑后图像之间局部线性模型系数的差异。此外,为了减轻LDM解码失真,采用了一个后处理步骤,该步骤基于图像的梯度信息,能够有效地去除伪影。颜色保持损失则采用L1损失,用于约束未编辑区域的颜色信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在结构保持方面优于现有的基于潜在扩散模型的图像编辑方法。通过定量评估,SPL能够显著降低编辑后图像的结构失真,并在视觉效果上产生更逼真的结果。与基线方法相比,该方法在结构相似性指标(SSIM)和峰值信噪比(PSNR)等指标上均有显著提升。

🎯 应用场景

该研究成果可广泛应用于图像编辑领域,例如照片增强、风格迁移、图像修复、图像着色等。通过保持图像的结构信息,可以提高编辑后图像的真实感和质量。该方法在艺术创作、视觉特效、以及工业设计等领域具有潜在的应用价值,并能提升相关产品的用户体验。

📄 摘要(原文)

Recent advances in image editing leverage latent diffusion models (LDMs) for versatile, text-prompt-driven edits across diverse tasks. Yet, maintaining pixel-level edge structures-crucial for tasks such as photorealistic style transfer or image tone adjustment-remains as a challenge for latent-diffusion-based editing. To overcome this limitation, we propose a novel Structure Preservation Loss (SPL) that leverages local linear models to quantify structural differences between input and edited images. Our training-free approach integrates SPL directly into the diffusion model's generative process to ensure structural fidelity. This core mechanism is complemented by a post-processing step to mitigate LDM decoding distortions, a masking strategy for precise edit localization, and a color preservation loss to preserve hues in unedited areas. Experiments confirm SPL enhances structural fidelity, delivering state-of-the-art performance in latent-diffusion-based image editing. Our code will be publicly released at https://github.com/gongms00/SPL.