AnchoredDream: Zero-Shot 360° Indoor Scene Generation from a Single View via Geometric Grounding

作者: Runmao Yao, Junsheng Zhou, Zhen Dong, Yu-Shen Liu

分类: cs.CV

发布日期: 2026-01-23

💡 一句话要点

AnchoredDream:基于几何约束的单视图零样本360°室内场景生成

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 360°场景生成 单视图重建 零样本学习 几何约束 扩散模型 室内场景理解 外观一致性 几何合理性

📋 核心要点

- 现有单视图360°场景生成方法难以在大视角变换下保持外观一致性和几何合理性,限制了全景生成效果。

- AnchoredDream通过外观-几何相互促进机制,将360°场景生成锚定在高保真几何上,提升生成质量。

- 实验表明,AnchoredDream在外观一致性和几何合理性方面显著优于现有方法,实现了零样本场景生成。

📝 摘要(中文)

单视图室内场景生成在现实世界应用中至关重要。然而,从单张图像生成完整的360°场景仍然是一个高度不适定且具有挑战性的问题。最近的方法利用扩散模型和深度估计网络取得了一些进展,但它们在大的视角变化下难以保持外观一致性和几何合理性,限制了其在全场景生成中的有效性。为了解决这个问题,我们提出了AnchoredDream,一种新颖的零样本流程,通过外观-几何相互促进机制将360°场景生成锚定在高保真几何上。给定单视图图像,我们的方法首先执行外观引导的几何生成,以构建可靠的3D场景布局。然后,我们通过一系列模块逐步生成完整的场景:warp-and-inpaint、warp-and-refine、后优化和一个新颖的Grouting Block,确保输入视图和生成区域之间的无缝过渡。大量实验表明,AnchoredDream在外观一致性和几何合理性方面都大大优于现有方法,并且是以零样本方式实现的。我们的结果突出了几何约束在高品质零样本单视图场景生成中的潜力。

🔬 方法详解

问题定义:论文旨在解决从单张图像生成完整360°室内场景的问题。现有方法,特别是基于扩散模型和深度估计的方法,在视角变化较大时,难以维持生成场景的外观一致性和几何合理性,导致全景生成效果不佳。

核心思路:AnchoredDream的核心思路是利用几何信息作为先验,引导场景生成过程。通过“外观-几何相互促进”的机制,首先生成可靠的3D场景布局,然后以此为基础逐步完善场景,从而保证生成场景的几何合理性和外观一致性。

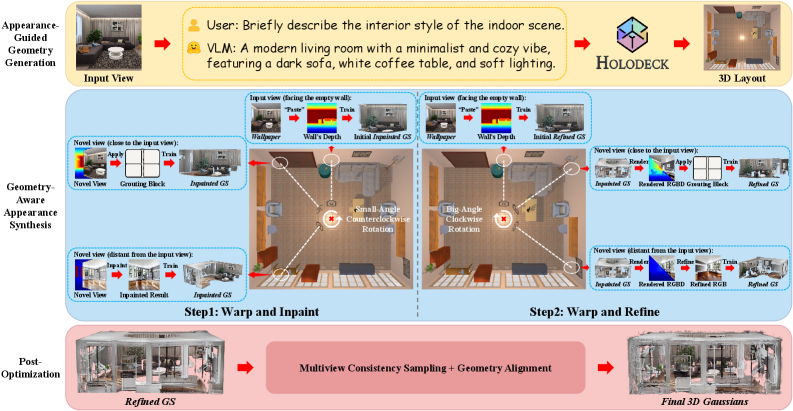

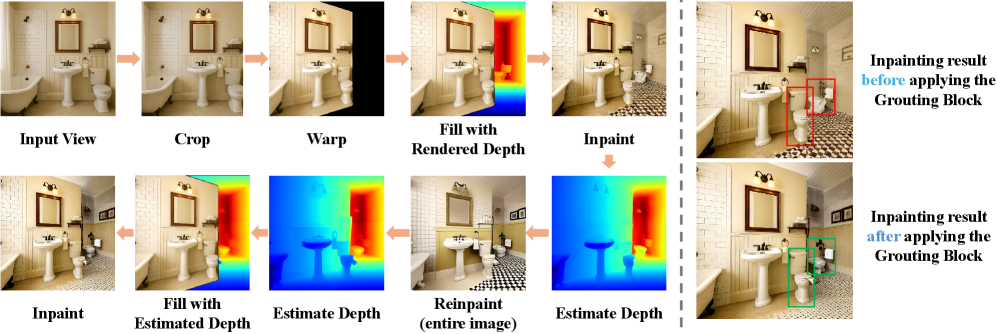

技术框架:AnchoredDream的整体流程包括以下几个主要模块:1) 外观引导的几何生成:从单视图图像生成初始的3D场景布局。2) warp-and-inpaint:对初始场景进行初步的补全。3) warp-and-refine:对补全后的场景进行精细化。4) 后优化:对场景进行优化,提升整体质量。5) Grouting Block:一个新颖的模块,用于确保输入视图和生成区域之间的无缝过渡。

关键创新:该方法最重要的创新点在于“外观-几何相互促进”的机制,即利用外观信息引导几何生成,再利用几何信息约束外观生成,从而实现高保真度的360°场景生成。Grouting Block也是一个重要的创新,它解决了不同视角下生成内容之间的不连续性问题。

关键设计:论文中关于几何生成的具体方法、warp-and-inpaint和warp-and-refine的具体实现细节(例如使用的网络结构、损失函数等)以及Grouting Block的内部结构和参数设置等是关键的技术细节。论文中使用的损失函数可能包括用于保证几何一致性的损失和用于保证外观一致性的损失。

🖼️ 关键图片

📊 实验亮点

AnchoredDream在360°室内场景生成任务上取得了显著的性能提升,在外观一致性和几何合理性方面均大幅优于现有方法。该方法以零样本方式运行,无需针对特定场景进行训练,具有很强的泛化能力。实验结果表明,几何约束对于高质量场景生成至关重要。

🎯 应用场景

该研究成果可应用于虚拟现实、增强现实、游戏开发、室内设计等领域。例如,用户只需提供一张室内照片,即可快速生成完整的3D室内场景,用于VR/AR体验或室内设计方案展示。该技术还可以用于自动生成训练数据,提升相关AI模型的性能,具有广阔的应用前景。

📄 摘要(原文)

Single-view indoor scene generation plays a crucial role in a range of real-world applications. However, generating a complete 360° scene from a single image remains a highly ill-posed and challenging problem. Recent approaches have made progress by leveraging diffusion models and depth estimation networks, yet they still struggle to maintain appearance consistency and geometric plausibility under large viewpoint changes, limiting their effectiveness in full-scene generation. To address this, we propose AnchoredDream, a novel zero-shot pipeline that anchors 360° scene generation on high-fidelity geometry via an appearance-geometry mutual boosting mechanism. Given a single-view image, our method first performs appearance-guided geometry generation to construct a reliable 3D scene layout. Then, we progressively generate the complete scene through a series of modules: warp-and-inpaint, warp-and-refine, post-optimization, and a novel Grouting Block, which ensures seamless transitions between the input view and generated regions. Extensive experiments demonstrate that AnchoredDream outperforms existing methods by a large margin in both appearance consistency and geometric plausibility--all in a zero-shot manner. Our results highlight the potential of geometric grounding for high-quality, zero-shot single-view scene generation.