TangramPuzzle: Evaluating Multimodal Large Language Models with Compositional Spatial Reasoning

作者: Daixian Liu, Jiayi Kuang, Yinghui Li, Yangning Li, Di Yin, Haoyu Cao, Xing Sun, Ying Shen, Hai-Tao Zheng, Liang Lin, Philip S. Yu

分类: cs.CV, cs.AI, cs.CL

发布日期: 2026-01-23

💡 一句话要点

提出TangramPuzzle基准,评估多模态大语言模型在组合空间推理上的能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 组合空间推理 七巧板游戏 基准测试 几何约束

📋 核心要点

- 现有MLLM基准测试在组合空间推理方面存在不足,任务简单、评估指标粗糙,难以准确评估模型能力。

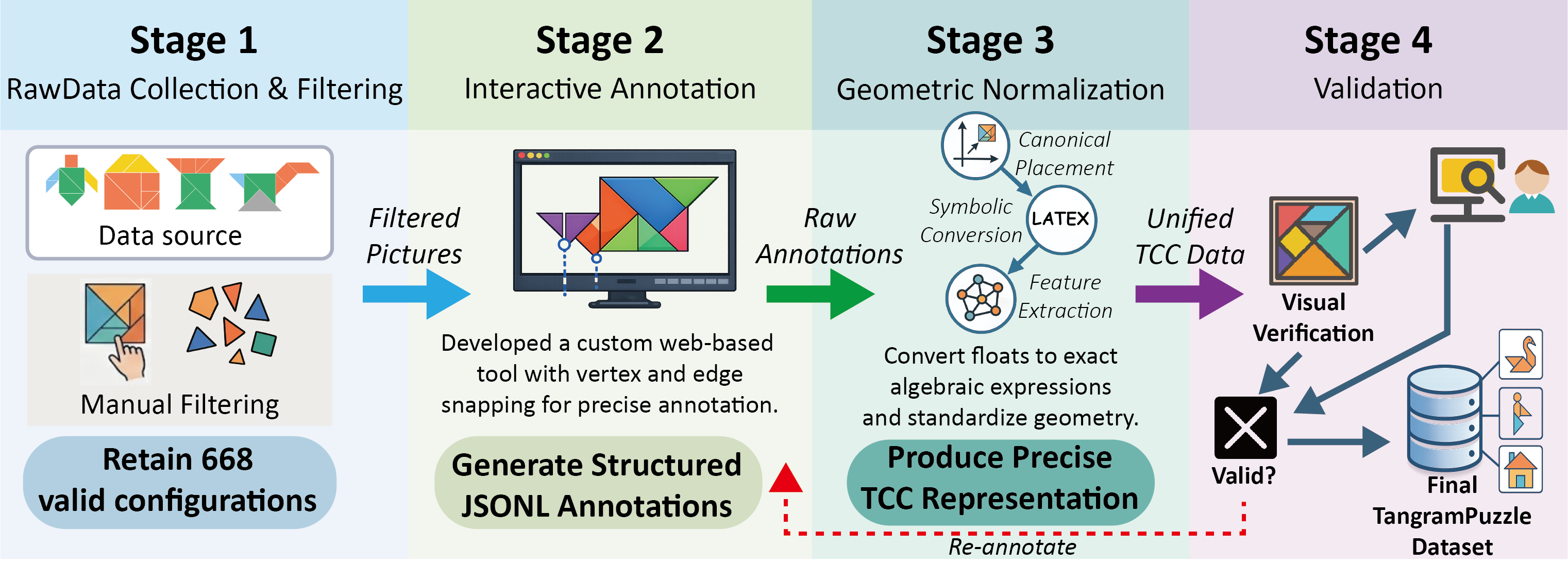

- 论文提出TangramPuzzle基准,利用七巧板游戏评估MLLM的组合空间推理能力,并引入TCE框架进行精确坐标规范。

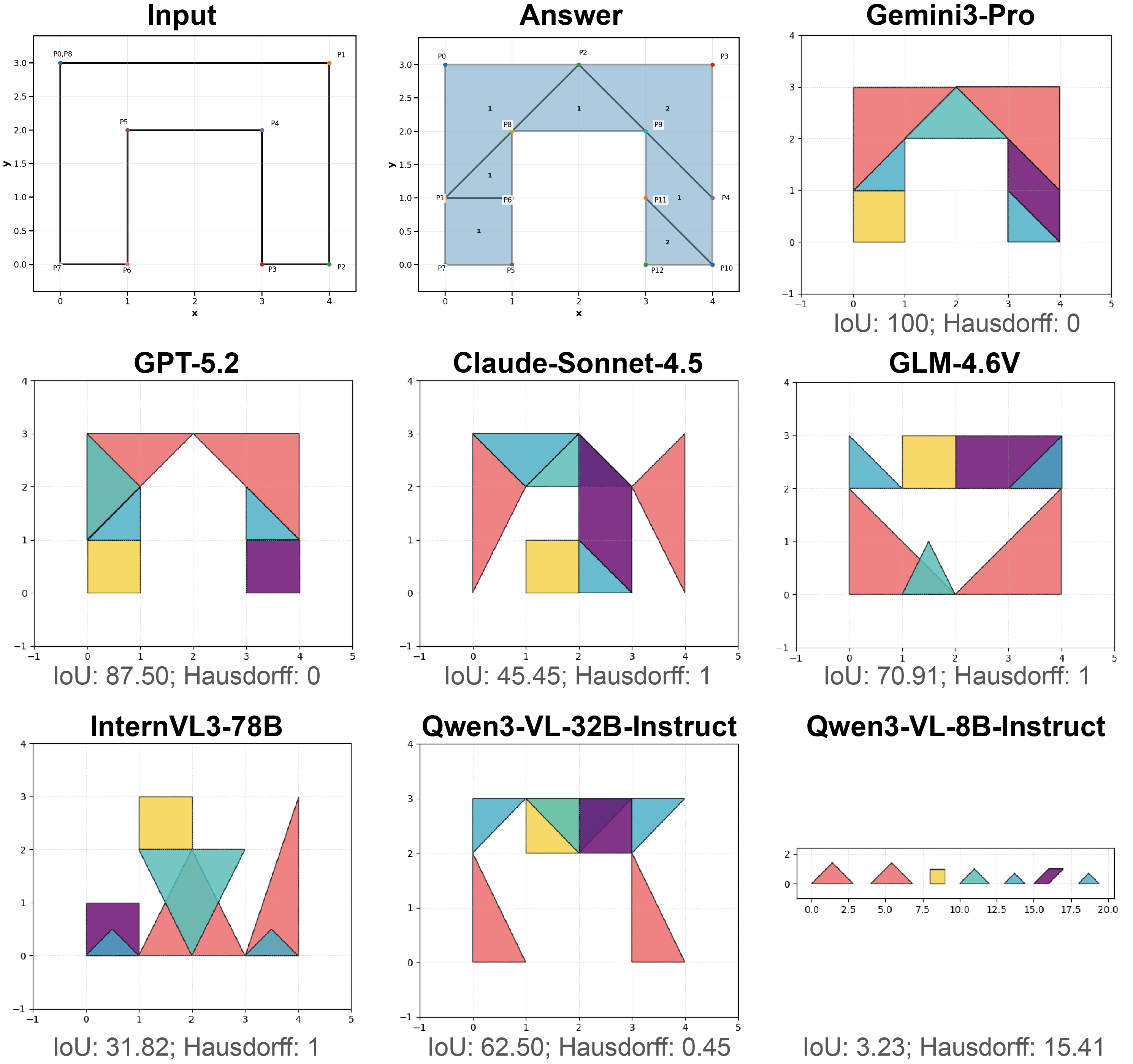

- 实验表明,MLLM在匹配目标轮廓时容易忽略几何约束,导致七巧板碎片出现扭曲或变形。

📝 摘要(中文)

多模态大语言模型(MLLMs)在视觉识别和语义理解方面取得了显著进展。然而,它们执行精确的组合空间推理的能力在很大程度上仍未被探索。现有的基准通常涉及相对简单的任务,并依赖于语义近似或粗略的相对定位,而它们的评估指标通常是有限的,并且缺乏严格的数学公式。为了弥合这一差距,我们引入了TangramPuzzle,这是一个基于几何的基准,旨在通过经典的七巧板游戏来评估组合空间推理。我们提出了七巧板构造表达式(TCE),这是一个符号几何框架,它将七巧板组合建立在精确的、机器可验证的坐标规范中,以减轻视觉近似的模糊性。我们设计了两个互补的任务:轮廓预测,需要从局部组件推断全局形状;端到端代码生成,需要解决逆几何组装问题。我们对先进的开源和专有模型进行了广泛的评估实验,揭示了一个有趣的见解:MLLM倾向于优先匹配目标轮廓,而忽略了几何约束,导致碎片出现扭曲或变形。

🔬 方法详解

问题定义:现有MLLM在组合空间推理能力评估方面存在不足。现有基准测试任务过于简单,依赖语义近似或粗略的相对定位,评估指标缺乏严格的数学公式,难以准确评估模型在复杂几何约束下的推理能力。

核心思路:论文的核心思路是利用经典的七巧板游戏来评估MLLM的组合空间推理能力。七巧板游戏具有明确的几何规则和组合方式,能够有效考察模型对局部组件和全局形状之间关系的理解和推理能力。通过设计轮廓预测和端到端代码生成两个互补的任务,全面评估模型的空间推理能力。

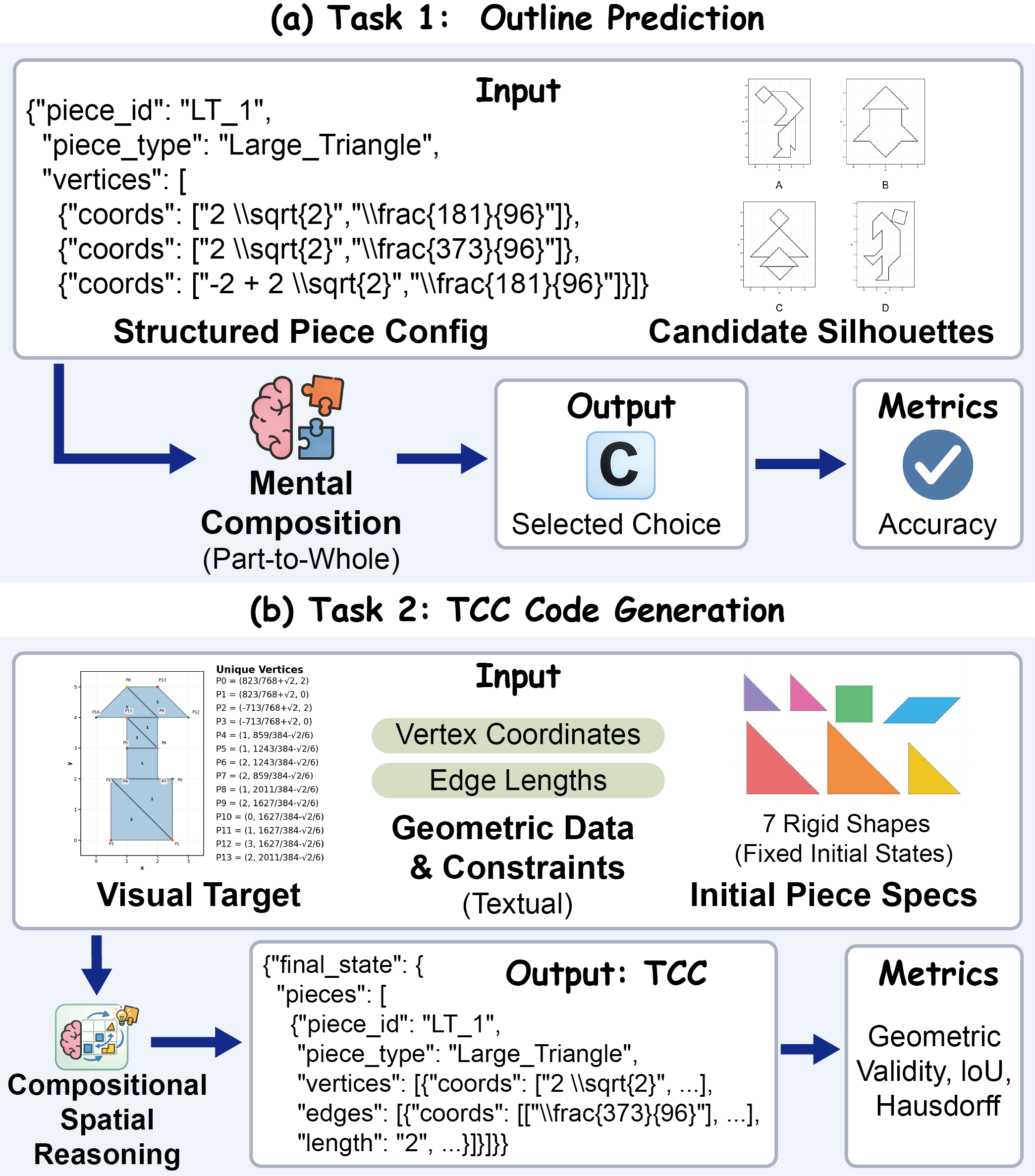

技术框架:TangramPuzzle基准测试包含两个主要任务:轮廓预测和端到端代码生成。轮廓预测任务要求模型根据给定的七巧板碎片推断出最终的轮廓形状。端到端代码生成任务则要求模型生成能够精确描述七巧板组合方式的代码。为了实现精确的几何约束,论文提出了七巧板构造表达式(TCE),这是一个符号几何框架,它将七巧板组合建立在精确的、机器可验证的坐标规范中。

关键创新:论文的关键创新在于提出了TangramPuzzle基准测试和TCE框架。TangramPuzzle提供了一个更具挑战性和几何约束的评估环境,能够更准确地评估MLLM的组合空间推理能力。TCE框架通过精确的坐标规范,消除了视觉近似的模糊性,使得评估结果更加可靠。

关键设计:TCE框架使用符号化的方式描述七巧板的几何形状和位置关系。每个七巧板碎片都用一组参数来表示,包括形状、大小、位置和旋转角度。TCE框架定义了一组操作符,用于描述七巧板碎片之间的组合方式。通过这些操作符,可以将多个七巧板碎片组合成一个完整的形状。在实验中,论文使用了多种先进的开源和专有模型进行评估,并分析了它们在不同任务上的表现。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有的MLLM在TangramPuzzle基准测试上的表现并不理想,尤其是在端到端代码生成任务上。模型倾向于优先匹配目标轮廓,而忽略了几何约束,导致七巧板碎片出现扭曲或变形。这表明MLLM在精确的组合空间推理方面仍有很大的提升空间。

🎯 应用场景

该研究成果可应用于机器人操作、自动设计、智能制造等领域。通过提高MLLM的组合空间推理能力,可以使机器人更好地理解和操作物体,实现更复杂的任务。此外,该研究还可以促进自动设计工具的开发,帮助设计师更高效地创建复杂的几何形状。

📄 摘要(原文)

Multimodal Large Language Models (MLLMs) have achieved remarkable progress in visual recognition and semantic understanding. Nevertheless, their ability to perform precise compositional spatial reasoning remains largely unexplored. Existing benchmarks often involve relatively simple tasks and rely on semantic approximations or coarse relative positioning, while their evaluation metrics are typically limited and lack rigorous mathematical formulations. To bridge this gap, we introduce TangramPuzzle, a geometry-grounded benchmark designed to evaluate compositional spatial reasoning through the lens of the classic Tangram game. We propose the Tangram Construction Expression (TCE), a symbolic geometric framework that grounds tangram assemblies in exact, machine-verifiable coordinate specifications, to mitigate the ambiguity of visual approximation. We design two complementary tasks: Outline Prediction, which demands inferring global shapes from local components, and End-to-End Code Generation, which requires solving inverse geometric assembly problems. We conduct extensive evaluation experiments on advanced open-source and proprietary models, revealing an interesting insight: MLLMs tend to prioritize matching the target silhouette while neglecting geometric constraints, leading to distortions or deformations of the pieces.