Skywork UniPic 3.0: Unified Multi-Image Composition via Sequence Modeling

作者: Hongyang Wei, Hongbo Liu, Zidong Wang, Yi Peng, Baixin Xu, Size Wu, Xuying Zhang, Xianglong He, Zexiang Liu, Peiyu Wang, Xuchen Song, Yangguang Li, Yang Liu, Yahui Zhou

分类: cs.CV, cs.AI

发布日期: 2026-01-22

💡 一句话要点

Skywork UniPic 3.0:提出基于序列建模的统一多图合成框架,实现高质量图像融合。

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多图合成 序列建模 图像融合 人-物交互 统一框架 推理加速 数据合成

📋 核心要点

- 现有方法在多图合成中缺乏对高质量融合的具体方法细节的公开,尤其是在人-物交互(HOI)等复杂场景下。

- Skywork UniPic 3.0将多图合成视为序列建模问题,通过统一的序列合成范式,简化了条件生成过程。

- 该模型仅使用70万高质量训练样本,在单图编辑和多图合成基准测试中均取得了领先的性能,并实现了显著的推理加速。

📝 摘要(中文)

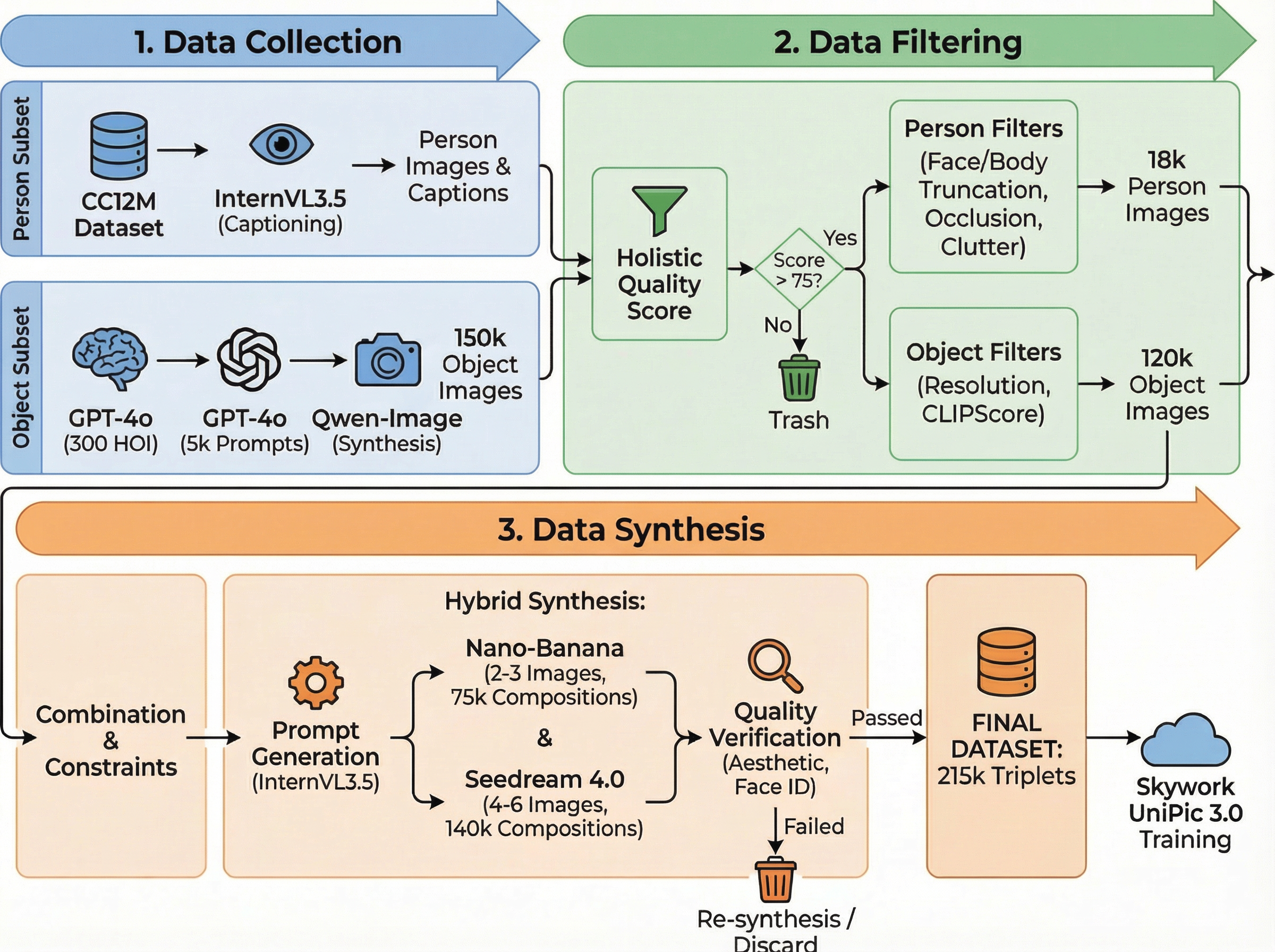

Nano-Banana和Seedream 4.0的流行表明社区对多图合成任务的强烈兴趣。相比于单图编辑,多图合成在一致性和质量方面面临更大挑战,但现有模型未公开实现高质量融合的具体方法细节。通过统计分析,我们发现人-物交互(HOI)是社区最需要的类别。因此,我们系统地分析并实现了一个最先进的多图合成方案,主要关注HOI任务。我们提出了Skywork UniPic 3.0,一个统一的多模态框架,集成了单图编辑和多图合成。我们的模型支持任意数量(1~6)和分辨率的输入图像,以及任意输出分辨率(总像素预算在1024x1024内)。为了应对多图合成的挑战,我们设计了一个全面的数据收集、过滤和合成流程,仅用70万高质量训练样本就实现了强大的性能。此外,我们引入了一种新的训练范式,将多图合成公式化为一个序列建模问题,将条件生成转化为统一的序列合成。为了加速推理,我们将轨迹映射和分布匹配集成到后训练阶段,使模型能够在短短8步内生成高保真样本,并实现比标准合成采样快12.5倍的速度提升。Skywork UniPic 3.0在单图编辑基准测试中取得了最先进的性能,并在多图合成基准测试中超越了Nano-Banana和Seedream 4.0,从而验证了我们的数据管道和训练范式的有效性。代码、模型和数据集已公开。

🔬 方法详解

问题定义:论文旨在解决多图合成任务中,现有方法难以实现高质量图像融合的问题,尤其是在处理包含复杂人-物交互(HOI)的场景时。现有方法通常缺乏对如何保证多张图像之间的一致性和融合质量的详细描述,导致合成结果不尽如人意。

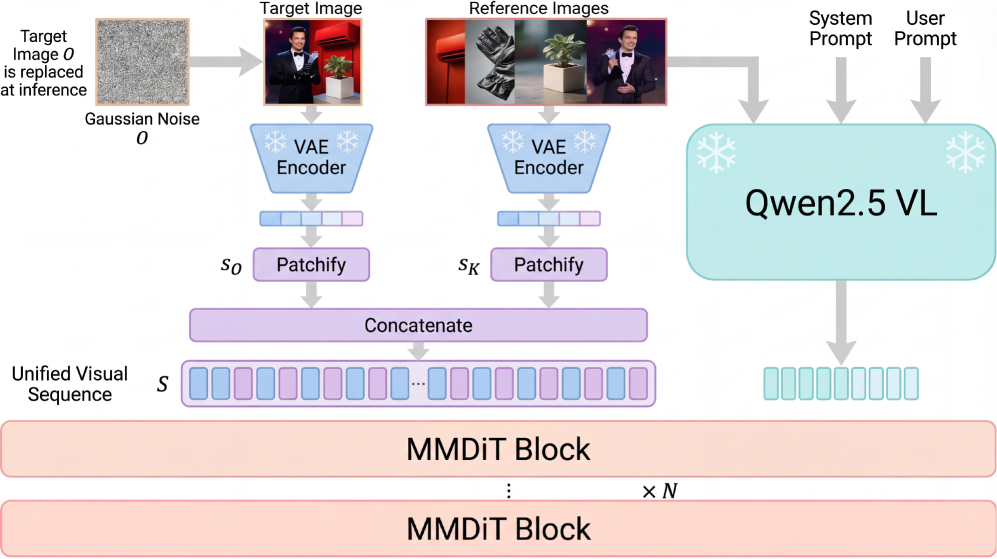

核心思路:论文的核心思路是将多图合成问题转化为一个序列建模问题。通过将多张输入图像的处理过程看作一个序列,并利用序列建模技术来学习图像之间的依赖关系,从而实现更自然、更一致的图像融合。这种方法将条件生成转化为统一的序列合成,简化了模型的设计和训练。

技术框架:Skywork UniPic 3.0是一个统一的多模态框架,集成了单图编辑和多图合成功能。其整体流程包括:1) 数据收集、过滤和合成,构建高质量的训练数据集;2) 使用序列建模方法训练模型,将多图合成转化为序列合成问题;3) 在后训练阶段,集成轨迹映射和分布匹配技术,加速推理过程。该框架支持任意数量(1~6)和分辨率的输入图像,以及任意输出分辨率(总像素预算在1024x1024内)。

关键创新:该论文的关键创新在于将多图合成问题转化为序列建模问题,并提出了一种新的训练范式。这种方法允许模型学习图像之间的复杂依赖关系,从而生成更逼真、更一致的合成图像。此外,论文还通过集成轨迹映射和分布匹配技术,显著提高了模型的推理速度。

关键设计:论文的关键设计包括:1) 精心设计的数据收集、过滤和合成流程,保证了训练数据的质量;2) 使用序列建模技术,将多图合成转化为序列合成问题;3) 在后训练阶段,集成轨迹映射和分布匹配技术,加速推理过程,仅需8步即可生成高保真样本。

🖼️ 关键图片

📊 实验亮点

Skywork UniPic 3.0在单图编辑基准测试中取得了最先进的性能,并在多图合成基准测试中超越了Nano-Banana和Seedream 4.0。此外,通过集成轨迹映射和分布匹配技术,该模型实现了12.5倍的推理速度提升,仅需8步即可生成高保真样本。这些结果验证了该论文提出的数据管道和训练范式的有效性。

🎯 应用场景

Skywork UniPic 3.0具有广泛的应用前景,包括但不限于:创意设计、广告制作、游戏开发、虚拟现实/增强现实内容生成等。该技术可以帮助用户快速生成高质量的多图合成图像,提高创作效率,降低创作成本。未来,该技术有望应用于更复杂的场景,例如视频合成、3D内容生成等。

📄 摘要(原文)

The recent surge in popularity of Nano-Banana and Seedream 4.0 underscores the community's strong interest in multi-image composition tasks. Compared to single-image editing, multi-image composition presents significantly greater challenges in terms of consistency and quality, yet existing models have not disclosed specific methodological details for achieving high-quality fusion. Through statistical analysis, we identify Human-Object Interaction (HOI) as the most sought-after category by the community. We therefore systematically analyze and implement a state-of-the-art solution for multi-image composition with a primary focus on HOI-centric tasks. We present Skywork UniPic 3.0, a unified multimodal framework that integrates single-image editing and multi-image composition. Our model supports an arbitrary (1~6) number and resolution of input images, as well as arbitrary output resolutions (within a total pixel budget of 1024x1024). To address the challenges of multi-image composition, we design a comprehensive data collection, filtering, and synthesis pipeline, achieving strong performance with only 700K high-quality training samples. Furthermore, we introduce a novel training paradigm that formulates multi-image composition as a sequence-modeling problem, transforming conditional generation into unified sequence synthesis. To accelerate inference, we integrate trajectory mapping and distribution matching into the post-training stage, enabling the model to produce high-fidelity samples in just 8 steps and achieve a 12.5x speedup over standard synthesis sampling. Skywork UniPic 3.0 achieves state-of-the-art performance on single-image editing benchmark and surpasses both Nano-Banana and Seedream 4.0 on multi-image composition benchmark, thereby validating the effectiveness of our data pipeline and training paradigm. Code, models and dataset are publicly available.