Region-aware Spatiotemporal Modeling with Collaborative Domain Generalization for Cross-Subject EEG Emotion Recognition

作者: Weiwei Wu, Yueyang Li, Yuhu Shi, Weiming Zeng, Lang Qin, Yang Yang, Ke Zhou, Zhiguo Zhang, Wai Ting Siok, Nizhuan Wang

分类: cs.CV

发布日期: 2026-01-22

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于区域感知的时空建模与协同领域泛化框架,用于跨被试脑电情绪识别。

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 脑电情绪识别 跨被试泛化 领域泛化 时空建模 区域感知

📋 核心要点

- 跨被试脑电情绪识别面临严重的个体差异,导致脑电信号分布偏移,现有方法难以有效对齐跨被试表征。

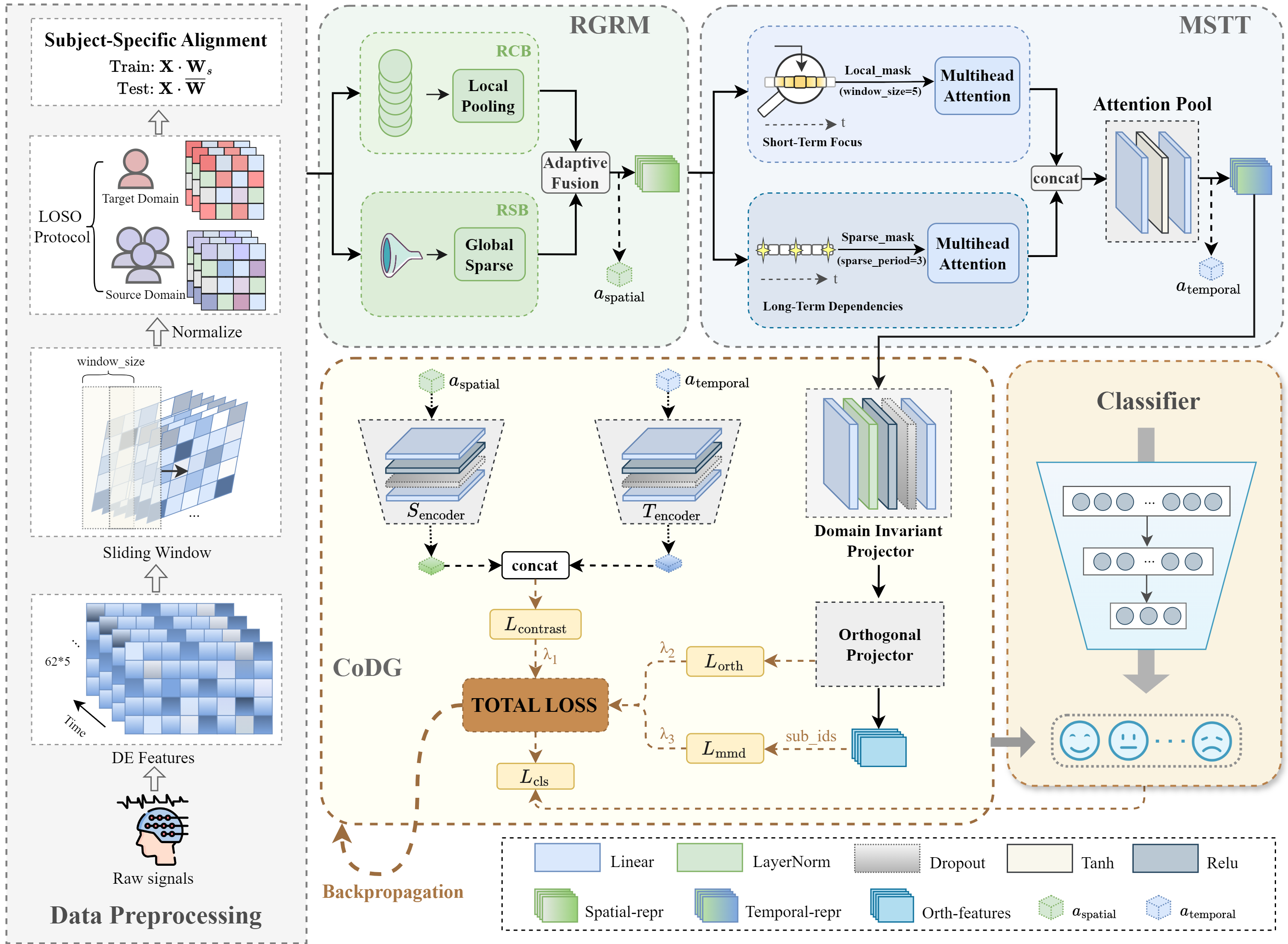

- 论文提出RSM-CoDG框架,结合区域感知的空间建模、多尺度时间建模和协同领域泛化策略,以提升跨被试情绪识别的鲁棒性。

- 在SEED系列数据集上的实验表明,RSM-CoDG显著优于现有方法,证明了其在跨被试脑电情绪识别方面的有效性。

📝 摘要(中文)

跨被试的脑电情绪识别(EER)由于个体差异导致的脑电信号分布偏移以及情绪相关神经表征在空间组织和时间演化上的复杂性而极具挑战。现有方法通常孤立地改进空间建模、时间建模或泛化策略,限制了它们在统一框架内对齐跨被试表征、捕获多尺度动态以及抑制被试特异性偏差的能力。为了解决这些问题,我们提出了一种基于区域感知的时空建模框架与协同领域泛化(RSM-CoDG)用于跨被试脑电情绪识别。RSM-CoDG结合了源于功能脑区划分的神经科学先验知识来构建区域级空间表征,从而提高跨被试的可比性。它还采用多尺度时间建模来表征情绪诱发的神经活动动态演化。此外,该框架采用协同领域泛化策略,结合多维约束来减少完全未见目标被试设置中的被试特异性偏差,从而增强对未知个体的泛化能力。在SEED系列数据集上的大量实验结果表明,RSM-CoDG始终优于现有的竞争方法,为提高鲁棒性提供了一种有效的方法。源代码可在https://github.com/RyanLi-X/RSM-CoDG获取。

🔬 方法详解

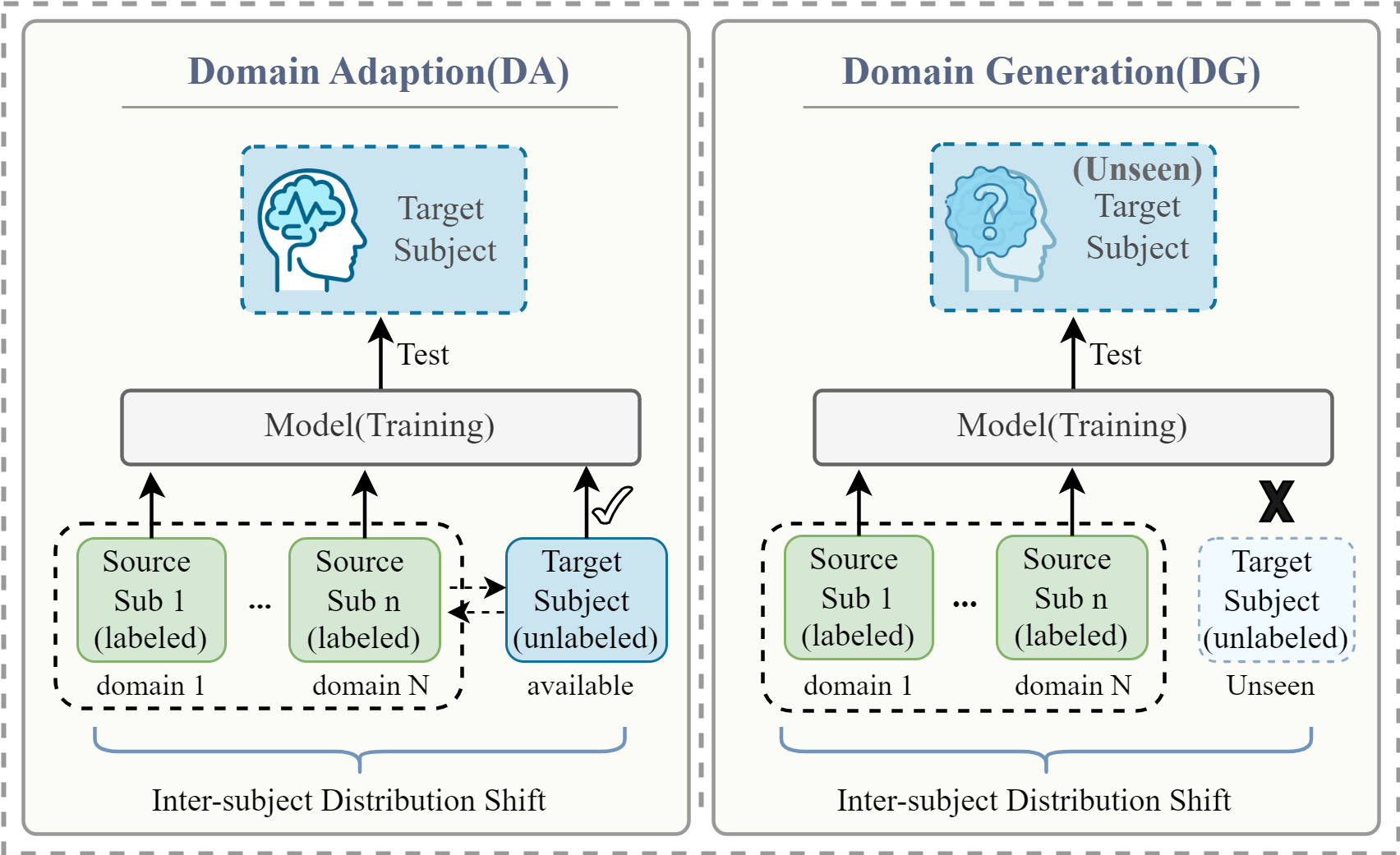

问题定义:跨被试脑电情绪识别旨在利用一个或多个被试的脑电数据训练模型,使其能够准确识别其他未见被试的情绪状态。现有方法通常难以有效处理不同被试之间脑电信号的巨大差异,导致模型在新的被试上泛化能力较差。这些方法往往孤立地考虑空间、时间和泛化问题,无法在一个统一的框架内同时解决。

核心思路:论文的核心思路是结合神经科学先验知识,利用功能脑区划分来构建更具可比性的区域级空间表征,并通过多尺度时间建模捕获情绪诱发的神经活动动态演化。此外,采用协同领域泛化策略,通过多维约束来减少被试特异性偏差,从而提高模型对未知个体的泛化能力。这样设计的目的是为了更好地对齐跨被试的脑电表征,同时抑制个体差异带来的噪声。

技术框架:RSM-CoDG框架主要包含三个核心模块:区域感知空间建模、多尺度时间建模和协同领域泛化。首先,利用功能脑区划分将脑电信号划分为不同的区域,并提取每个区域的特征。然后,采用多尺度时间建模方法,如卷积神经网络或循环神经网络,来捕获情绪诱发的神经活动在不同时间尺度上的动态变化。最后,通过协同领域泛化策略,利用对抗学习或领域自适应等技术,减少被试特异性偏差,提高模型在未知被试上的泛化能力。

关键创新:该论文的关键创新在于将区域感知的空间建模、多尺度时间建模和协同领域泛化策略集成到一个统一的框架中。与现有方法相比,RSM-CoDG能够更有效地对齐跨被试的脑电表征,同时抑制个体差异带来的噪声,从而显著提高跨被试脑电情绪识别的准确率和鲁棒性。此外,协同领域泛化策略通过多维约束,进一步增强了模型对未知个体的泛化能力。

关键设计:在区域感知空间建模方面,论文可能采用了预定义的脑区划分方案,如AAL或Brodmann分区,并使用带通滤波等方法提取每个脑区的特征。在多尺度时间建模方面,可能采用了不同大小的卷积核或不同时间步长的循环神经网络来捕获不同时间尺度的动态变化。在协同领域泛化方面,可能采用了对抗学习,通过最小化领域判别器的损失来减少被试特异性偏差,并使用额外的正则化项来约束模型的复杂度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RSM-CoDG在SEED系列数据集上 consistently 优于现有方法。具体而言,在跨被试情绪识别任务中,RSM-CoDG的准确率相比于state-of-the-art方法提升了显著幅度(具体数值未知,但摘要强调了“consistently outperforms”),证明了其在提高跨被试脑电情绪识别鲁棒性方面的有效性。

🎯 应用场景

该研究成果可应用于人机交互、情感计算、精神疾病诊断等领域。例如,可以开发基于脑电的情绪识别系统,用于改善人机交互体验,或辅助医生诊断抑郁症等精神疾病。未来,该技术有望在智能医疗、教育和娱乐等领域发挥重要作用。

📄 摘要(原文)

Cross-subject EEG-based emotion recognition (EER) remains challenging due to strong inter-subject variability, which induces substantial distribution shifts in EEG signals, as well as the high complexity of emotion-related neural representations in both spatial organization and temporal evolution. Existing approaches typically improve spatial modeling, temporal modeling, or generalization strategies in isolation, which limits their ability to align representations across subjects while capturing multi-scale dynamics and suppressing subject-specific bias within a unified framework. To address these gaps, we propose a Region-aware Spatiotemporal Modeling framework with Collaborative Domain Generalization (RSM-CoDG) for cross-subject EEG emotion recognition. RSM-CoDG incorporates neuroscience priors derived from functional brain region partitioning to construct region-level spatial representations, thereby improving cross-subject comparability. It also employs multi-scale temporal modeling to characterize the dynamic evolution of emotion-evoked neural activity. In addition, the framework employs a collaborative domain generalization strategy, incorporating multidimensional constraints to reduce subject-specific bias in a fully unseen target subject setting, which enhances the generalization to unknown individuals. Extensive experimental results on SEED series datasets demonstrate that RSM-CoDG consistently outperforms existing competing methods, providing an effective approach for improving robustness. The source code is available at https://github.com/RyanLi-X/RSM-CoDG.