Rethinking Video Generation Model for the Embodied World

作者: Yufan Deng, Zilin Pan, Hongyu Zhang, Xiaojie Li, Ruoqing Hu, Yufei Ding, Yiming Zou, Yan Zeng, Daquan Zhou

分类: cs.CV, cs.AI, cs.RO

发布日期: 2026-01-21

备注: Github: https://github.com/DAGroup-PKU/ReVidgen/ Project website: https://dagroup-pku.github.io/ReVidgen.github.io/

💡 一句话要点

针对具身智能,提出RBench机器人视频生成评估基准和RoVid-X大规模数据集。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频生成 具身智能 机器人 数据集 评估基准

📋 核心要点

- 现有机器人视频生成模型难以合成高质量、物理真实的机器人交互视频,且缺乏统一的评估标准。

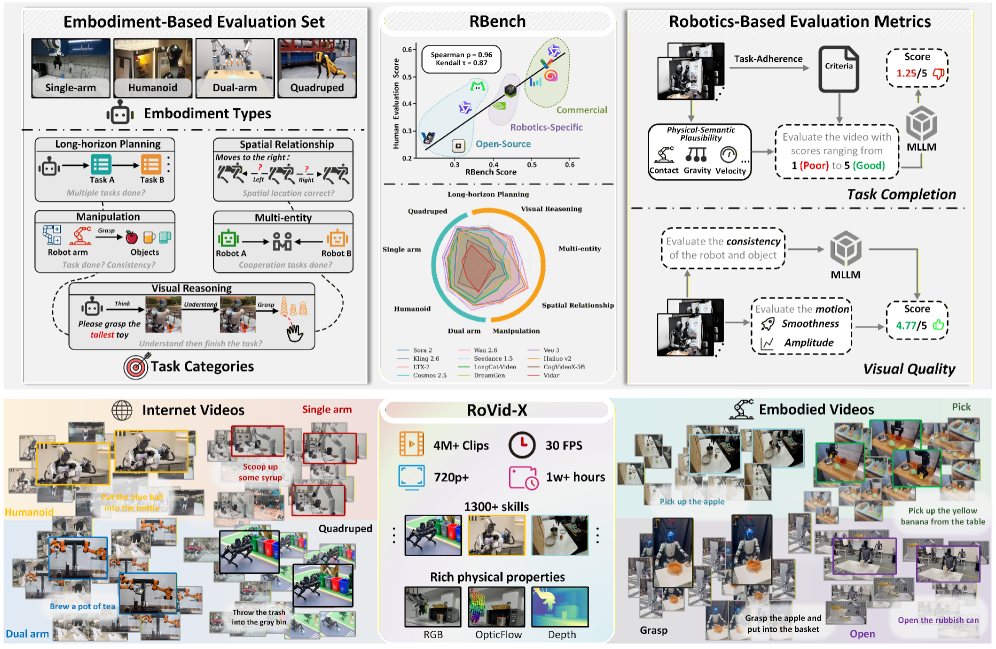

- 论文提出RBench基准,用于评估机器人视频生成的任务正确性和视觉逼真度,并揭示现有模型的不足。

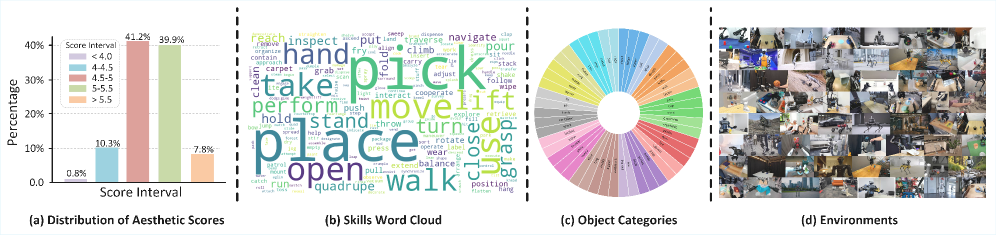

- 论文构建RoVid-X数据集,包含400万个带注释的机器人视频片段,为训练物理真实的视频生成模型提供数据支持。

📝 摘要(中文)

视频生成模型显著推动了具身智能的发展,为生成捕捉物理世界中感知、推理和行动的各种机器人数据开辟了新的可能性。然而,合成能够准确反映真实机器人交互的高质量视频仍然具有挑战性,并且缺乏标准化的基准限制了公平比较和进展。为了解决这一差距,我们引入了一个全面的机器人基准RBench,旨在评估跨五个任务领域和四个不同具身形态的面向机器人的视频生成。它通过可复现的子指标评估任务层面的正确性和视觉逼真度,包括结构一致性、物理合理性和动作完整性。对25个代表性模型的评估突出了在生成物理上逼真的机器人行为方面的显著缺陷。此外,该基准与人类评估实现了0.96的Spearman相关系数,验证了其有效性。虽然RBench提供了识别这些缺陷的必要视角,但实现物理真实感需要超越评估,解决高质量训练数据的严重短缺问题。在这些见解的驱动下,我们引入了一个改进的四阶段数据流水线,产生了RoVid-X,这是最大的开源机器人视频生成数据集,包含400万个带注释的视频片段,涵盖数千个任务,并富含全面的物理属性注释。总而言之,这种评估和数据的协同生态系统为视频模型的严格评估和可扩展训练奠定了坚实的基础,加速了具身人工智能向通用智能的演进。

🔬 方法详解

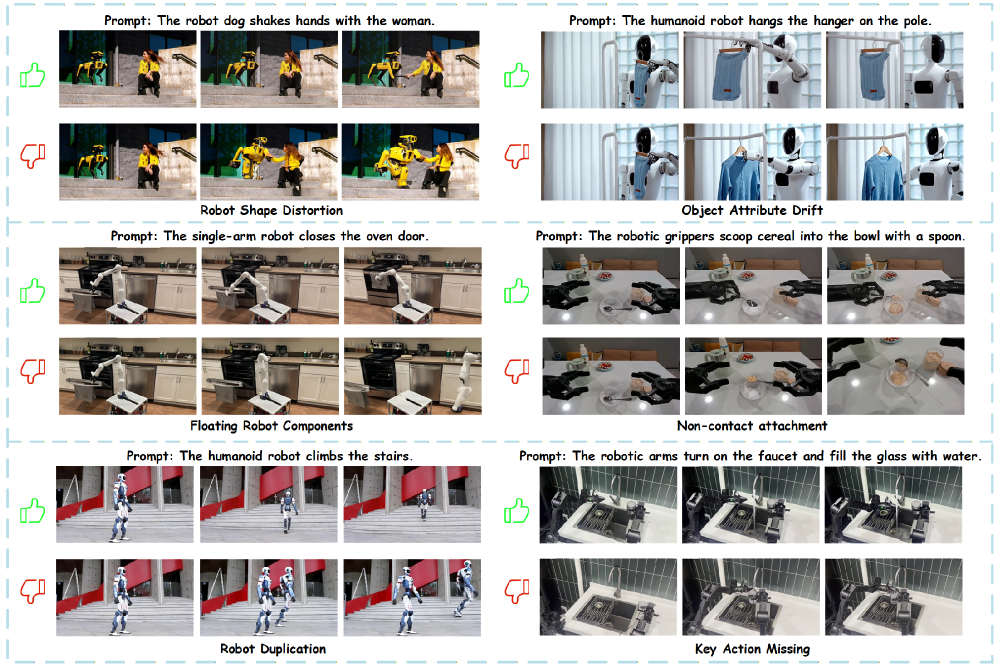

问题定义:现有机器人视频生成模型在生成与真实世界物理规律相符的视频方面存在困难。具体来说,模型难以保证生成视频中物体的结构一致性、物理合理性以及动作的完整性。此外,缺乏一个标准化的评估基准使得不同模型之间的公平比较变得困难,阻碍了该领域的发展。

核心思路:论文的核心思路是通过构建一个全面的评估基准(RBench)和一个大规模的训练数据集(RoVid-X)来解决上述问题。RBench旨在提供一个统一的平台,用于评估不同视频生成模型在机器人领域的性能,并识别模型在物理真实性方面的不足。RoVid-X则旨在提供充足的高质量训练数据,以帮助模型学习生成更逼真的机器人交互视频。

技术框架:论文构建的生态系统包含两个主要组成部分:RBench评估基准和RoVid-X数据集。RBench包含五个任务领域和四个不同的机器人形态,并定义了可复现的子指标来评估任务层面的正确性和视觉逼真度,包括结构一致性、物理合理性和动作完整性。RoVid-X数据集通过一个四阶段的数据流水线构建,包含400万个带注释的视频片段,涵盖数千个任务,并富含全面的物理属性注释。

关键创新:论文的关键创新在于提出了RBench基准和RoVid-X数据集,共同构成了一个评估和训练的协同生态系统。RBench是首个针对机器人视频生成任务的综合性评估基准,能够有效识别现有模型在物理真实性方面的不足。RoVid-X是目前最大的开源机器人视频生成数据集,为训练更逼真的视频生成模型提供了充足的数据支持。

关键设计:RBench的评估指标设计考虑了机器人任务的特殊性,包括结构一致性(例如,物体形状和大小的变化是否合理)、物理合理性(例如,物体是否会穿透其他物体)和动作完整性(例如,机器人是否完成了预期的动作)。RoVid-X的数据流水线包含数据收集、数据清洗、数据标注和数据增强等阶段,以确保数据集的质量和多样性。数据集的物理属性注释包括物体的位置、速度、质量等信息,有助于模型学习物理规律。

🖼️ 关键图片

📊 实验亮点

RBench基准的评估结果表明,现有视频生成模型在生成物理真实的机器人行为方面存在显著缺陷。RBench与人类评估实现了0.96的Spearman相关系数,验证了其有效性。RoVid-X数据集包含400万个带注释的视频片段,是目前最大的开源机器人视频生成数据集。

🎯 应用场景

该研究成果可应用于机器人仿真、强化学习、自动驾驶等领域。通过生成逼真的机器人交互视频,可以为机器人训练提供更安全、更高效的环境。此外,该研究也有助于开发更智能、更可靠的机器人系统,使其能够更好地理解和适应真实世界。

📄 摘要(原文)

Video generation models have significantly advanced embodied intelligence, unlocking new possibilities for generating diverse robot data that capture perception, reasoning, and action in the physical world. However, synthesizing high-quality videos that accurately reflect real-world robotic interactions remains challenging, and the lack of a standardized benchmark limits fair comparisons and progress. To address this gap, we introduce a comprehensive robotics benchmark, RBench, designed to evaluate robot-oriented video generation across five task domains and four distinct embodiments. It assesses both task-level correctness and visual fidelity through reproducible sub-metrics, including structural consistency, physical plausibility, and action completeness. Evaluation of 25 representative models highlights significant deficiencies in generating physically realistic robot behaviors. Furthermore, the benchmark achieves a Spearman correlation coefficient of 0.96 with human evaluations, validating its effectiveness. While RBench provides the necessary lens to identify these deficiencies, achieving physical realism requires moving beyond evaluation to address the critical shortage of high-quality training data. Driven by these insights, we introduce a refined four-stage data pipeline, resulting in RoVid-X, the largest open-source robotic dataset for video generation with 4 million annotated video clips, covering thousands of tasks and enriched with comprehensive physical property annotations. Collectively, this synergistic ecosystem of evaluation and data establishes a robust foundation for rigorous assessment and scalable training of video models, accelerating the evolution of embodied AI toward general intelligence.