DrivIng: A Large-Scale Multimodal Driving Dataset with Full Digital Twin Integration

作者: Dominik Rößle, Xujun Xie, Adithya Mohan, Venkatesh Thirugnana Sambandham, Daniel Cremers, Torsten Schön

分类: cs.CV

发布日期: 2026-01-21

备注: Accepted to the IEEE Intelligent Vehicles Symposium 2026. For code and dataset, see https://github.com/cvims/DrivIng

💡 一句话要点

DrivIng:一个集成完整数字孪生的大规模多模态自动驾驶数据集

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动驾驶 数据集 数字孪生 多模态感知 3D目标检测

📋 核心要点

- 现有自动驾驶数据集缺乏高保真数字孪生,限制了系统测试、极端情况模拟、传感器修改以及从仿真到真实的评估。

- DrivIng数据集通过构建一个完整的地理参考数字孪生,并提供多模态传感器数据,解决了现有数据集的局限性。

- 该数据集使用最先进的感知模型进行了基准测试,并公开发布,以促进可复现的研究和稳健的验证。

📝 摘要(中文)

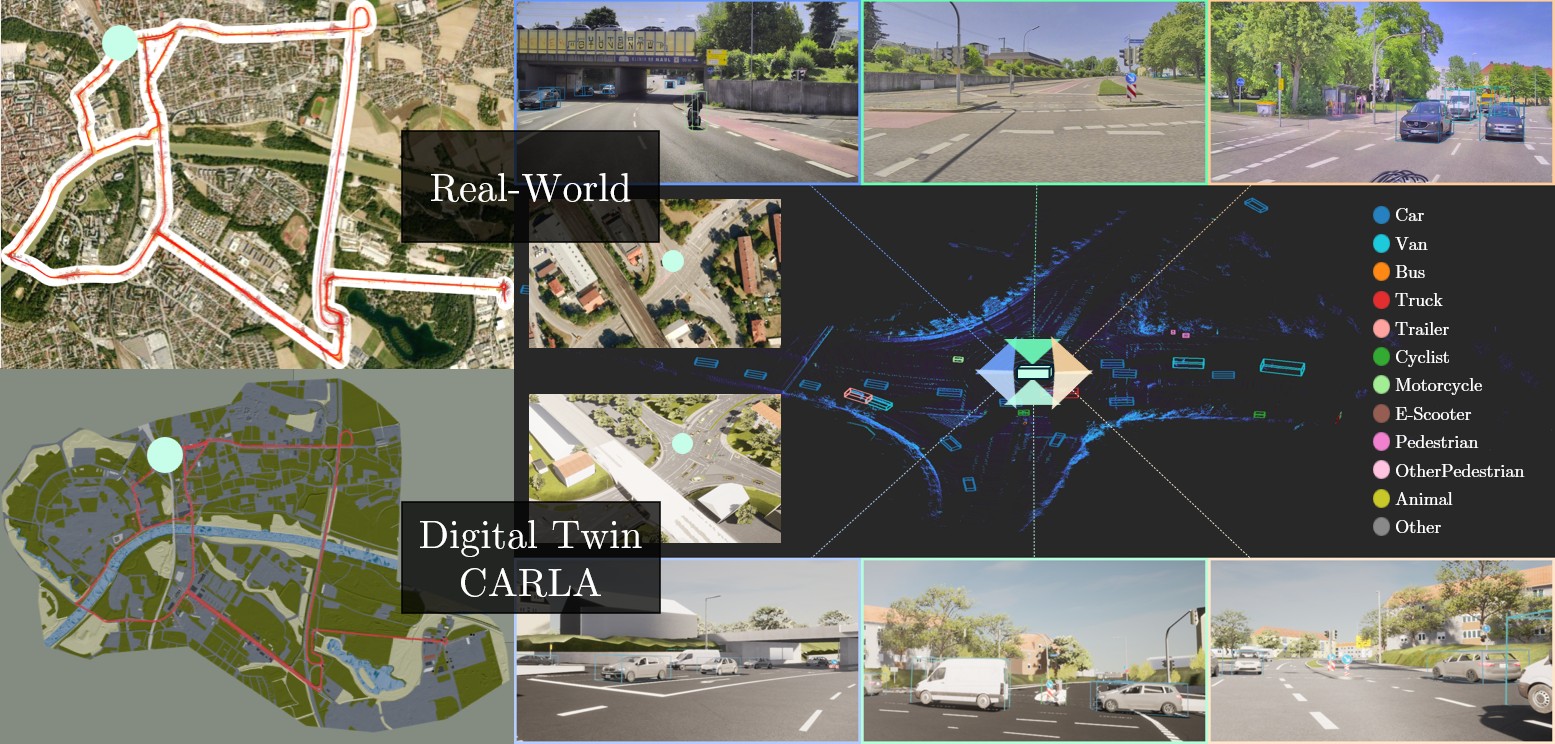

本文提出了DrivIng,一个大规模多模态数据集,它具有完整的地理参考数字孪生,覆盖了约18公里的城市、郊区和高速公路路段。该数据集提供了来自六个RGB相机、一个激光雷达和基于高精度ADMA的定位的连续记录,数据采集横跨白天、黄昏和夜晚。所有序列都以10Hz的频率进行标注,包含12个类别的3D bounding box和跟踪ID,总计约120万个标注实例。除了数字孪生的优势外,DrivIng还支持将真实交通1:1转移到仿真中,保留了智能体交互,同时实现了逼真且灵活的场景测试。为了支持可复现的研究和稳健的验证,我们使用最先进的感知模型对DrivIng进行了基准测试,并公开发布了数据集、数字孪生、高清地图和代码库。

🔬 方法详解

问题定义:现有自动驾驶数据集通常缺乏高保真度的数字孪生,这限制了算法的测试和验证能力,尤其是在极端情况模拟、传感器配置修改以及仿真到真实环境的迁移等方面。缺乏数字孪生使得系统性的测试和边缘案例分析变得困难,阻碍了自动驾驶感知算法的鲁棒性提升。

核心思路:DrivIng数据集的核心思路是构建一个包含完整地理参考的数字孪生,并同步采集多模态传感器数据,从而提供一个更全面、更逼真的自动驾驶研究平台。通过将真实世界的驾驶场景与数字孪生相结合,可以实现更灵活、更可控的实验环境,并支持更深入的算法分析和优化。

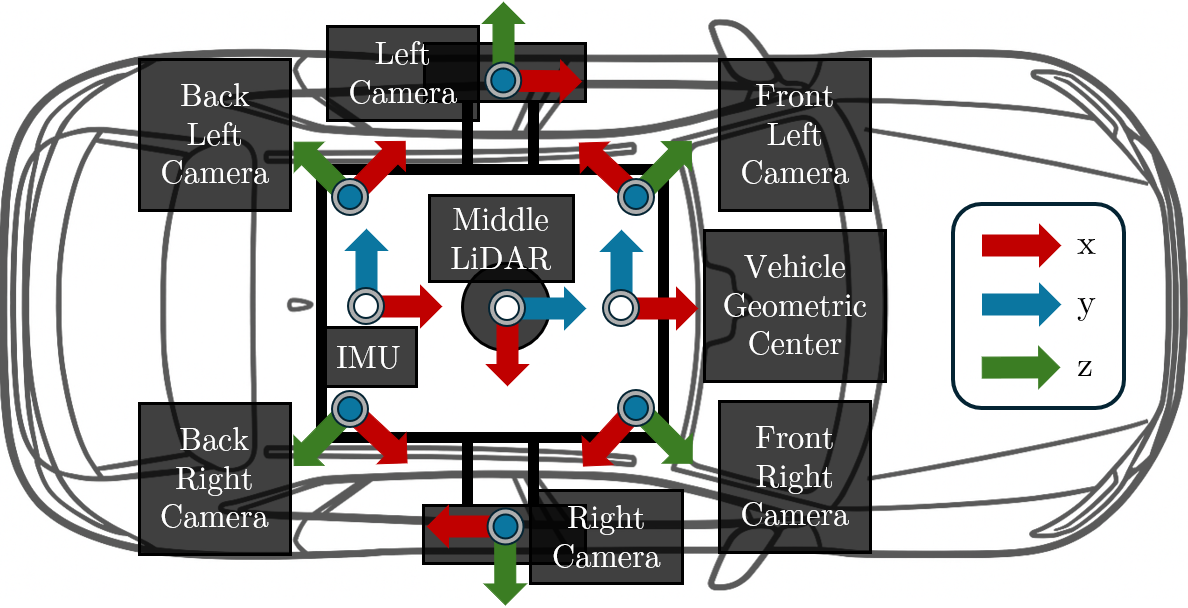

技术框架:DrivIng数据集的构建包括以下几个主要阶段:1) 数据采集:使用配备六个RGB相机、一个激光雷达和高精度ADMA定位系统的车辆,在城市、郊区和高速公路等多种场景下进行数据采集。2) 数据标注:对采集到的数据进行精确的3D bounding box标注和跟踪ID分配,涵盖12个类别。3) 数字孪生构建:基于采集到的数据和高清地图,构建一个完整的地理参考数字孪生。4) 数据集发布:公开发布数据集、数字孪生、高清地图和代码库。

关键创新:DrivIng数据集的关键创新在于其完整的数字孪生集成,这使得研究人员能够在一个可控的仿真环境中进行各种实验,例如修改传感器配置、模拟极端天气条件等。此外,该数据集还支持将真实交通场景1:1转移到仿真中,从而保留了智能体之间的交互,并实现了更逼真的场景测试。

关键设计:DrivIng数据集的关键设计包括:1) 多模态传感器配置:配备六个RGB相机和一个激光雷达,提供全面的感知信息。2) 高精度定位:使用基于ADMA的定位系统,提供精确的车辆位置信息。3) 详细的3D标注:对所有序列进行10Hz的3D bounding box标注和跟踪ID分配,涵盖12个类别。4) 完整的数字孪生:构建一个完整的地理参考数字孪生,支持各种仿真实验。

🖼️ 关键图片

📊 实验亮点

DrivIng数据集包含约120万个标注实例,涵盖12个类别,并提供了完整的数字孪生。论文使用最先进的感知模型对DrivIng进行了基准测试,结果表明该数据集具有挑战性和价值。具体性能数据未知,但数据集的发布将促进自动驾驶感知算法的进一步研究和发展。

🎯 应用场景

DrivIng数据集可广泛应用于自动驾驶感知算法的开发、测试和验证。它支持各种任务,例如3D目标检测、跟踪、场景理解和行为预测。该数据集的数字孪生特性使其特别适用于仿真测试、传感器配置优化和从仿真到真实环境的迁移学习。此外,它还可以用于开发更安全、更可靠的自动驾驶系统。

📄 摘要(原文)

Perception is a cornerstone of autonomous driving, enabling vehicles to understand their surroundings and make safe, reliable decisions. Developing robust perception algorithms requires large-scale, high-quality datasets that cover diverse driving conditions and support thorough evaluation. Existing datasets often lack a high-fidelity digital twin, limiting systematic testing, edge-case simulation, sensor modification, and sim-to-real evaluations. To address this gap, we present DrivIng, a large-scale multimodal dataset with a complete geo-referenced digital twin of a ~18 km route spanning urban, suburban, and highway segments. Our dataset provides continuous recordings from six RGB cameras, one LiDAR, and high-precision ADMA-based localization, captured across day, dusk, and night. All sequences are annotated at 10 Hz with 3D bounding boxes and track IDs across 12 classes, yielding ~1.2 million annotated instances. Alongside the benefits of a digital twin, DrivIng enables a 1-to-1 transfer of real traffic into simulation, preserving agent interactions while enabling realistic and flexible scenario testing. To support reproducible research and robust validation, we benchmark DrivIng with state-of-the-art perception models and publicly release the dataset, digital twin, HD map, and codebase.