Training-Free and Interpretable Hateful Video Detection via Multi-stage Adversarial Reasoning

作者: Shuonan Yang, Yuchen Zhang, Zeyu Fu

分类: cs.CV

发布日期: 2026-01-21

备注: Accepted at ICASSP 2026. \c{opyright} 2026 IEEE. This is the author accepted manuscript. The final published version will be available via IEEE Xplore

🔗 代码/项目: GITHUB

💡 一句话要点

提出MARS:一种免训练且可解释的多阶段对抗推理框架,用于检测仇恨视频。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 仇恨视频检测 免训练学习 可解释性 对抗推理 多模态分析

📋 核心要点

- 现有仇恨视频检测方法依赖大量训练数据,泛化性差,且缺乏可解释性,难以满足实际应用需求。

- MARS框架通过多阶段对抗推理,模拟人类思考过程,从不同角度分析视频内容,做出可解释的判断。

- 实验结果表明,MARS在免训练的情况下,性能优于现有免训练方法,并在部分数据集上超越了有监督方法。

📝 摘要(中文)

仇恨视频通过放大歧视、煽动暴力和破坏在线安全构成严重风险。现有的基于训练的仇恨视频检测方法受到有限训练数据的约束,并且缺乏可解释性,而直接提示大型视觉-语言模型通常难以提供可靠的仇恨检测。为了解决这些挑战,本文提出了一种免训练的多阶段对抗推理框架MARS,该框架能够实现可靠且可解释的仇恨内容检测。MARS首先客观地描述视频内容,为后续分析建立中立的基础。在此基础上,它开发了支持潜在仇恨解释的基于证据的推理,同时并行地结合反证据推理来捕捉合理的非仇恨视角。最后,这些视角被综合成一个结论性的和可解释的决策。在两个真实世界数据集上的广泛评估表明,与其他免训练方法相比,MARS在某些骨干网络和设置下实现了高达10%的改进,并且在一个数据集上优于最先进的基于训练的方法。此外,MARS产生人类可理解的理由,从而支持合规监督并提高内容审核工作流程的透明度。

🔬 方法详解

问题定义:现有基于训练的仇恨视频检测方法依赖于大量的标注数据,这在实际应用中往往难以获得。此外,这些方法通常缺乏可解释性,难以理解其判断依据。直接使用大型视觉-语言模型进行提示学习,虽然不需要训练,但检测结果的可靠性不高。因此,如何设计一种免训练、高性能且可解释的仇恨视频检测方法是一个重要的挑战。

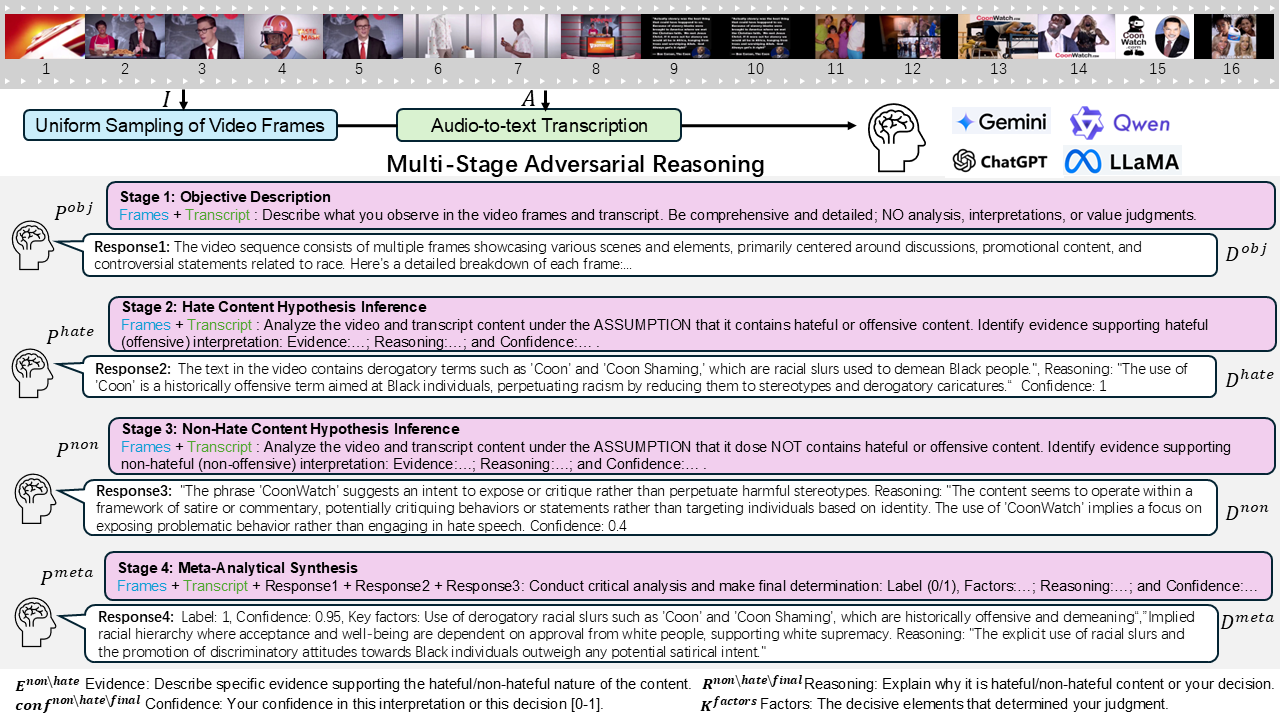

核心思路:MARS的核心思路是模拟人类的推理过程,通过多阶段的对抗性推理来综合考虑视频内容的不同方面。首先,对视频内容进行客观描述,然后分别从支持仇恨和反对仇恨的角度进行推理,最后综合这些推理结果做出判断。这种方法旨在提高检测的准确性和可解释性。

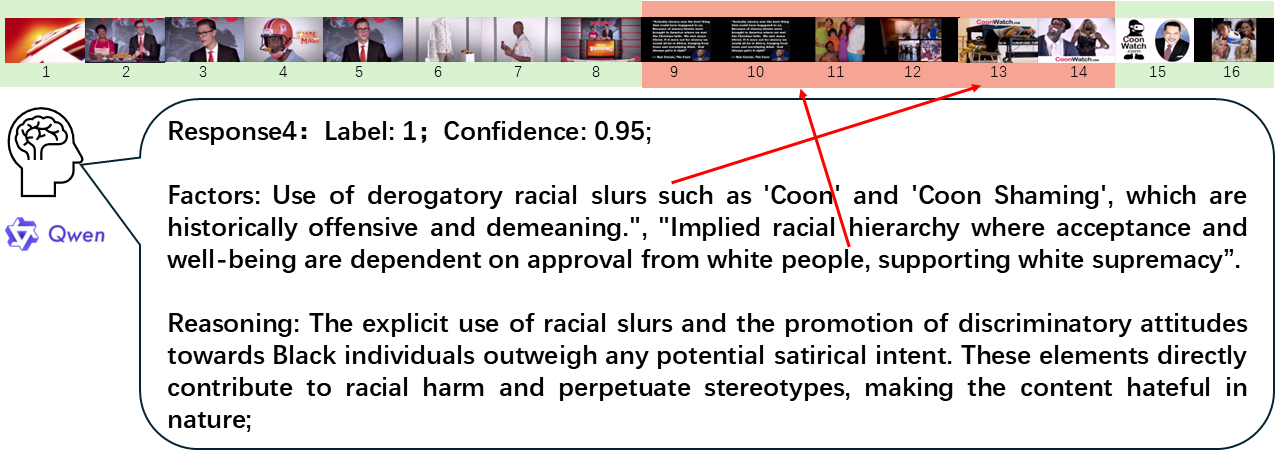

技术框架:MARS框架包含以下几个主要阶段: 1. 客观描述:使用视觉-语言模型对视频内容进行客观描述,建立中立的基础。 2. 证据推理:从支持仇恨的角度出发,寻找视频中可能被解释为仇恨的证据。 3. 反证据推理:从反对仇恨的角度出发,寻找视频中可能被解释为非仇恨的证据。 4. 综合决策:综合证据推理和反证据推理的结果,做出最终的仇恨判断,并提供可解释的理由。

关键创新:MARS的关键创新在于其多阶段对抗推理框架。与传统的单阶段方法不同,MARS通过多阶段的推理过程,更全面地考虑了视频内容的不同方面。此外,MARS的对抗性推理机制能够有效地平衡支持和反对仇恨的证据,从而提高检测的准确性和鲁棒性。最重要的是,MARS是免训练的,避免了对大量标注数据的依赖。

关键设计:MARS的关键设计包括: 1. 使用预训练的视觉-语言模型(如CLIP)进行视频内容的客观描述。 2. 设计专门的提示模板,引导视觉-语言模型进行证据推理和反证据推理。 3. 使用加权平均或投票机制综合证据推理和反证据推理的结果。 4. 通过生成自然语言解释,提高模型的可解释性。具体的参数设置和网络结构取决于所使用的视觉-语言模型和提示模板。

🖼️ 关键图片

📊 实验亮点

MARS在两个真实世界数据集上进行了广泛评估,结果表明,与其他免训练方法相比,MARS在某些骨干网络和设置下实现了高达10%的改进。此外,MARS在一个数据集上优于最先进的基于训练的方法。更重要的是,MARS能够生成人类可理解的理由,提高了模型的可解释性。

🎯 应用场景

MARS可应用于在线视频平台的内容审核,自动检测和过滤仇恨视频,维护健康的在线环境。该方法的可解释性有助于人工审核员理解模型的判断依据,提高审核效率。此外,MARS还可用于社交媒体监控、舆情分析等领域,及时发现和应对潜在的仇恨言论。

📄 摘要(原文)

Hateful videos pose serious risks by amplifying discrimination, inciting violence, and undermining online safety. Existing training-based hateful video detection methods are constrained by limited training data and lack of interpretability, while directly prompting large vision-language models often struggle to deliver reliable hate detection. To address these challenges, this paper introduces MARS, a training-free Multi-stage Adversarial ReaSoning framework that enables reliable and interpretable hateful content detection. MARS begins with the objective description of video content, establishing a neutral foundation for subsequent analysis. Building on this, it develops evidence-based reasoning that supports potential hateful interpretations, while in parallel incorporating counter-evidence reasoning to capture plausible non-hateful perspectives. Finally, these perspectives are synthesized into a conclusive and explainable decision. Extensive evaluation on two real-world datasets shows that MARS achieves up to 10% improvement under certain backbones and settings compared to other training-free approaches and outperforms state-of-the-art training-based methods on one dataset. In addition, MARS produces human-understandable justifications, thereby supporting compliance oversight and enhancing the transparency of content moderation workflows. The code is available at https://github.com/Multimodal-Intelligence-Lab-MIL/MARS.