LiViBench: An Omnimodal Benchmark for Interactive Livestream Video Understanding

作者: Xiaodong Wang, Langling Huang, Zhirong Wu, Xu Zhao, Teng Xu, Xuhong Xia, Peixi Peng

分类: cs.CV

发布日期: 2026-01-21

备注: AAAI 2026 Main Track

💡 一句话要点

提出LiViBench,一个面向交互式直播视频理解的全模态基准测试。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 交互式直播视频理解 多模态学习 大型语言模型 基准测试 半自动标注 指令调优 视频评论检索

📋 核心要点

- 现有视频理解基准主要关注非交互式视频,缺乏对交互式直播场景的针对性评估。

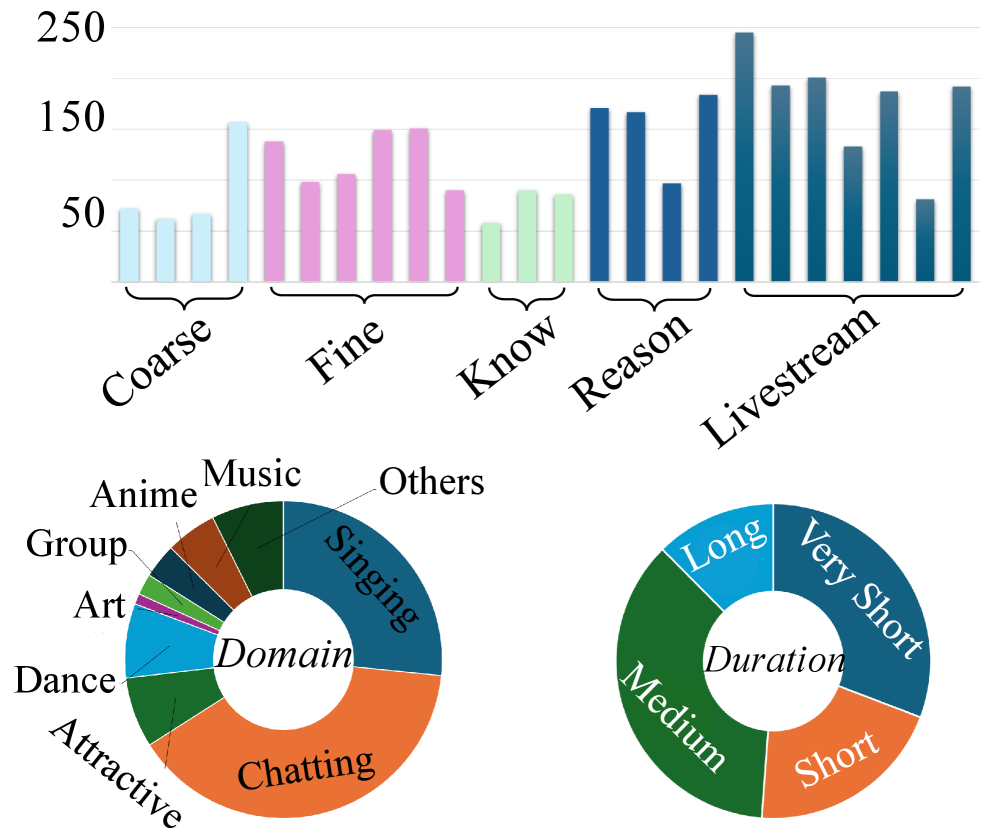

- LiViBench通过构建包含24个任务的全模态基准,并设计半自动标注流程,填补了这一空白。

- 提出的LiVi-LLM-7B模型,通过两阶段指令调优和VCR模块,在多个基准上超越了现有模型。

📝 摘要(中文)

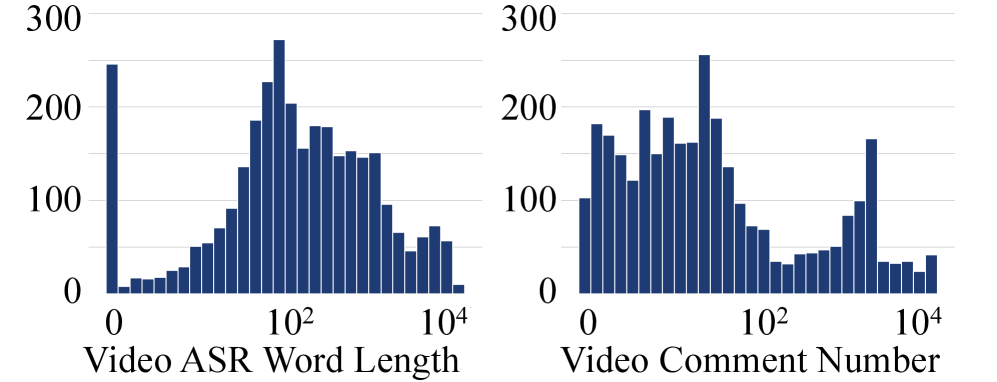

多模态大型语言模型(MLLM)的发展推动了通用视频理解。然而,现有的视频评估基准主要集中于非交互式视频,如电影和录像。为了填补这一空白,本文提出了第一个用于交互式直播视频的全模态基准测试,LiViBench。它包含24个不同的任务,突出了感知、推理和直播特定的挑战。为了高效地构建数据集,我们设计了一个标准化的半自动标注工作流程,该流程在多个阶段都包含了人工参与。该工作流程利用多个MLLM形成一个多智能体系统,用于全面的视频描述,并使用种子问题驱动的方法来构建高质量的标注。基准测试中的所有交互式视频都包含音频、语音和实时评论模态。为了增强模型对交互式视频的理解,我们设计了定制的两阶段指令调优,并提出了一个视频到评论检索(VCR)模块,以提高模型利用实时评论的能力。基于这些进展,我们开发了LiVi-LLM-7B,一个具有增强的交互式直播知识的MLLM。实验表明,我们的模型优于参数高达72B的更大的开源模型,缩小了与LiViBench上领先的专有模型的差距,并在通用视频基准测试(包括VideoMME、LongVideoBench、MLVU和VideoEval-Pro)上实现了增强的性能。

🔬 方法详解

问题定义:现有视频理解模型在处理交互式直播视频时面临挑战,因为这些视频包含实时评论、音频和语音等多模态信息,并且需要模型具备感知、推理和直播特定知识。现有的基准测试主要关注非交互式视频,无法有效评估模型在交互式直播场景下的性能。

核心思路:论文的核心思路是构建一个专门针对交互式直播视频的全模态基准测试LiViBench,并在此基础上训练一个能够有效利用多模态信息和直播特定知识的模型。通过设计标准化的半自动标注流程和定制的训练方法,提高模型在交互式直播视频理解方面的能力。

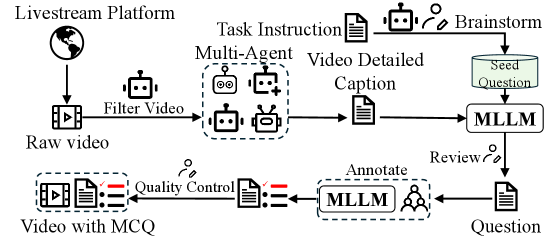

技术框架:整体框架包括数据集构建和模型训练两个主要部分。数据集构建采用半自动标注流程,利用多个MLLM形成多智能体系统进行视频描述,并使用种子问题驱动的方法构建高质量标注。模型训练采用两阶段指令调优,首先进行通用视频理解的预训练,然后针对LiViBench进行微调。此外,还提出了视频到评论检索(VCR)模块,以提高模型利用实时评论的能力。

关键创新:最重要的创新点在于构建了首个针对交互式直播视频的全模态基准测试LiViBench,并提出了相应的半自动标注流程和模型训练方法。VCR模块也是一个关键创新,它能够有效利用实时评论信息,提高模型对视频内容的理解。

关键设计:半自动标注流程的关键设计包括多智能体系统的构建和种子问题驱动的方法。多智能体系统利用多个MLLM进行视频描述,提高标注的全面性和准确性。种子问题驱动的方法通过预先设计的问题引导标注过程,确保标注的质量和一致性。VCR模块的关键设计在于如何有效地将视频特征和评论信息进行融合,以提高模型对视频内容的理解。

🖼️ 关键图片

📊 实验亮点

LiVi-LLM-7B模型在LiViBench上取得了显著的性能提升,超越了参数高达72B的开源模型,并缩小了与领先的专有模型的差距。此外,该模型在通用视频基准测试(包括VideoMME、LongVideoBench、MLVU和VideoEval-Pro)上也取得了增强的性能,表明其具有良好的泛化能力。

🎯 应用场景

该研究成果可应用于直播平台的内容理解、智能推荐、实时互动等领域。例如,可以利用该模型自动识别直播中的违规内容,提高内容审核效率;也可以根据用户的评论和视频内容,进行个性化推荐,提升用户体验。此外,该研究还可以促进多模态大型语言模型在视频理解领域的进一步发展。

📄 摘要(原文)

The development of multimodal large language models (MLLMs) has advanced general video understanding. However, existing video evaluation benchmarks primarily focus on non-interactive videos, such as movies and recordings. To fill this gap, this paper proposes the first omnimodal benchmark for interactive livestream videos, LiViBench. It features a diverse set of 24 tasks, highlighting the perceptual, reasoning, and livestream-specific challenges. To efficiently construct the dataset, we design a standardized semi-automatic annotation workflow that incorporates the human-in-the-loop at multiple stages. The workflow leverages multiple MLLMs to form a multi-agent system for comprehensive video description and uses a seed-question-driven method to construct high-quality annotations. All interactive videos in the benchmark include audio, speech, and real-time comments modalities. To enhance models' understanding of interactive videos, we design tailored two-stage instruction-tuning and propose a Video-to-Comment Retrieval (VCR) module to improve the model's ability to utilize real-time comments. Based on these advancements, we develop LiVi-LLM-7B, an MLLM with enhanced knowledge of interactive livestreams. Experiments show that our model outperforms larger open-source models with up to 72B parameters, narrows the gap with leading proprietary models on LiViBench, and achieves enhanced performance on general video benchmarks, including VideoMME, LongVideoBench, MLVU, and VideoEval-Pro.