ReinPath: A Multimodal Reinforcement Learning Approach for Pathology

作者: Kangcheng Zhou, Jun Jiang, Qing Zhang, Shuang Zheng, Qingli Li, Shugong Xu

分类: cs.CV

发布日期: 2026-01-21

💡 一句话要点

提出ReinPath:一种用于病理学分析的多模态强化学习方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 强化学习 病理学 视觉问答 医学影像

📋 核心要点

- 现有方法在病理学多模态信息集成方面缺乏可解释性,且高质量数据集的缺失限制了推理能力。

- 提出ReinPath,利用语义奖励策略和群体相对策略优化,提升文本描述的准确性和相关性。

- 实验表明,ReinPath在病理学VQA数据集上超越SOTA方法,并在零样本图像分类上媲美CLIP。

📝 摘要(中文)

本文提出了一种用于病理学分析的新型多模态大型语言模型,该模型具有强大的推理能力。为了提高生成准确且上下文相关的文本描述的质量,设计了一种语义奖励策略,并结合了群体相对策略优化方法。同时,构建了一个高质量的病理学视觉问答(VQA)数据集,专门用于支持复杂的推理任务。在该数据集上进行的综合实验表明,即使仅使用20%的数据进行训练,该方法也优于目前最先进的方法。此外,该方法在下游的零样本图像分类任务中,也取得了与CLIP相当的性能。

🔬 方法详解

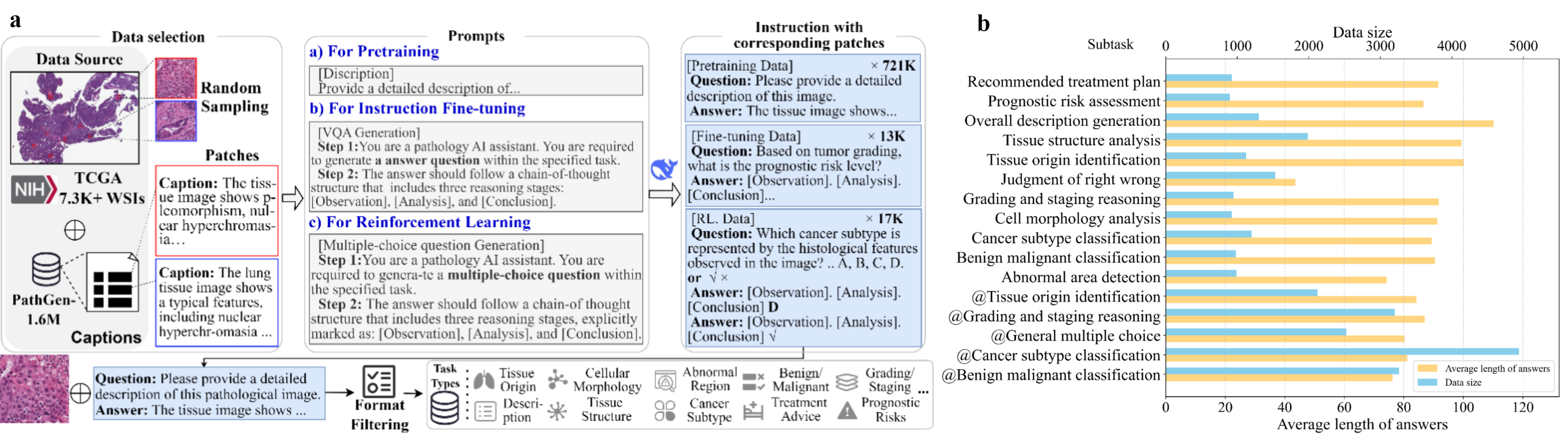

问题定义:现有计算病理学方法在整合组织病理学图像和文本数据时,由于缺乏支持显式推理的高质量数据集和简单的推理过程,导致多模态信息集成方法的可解释性有限。因此,需要一种能够进行复杂推理,并生成准确、上下文相关的文本描述的方法。

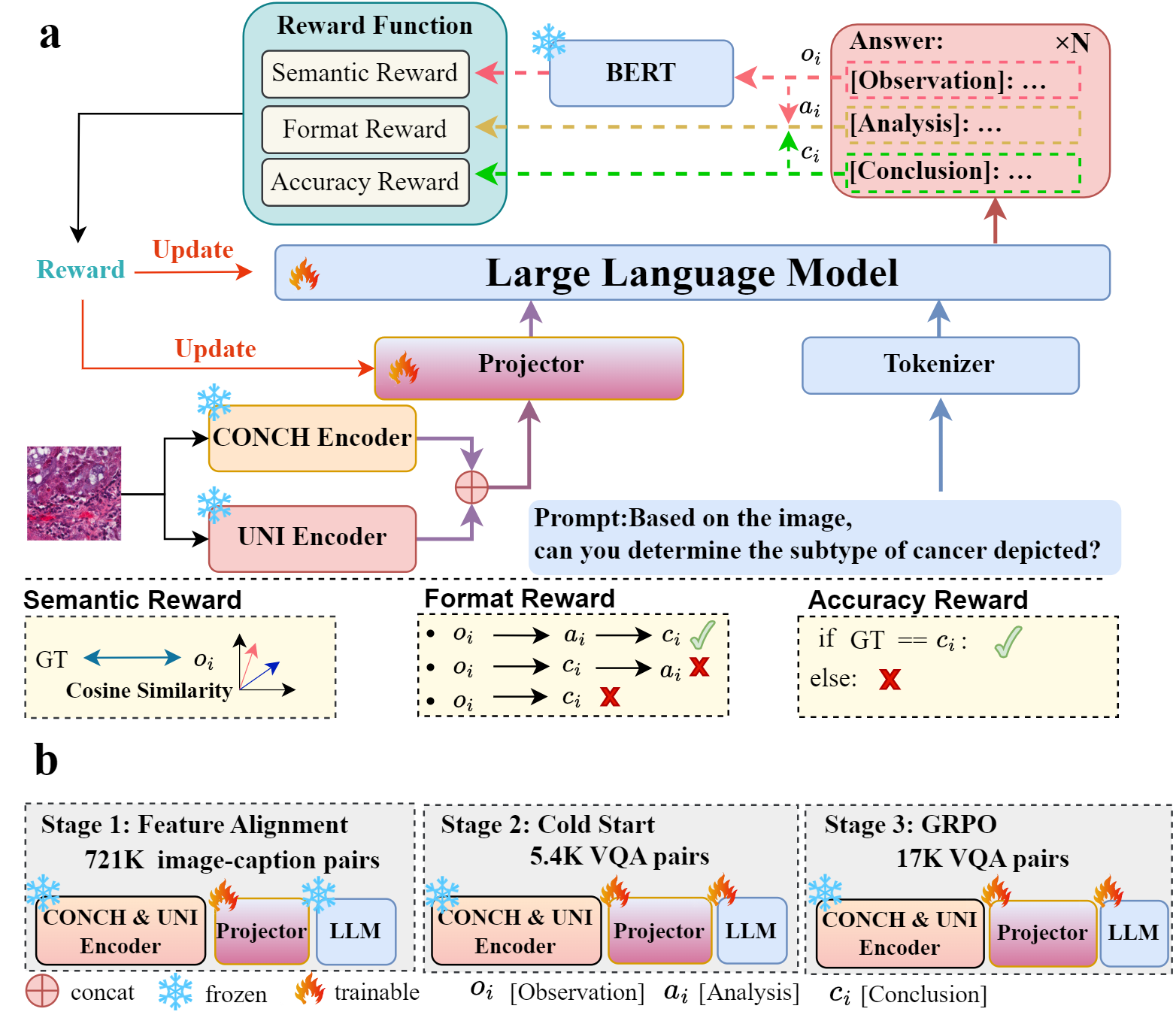

核心思路:论文的核心思路是利用强化学习来训练一个多模态大型语言模型,使其能够根据图像和问题生成高质量的答案。通过设计语义奖励策略,鼓励模型生成更准确和上下文相关的文本描述。群体相对策略优化则用于提高训练的稳定性和效率。

技术框架:ReinPath的技术框架主要包含以下几个模块:1) 图像编码器:用于提取组织病理学图像的视觉特征。2) 文本编码器:用于编码输入的问题。3) 多模态融合模块:将图像特征和文本特征进行融合,得到多模态表示。4) 语言模型:根据多模态表示生成答案。5) 强化学习模块:使用语义奖励策略和群体相对策略优化来训练语言模型。

关键创新:论文的关键创新在于:1) 提出了一个语义奖励策略,该策略能够更准确地评估生成文本的质量,并引导模型生成更符合上下文的描述。2) 结合了群体相对策略优化,提高了强化学习训练的稳定性和效率。3) 构建了一个高质量的病理学VQA数据集,为复杂推理任务提供了支持。

关键设计:语义奖励策略的设计是关键。它不仅仅依赖于文本的字面匹配,而是考虑了生成文本的语义信息。具体来说,可以使用预训练的语言模型(如BERT)来计算生成文本和ground truth之间的语义相似度,并将其作为奖励信号。群体相对策略优化则通过维护一个策略群体,并根据群体中其他策略的表现来调整当前策略,从而提高训练的鲁棒性。

🖼️ 关键图片

📊 实验亮点

ReinPath在自建的高质量病理学VQA数据集上取得了显著的性能提升,超越了现有的SOTA方法。更重要的是,即使仅使用20%的数据进行训练,ReinPath仍然能够取得优异的性能,表明其具有很强的数据效率。此外,ReinPath在零样本图像分类任务中也取得了与CLIP相当的性能,证明了其具有良好的泛化能力。

🎯 应用场景

该研究成果可应用于辅助病理诊断,帮助医生更准确地理解病理图像,并生成相应的诊断报告。此外,该方法还可以用于病理学教育和研究,例如,可以用于生成病理图像的自动描述,帮助学生更好地理解病理知识。未来,该技术有望扩展到其他医学影像领域,例如放射影像学。

📄 摘要(原文)

Interpretability is significant in computational pathology, leading to the development of multimodal information integration from histopathological image and corresponding text data.However, existing multimodal methods have limited interpretability due to the lack of high-quality dataset that support explicit reasoning and inference and simple reasoning process.To address the above problems, we introduce a novel multimodal pathology large language model with strong reasoning capabilities.To improve the generation of accurate and contextually relevant textual descriptions, we design a semantic reward strategy integrated with group relative policy optimization.We construct a high-quality pathology visual question answering (VQA) dataset, specifically designed to support complex reasoning tasks.Comprehensive experiments conducted on this dataset demonstrate that our method outperforms state-of-the-art methods, even when trained with only 20% of the data.Our method also achieves comparable performance on downstream zero-shot image classification task compared with CLIP.