FantasyVLN: Unified Multimodal Chain-of-Thought Reasoning for Vision-Language Navigation

作者: Jing Zuo, Lingzhou Mu, Fan Jiang, Chengcheng Ma, Mu Xu, Yonggang Qi

分类: cs.CV, cs.RO

发布日期: 2026-01-20

💡 一句话要点

提出FantasyVLN,用于视觉语言导航中统一的多模态链式思考推理,提升效率与性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言导航 链式思考 多模态推理 隐式推理 视觉自回归器 具身智能 长程规划

📋 核心要点

- 现有视觉语言导航方法,特别是基于链式思考的方法,存在空间定位不足或计算开销过大的问题,限制了其在实际场景中的应用。

- FantasyVLN通过将想象的视觉信息编码到紧凑的潜在空间中,实现了隐式的链式思考推理,避免了显式token生成带来的计算负担。

- 实验表明,FantasyVLN在提高导航成功率和效率的同时,显著降低了推理延迟,实现了推理感知且实时的导航。

📝 摘要(中文)

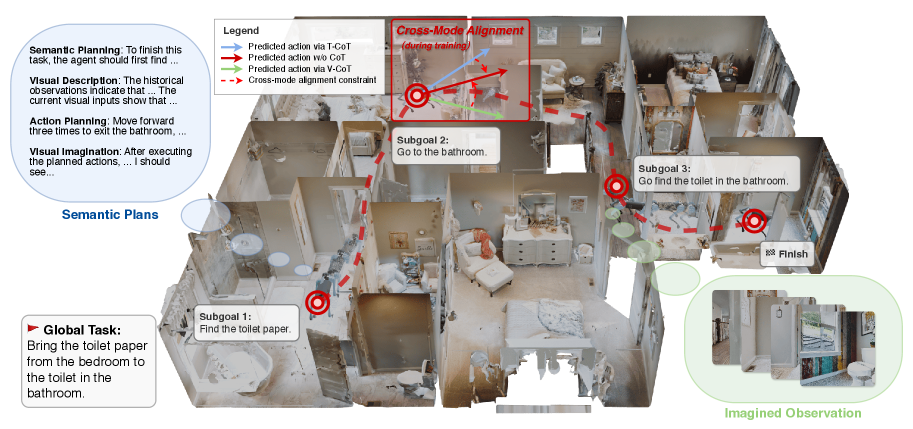

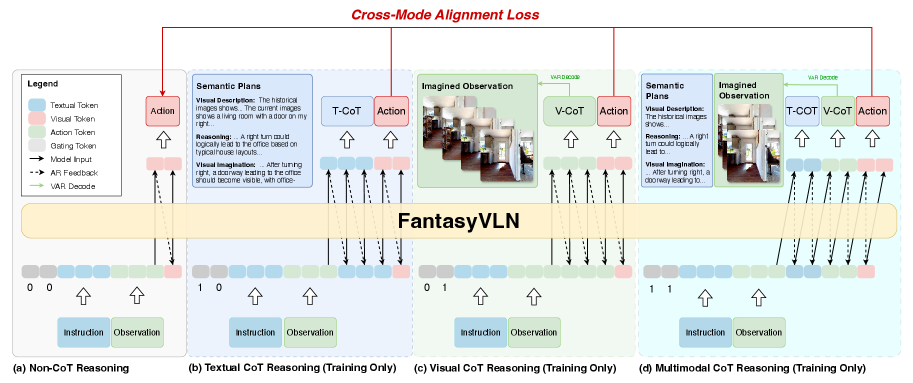

为了在视觉语言导航(VLN)中达到人类水平,具身智能体需要联合理解多模态指令和视觉空间环境,并在长动作序列上进行推理。现有方法如NavCoT和NavGPT-2展示了链式思考(CoT)推理在提高可解释性和长程规划方面的潜力。然而,纯文本CoT缺乏空间定位,容易过拟合稀疏标注的推理步骤,而多模态CoT通过生成想象的视觉观察导致严重的token膨胀,使得实时导航不切实际。本文提出了FantasyVLN,一个统一的隐式推理框架,保留了CoT推理的优点,而无需显式的token开销。具体来说,在CoT推理训练期间,使用预训练的视觉自回归器(VAR)将想象的视觉token编码到紧凑的潜在空间中,并且该模型在统一的多CoT策略下,从文本、视觉和多模态CoT模式中联合学习。在推理时,我们的模型执行直接的指令到动作的映射,同时仍然享受推理感知的表示。在LH-VLN上的大量实验表明,我们的方法实现了推理感知但实时的导航,提高了成功率和效率,同时与显式CoT方法相比,降低了一个数量级的推理延迟。

🔬 方法详解

问题定义:现有基于链式思考(CoT)的视觉语言导航方法,要么依赖纯文本推理,缺乏空间感知能力,容易过拟合;要么生成显式的视觉token进行多模态推理,导致计算量巨大,难以实现实时导航。因此,如何在保证推理能力的同时,降低计算复杂度,是本文要解决的核心问题。

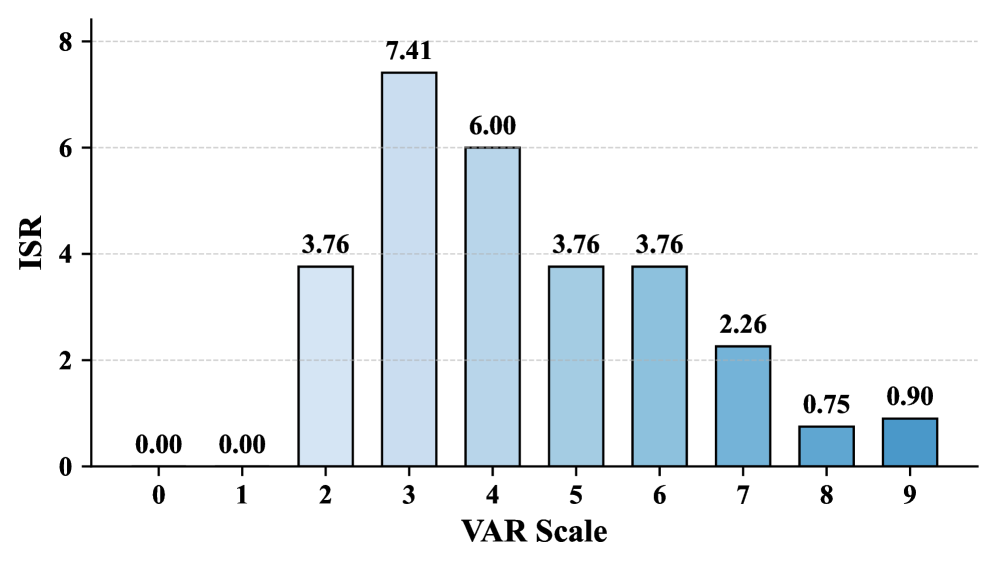

核心思路:本文的核心思路是利用预训练的视觉自回归器(VAR)将想象的视觉信息编码到紧凑的潜在空间中,从而实现隐式的链式思考推理。这种方法避免了显式生成视觉token,显著降低了计算开销,同时保留了CoT推理的优点,即能够进行推理感知的表示。

技术框架:FantasyVLN框架主要包含以下几个模块:1) 指令编码器:用于编码文本指令;2) 视觉编码器:用于编码视觉输入;3) 视觉自回归器(VAR):用于将想象的视觉信息编码到潜在空间;4) 多模态融合模块:用于融合文本、视觉和潜在空间的表示;5) 动作预测模块:用于预测下一步的动作。在训练阶段,模型从文本、视觉和多模态CoT模式中联合学习。在推理阶段,模型直接执行指令到动作的映射。

关键创新:FantasyVLN最重要的技术创新点在于提出了隐式的链式思考推理方法。与现有方法相比,FantasyVLN不需要显式生成视觉token,而是通过视觉自回归器将想象的视觉信息编码到潜在空间中,从而实现了推理感知且实时的导航。这种方法在保证推理能力的同时,显著降低了计算复杂度。

关键设计:在训练阶段,FantasyVLN采用多CoT策略,即同时从文本、视觉和多模态CoT模式中学习。损失函数包括指令预测损失、动作预测损失和VAR的重构损失。VAR采用预训练的模型,并在训练过程中进行微调。在推理阶段,模型直接执行指令到动作的映射,无需进行显式的链式思考推理。

🖼️ 关键图片

📊 实验亮点

FantasyVLN在LH-VLN数据集上取得了显著的性能提升。实验结果表明,FantasyVLN在提高导航成功率和效率的同时,与显式CoT方法相比,降低了一个数量级的推理延迟。这表明FantasyVLN能够实现推理感知且实时的导航,具有很强的实用价值。

🎯 应用场景

FantasyVLN具有广泛的应用前景,例如可以应用于机器人导航、自动驾驶、虚拟现实等领域。该研究成果有助于提升智能体在复杂环境中的导航能力,使其能够更好地理解人类指令,并做出合理的决策。此外,该方法还可以应用于其他需要多模态推理的任务中,例如视觉问答、图像描述等。

📄 摘要(原文)

Achieving human-level performance in Vision-and-Language Navigation (VLN) requires an embodied agent to jointly understand multimodal instructions and visual-spatial context while reasoning over long action sequences. Recent works, such as NavCoT and NavGPT-2, demonstrate the potential of Chain-of-Thought (CoT) reasoning for improving interpretability and long-horizon planning. Moreover, multimodal extensions like OctoNav-R1 and CoT-VLA further validate CoT as a promising pathway toward human-like navigation reasoning. However, existing approaches face critical drawbacks: purely textual CoTs lack spatial grounding and easily overfit to sparse annotated reasoning steps, while multimodal CoTs incur severe token inflation by generating imagined visual observations, making real-time navigation impractical. In this work, we propose FantasyVLN, a unified implicit reasoning framework that preserves the benefits of CoT reasoning without explicit token overhead. Specifically, imagined visual tokens are encoded into a compact latent space using a pretrained Visual AutoRegressor (VAR) during CoT reasoning training, and the model jointly learns from textual, visual, and multimodal CoT modes under a unified multi-CoT strategy. At inference, our model performs direct instruction-to-action mapping while still enjoying reasoning-aware representations. Extensive experiments on LH-VLN show that our approach achieves reasoning-aware yet real-time navigation, improving success rates and efficiency while reducing inference latency by an order of magnitude compared to explicit CoT methods.